Clear Sky Science · es

Redes neuronales de picos sin retropropagación con el algoritmo forward–forward

Enseñar a los ordenadores a pensar en picos

Muchas de las máquinas más inteligentes de hoy aprenden mediante matemáticas que no se parecen en nada a lo que ocurre en el cerebro. Este artículo explora una nueva forma de entrenar redes neuronales "de picos": modelos informáticos que se comunican con breves pulsos eléctricos, muy parecidos a las neuronas reales, sin recurrir a la receta estándar de la retropropagación. Los autores muestran que un método inspirado en el cerebro llamado algoritmo forward–forward puede enseñar a estas redes de picos a reconocer imágenes y sonidos con una precisión cercana —y a veces superior— a la de los mejores métodos existentes, a la vez que es más compatible con hardware neuromórfico de bajo consumo.

Por qué las redes de picos son difíciles de entrenar

Las redes neuronales de picos procesan la información usando ráfagas discretas, o picos, a lo largo del tiempo en lugar de números continuos y suaves. Esto las hace atractivas para el cálculo eficiente en energía y para imitar cerebros biológicos. Pero también complica los algoritmos de aprendizaje convencionales: la retropropagación necesita gradientes suaves para ajustar las conexiones entre neuronas, mientras que los picos son eventos todo-o-nada. Existen soluciones —como gradientes sustitutos que simulan suavidad durante el aprendizaje—, pero la retropropagación sigue requiriendo almacenar grandes cantidades de actividad intermedia y enviar señales de error precisas hacia atrás por cada capa, supuestos que son tanto costosos computacionalmente como poco realistas desde el punto de vista biológico.

Un camino distinto: aprender con dos pases hacia delante

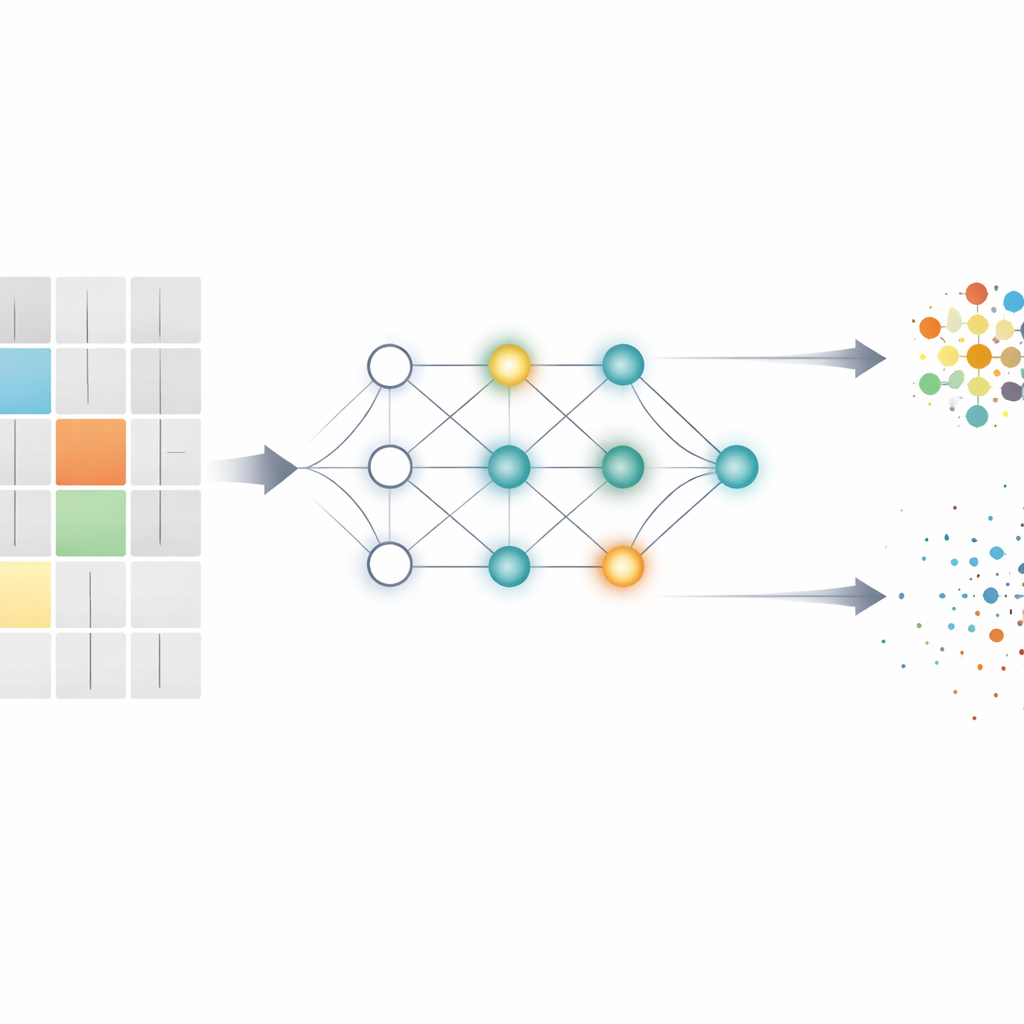

El algoritmo forward–forward propone un enfoque alternativo. En lugar de un pase hacia delante seguido de una pasada hacia atrás con señales de error, cada capa de la red se entrena usando solo dos pases hacia delante: uno con ejemplos "positivos" que coinciden con la etiqueta correcta y otro con ejemplos "negativos" construidos de forma controlada para ser erróneos. Para cada capa, la red mide una puntuación sencilla llamada "bondad", basada en la fuerza de la respuesta de sus neuronas. El objetivo es que la bondad sea alta para entradas positivas y baja para las negativas. Dado que cada capa usa únicamente su propia actividad para actualizar sus conexiones, no es necesario enviar señales de error a lo largo de toda la red, y el algoritmo se vuelve más local, modular y adecuado para hardware.

Hacer que forward–forward funcione con picos

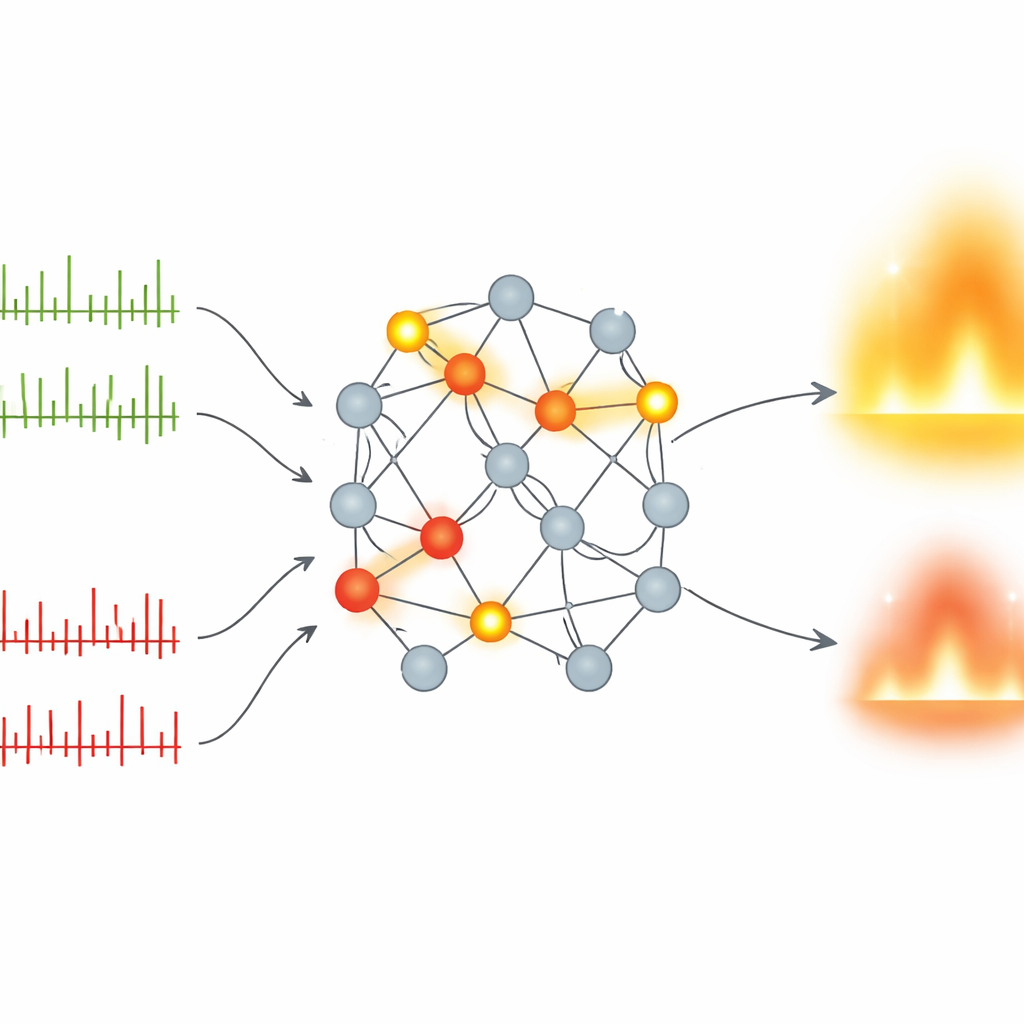

Los autores adaptan esta idea a redes de picos diseñando con cuidado cómo se codifican las entradas y las etiquetas y cómo se mide la bondad. Primero, imágenes o patrones sonoros se transforman en trenes de picos usando codificación por tasa: entradas más intensas generan más picos durante una breve secuencia de pasos temporales. Las etiquetas se incorporan directamente en una parte de la entrada, de modo que un único vector contiene tanto los datos como una clase candidata. Las muestras positivas usan la etiqueta correcta; las negativas usan una etiqueta incorrecta deliberadamente "difícil", elegida entre clases que la red tiende a confundir. A medida que los picos atraviesan capas de neuronas leaky integrate-and-fire, el modelo cuenta cuántas veces dispara cada neurona en pases positivos y negativos. La bondad de una capa se define por los recuentos globales de picos, y una función de pérdida suave fomenta que la bondad positiva supere a la negativa por un margen cómodo manteniendo los gradientes estables.

¿Qué rendimiento ofrece este método basado en picos?

Para evaluar su planteamiento, los autores entrenan redes de picos compactas en varios benchmarks visuales estándar, incluidos dígitos manuscritos (MNIST), prendas de moda, caracteres japoneses y imágenes de objetos a color (CIFAR-10), así como conjuntos neuromórficos donde las entradas ya llegan en forma de picos, como registros de dígitos basados en eventos (N-MNIST) y dígitos hablados codificados como trenes de picos (SHD). A pesar de usar solo dos capas ocultas y tan solo 10 pasos temporales, sus modelos forward–forward con picos igualan o superan a otros sistemas forward–forward para picos y se acercan a las mejores redes de picos entrenadas con retropropagación. En tareas temporales más exigentes como SHD, su método incluso supera a varios modelos de picos basados en retropropagación, todo ello usando menos parámetros y siendo más fácil de mapear a hardware orientado a eventos.

Qué implica esto para máquinas futuras más parecidas al cerebro

Para un lector general, el mensaje clave es que existe ahora una forma prometedora de entrenar redes inspiradas en el cerebro y basadas en picos sin depender de la pesada maquinaria de la retropropagación. Al juzgar cada capa por cuán intensamente responde a ejemplos buenos frente a malos, y trabajando únicamente con pases hacia delante, el enfoque forward–forward mantiene el aprendizaje local y modular y, aun así, alcanza una precisión competitiva. Aunque algunos ingredientes —como gradientes sustitutos e incrustación explícita de etiquetas— no son estrictamente biológicos, este marco aproxima el aprendizaje automático a la forma en que los sistemas nerviosos reales podrían adaptarse, y abre un camino hacia dispositivos inteligentes más eficientes y de bajo consumo que aprendan de datos sensoriales en flujo en tiempo real.

Cita: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Palabras clave: redes neuronales de picos, aprendizaje forward-forward, informática neuromórfica, IA inspirada biológicamente, alternativas a la retropropagación