Clear Sky Science · it

Reti neurali a spike senza backpropagation con l’algoritmo forward–forward

Insegnare ai computer a pensare a impulsi

Molti degli odierni sistemi più intelligenti apprendono usando formalismi matematici che non somigliano a ciò che avviene nel cervello. Questo articolo esplora un nuovo modo di addestrare le reti neurali “a spike” — modelli computazionali che comunicano con brevi impulsi elettrici, simili a quelli dei neuroni reali — senza fare affidamento sulla classica ricetta della backpropagation. Gli autori dimostrano che un metodo ispirato al cervello, chiamato algoritmo forward–forward, può insegnare a queste reti a riconoscere immagini e suoni con un’accuratezza vicino, e talvolta superiore, alle migliori tecniche esistenti, risultando al contempo più compatibile con hardware neuromorfico a basso consumo.

Perché è difficile addestrare i cervelli a spike

Le reti neurali a spike elaborano informazioni usando scosse discrete, o spike, nel tempo invece di numeri continui e lisci. Questo le rende attraenti per il calcolo a elevata efficienza energetica e per imitare cervelli biologici. Ma crea anche problemi per gli algoritmi di apprendimento convenzionali: la backpropagation richiede gradienti continui per aggiustare le connessioni tra neuroni, mentre gli spike sono eventi tutto-o-nulla. Esistono stratagemmi — come i gradienti surrogate che fingono che gli spike siano lisci durante l’apprendimento — ma la backpropagation richiede comunque di memorizzare grandi quantità di attività intermedie e di inviare segnali di errore precisi all’indietro attraverso ogni livello, ipotesi che risultano onerose dal punto di vista computazionale e biologicamente poco realistiche.

Una via diversa: apprendere con due passaggi in avanti

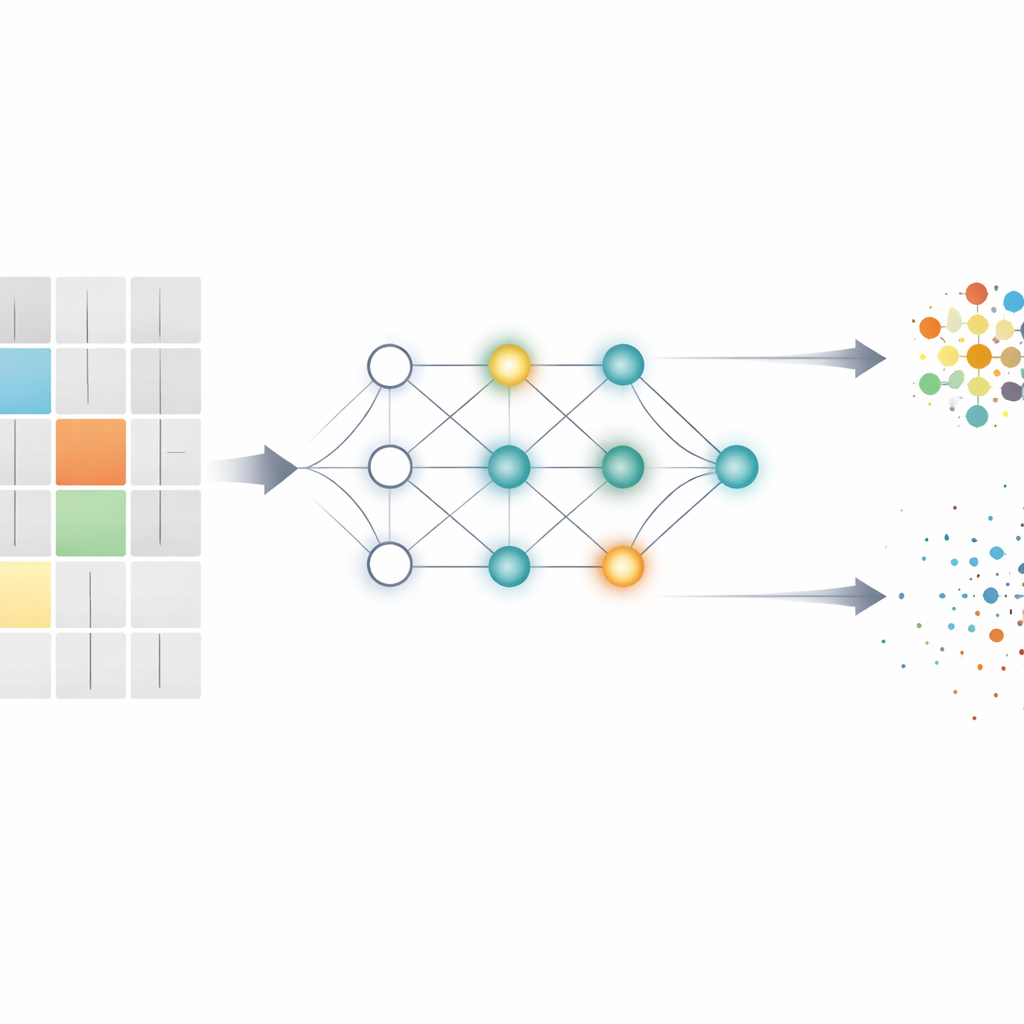

L’algoritmo forward–forward propone un approccio alternativo. Invece di una singola passata in avanti seguita da una retropropagazione degli errori, ogni livello della rete viene addestrato usando soltanto due passate in avanti: una con esempi “positivi” che corrispondono all’etichetta corretta e una con esempi “negativi” costruiti per essere sbagliati in modo controllato. Per ogni livello la rete misura un punteggio semplice chiamato “goodness”, basato su quanto intensamente rispondono i suoi neuroni. L’obiettivo è rendere la goodness alta per gli input positivi e bassa per quelli negativi. Poiché ogni livello usa solo la propria attività per aggiornare le connessioni, non è necessario inviare segnali di errore attraverso tutta la rete: l’algoritmo diventa così più locale, modulare e favorevole all’hardware.

Far funzionare il forward–forward con gli spike

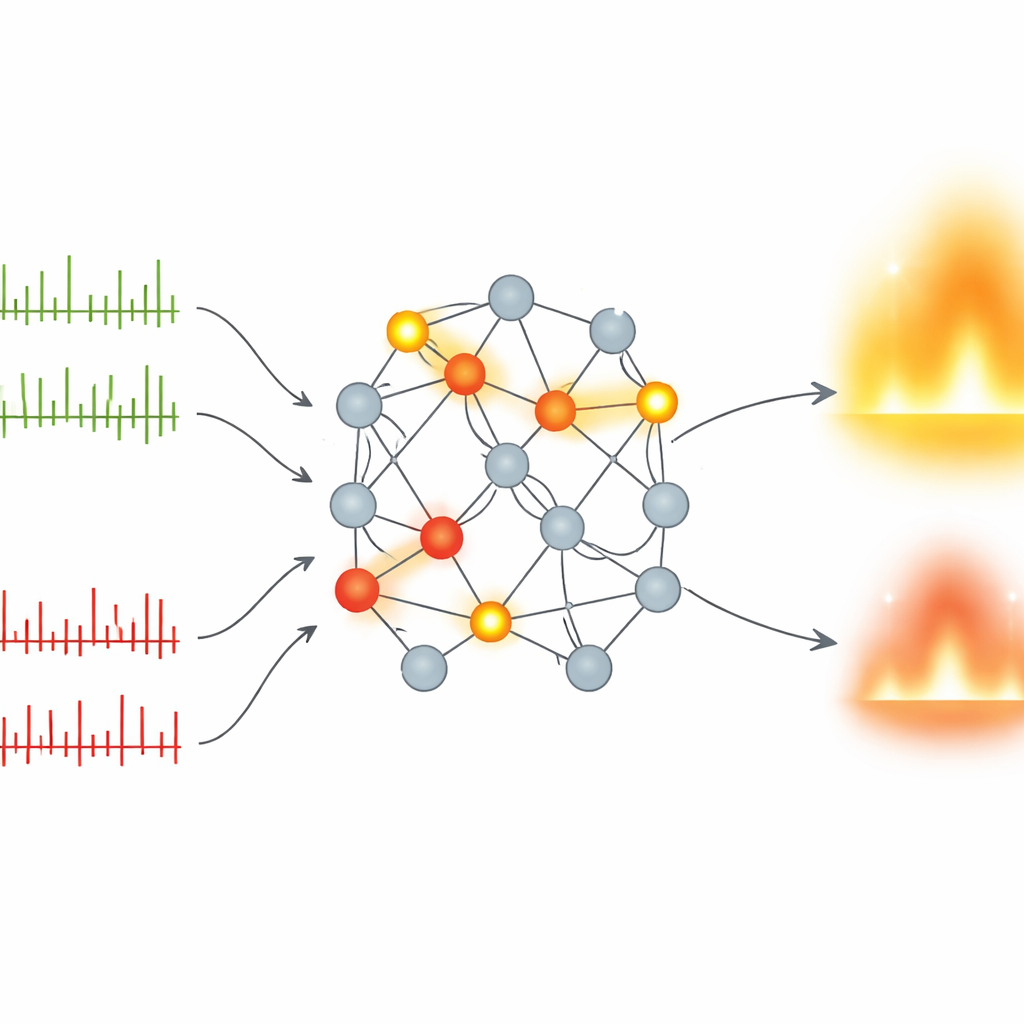

Gli autori adattano questa idea alle reti a spike progettando con cura come vengono codificati input ed etichette e come viene misurata la goodness. Innanzitutto, immagini o pattern sonori vengono convertiti in treni di spike tramite rate coding — input più intensi generano più spike in una breve serie di passi temporali. Le etichette sono incorporate direttamente in una parte dell’input, così un unico vettore contiene sia i dati sia una classe candidata. I campioni positivi usano l’etichetta corretta; i campioni negativi usano un’etichetta scorretta scelta intenzionalmente come “difficile” tra le classi che la rete tende a confondere. Mentre gli spike scorrono attraverso strati di neuroni leaky integrate-and-fire, il modello conta quante volte ciascun neurone spara nelle passate positive e negative. La goodness di un livello viene quindi definita dai conteggi complessivi di spike, e una funzione di perdita levigata incentiva la goodness positiva a superare quella negativa con un margine confortevole mantenendo stabili i gradienti.

Quanto bene funziona questo metodo a spike?

Per valutare l’approccio, gli autori addestrano reti a spike compatte su diversi benchmark visivi standard, inclusi cifre scritte a mano (MNIST), capi di abbigliamento, caratteri giapponesi e immagini a colori di oggetti (CIFAR-10), oltre a dataset neuromorfici in cui gli input arrivano già sotto forma di spike, come registrazioni event-based di cifre (N-MNIST) e cifre pronunciate codificate come treni di spike (SHD). Pur usando soltanto due strati nascosti e appena 10 passi temporali, i loro modelli forward–forward a spike equiparano o superano altri sistemi forward–forward a spike e si avvicinano ai migliori modelli a spike addestrati con backpropagation. Su compiti temporali più impegnativi come SHD, il loro metodo supera persino diversi modelli a spike basati su backpropagation, il tutto utilizzando meno parametri e restando più semplice da mappare su hardware event-driven.

Cosa significa per le macchine future simili al cervello

Per il lettore non specialistico, il messaggio principale è che esiste ora una via promettente per addestrare reti ispirate al cervello e basate su spike senza fare affidamento sulla pesante macchina della backpropagation. Giudicando ogni livello in base a quanto risponde a esempi buoni rispetto a quelli cattivi e lavorando esclusivamente con passate in avanti, l’approccio forward–forward mantiene l’apprendimento locale e modulare pur ottenendo accuratezza competitiva. Sebbene alcuni ingredienti — come i gradienti surrogate e l’incorporamento esplicito delle etichette — non siano strettamente biologici, questo quadro avvicina il machine learning a come i sistemi nervosi reali potrebbero adattarsi e apre la strada a dispositivi intelligenti più efficienti e a basso consumo che apprendono da flussi sensoriali in tempo reale.

Citazione: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Parole chiave: reti neurali a spike, apprendimento forward-forward, calcolo neuromorfico, IA ispirata alla biologia, alternative alla backpropagation