Clear Sky Science · de

Spiking-Neuronale Netze ohne Backpropagation mit dem Forward–Forward-Algorithmus

Computern beibringen, in Spikes zu denken

Viele der heute leistungsfähigsten Maschinen lernen mit Mathematik, die kaum dem ähnelt, was im Gehirn passiert. Dieses Papier untersucht eine neue Methode, spiking neuronale Netze zu trainieren — Modellrechnungen, die sich mit kurzen elektrischen Impulsen verständigen, ähnlich wie reale Neuronen — ohne auf das klassische Backpropagation-Rezept zurückzugreifen. Die Autoren zeigen, dass ein vom Gehirn inspiriertes Verfahren, der Forward–Forward-Algorithmus, diesen spiking Netzen beibringen kann, Bilder und Geräusche mit einer Genauigkeit zu erkennen, die nahe an die besten existierenden Methoden herankommt und sie teils übertrifft, dabei aber besser mit energieeffizienter, neuromorpher Hardware kompatibel ist.

Warum spikende Netze schwer zu trainieren sind

Spiking neuronale Netze verarbeiten Informationen über die Zeit mit diskreten Impulsen oder Spikes statt mit glatten, kontinuierlichen Zahlen. Das macht sie attraktiv für energieeffizientes Rechnen und für die Nachahmung biologischer Gehirne. Gleichzeitig stellt es konventionelle Lernalgorithmen vor Probleme: Backpropagation benötigt glatte Gradienten, um Verbindungen zwischen Neuronen anzupassen, während Spikes Alles-oder-Nichts-Ereignisse sind. Es gibt Umgehungslösungen — etwa Surrogat-Gradienten, die so tun, als seien Spikes während des Lernens glatt — doch Backpropagation verlangt weiterhin, große Mengen an Zwischenaktivität zu speichern und genaue Fehlersignale rückwärts durch jede Schicht zu schicken. Das sind Annahmen, die sowohl rechenintensiv als auch biologisch unrealistisch sind.

Ein anderer Weg: Lernen mit zwei Vorwärtsdurchläufen

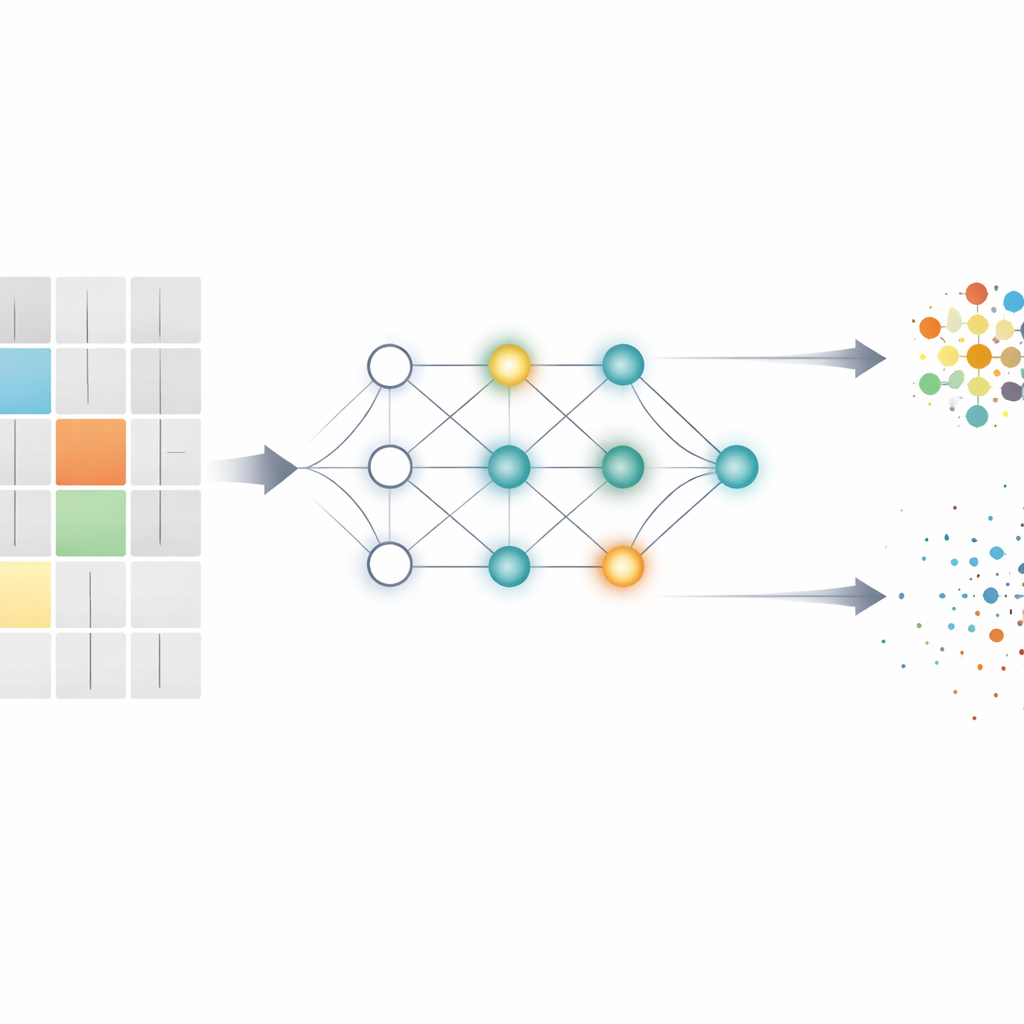

Der Forward–Forward-Algorithmus verfolgt einen kontrastierenden Ansatz. Anstatt eines Vorwärtsdurchlaufs gefolgt von einer Rückpropagierung von Fehlersignalen wird jede Schicht des Netzes allein mit zwei Vorwärtsdurchläufen trainiert: einem mit „positiven“ Beispielen, die zum korrekten Label passen, und einem mit „negativen“ Beispielen, die gezielt auf eine falsche, aber kontrollierte Weise konstruiert sind. Für jede Schicht misst das Netz eine einfache Größe, die als „Goodness“ bezeichnet wird und darauf basiert, wie stark ihre Neuronen reagieren. Das Ziel ist, die Goodness für positive Eingaben hoch und für negative Eingaben niedrig zu machen. Weil jede Schicht nur ihre eigene Aktivität zur Aktualisierung ihrer Verbindungen nutzt, müssen keine Fehlersignale durch das gesamte Netz zurückgesendet werden; der Algorithmus wird dadurch lokaler, modularer und hardwarefreundlicher.

Forward–Forward für Spikes nutzbar machen

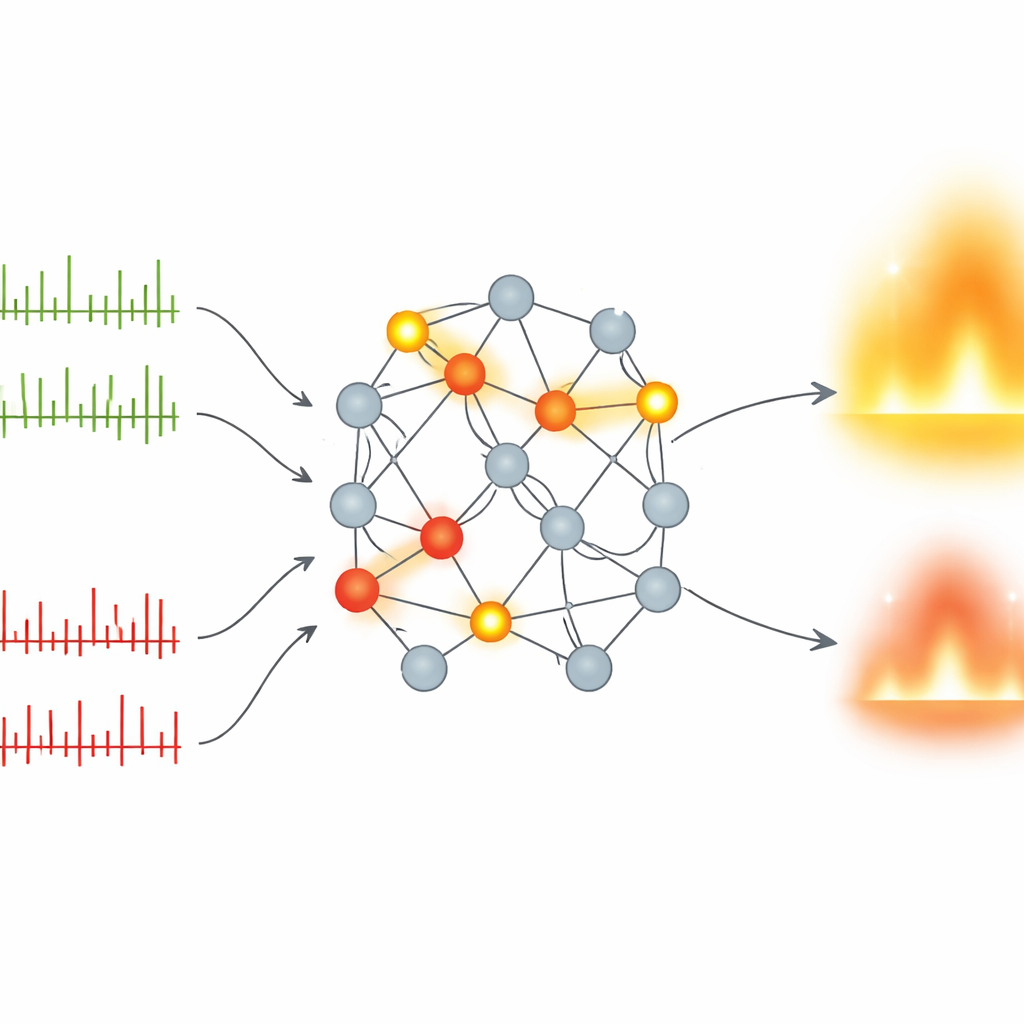

Die Autoren passen diese Idee an spiking Netze an, indem sie sorgfältig festlegen, wie Eingaben und Labels kodiert und wie Goodness gemessen wird. Zuerst werden Bilder oder Klangmuster mittels Rate-Coding in Spike-Trains umgewandelt — intensivere Eingaben erzeugen über eine kurze Folge von Zeitschritten mehr Spikes. Labels werden direkt in einen Teil der Eingabe eingebettet, sodass ein einziger Vektor sowohl die Daten als auch eine Kandidatenklasse trägt. Positive Beispiele nutzen das korrekte Label; negative Beispiele verwenden gezielt ein „schweres“ falsches Label, das aus Klassen gewählt wird, die das Netz häufig verwechselt. Während Spikes durch Schichten von leaky integrate-and-fire Neuronen fließen, zählt das Modell, wie oft jedes Neuron in positiven und negativen Durchläufen feuert. Die Goodness einer Schicht wird durch die gesamten Spike-Zählungen definiert, und eine glatte Verlustfunktion sorgt dafür, dass die positive Goodness die negative um einen komfortablen Abstand übertrifft, während die Gradienten stabil bleiben.

Wie gut funktioniert diese spiking Methode?

Um den Ansatz zu testen, trainieren die Autoren kompakte spiking Netze auf mehreren Standard-Visionsbenchmarks, darunter handgeschriebene Ziffern (MNIST), Modeartikel, japanische Zeichen und farbige Objektbilder (CIFAR-10), sowie auf neuromorphen Datensätzen, bei denen Eingaben bereits als Spikes vorliegen, wie ereignisbasierte Ziffernaufzeichnungen (N-MNIST) und gesprochene Ziffern, die als Spike-Trains kodiert sind (SHD). Trotz der Verwendung von nur zwei versteckten Schichten und so wenigen wie 10 Zeitschritten erreichen ihre Forward–Forward-Spiking-Modelle Werte, die andere Forward–Forward-Spiking-Systeme übertreffen oder erreichen, und kommen nahe an die besten mit Backpropagation trainierten spiking Netze heran. Bei anspruchsvolleren zeitlichen Aufgaben wie SHD übertrifft ihre Methode sogar mehrere backpropagation-basierte spiking Modelle, und das bei weniger Parametern und besserer Eignung für ereignisgetriebene Hardware.

Was das für zukünftige gehirnähnliche Maschinen bedeutet

Für eine nicht-technische Leserschaft ist die Kernbotschaft, dass es nun einen vielversprechenden Weg gibt, gehirninspirierte, spike-basierte Netze zu trainieren, ohne auf die schwere Maschinerie der Backpropagation angewiesen zu sein. Indem jede Schicht danach beurteilt wird, wie stark sie auf gute gegenüber schlechten Beispielen reagiert, und indem ausschließlich mit Vorwärtsdurchläufen gearbeitet wird, bleibt das Lernen lokal und modular, während es gleichzeitig konkurrenzfähige Genauigkeit erreicht. Obwohl einige Zutaten — wie Surrogat-Gradienten und explizite Label-Einbettungen — nicht strikt biologisch sind, rückt dieses Rahmenwerk das maschinelle Lernen einen Schritt näher an die Art und Weise, wie reale Nervensysteme sich anpassen könnten, und öffnet den Weg zu effizienteren, energiearmen intelligenten Geräten, die aus kontinuierlichen sensorischen Daten in Echtzeit lernen.

Zitation: Ghader, M., Kheradpisheh, S.R., Farahani, B. et al. Backpropagation-free spiking neural networks with the forward–forward algorithm. Sci Rep 16, 14294 (2026). https://doi.org/10.1038/s41598-026-41671-4

Schlüsselwörter: spiking neuronale Netze, forward-forward Lernen, neuromorphe Berechnung, biologisch inspirierte KI, Alternativen zu Backpropagation