Clear Sky Science · zh

将人工智能融入教育的伦理考量:一种用于预测透明度评分的新型深度神经网络框架

这对学生和教师为何重要

世界各地的课堂正在迅速采用人工智能工具来批改作业、推荐课程以及标记可能需要帮助的学生。然而,大多数人对这些系统如何做出决策、或是否对所有人一视同仁知之甚少。本研究提出了一种衡量教育类人工智能系统“可见度”(透明度)的方法,并展示了一种新模型 EduTransNet,力图在保持公平、隐私和问责为核心的同时,做出强有力的预测。

看清人工智能的决策过程

论文的核心是一个新的量尺——透明度评分。研究者并不只以预测准确性来评判教育人工智能,而是问:我们能否解释其推理、追溯输入如何导致输出、与非专家清晰地讨论其决策,以及证明它遵循伦理规则?他们将这四个要素——可解释性、可追溯性、沟通清晰度和伦理合规——打包为一个从0到100的综合分数。高分意味着该人工智能系统的行为可以被学生、教师和管理者检查和质询,而不是隐藏在黑箱中。

新模型如何从学生中学习

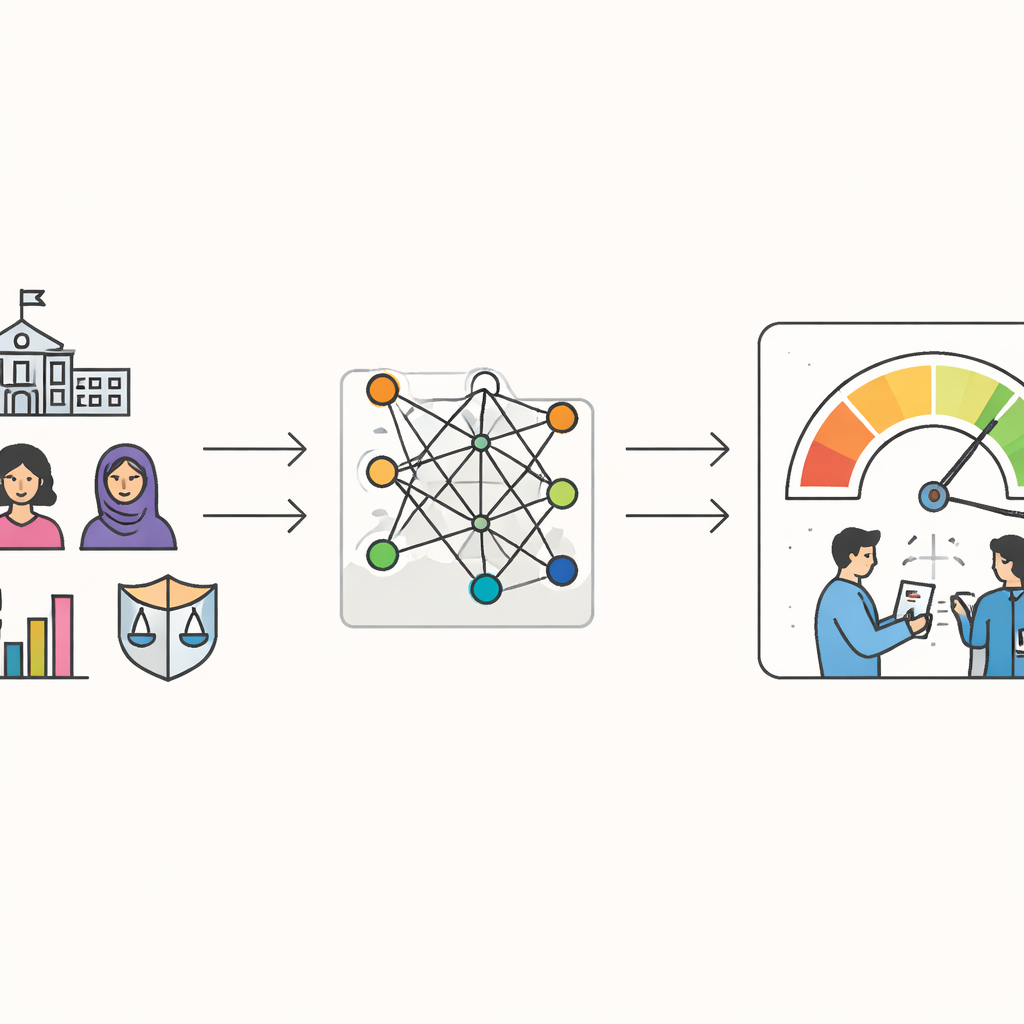

为检验这一想法,研究人员收集了来自巴基斯坦三所大学的2,847名学生的数据。信息包括年龄与性别等基本人口统计、出勤与每周学习时长等学习行为、成绩,以及有关隐私担忧、对算法偏见的意识、公平感受和对开放性的期望的问卷回应。利用这些要素,EduTransNet 学会预测每位学生的透明度评分——实质上估计一个由人工智能驱动的决策对该学生及其类似同伴而言会感觉有多透明。重要的是,模型最依赖于参与度和伦理感知特征,而在人口统计学特征上的权重要小得多,表明模型更多由学生的行为和感受驱动,而非他们的身份。

为人工智能模型设立护栏

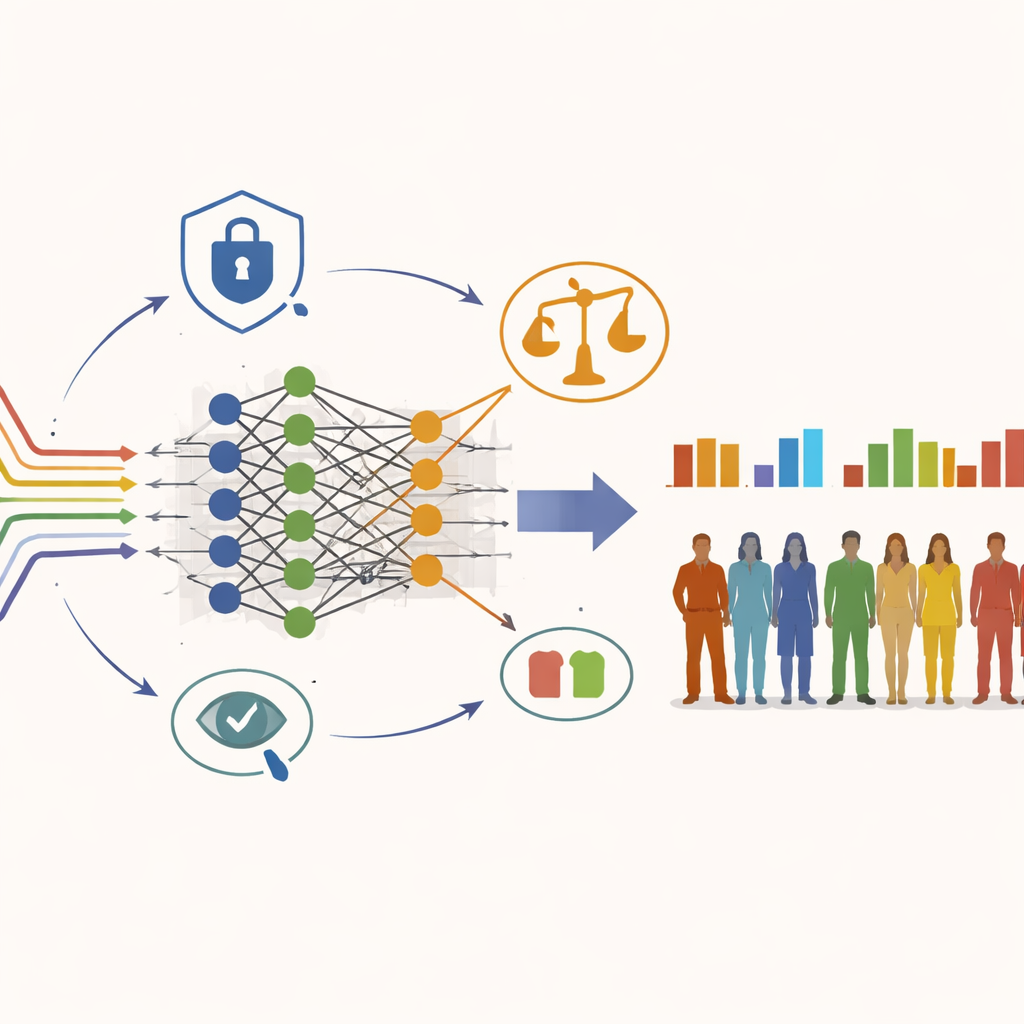

EduTransNet 是为此任务专门调优的深度神经网络。它堆叠若干层,逐步压缩和提炼输入数据为单一的透明度预测。但与许多只关注准确性的强大模型不同,该模型在设计上带有护栏。训练过程中明确惩罚那种某一性别或族群持续获得较高或较低预测分数的模式。作者还将隐私与有用性之间的正式折衷纳入其中,使用匿名化和加噪技术,使得个体学生不易被重新识别,同时系统仍能学习到有意义的模式。

检验准确性、公平性与隐私

研究团队将 EduTransNet 与三种常见预测工具进行了比较:线性回归、支持向量回归和随机森林。在重复测试以及对从未见过的保留学生样本上,EduTransNet 解释了约99–100%的透明度评分变异,同时其误差远小于其他模型。统计检验表明,这一强劲表现并非仅仅对数据偶然特征的过拟合。与此同时,使用既有工具包进行的公平性审计显示,预测分数在性别和族群之间保持接近平衡,错误率并未系统性地偏袒任何一组。独立分析也确认,隐私保护足够强,从而在限制重新识别风险的同时仍支持准确的学习。

这对真实课堂意味着什么

除了数学与技术细节外,研究还探讨了此类系统在实践中的可能用途。在一种情境中,EduTransNet 有助于识别可能处于学业风险的学生,但每个风险标记都会配上高或低的透明度评分,便于教师判断应信任警报到何种程度以及如何解释该提示。在另一种情境中,它在支持课程与职业推荐时,会检查建议是否在不经意间将弱势学生引向更狭窄的路径。在政策层面,聚合的透明度评分可以突出哪些学校或项目在人工智能决策上显得不透明,从而在不暴露个体的情况下指导有针对性的改革。

给非专业读者的要点

核心结论是,在教育中我们不必在强大人工智能与负责任人工智能之间做选择。通过像 EduTransNet 这样的设计,将透明性与公平性作为核心设计目标——而非事后补救——开发者可以构建既高度准确又更易被质询、监控和改进的系统。尽管目前的结果来自三所大学,仍需在其他环境中检验,但该框架为想要利用智能工具同时不放弃学生权利、隐私或机会平等的学校、政策制定者与人工智能开发者提供了一条具体路径。

引用: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

关键词: 教育中的人工智能, 算法透明度, 伦理人工智能, 学生隐私, 机器学习中的公平性