Clear Sky Science · sv

Etiska överväganden vid integrering av artificiell intelligens i utbildning: en ny ram med djupa neurala nätverk för att förutsäga transparenspoäng

Varför detta är viktigt för studenter och lärare

Klassrum världen över inför snabbt AI-verktyg för att rätta arbeten, rekommendera kurser och markera studenter som kan behöva stöd. Ändå har de flesta liten insikt i hur dessa system faktiskt fattar beslut eller om de behandlar alla rättvist. Denna studie introducerar ett sätt att mäta hur "genomskinliga" sådana utbildnings-AI-system är, och presenterar en ny modell, EduTransNet, som syftar till att göra kraftfulla förutsägelser samtidigt som rättvisa, integritet och ansvarstagande står i centrum.

Att se in i AI-beslut

I hjärtat av artikeln finns en ny måttstock kallad transparenspoäng. Istället för att bedöma AI i utbildning endast utifrån hur träffsäker dess prognoser är, frågar författarna: kan vi förklara dess resonemang, spåra hur ingångar leder till utgångar, kommunicera dess beslut tydligt med lekmän och visa att den följer etiska regler? De paketerar dessa fyra ingredienser—förklarbarhet, spårbarhet, tydlighet i kommunikationen och etisk efterlevnad—till en enda poäng från 0 till 100. Höga poäng signalerar AI-system vars beteende kan inspekteras och ifrågasättas av studenter, lärare och administratörer i stället för att gömmas i en svart låda.

Hur den nya modellen lär av studenter

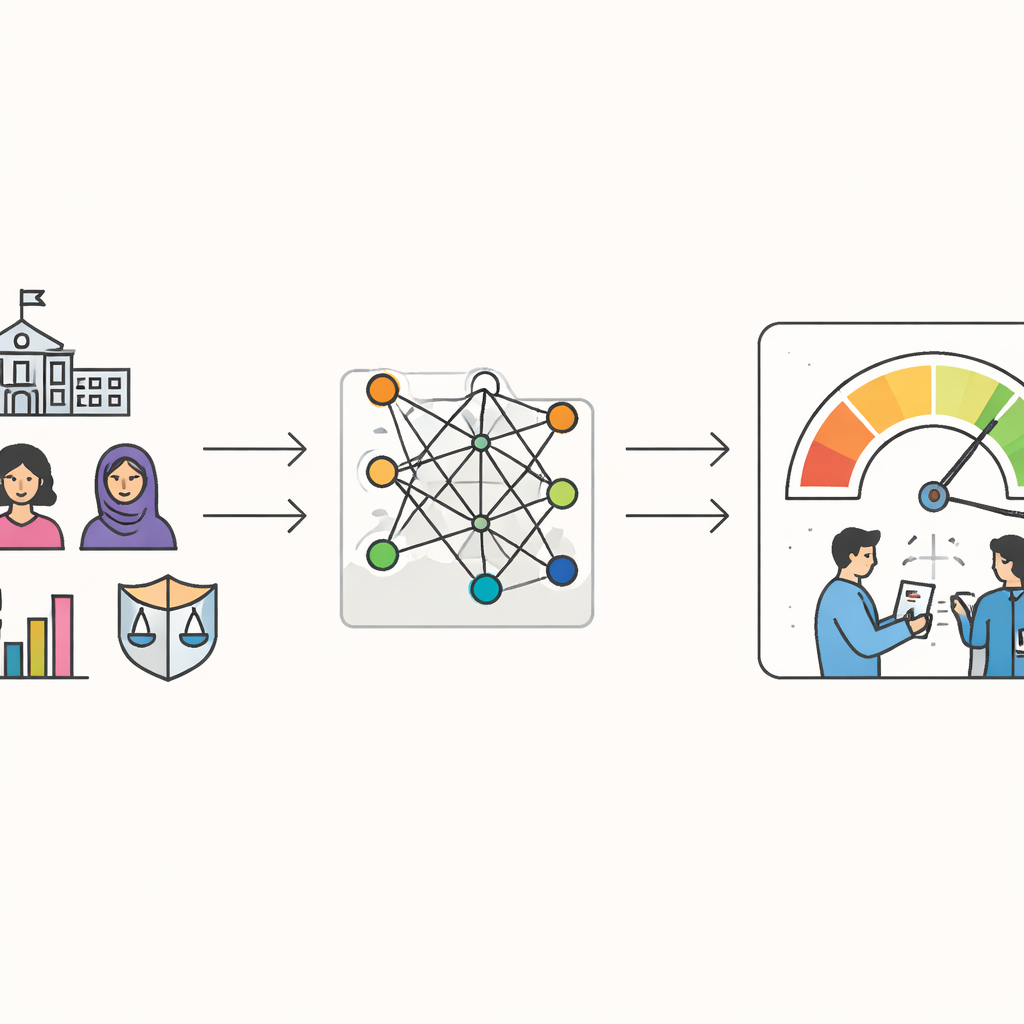

För att testa idén samlade forskarna in data från 2 847 studenter vid tre universitet i Pakistan. Informationen inkluderade grundläggande demografi som ålder och kön, studievanor som närvaro och veckovisa studietimmar, betyg och enkät svar om integritetsoro, medvetenhet om algoritmisk bias, upplevelse av rättvisa och förväntningar på öppenhet. Med dessa ingredienser lär sig EduTransNet att förutsäga varje students transparenspoäng—i praktiken att uppskatta hur transparent ett AI-drivet beslut skulle upplevas av den studenten och liknande jämnåriga. Viktigt är att modellen förlitar sig mest på engagemangs- och etikkopplade egenskaper, och mycket mindre på demografi, vilket tyder på att den drivs mer av hur studenter agerar och uppfattar än av vem de är.

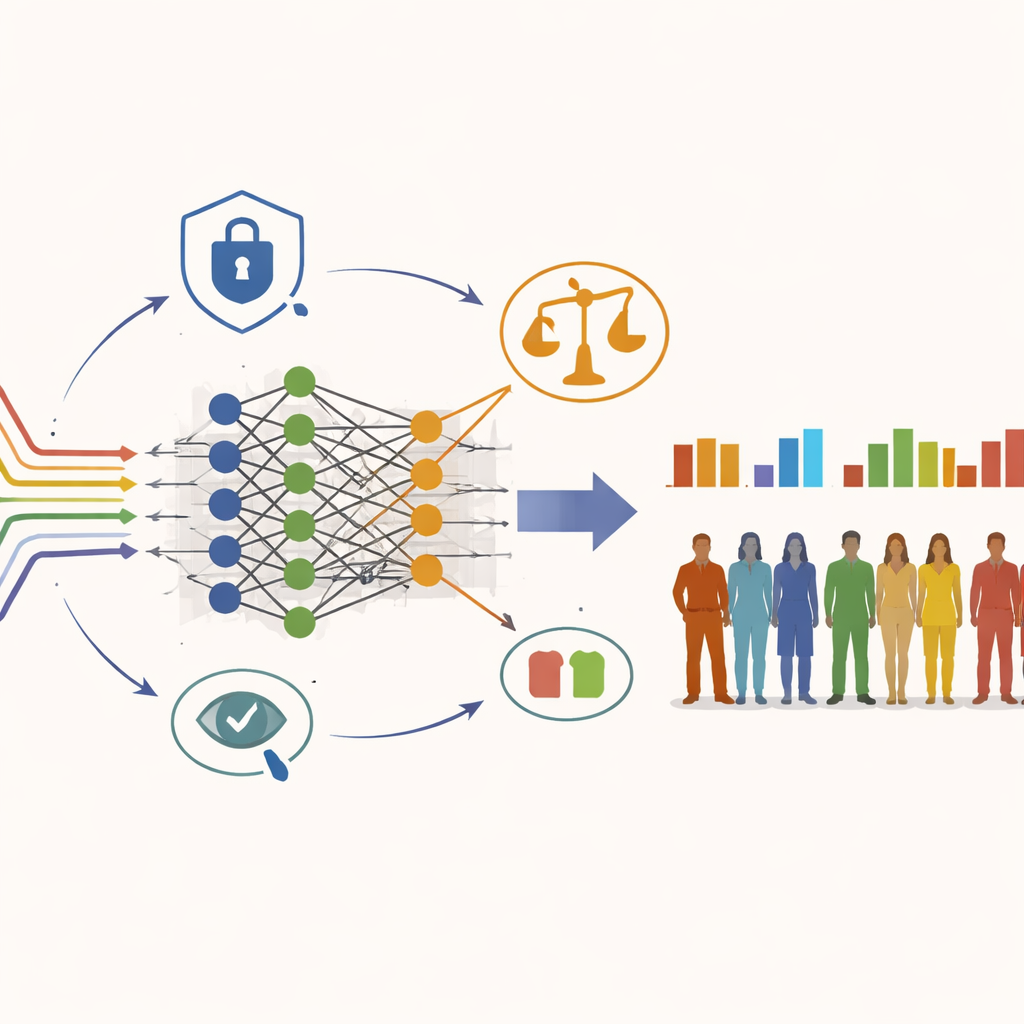

Bygga en AI-modell med skyddsräcken

EduTransNet är ett djupt neuralt nätverk justerat specifikt för denna uppgift. Det staplar flera lager som gradvis komprimerar och förfinar ingångsdata till en enda transparensprediktion. Men till skillnad från många kraftfulla modeller som fokuserar enbart på noggrannhet är denna utformad med skyddsräcken. Träningsprocessen straffar uttryckligen mönster där ett kön eller en etnisk grupp konsekvent får högre eller lägre förutsagda poäng än andra. Författarna väver också in en formell avvägning mellan sekretess och användbarhet, genom att använda anonymisering och brusläggning så att enskilda studenter inte lätt kan återidentifieras samtidigt som systemet fortfarande lär sig meningsfulla mönster.

Kontroll av noggrannhet, rättvisa och integritet

Teamet jämförde EduTransNet med tre vanliga prediktiva verktyg: linjär regression, stödvektorregering och random forests. Över upprepade tester och på en håll-tillbaka-uppsättning av studenter som modellen aldrig sett förut förklarade EduTransNet cirka 99–100 procent av variationen i transparenspoäng, samtidigt som den gjorde mycket mindre fel än de andra modellerna. Statistiska kontroller antydde att denna starka prestation inte bara beror på överanpassning till dataegenskaper. Samtidigt visade rättvisegranskningar med etablerade verktyg att de förutsagda poängen var välbalanserade över köns- och etniska grupper, och att felaktighetsfrekvenser inte systematiskt gynnade någon enskild grupp. Separata analyser bekräftade att integritetsskydden var tillräckligt starka för att begränsa återidentifieringsrisker samtidigt som de stödde korrekt lärande.

Vad detta betyder för verkliga klassrum

Bortom matematiken undersöker studien hur ett sådant system kan användas i praktiken. I ett scenario hjälper EduTransNet till att identifiera studenter som kan vara i akademisk risk, men parar varje riskmarkering med en hög- eller låg-transparenspoäng så att lärare vet hur mycket de kan lita på och hur de ska förklara varningen. I ett annat stödjer det kurs- och karriärrekommendationer samtidigt som det kontrollerar att förslag inte tyst styr missgynnade studenter mot smalare vägar. På policynivå skulle aggregerade transparenspoäng kunna lyfta fram skolor eller program där AI-beslut upplevs som ogenomskinliga, och därmed styra riktade reformer utan att exponera individer.

Huvudbudskap för icke-experter

Den centrala slutsatsen är att vi inte behöver välja mellan kraftfull AI och ansvarsfull AI i utbildning. Genom att utforma modeller som EduTransNet som betraktar transparens och rättvisa som kärnmål—i stället för eftertankar—kan utvecklare skapa system som både är mycket noggranna och lättare att ifrågasätta, övervaka och förbättra. Medan resultaten hittills kommer från tre universitet och behöver testas på andra platser, erbjuder ramverket en konkret väg för skolor, beslutsfattare och AI-utvecklare som vill ta tillvara smarta verktyg utan att ge upp studenters rättigheter, integritet eller lika möjligheter.

Citering: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Nyckelord: AI i utbildning, algoritmisk transparens, etisk AI, studenters integritet, rättvisa i maskininlärning