Clear Sky Science · fr

Considérations éthiques dans l’intégration de l’intelligence artificielle dans l’éducation : un nouveau cadre de réseau neuronal profond pour prédire des scores de transparence

Pourquoi cela compte pour les étudiants et les enseignants

Les salles de classe du monde entier adoptent rapidement des outils d’intelligence artificielle pour noter les travaux, recommander des cours et signaler les étudiants qui pourraient avoir besoin d’aide. Pourtant, la plupart des gens ignorent comment ces systèmes prennent leurs décisions, ou s’ils traitent tout le monde de manière équitable. Cette étude propose une méthode pour mesurer à quel point ces systèmes d’IA éducative sont « transparents », et présente un nouveau modèle, EduTransNet, qui vise à produire des prédictions puissantes tout en plaçant l’équité, la confidentialité et la responsabilité au cœur du dispositif.

Voir à l’intérieur des décisions d’IA

Au centre de l’article se trouve une nouvelle mesure appelée score de transparence. Plutôt que de juger l’IA en éducation uniquement sur la précision de ses prédictions, les auteurs demandent : peut‑on expliquer son raisonnement, retracer comment les entrées conduisent aux sorties, communiquer clairement ses décisions à des non‑experts et montrer qu’elle respecte des règles éthiques ? Ils regroupent ces quatre éléments — explicabilité, traçabilité, clarté de communication et conformité éthique — en un seul score de 0 à 100. Des scores élevés signalent des systèmes d’IA dont le comportement peut être inspecté et remis en question par les étudiants, les enseignants et les administrateurs, plutôt que caché dans une boîte noire.

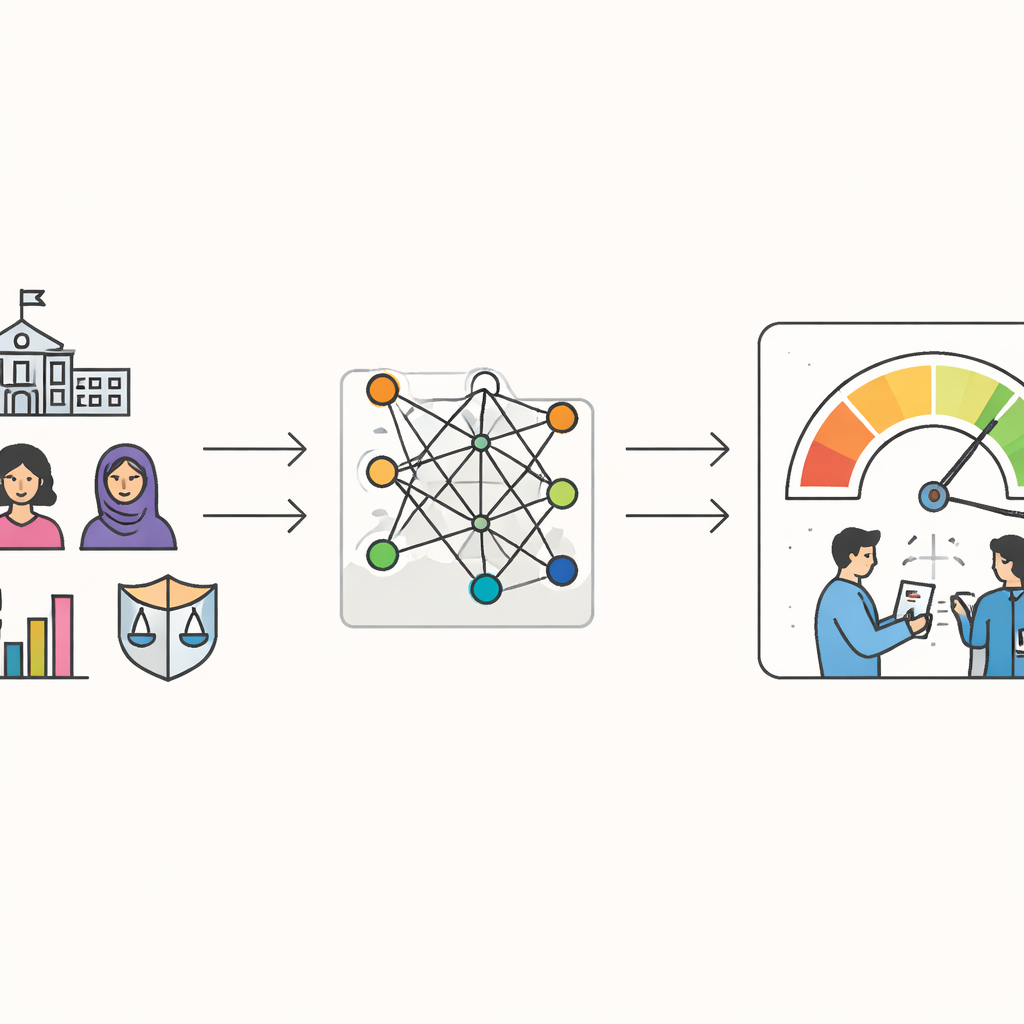

Comment le nouveau modèle apprend des étudiants

Pour tester cette idée, les chercheurs ont collecté des données auprès de 2 847 étudiants de trois universités au Pakistan. Les informations comprenaient des données démographiques de base comme l’âge et le sexe, des comportements d’étude tels que l’assiduité et les heures d’étude hebdomadaires, les notes, ainsi que des réponses à des enquêtes sur les préoccupations en matière de confidentialité, la conscience des biais algorithmiques, le sentiment d’équité et les attentes en matière d’ouverture. À partir de ces éléments, EduTransNet apprend à prédire le score de transparence de chaque étudiant — estimant essentiellement à quel point une décision pilotée par l’IA paraîtrait transparente pour cet étudiant et des pairs similaires. Fait important, le modèle s’appuie principalement sur des caractéristiques d’engagement et de perception éthique, et beaucoup moins sur les données démographiques, ce qui suggère qu’il est davantage guidé par les actions et les ressentis des étudiants que par leur identité.

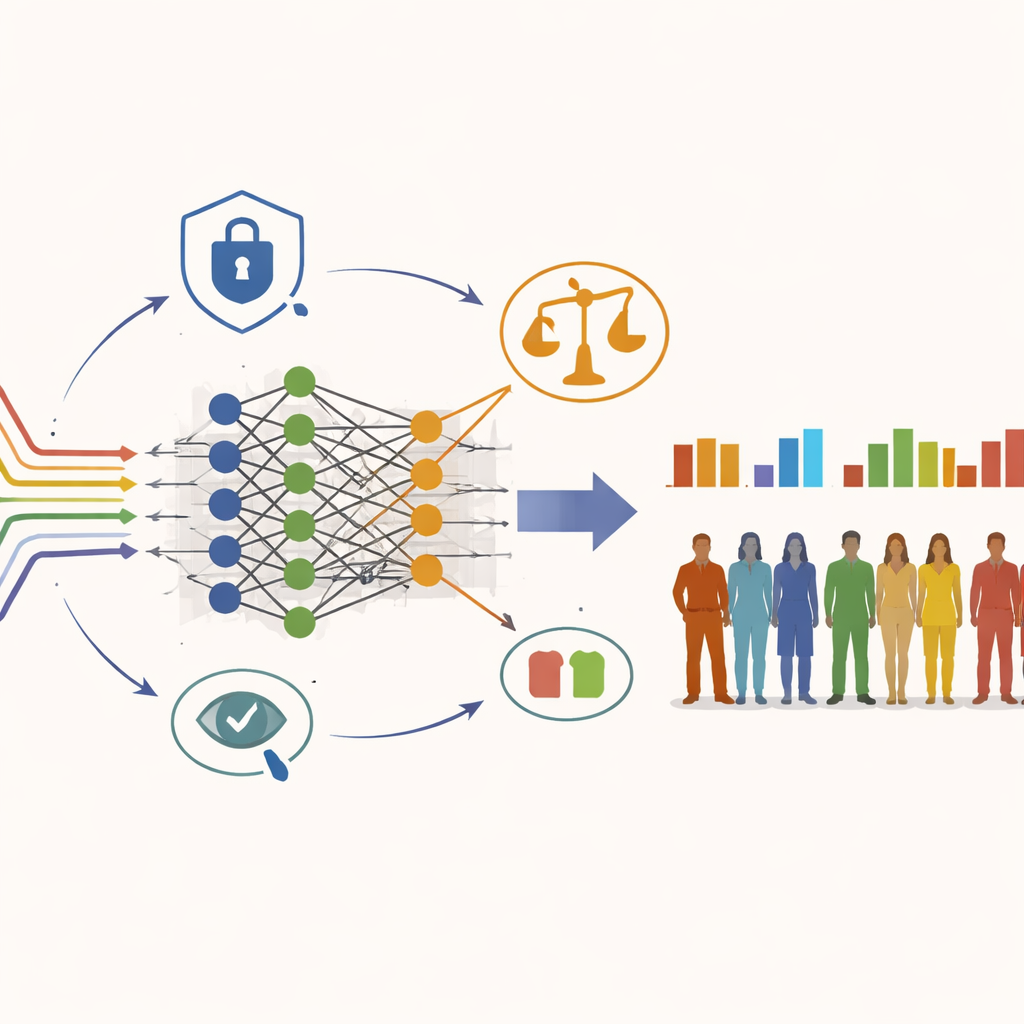

Construire un modèle d’IA avec des garde‑fous

EduTransNet est un réseau neuronal profond ajusté spécifiquement pour cette tâche. Il empile plusieurs couches qui compressent et raffinent progressivement les données d’entrée pour aboutir à une prédiction unique de transparence. Mais, à la différence de nombreux modèles puissants qui ne recherchent que la précision, celui‑ci est conçu avec des garde‑fous. Le processus d’entraînement pénalise explicitement les schémas où un genre ou un groupe ethnique reçoit systématiquement des scores prédits plus élevés ou plus bas que d’autres. Les auteurs intègrent également un compromis formel entre confidentialité et utilité, en utilisant des techniques d’anonymisation et d’ajout de bruit afin que les étudiants individuels ne puissent pas être facilement réidentifiés tout en permettant au système d’apprendre des motifs significatifs.

Vérifier précision, équité et confidentialité

L’équipe a comparé EduTransNet avec trois outils prédictifs courants : régression linéaire, régression à vecteur de support et forêts aléatoires. Lors de tests répétés et sur un ensemble tenu à l’écart d’étudiants jamais vus auparavant, EduTransNet expliquait environ 99–100 % de la variation des scores de transparence, tout en commettant des erreurs nettement plus faibles que les autres modèles. Des vérifications statistiques ont suggéré que cette forte performance n’était pas simplement due à un surapprentissage des singularités des données. Parallèlement, des audits d’équité utilisant des boîtes à outils établies ont montré que les scores prédits étaient étroitement équilibrés entre les groupes de genre et ethniques, et que les taux d’erreur ne favorisaient systématiquement aucun groupe. Des analyses séparées ont confirmé que les protections de confidentialité étaient suffisamment robustes pour limiter le risque de réidentification tout en soutenant un apprentissage précis.

Ce que cela signifie pour les classes réelles

Au‑delà des aspects mathématiques, l’étude examine comment un tel système pourrait être utilisé en pratique. Dans un scénario, EduTransNet aide à identifier les étudiants qui pourraient être en risque académique, mais associe chaque signal d’alerte à un score de transparence élevé ou faible afin que les enseignants sachent dans quelle mesure faire confiance à l’alerte et comment l’expliquer. Dans un autre, il soutient les recommandations de cours et d’orientation professionnelle tout en vérifiant que les suggestions ne poussent pas discrètement les étudiants défavorisés vers des trajectoires plus étroites. Au niveau politique, des scores de transparence agrégés pourraient mettre en évidence des écoles ou des programmes où les décisions d’IA paraissent opaques, orientant des réformes ciblées sans exposer les individus.

Message clé pour les non‑experts

La conclusion centrale est que nous n’avons pas à choisir entre une IA puissante et une IA responsable dans l’éducation. En concevant des modèles comme EduTransNet qui placent la transparence et l’équité au cœur des objectifs de conception — plutôt que comme des considérations secondaires — les développeurs peuvent produire des systèmes à la fois très précis et plus faciles à interroger, surveiller et améliorer. Si les résultats présentés proviennent pour l’instant de trois universités et doivent être testés ailleurs, le cadre offre une voie concrète pour les écoles, les décideurs et les concepteurs d’IA qui souhaitent exploiter des outils intelligents sans renoncer aux droits des étudiants, à la confidentialité ou à l’égalité des chances.

Citation: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Mots-clés: L’IA dans l’éducation, transparence algorithmique, IA éthique, confidentialité des étudiants, équité en apprentissage automatique