Clear Sky Science · de

Ethische Erwägungen bei der Integration künstlicher Intelligenz in die Bildung: ein neuartiges tiefes neuronales Netzwerk‑Framework zur Vorhersage von Transparenzpunkten

Warum das für Studierende und Lehrende wichtig ist

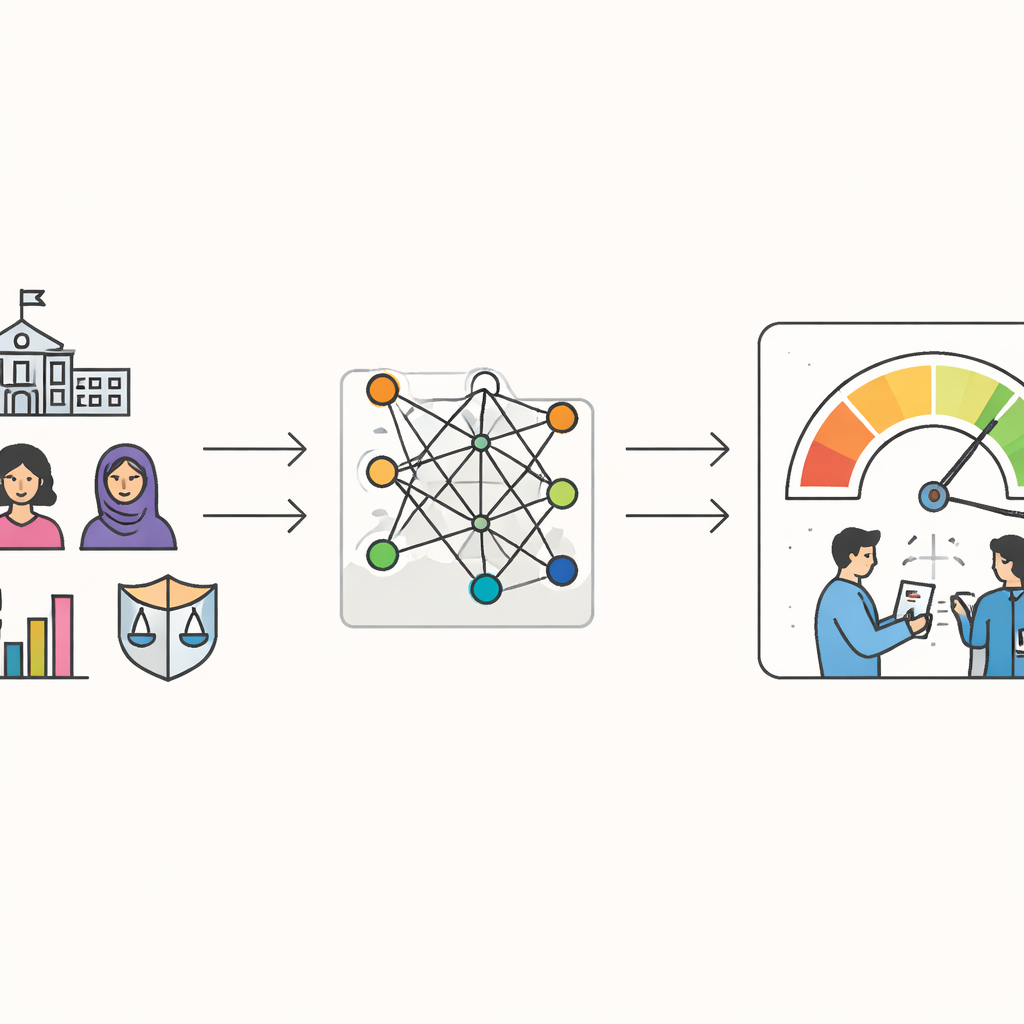

Klassenzimmer weltweit führen schnell KI‑Werkzeuge ein, um Arbeiten zu bewerten, Kurse zu empfehlen und Studierende zu markieren, die Unterstützung brauchen könnten. Doch die meisten Menschen haben wenig Ahnung, wie diese Systeme tatsächlich Entscheidungen treffen oder ob sie alle fair behandeln. Diese Studie führt eine Methode ein, um zu messen, wie „durchsichtig“ solche Bildungs‑KI‑Systeme sind, und stellt ein neues Modell, EduTransNet, vor, das starke Vorhersagen treffen will, dabei aber Fairness, Datenschutz und Rechenschaftspflicht in den Mittelpunkt stellt.

Ein Blick in KI‑Entscheidungen

Kern der Arbeit ist ein neuer Messwert, der Transparenzscore. Statt KI in der Bildung nur nach der Genauigkeit ihrer Vorhersagen zu beurteilen, fragen die Autoren: Lässt sich ihr Denken erklären, kann man nachvollziehen, wie Eingaben zu Ausgaben führen, lassen sich Entscheidungen klar mit Nicht‑Expertinnen und Nicht‑Experten kommunizieren, und folgt das System ethischen Regeln? Sie bündeln diese vier Komponenten – Erklärbarkeit, Nachvollziehbarkeit, Verständlichkeit der Kommunikation und ethische Konformität – zu einem einzigen Score von 0 bis 100. Hohe Werte signalisieren KI‑Systeme, deren Verhalten von Studierenden, Lehrenden und Verwaltung eingesehen und hinterfragt werden kann, statt in einer Blackbox verborgen zu bleiben.

Wie das neue Modell von Studierenden lernt

Um diese Idee zu prüfen, sammelten die Forschenden Daten von 2.847 Studierenden an drei Universitäten in Pakistan. Die Informationen umfassten grundlegende demografische Angaben wie Alter und Geschlecht, Studienverhalten wie Anwesenheit und wöchentliche Studienstunden, Noten sowie Umfrageantworten zu Datenschutzbedenken, Bewusstsein für algorithmische Verzerrungen, Gerechtigkeitsempfinden und Erwartungen an Offenheit. Aus diesen Merkmalen lernt EduTransNet, den Transparenzscore jeder‑/jedes Einzelnen vorherzusagen – im Wesentlichen eine Schätzung, wie transparent sich eine KI‑getriebene Entscheidung für diese Person und ähnliche Peers anfühlen würde. Wichtig ist, dass das Modell vor allem auf Engagement‑ und ethischer Wahrnehmungsmerkmale beruht und deutlich weniger auf Demografie, was darauf hindeutet, dass es eher von Verhalten und Wahrnehmung als von der Identität der Personen gesteuert wird.

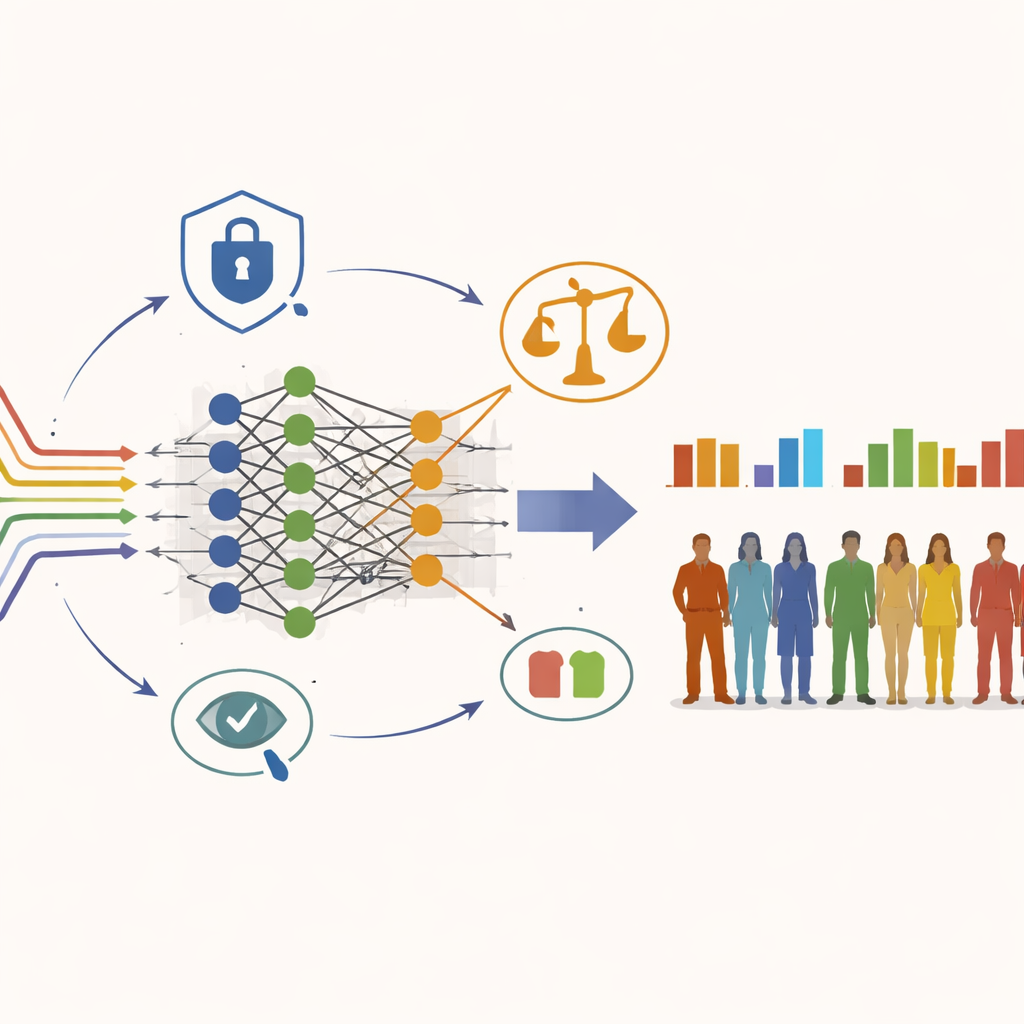

Ein KI‑Modell mit Schutzmechanismen

EduTransNet ist ein tiefes neuronales Netzwerk, das speziell für diese Aufgabe abgestimmt wurde. Es stapelt mehrere Schichten, die Eingabedaten schrittweise komprimieren und verfeinern, bis eine einzelne Transparenzvorhersage entsteht. Im Gegensatz zu vielen leistungsfähigen Modellen, die nur auf Genauigkeit ausgelegt sind, wurde dieses jedoch mit Schutzmechanismen konstruiert. Der Trainingsprozess bestraft explizit Muster, bei denen ein Geschlecht oder eine ethnische Gruppe systematisch höhere oder niedrigere vorhergesagte Werte erhält als andere. Außerdem integrieren die Autoren eine formale Abwägung zwischen Datenschutz und Nützlichkeit, etwa durch Anonymisierung und das Hinzufügen von Rauschen, sodass einzelne Studierende nicht leicht reidentifiziert werden können, während das System dennoch sinnvolle Muster lernt.

Überprüfung von Genauigkeit, Fairness und Datenschutz

Das Team verglich EduTransNet mit drei gängigen Vorhersagewerkzeugen: linearer Regression, Support‑Vector‑Regression und Random Forests. Über wiederholte Tests und auf einem zurückgehaltenen Datensatz, den das Modell nie gesehen hatte, erklärte EduTransNet etwa 99–100 Prozent der Variation der Transparenzscores und erzielte dabei deutlich kleinere Fehler als die anderen Modelle. Statistische Prüfungen legen nahe, dass diese starke Leistung nicht nur Overfitting an Datenbesonderheiten ist. Gleichzeitig zeigten Fairness‑Audits mit etablierten Toolkits, dass die vorhergesagten Scores über Geschlechter- und ethnische Gruppen hinweg eng ausbalanciert waren und die Fehlerquoten keine Gruppe systematisch bevorzugten. Separate Analysen bestätigten, dass die Datenschutzmaßnahmen stark genug waren, um das Reidentifikationsrisiko zu begrenzen und gleichzeitig genaues Lernen zu ermöglichen.

Was das für reale Klassenzimmer bedeutet

Über die Mathematik hinaus untersucht die Studie, wie ein solches System in der Praxis verwendet werden könnte. In einem Szenario hilft EduTransNet dabei, Studierende mit akutem akademischem Risiko zu identifizieren, koppelt aber jede Risiko‑Markierung mit einem hohen oder niedrigen Transparenzscore, damit Lehrende wissen, wie sehr sie dem Hinweis vertrauen und wie sie ihn erklären sollten. In einem anderen unterstützt es Kurs‑ und Berufsempfehlungen und prüft gleichzeitig, dass Vorschläge nicht stillschweigend benachteiligte Studierende in engere Bahnen lenken. Auf der politischen Ebene könnten aggregierte Transparenzscores Schulen oder Programme hervorheben, in denen KI‑Entscheidungen als undurchsichtig empfunden werden, und so gezielte Reformen lenken, ohne Einzelpersonen preiszugeben.

Die Kernaussage für Nicht‑Expertinnen und Nicht‑Experten

Die zentrale Schlussfolgerung ist, dass wir nicht zwischen leistungsfähiger KI und verantwortlicher KI in der Bildung wählen müssen. Durch die Gestaltung von Modellen wie EduTransNet, die Transparenz und Fairness als zentrale Gestaltungsziele – statt als Nachgedanken – behandeln, können Entwickler Systeme schaffen, die sowohl sehr genau als auch leichter hinterfragbar, überwachbar und verbesserbar sind. Obwohl die bisherigen Ergebnisse von drei Universitäten stammen und anderswo getestet werden müssen, bietet das Framework einen konkreten Weg für Schulen, politische Entscheidungsträger und KI‑Entwickler, die intelligente Werkzeuge nutzen wollen, ohne auf Rechte von Studierenden, Datenschutz oder Chancengleichheit zu verzichten.

Zitation: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Schlüsselwörter: KI in der Bildung, algorithmische Transparenz, ethische KI, Datenschutz von Studierenden, Gerechtigkeit im maschinellen Lernen