Clear Sky Science · ja

教育への人工知能統合における倫理的配慮:透明性スコアを予測する新しい深層ニューラルネットワークの枠組み

学生と教師にとってなぜ重要か

世界中の教室では、課題の採点、履修推薦、支援が必要な学生の検知などに人工知能ツールが急速に導入されています。しかし、こうしたシステムが実際にどのように意思決定を行っているのか、すべての人に対して公正に扱っているのかを理解している人はほとんどいません。本研究は、教育用AIシステムの「どれだけ透けて見えるか」を測る手法を提示し、強力な予測を行いながら公平性、プライバシー、説明責任を中核に据える新しいモデル、EduTransNetを紹介します。

AIの判断の中身を覗く

論文の中心には「透明性スコア」と呼ぶ新たな尺度があります。教育におけるAIを予測精度だけで評価するのではなく、著者らは問いかけます:その推論を説明できるか、入力がどのように出力につながるかを追跡できるか、非専門家にも分かりやすく決定を伝えられるか、倫理規範に従っていることを示せるか。説明可能性、追跡可能性、伝達の明確さ、倫理遵守という四つの要素をまとめて0から100の単一のスコアにしています。高いスコアは、学生や教師、管理者がその挙動を検査し問いただすことができるAIシステムを示し、ブラックボックスに隠れた状態ではないことを意味します。

モデルが学生から学ぶ仕組み

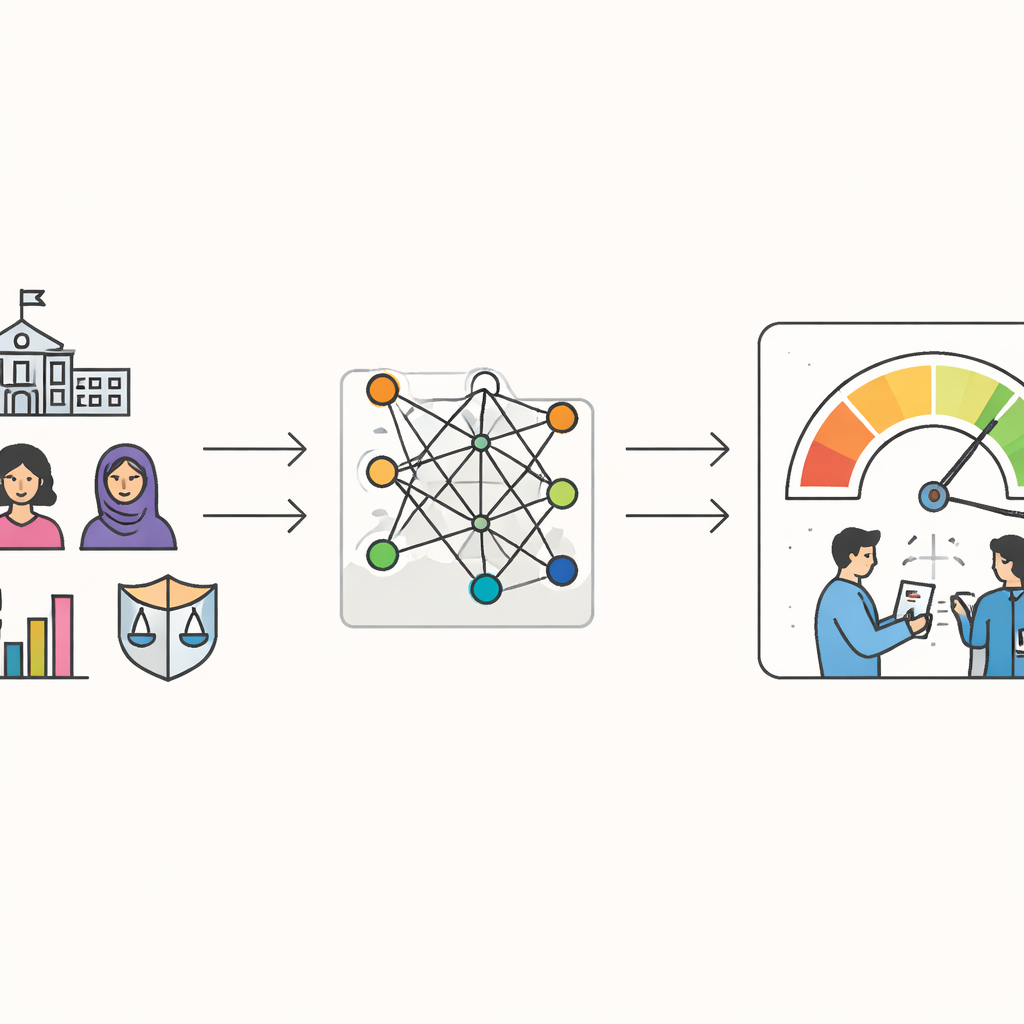

この考えを検証するために、研究者らはパキスタンの3大学から2,847人の学生データを収集しました。収集された情報には年齢や性別といった基本的な属性、出席や週あたりの学習時間のような学習行動、成績、そしてプライバシーへの懸念、アルゴリズムバイアスの認識、公平感、開示に対する期待に関する調査回答が含まれていました。これらの要素を使って、EduTransNetは各学生の透明性スコアを予測します。これは本質的に、その学生や類似の仲間にとってAI駆動の決定がどれだけ透明に感じられるかを推定するものです。重要なのは、モデルは人口統計よりもエンゲージメントや倫理的認識の特徴に最も依存しており、誰であるかよりも行動や感じ方に基づいていることを示唆している点です。

ガードレールを備えたAIモデルの構築

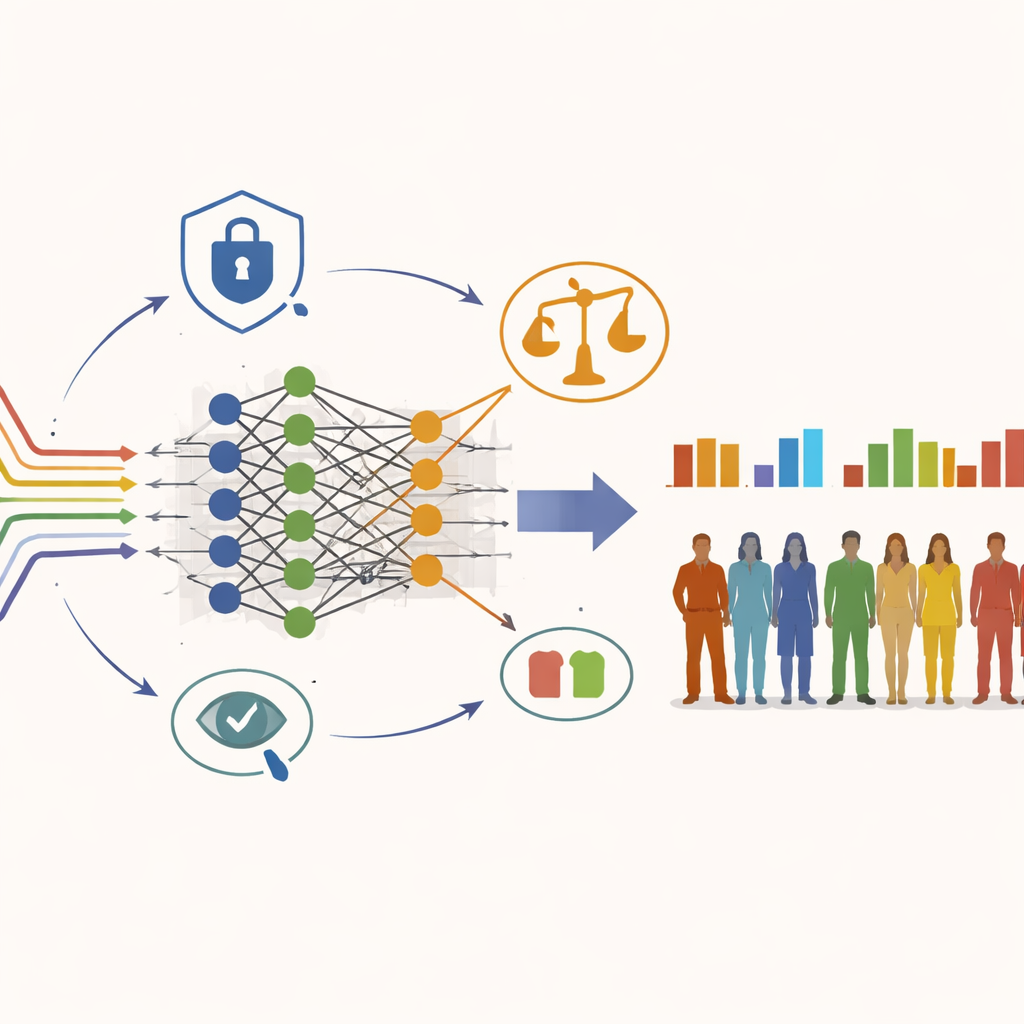

EduTransNetはこのタスク専用に調整された深層ニューラルネットワークです。複数の層を積み重ね、入力データを徐々に圧縮・洗練して単一の透明性予測にまとめます。しかし、精度だけに注力する多くの強力なモデルとは異なり、本モデルはガードレールを組み込んで設計されています。訓練過程では、特定の性別や民族集団が継続して高いまたは低い予測スコアを受け取るようなパターンを明示的に抑制するペナルティを導入しています。さらに、個々の学生が容易に再識別されないように匿名化とノイズ付加技術を用いるなど、プライバシーと有用性のトレードオフを形式的に織り込んでいます。

精度、公平性、プライバシーの検証

研究チームはEduTransNetを線形回帰、サポートベクター回帰、ランダムフォレストという3つの一般的な予測手法と比較しました。繰り返しのテストと未使用の保留データセットに対して、EduTransNetは透明性スコアの変動の約99–100パーセントを説明し、他のモデルよりも誤差がずっと小さい結果を出しました。統計的検査は、この高い性能が単にデータの特異性に過剰適合しているだけではないことを示唆しました。同時に、既存のツールキットを用いた公平性監査では、予測スコアが性別や民族集団にわたってほぼ均衡しており、誤差率が特定の集団を体系的に優遇していないことが示されました。別の分析では、プライバシー保護は再識別リスクを制限するのに十分でありながら、依然として有意義な学習を可能にすることが確認されました。

実際の教室にとっての意味

数式を離れて、研究はこうしたシステムが実務でどのように使われうるかを検討しています。一つのシナリオでは、EduTransNetは学業リスクのある学生を特定するのに役立ちますが、各リスク警告に対して高いか低いかの透明性スコアを付けることで教師が警告をどれだけ信用し、どのように説明すべきかを判断できるようにします。別のケースでは、コースやキャリア推薦を支援しつつ、不利な立場にある学生を密かに狭い進路に誘導していないかをチェックします。政策レベルでは、集計された透明性スコアがAI判断が不透明に感じられる学校やプログラムを浮き彫りにし、個人を晒すことなく対象を絞った改革を導くことができます。

専門外の人への要点

中心的な結論は、教育において強力なAIと責任あるAIのどちらかを選ぶ必要はないということです。透明性や公平性を後付けではなく設計の核心目標として扱うEduTransNetのようなモデルを設計することで、開発者は高精度でありながら問いただし、監視し、改善しやすいシステムを作ることができます。現時点の結果は3大学からのデータに基づくため他地域での検証が必要ですが、この枠組みは、学生の権利、プライバシー、機会均等を犠牲にせずに賢いツールを活用したい学校、政策立案者、AI開発者にとって具体的な道筋を提供します。

引用: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

キーワード: 教育におけるAI, アルゴリズムの透明性, 倫理的なAI, 学生のプライバシー, 機械学習における公平性