Clear Sky Science · ru

Этические аспекты интеграции искусственного интеллекта в образование: новая архитектура глубокой нейронной сети для прогнозирования показателей прозрачности

Почему это важно для студентов и преподавателей

Классы по всему миру быстро внедряют инструменты искусственного интеллекта для оценивания работ, рекомендаций по курсам и выявления студентов, которым может потребоваться помощь. При этом большинство людей мало представляет, как эти системы принимают решения и относятся ли они ко всем справедливо. В этом исследовании предложен способ измерения того, насколько «прозрачны» такие образовательные ИИ‑системы, а также представлена новая модель EduTransNet, которая стремится давать мощные прогнозы, сохраняя в центре внимание принципы справедливости, конфиденциальности и подотчетности.

Заглянуть внутрь решений ИИ

В основе статьи — новая метрика, называемая показателем прозрачности. Вместо того чтобы оценивать ИИ в образовании только по точности прогнозов, авторы задают вопросы: можно ли объяснить его рассуждения, проследить, как входные данные приводят к выходам, ясно обсудить решения с неспециалистами и показать соблюдение этических правил? Эти четыре компонента — объяснимость, прослеживаемость, понятность коммуникации и соблюдение этики — объединены в единый шкальный балл от 0 до 100. Высокие баллы сигнализируют о системах ИИ, поведение которых можно проверить и оспорить студентам, преподавателям и администраторам, а не спрятать в «чёрном ящике».

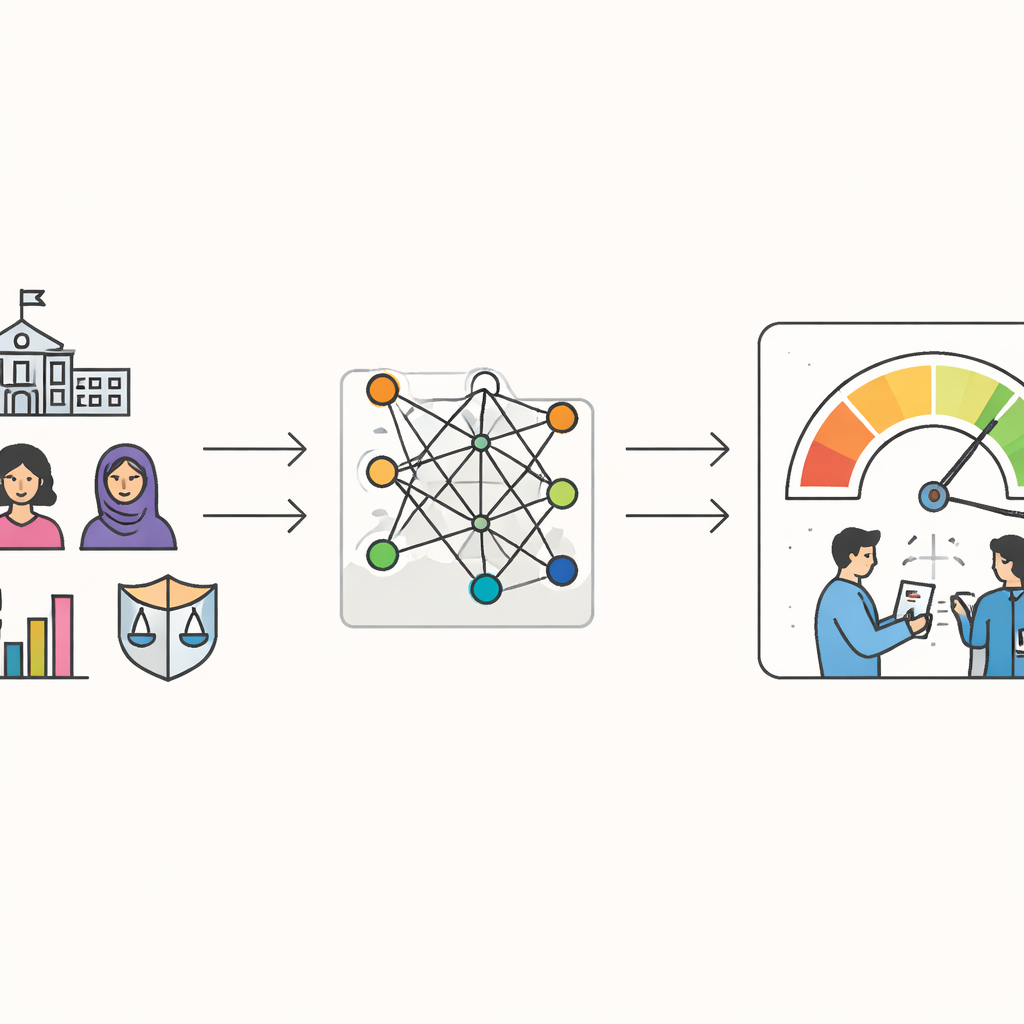

Как новая модель обучается на данных студентов

Чтобы проверить идею, исследователи собрали данные от 2 847 студентов трёх университетов Пакистана. Информация включала базовые демографические сведения, такие как возраст и пол, учебные поведенческие показатели — посещаемость и недельные часы занятий, оценки, а также ответы в опросах о беспокойствах по поводу конфиденциальности, осведомлённости об алгоритмическом смещении, ощущении справедливости и ожиданиях прозрачности. На основе этих компонентов EduTransNet учится предсказывать показатель прозрачности для каждого студента — по сути оценивая, насколько прозрачным будет казаться ИИ‑решение для этого студента и аналогичных сверстников. Важно, что модель опирается прежде всего на признаки вовлечённости и этического восприятия и гораздо меньше — на демографию, что указывает на то, что её решения больше зависят от поведения и ощущений студентов, чем от их принадлежности.

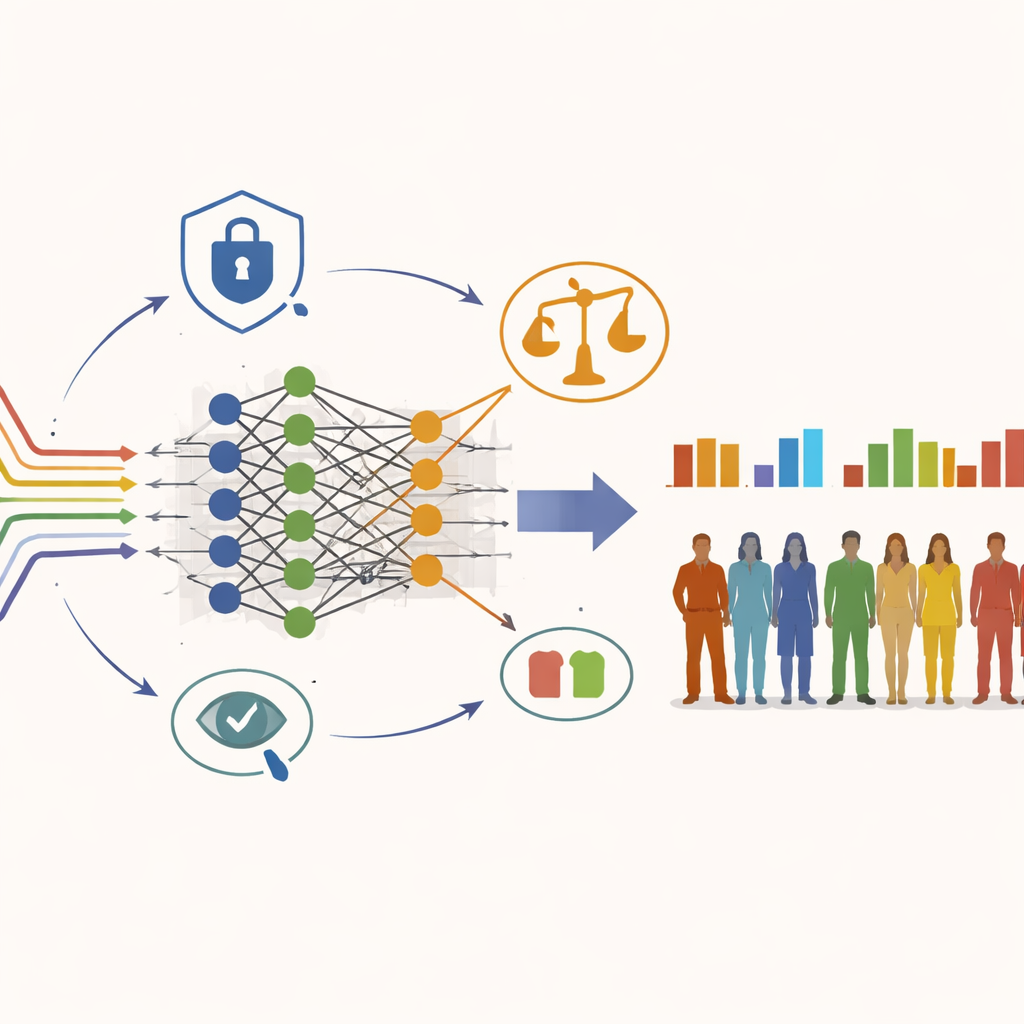

Построение модели ИИ с ограничениями‑защитниками

EduTransNet — это глубокая нейронная сеть, специально настроенная для этой задачи. Она комбинирует несколько слоёв, которые постепенно сжимают и уточняют входные данные до единого предсказания прозрачности. Но в отличие от многих мощных моделей, ориентированных только на точность, эта модель спроектирована с «ограничениями‑защитниками». В процессе обучения явно штрафуются паттерны, при которых одна гендерная или этническая группа систематически получает более высокие или более низкие предсказанные баллы по сравнению с другими. Авторы также внедряют формализованный компромисс между конфиденциальностью и полезностью, используя методы анонимизации и добавления шума, чтобы затруднить реконструкцию личности отдельных студентов при сохранении способности системы учиться значимым закономерностям.

Проверка точности, справедливости и конфиденциальности

Команда сравнила EduTransNet с тремя распространёнными предиктивными инструментами: линейной регрессией, регрессией опорных векторов и случайными лесами. В повторных тестах и на отложенной выборке студентов, которых модель ранее не видела, EduTransNet объясняла около 99–100 процентов вариации показателей прозрачности и допускала значительно меньшие ошибки по сравнению с другими моделями. Статистические проверки указывали на то, что такое сильное качество не является лишь подгонкой под особенности выборки. Одновременно аудиты справедливости с использованием признанных инструментов показали, что предсказанные баллы оказались сбалансированы по гендерным и этническим группам, и скорости ошибок не систематически благоприятствовали какой‑то одной группе. Отдельные анализы подтвердили, что меры защиты конфиденциальности достаточно сильны, чтобы ограничить риск повторной идентификации, при этом не мешая точному обучению.

Что это значит для реальных классов

Помимо математических результатов, исследование рассматривает, как такую систему можно применять на практике. В одном сценарии EduTransNet помогает выявлять студентов с академическими рисками, одновременно сопоставляя каждому сигналу риска высокий или низкий балл прозрачности, чтобы преподаватели знали, насколько следует доверять предупреждению и как его объяснить. В другом сценарии модель поддерживает рекомендации по курсам и карьере, следя за тем, чтобы предложения не направляли незаметно обделённых студентов на более узкие пути. На уровне политики агрегированные показатели прозрачности могут выявлять школы или программы, где решения ИИ кажутся непрозрачными, направляя целевые реформы без раскрытия данных об отдельных лицах.

Главный вывод для неспециалистов

Ключевой вывод заключается в том, что не нужно выбирать между мощным ИИ и ответственный ИИ в образовании. Проектируя модели вроде EduTransNet, которые ставят прозрачность и справедливость в разряд основных проектных целей, а не дополняют их затем, разработчики могут создавать системы, одновременно высокоточные и более доступные для вопросов, контроля и улучшений. Хотя результаты пока получены на данных трёх университетов и требуют проверки в других местах, предложенная структура даёт практический путь для школ, политиков и разработчиков ИИ, которые хотят воспользоваться интеллектуальными инструментами, не отказываясь от прав студентов, конфиденциальности и равных возможностей.

Цитирование: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Ключевые слова: ИИ в образовании, алгоритмическая прозрачность, этичный ИИ, конфиденциальность студентов, справедливость в машинном обучении