Clear Sky Science · nl

Ethische overwegingen bij de integratie van kunstmatige intelligentie in het onderwijs: een nieuw diep neuraal netwerkraamwerk voor het voorspellen van transparantiescores

Waarom dit belangrijk is voor studenten en docenten

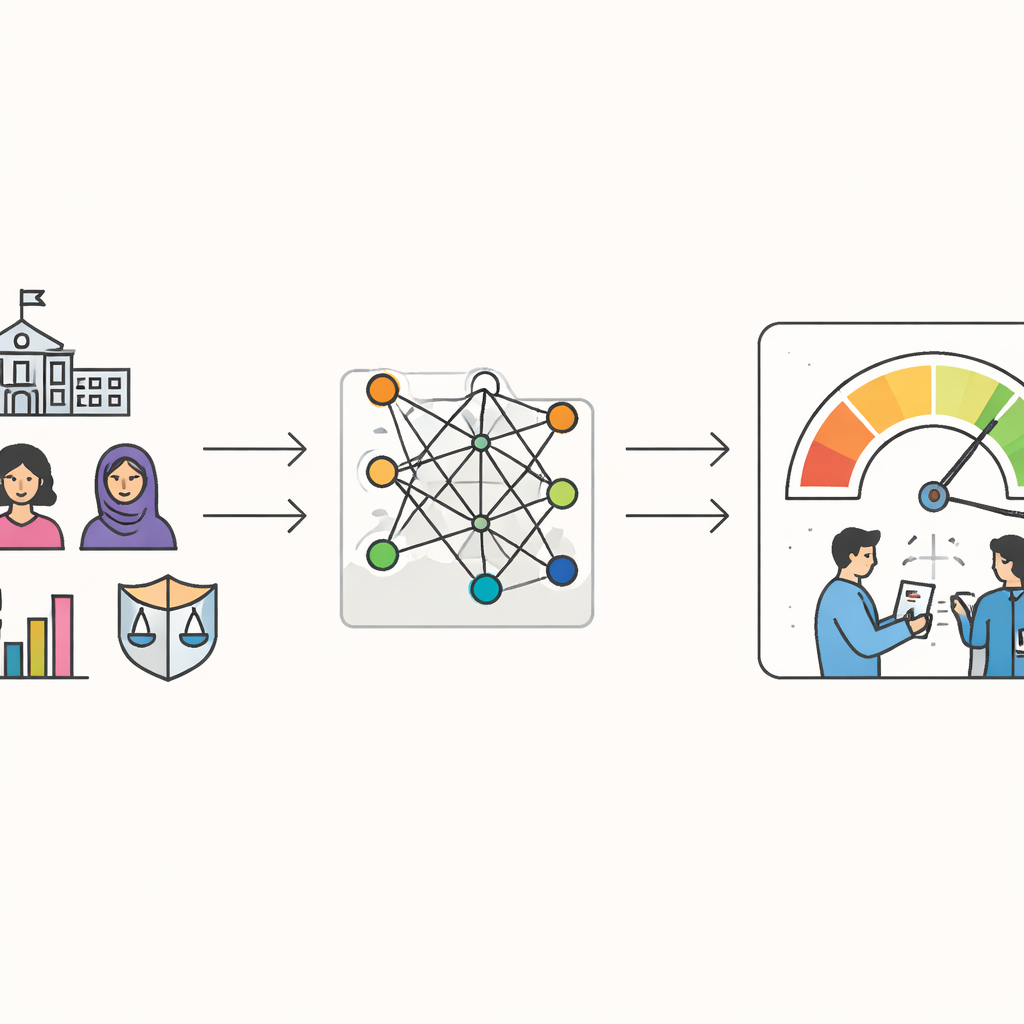

Klaslokalen over de hele wereld nemen snel AI‑hulpmiddelen in gebruik om werk te beoordelen, cursussen aan te bevelen en studenten te signaleren die mogelijk hulp nodig hebben. Toch heeft het merendeel van de mensen weinig idee hoe deze systemen daadwerkelijk beslissingen nemen of of ze iedereen eerlijk behandelen. Deze studie introduceert een manier om te meten hoe "doorzichtig" zulke educatieve AI‑systemen zijn en presenteert een nieuw model, EduTransNet, dat krachtige voorspellingen wil doen terwijl het eerlijkheid, privacy en verantwoording centraal stelt.

Inzicht in AI‑beslissingen

Het hart van het artikel is een nieuwe maatstaf genaamd de transparantiescore. In plaats van AI in het onderwijs alleen te beoordelen op hoe nauwkeurig de voorspellingen zijn, vragen de auteurs: kunnen we de redenering uitleggen, nagaan hoe invoer tot uitvoer leidt, beslissingen helder bespreken met niet‑experts en aantonen dat het ethische regels volgt? Ze bundelen deze vier ingrediënten — uitlegbaarheid, traceerbaarheid, helderheid van communicatie en ethische naleving — in één score van 0 tot 100. Hoge scores duiden op AI‑systemen waarvan het gedrag kan worden geïnspecteerd en bevraagd door studenten, docenten en bestuurders, in plaats van verborgen te blijven in een zwarte doos.

Hoe het nieuwe model van studenten leert

Om dit idee te testen verzamelden de onderzoekers gegevens van 2.847 studenten aan drie universiteiten in Pakistan. De informatie omvatte basisdemografie zoals leeftijd en geslacht, studiegedrag zoals aanwezigheid en wekelijkse studeertijd, cijfers en enquêteantwoorden over privacyzorgen, bewustzijn van algorithmische vooringenomenheid, gevoel van rechtvaardigheid en verwachtingen ten aanzien van openheid. Met deze gegevens leert EduTransNet de transparantiescore van elke student te voorspellen — in wezen schat het in hoe transparant een AI‑gestuurde beslissing voor die student en vergelijkbare peers zou aanvoelen. Belangrijk is dat het model vooral leunt op betrokkenheid en ethische perceptie en veel minder op demografische kenmerken, wat suggereert dat het meer gestuurd wordt door hoe studenten handelen en voelen dan door wie ze zijn.

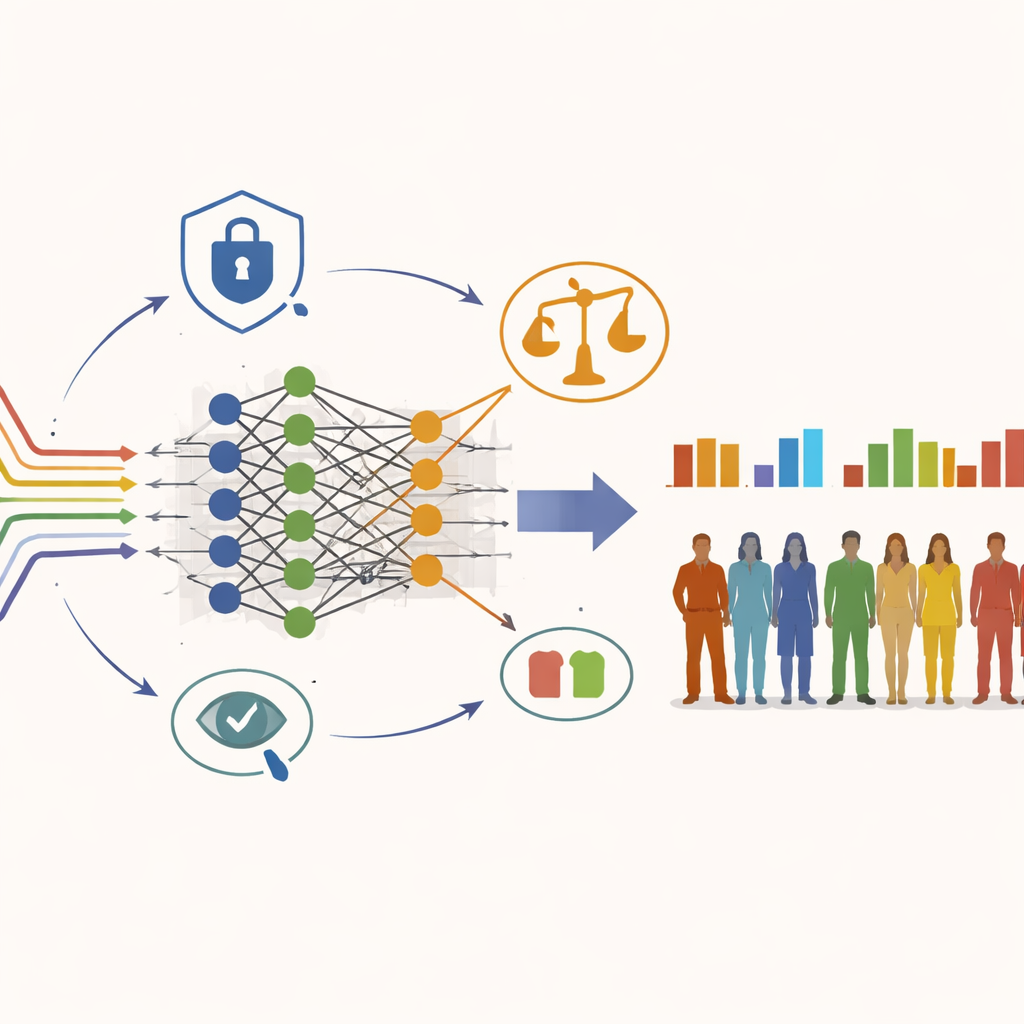

Een AI‑model bouwen met vangrails

EduTransNet is een diep neuraal netwerk dat specifiek voor deze taak is afgestemd. Het stapelt meerdere lagen die de inputgegevens geleidelijk comprimeren en verfijnen tot één transparantievoorspelling. Maar anders dan veel krachtige modellen die alleen op nauwkeurigheid focussen, is dit model met vangrails ontworpen. Het trainingsproces bestraft expliciet patronen waarbij één geslacht of etnische groep consequent hogere of lagere voorspelde scores krijgt dan andere groepen. De auteurs verwerken ook een formele privacy‑tegen‑bruikbaarheid afweging, met behulp van anonimisering en technieken om ruis toe te voegen zodat individuele studenten niet gemakkelijk kunnen worden gereïdentificeerd terwijl het systeem nog steeds betekenisvolle patronen leert.

Controleren van nauwkeurigheid, rechtvaardigheid en privacy

Het team vergeleek EduTransNet met drie gebruikelijke voorspellende hulpmiddelen: lineaire regressie, support vector regression en random forests. Over herhaalde tests en op een apart gehouden dataset van studenten die het model nooit eerder had gezien, verklaarde EduTransNet ongeveer 99–100 procent van de variantie in transparantiescores en maakte het veel kleinere fouten dan de andere modellen. Statistische toetsen suggereren dat deze sterke prestatie niet alleen het gevolg is van overfitting aan eigenaardigheden van de data. Tegelijkertijd toonden fairness‑audits met gevestigde toolkits aan dat de voorspelde scores goed in balans waren over geslachts‑ en etnische groepen, en dat foutpercentages niet systematisch een groep bevoordeelden. Afzonderlijke analyses bevestigden dat de privacybescherming sterk genoeg was om het risico op heridentificatie te beperken terwijl accurate leerprocessen werden ondersteund.

Wat dit betekent voor echte klaslokalen

Buiten de wiskunde onderzoekt de studie hoe zo’n systeem in de praktijk gebruikt zou kunnen worden. In één scenario helpt EduTransNet bij het identificeren van studenten die academisch risico lopen, maar koppelt elk risicosignaal aan een hoge of lage transparantiescore zodat docenten weten hoeveel ze het signaal mogen vertrouwen en hoe ze de waarschuwing moeten uitleggen. In een ander scenario ondersteunt het aanbevelingen voor cursussen en loopbanen terwijl het controleert of suggesties studenten uit achtergestelde groepen niet stelselmatig naar smallere paden duwen. Op beleidsniveau zouden geaggregeerde transparantiescores scholen of programma’s kunnen aanwijzen waar AI‑beslissingen als ondoorzichtig worden ervaren, en zo gerichte hervormingen sturen zonder individuen bloot te stellen.

Belangrijkste boodschap voor niet‑experts

De centrale conclusie is dat we niet hoeven te kiezen tussen krachtige AI en verantwoordelijke AI in het onderwijs. Door modellen als EduTransNet te ontwerpen die transparantie en rechtvaardigheid als kernontwerpeisen behandelen — in plaats van als bijzaak — kunnen ontwikkelaars systemen produceren die zowel zeer nauwkeurig zijn als gemakkelijker te bevragen, te monitoren en te verbeteren. Hoewel de resultaten tot nu toe van drie universiteiten komen en elders getest moeten worden, biedt het raamwerk een concreet pad voor scholen, beleidsmakers en AI‑bouwers die slimme hulpmiddelen willen benutten zonder afstand te doen van studentenrechten, privacy of gelijke kansen.

Bronvermelding: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Trefwoorden: AI in het onderwijs, algorithmische transparantie, ethische AI, studentenprivacy, rechtvaardigheid in machine learning