Clear Sky Science · pt

Considerações éticas na integração da inteligência artificial na educação: um novo framework de rede neural profunda para predizer escores de transparência

Por que isso importa para estudantes e professores

Salas de aula em todo o mundo estão adotando rapidamente ferramentas de inteligência artificial para corrigir trabalhos, recomendar cursos e sinalizar alunos que podem precisar de ajuda. Ainda assim, a maioria das pessoas não tem muita ideia de como esses sistemas realmente tomam decisões, ou se tratam todos de forma justa. Este estudo apresenta uma forma de medir o quão “transparentes” esses sistemas educacionais são e introduz um novo modelo, o EduTransNet, que busca fazer previsões poderosas mantendo a justiça, a privacidade e a responsabilização no centro.

Vendo por dentro as decisões da IA

No cerne do artigo está uma nova medida chamada escore de transparência. Em vez de avaliar a IA na educação apenas pela precisão de suas previsões, os autores perguntam: podemos explicar seu raciocínio, traçar como entradas levam a saídas, comunicar suas decisões de forma clara a não especialistas e mostrar que segue normas éticas? Eles reúnem esses quatro ingredientes — explicabilidade, rastreabilidade, clareza de comunicação e conformidade ética — em um único escore de 0 a 100. Escores altos sinalizam sistemas de IA cujo comportamento pode ser inspecionado e questionado por estudantes, professores e administradores, em vez de ficar escondido em uma caixa preta.

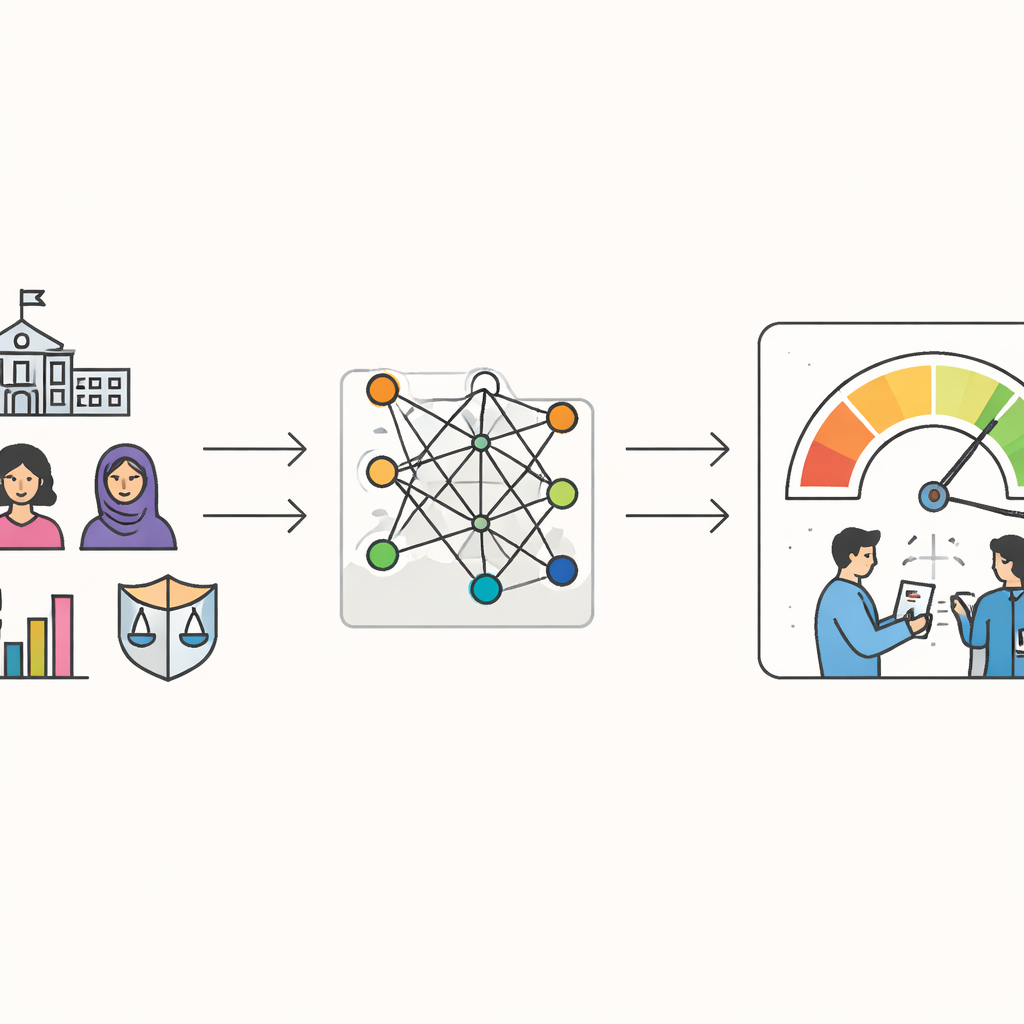

Como o novo modelo aprende com os estudantes

Para testar a ideia, os pesquisadores coletaram dados de 2.847 estudantes em três universidades do Paquistão. As informações incluíram dados demográficos básicos como idade e gênero, comportamentos de estudo como presença e horas semanais de estudo, notas e respostas a questionários sobre preocupações com privacidade, percepção de viés algorítmico, senso de justiça e expectativas de transparência. Com essas variáveis, o EduTransNet aprende a prever o escore de transparência de cada estudante — essencialmente estimando quão transparente uma decisão guiada por IA pareceria para aquele estudante e colegas semelhantes. Importante: o modelo depende mais de variáveis de engajamento e percepção ética, e muito menos de demografia, sugerindo que é movido mais pelo que os estudantes fazem e sentem do que por quem eles são.

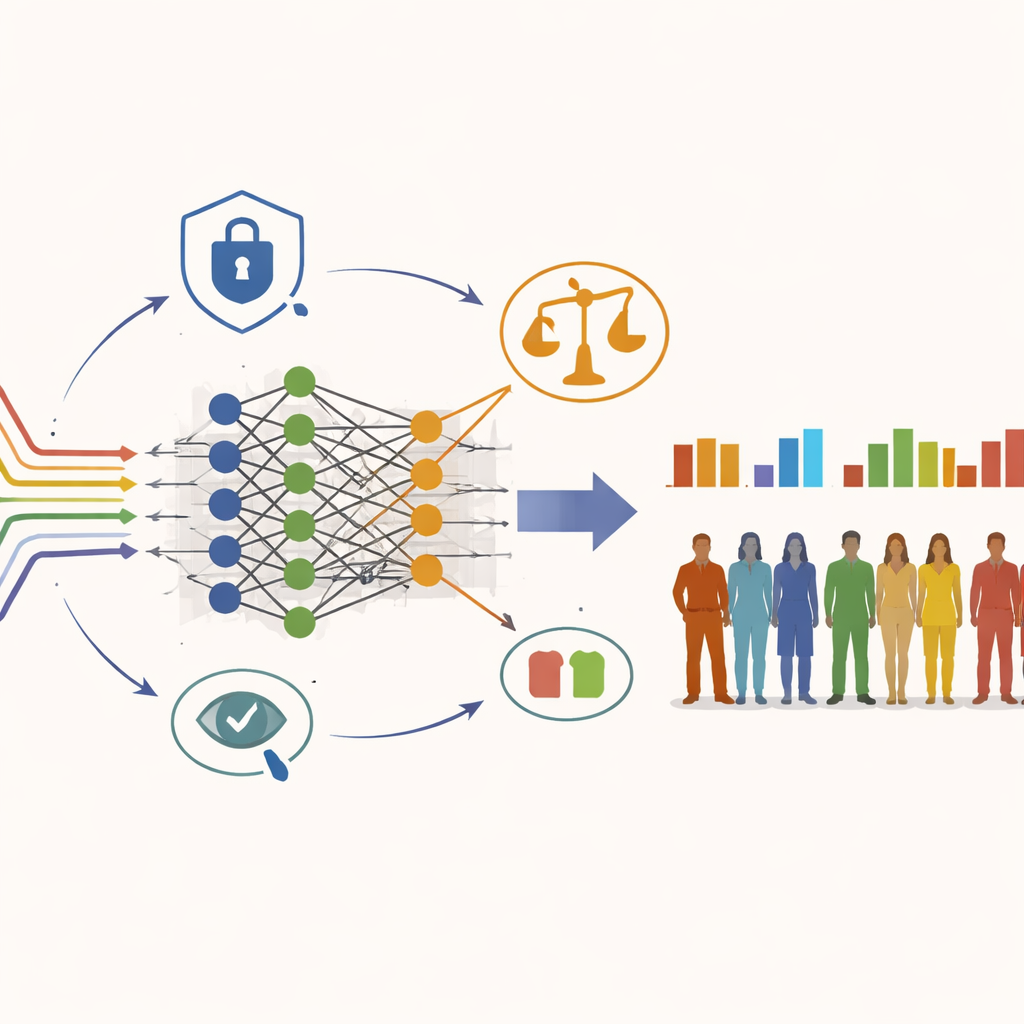

Construindo um modelo de IA com controles

O EduTransNet é uma rede neural profunda ajustada especificamente para essa tarefa. Ele empilha várias camadas que gradualmente comprimem e refinam os dados de entrada em uma única previsão de transparência. Mas, ao contrário de muitos modelos poderosos que se concentram apenas na precisão, este foi projetado com salvaguardas. O processo de treinamento penaliza explicitamente padrões em que um gênero ou grupo étnico recebe de forma consistente escores previstos mais altos ou mais baixos que outros. Os autores também incorporam formalmente o trade‑off privacidade‑versus‑utilidade, usando técnicas de anonimização e adição de ruído para que estudantes individuais não possam ser facilmente reidentificados, ao mesmo tempo em que o sistema ainda aprende padrões significativos.

Verificando precisão, equidade e privacidade

A equipe comparou o EduTransNet com três ferramentas preditivas comuns: regressão linear, regressão por vetores de suporte e florestas aleatórias. Em testes repetidos e em um conjunto reservado de estudantes que nunca havia visto, o EduTransNet explicou cerca de 99–100% da variação nos escores de transparência, enquanto cometia erros muito menores do que os outros modelos. Verificações estatísticas sugeriram que esse desempenho forte não é apenas um sobreajuste a particularidades dos dados. Ao mesmo tempo, auditorias de equidade usando ferramentas estabelecidas mostraram que os escores previstos estavam bem equilibrados entre gêneros e grupos étnicos, e que as taxas de erro não favoreciam sistematicamente nenhum grupo. Análises separadas confirmaram que as proteções de privacidade eram suficientemente robustas para limitar o risco de reidentificação, mantendo, porém, aprendizado preciso.

O que isso significa para salas de aula reais

Além da matemática, o estudo explora como tal sistema poderia ser usado na prática. Em um cenário, o EduTransNet ajuda a identificar estudantes que podem estar em risco acadêmico, mas associa cada sinal de risco a um escore de transparência alto ou baixo para que os professores saibam quanto confiar e como explicar o alerta. Em outro, apoia recomendações de cursos e carreira enquanto verifica se as sugestões não estão discretamente direcionando estudantes desfavorecidos para caminhos mais limitados. Em nível de política, escores de transparência agregados poderiam destacar escolas ou programas onde decisões de IA parecem opacas, orientando reformas direcionadas sem expor indivíduos.

Mensagem principal para não especialistas

A conclusão central é que não precisamos escolher entre IA poderosa e IA responsável na educação. Ao projetar modelos como o EduTransNet que tratam transparência e equidade como objetivos centrais de design — e não como algo secundário — desenvolvedores podem produzir sistemas que são ao mesmo tempo altamente precisos e mais fáceis de questionar, monitorar e melhorar. Embora os resultados até agora venham de três universidades e precisem ser testados em outros contextos, o framework oferece um caminho concreto para escolas, formuladores de políticas e desenvolvedores de IA que queiram aproveitar ferramentas inteligentes sem abrir mão dos direitos dos estudantes, da privacidade ou da igualdade de oportunidades.

Citação: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Palavras-chave: IA na educação, transparência algorítmica, IA ética, privacidade dos estudantes, justiça em aprendizado de máquina