Clear Sky Science · it

Considerazioni etiche sull’integrazione dell’intelligenza artificiale nell’istruzione: un nuovo framework basato su reti neurali profonde per prevedere i punteggi di trasparenza

Perché questo conta per studenti e insegnanti

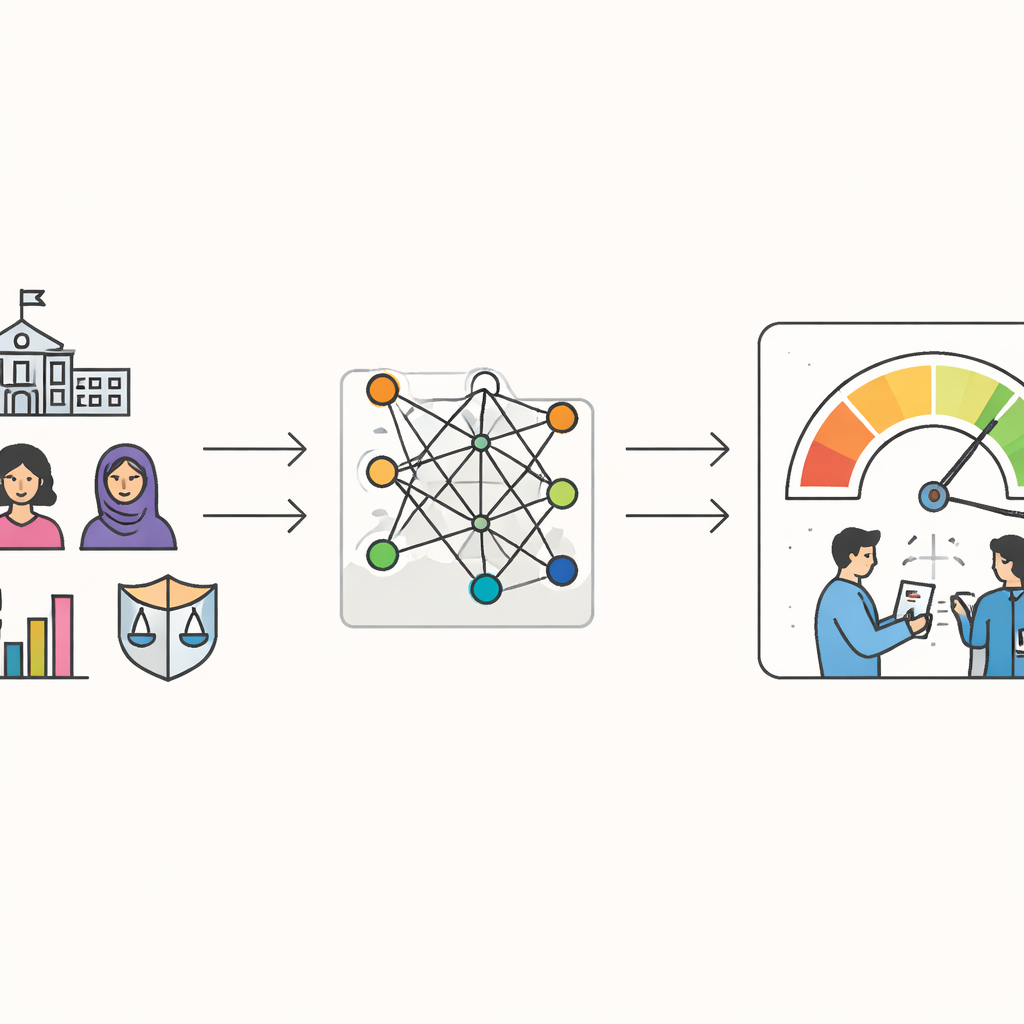

Le aule in tutto il mondo stanno adottando rapidamente strumenti di intelligenza artificiale per correggere compiti, consigliare corsi e segnalare studenti che potrebbero aver bisogno di aiuto. Eppure la maggior parte delle persone ha scarsa idea di come questi sistemi prendano realmente decisioni o se trattino tutti in modo equo. Questo studio introduce un metodo per misurare quanto questi sistemi educativi basati su IA siano “trasparenti” e presenta un nuovo modello, EduTransNet, che punta a fornire previsioni potenti mantenendo al centro equità, privacy e responsabilità.

Vedere dentro le decisioni dell’IA

Al centro dell’articolo c’è un nuovo metro chiamato punteggio di trasparenza. Invece di valutare l’IA nell’istruzione solo in base alla precisione delle sue previsioni, gli autori chiedono: possiamo spiegare il suo ragionamento, tracciare come gli input conducono agli output, comunicare chiaramente le decisioni ai non esperti e dimostrare che rispetta regole etiche? Raggruppano questi quattro elementi — spiegabilità, tracciabilità, chiarezza nella comunicazione e conformità etica — in un unico punteggio da 0 a 100. Punteggi alti segnalano sistemi IA il cui comportamento può essere ispezionato e messo in discussione da studenti, insegnanti e amministratori, anziché nascosto in una scatola nera.

Come il nuovo modello impara dagli studenti

Per mettere alla prova questa idea, i ricercatori hanno raccolto dati da 2.847 studenti di tre università in Pakistan. Le informazioni includevano dati demografici di base come età e genere, comportamenti di studio come frequenza e ore settimanali dedicate allo studio, voti e risposte a questionari su preoccupazioni relative alla privacy, consapevolezza dei bias algoritmici, senso di equità e aspettative di trasparenza. Con questi elementi, EduTransNet impara a prevedere il punteggio di trasparenza di ciascuno studente — stimando in pratica quanto una decisione guidata dall’IA risulterebbe trasparente per quello studente e per coetanei simili. Importante, il modello si basa maggiormente su caratteristiche legate all’impegno e alla percezione etica, e molto meno sui dati demografici, suggerendo che è guidato più da come gli studenti agiscono e percepiscono la situazione che da chi sono.

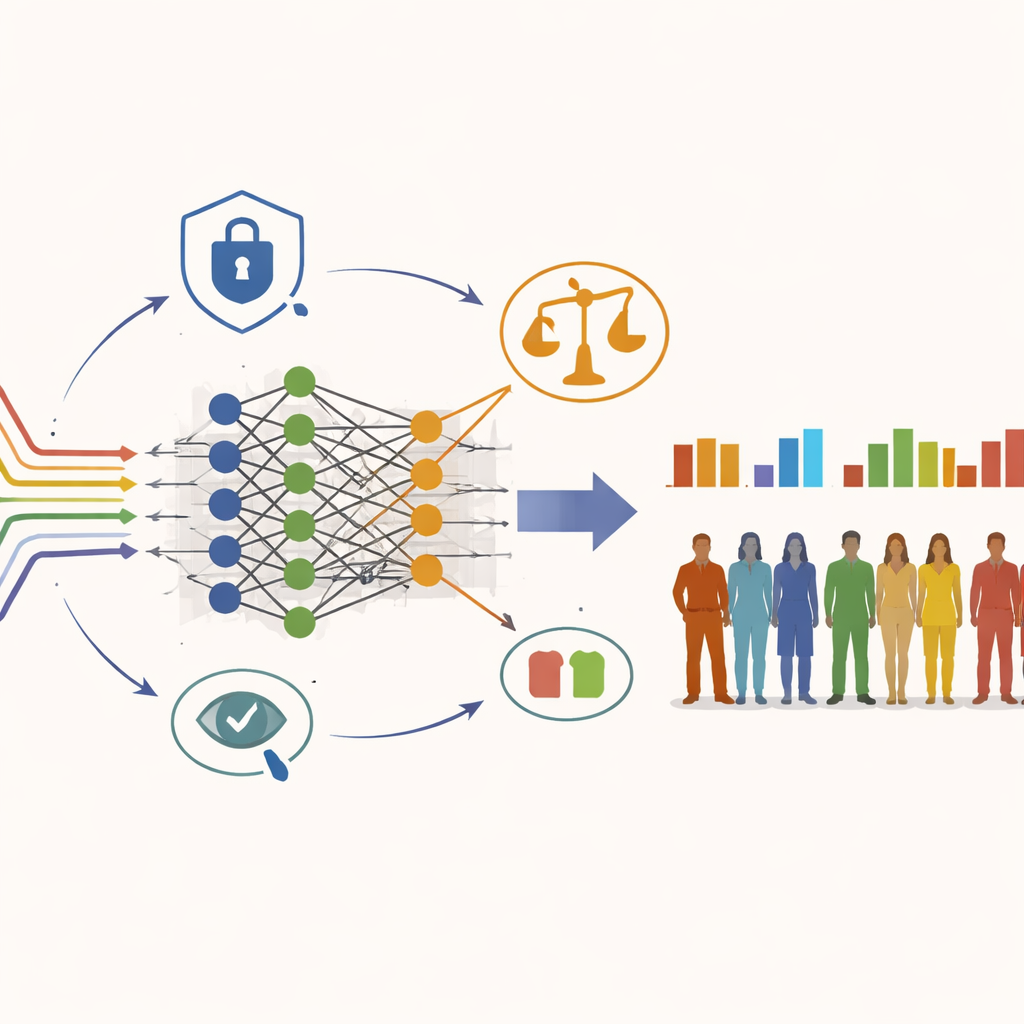

Costruire un modello di IA con salvaguardie

EduTransNet è una rete neurale profonda tarata specificamente per questo compito. Sovrappone diversi strati che comprimono e raffinano progressivamente i dati di input fino a una singola previsione di trasparenza. Ma a differenza di molti modelli potenti che si concentrano solo sulla precisione, questo è progettato con salvaguardie. Il processo di addestramento penalizza esplicitamente pattern in cui un genere o un gruppo etnico riceve sistematicamente punteggi previsti più alti o più bassi rispetto ad altri. Gli autori integrano inoltre un trade‑off formale tra privacy e utilità, usando tecniche di anonimizzazione e aggiunta di rumore in modo che gli studenti individuali non possano essere facilmente reidentificati pur permettendo al sistema di apprendere schemi significativi.

Verificare precisione, equità e privacy

Il team ha confrontato EduTransNet con tre strumenti predittivi comuni: regressione lineare, support vector regression e random forest. In test ripetuti e su un insieme di studenti tenuto fuori dal training che il modello non aveva mai visto, EduTransNet ha spiegato circa il 99–100 percento della variazione nei punteggi di trasparenza, commettendo errori molto più piccoli rispetto agli altri modelli. Controlli statistici hanno suggerito che questa forte prestazione non è solo un overfitting a particolarità dei dati. Allo stesso tempo, audit di equità condotti con toolkit consolidati hanno mostrato che i punteggi previsti erano ben bilanciati tra genere e gruppi etnici, e che i tassi d’errore non favorivano sistematicamente nessun gruppo. Analisi separate hanno confermato che le protezioni della privacy erano sufficientemente robuste da limitare il rischio di reidentificazione pur supportando un apprendimento accurato.

Cosa significa per le aule reali

Oltre alla matematica, lo studio esplora come un sistema del genere potrebbe essere usato nella pratica. In uno scenario, EduTransNet aiuta a identificare studenti a rischio dal punto di vista accademico, ma associa a ogni segnalazione di rischio un punteggio di trasparenza alto o basso in modo che gli insegnanti sappiano quanto fidarsi e come spiegare l’allerta. In un altro, supporta raccomandazioni di corsi e di carriera verificando che i suggerimenti non stiano silenziosamente indirizzando studenti svantaggiati verso percorsi più ristretti. A livello di politica, punteggi di trasparenza aggregati potrebbero evidenziare scuole o programmi in cui le decisioni IA risultano opache, guidando riforme mirate senza esporre singoli individui.

Messaggio chiave per i non esperti

La conclusione centrale è che non dobbiamo scegliere tra IA potente e IA responsabile nell’istruzione. Progettando modelli come EduTransNet che considerano trasparenza ed equità come obiettivi di design fondamentali — piuttosto che come riflessioni successive — gli sviluppatori possono produrre sistemi sia altamente accurati sia più facili da interrogare, monitorare e migliorare. Pur essendo i risultati ottenuti finora basati su tre università e necessitando di ulteriori verifiche in altri contesti, il framework offre un percorso concreto per scuole, responsabili politici e costruttori di IA che vogliono sfruttare strumenti intelligenti senza rinunciare ai diritti degli studenti, alla privacy o all’uguaglianza di opportunità.

Citazione: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Parole chiave: IA nell'istruzione, trasparenza algoritmica, IA etica, privacy degli studenti, equità nel machine learning