Clear Sky Science · es

Consideraciones éticas en la integración de la inteligencia artificial en la educación: un novedoso marco de redes neuronales profundas para predecir puntuaciones de transparencia

Por qué esto importa para estudiantes y docentes

Las aulas de todo el mundo están adoptando rápidamente herramientas de inteligencia artificial para calificar trabajos, recomendar cursos y señalar a estudiantes que pueden necesitar ayuda. Sin embargo, la mayoría de las personas tiene poca idea de cómo toman decisiones estos sistemas o de si tratan a todos con equidad. Este estudio introduce una forma de medir cuán “transparentes” son esos sistemas de IA educativa y presenta un nuevo modelo, EduTransNet, que pretende ofrecer predicciones potentes manteniendo la equidad, la privacidad y la responsabilidad en el centro.

Ver dentro de las decisiones de la IA

En el núcleo del artículo hay una nueva medida llamada puntuación de transparencia. En lugar de juzgar la IA en educación solo por la precisión de sus predicciones, los autores se preguntan: ¿podemos explicar su razonamiento, trazar cómo las entradas conducen a las salidas, comunicar claramente sus decisiones a no expertos y demostrar que sigue normas éticas? Agrupan estos cuatro ingredientes —explicabilidad, trazabilidad, claridad en la comunicación y cumplimiento ético— en una única puntuación de 0 a 100. Las puntuaciones altas indican sistemas de IA cuyo comportamiento puede ser inspeccionado y cuestionado por estudiantes, docentes y administradores, en lugar de quedarse oculto en una caja negra.

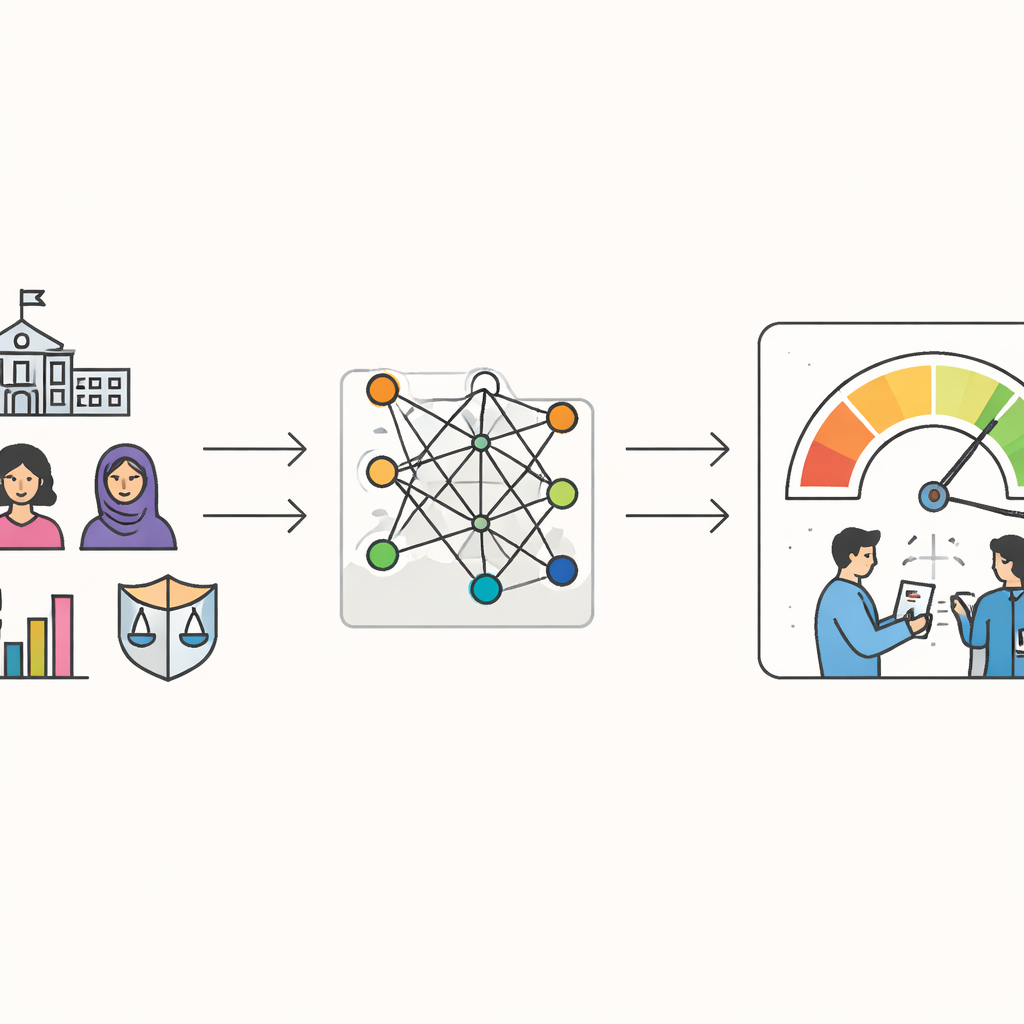

Cómo el nuevo modelo aprende de los estudiantes

Para probar esta idea, los investigadores recopilaron datos de 2.847 estudiantes de tres universidades en Pakistán. La información incluía datos demográficos básicos como edad y género, comportamientos de estudio como asistencia y horas semanales de estudio, calificaciones y respuestas a encuestas sobre preocupaciones de privacidad, conocimiento del sesgo algorítmico, sensación de justicia y expectativas de apertura. Con estos elementos, EduTransNet aprende a predecir la puntuación de transparencia de cada estudiante —esencialmente estimando qué tan transparente se percibiría una decisión impulsada por IA para ese estudiante y sus pares similares. De forma importante, el modelo se apoya principalmente en características de compromiso y percepción ética, y mucho menos en datos demográficos, lo que sugiere que se guía más por cómo actúan y sienten los estudiantes que por quiénes son.

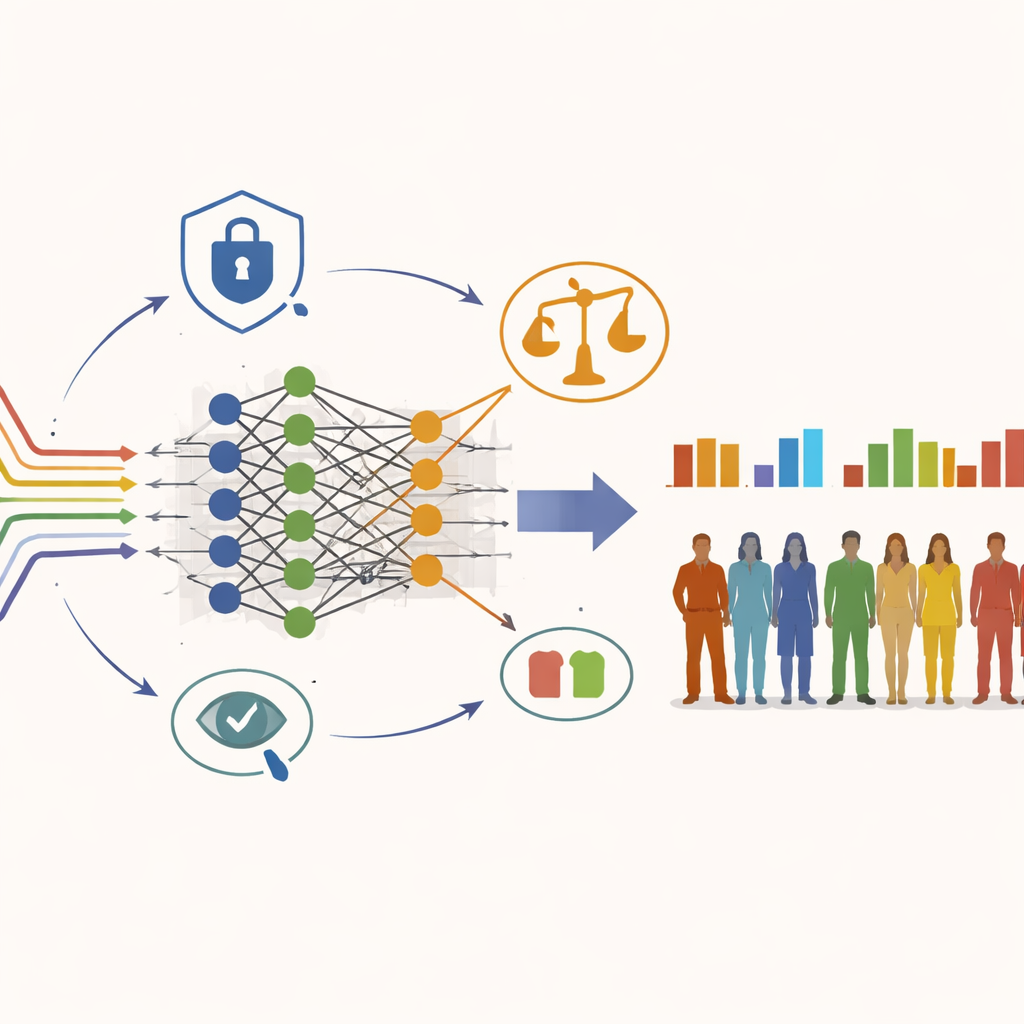

Construir un modelo de IA con salvaguardas

EduTransNet es una red neuronal profunda ajustada específicamente para esta tarea. Apila varias capas que comprimen y refinan gradualmente los datos de entrada hasta producir una única predicción de transparencia. Pero, a diferencia de muchos modelos potentes que se centran solo en la precisión, este está diseñado con salvaguardas. El proceso de entrenamiento penaliza explícitamente patrones en los que un género o grupo étnico recibe de forma consistente puntuaciones predichas más altas o más bajas que otros. Los autores también incorporan un compromiso formal entre privacidad y utilidad, usando técnicas de anonimización y adición de ruido para que los estudiantes individuales no puedan ser fácilmente reidentificados mientras el sistema aún aprende patrones significativos.

Comprobación de precisión, equidad y privacidad

El equipo comparó EduTransNet con tres herramientas predictivas comunes: regresión lineal, regresión con vectores de soporte y bosques aleatorios. En pruebas repetidas y sobre un conjunto retenido de estudiantes que nunca había visto, EduTransNet explicó alrededor del 99–100 por ciento de la variación en las puntuaciones de transparencia, mientras cometía errores mucho menores que los otros modelos. Verificaciones estadísticas sugirieron que este sólido rendimiento no se debe solo a un sobreajuste a peculiaridades de los datos. Al mismo tiempo, auditorías de equidad con herramientas establecidas mostraron que las puntuaciones predichas estaban equilibradas entre géneros y grupos étnicos, y que las tasas de error no favorecían sistemáticamente a ningún grupo. Análisis separados confirmaron que las protecciones de privacidad eran lo bastante fuertes como para limitar el riesgo de reidentificación y, aun así, permitir un aprendizaje preciso.

Qué significa esto para las aulas reales

Más allá de las matemáticas, el estudio explora cómo podría emplearse tal sistema en la práctica. En un escenario, EduTransNet ayuda a identificar estudiantes que pueden estar en riesgo académico, pero empareja cada señal de riesgo con una puntuación de transparencia alta o baja para que los docentes sepan cuánto confiar y cómo explicar la alerta. En otro, apoya recomendaciones de cursos y carreras mientras comprueba que las sugerencias no estén conduciendo silenciosamente a estudiantes desfavorecidos hacia trayectorias más estrechas. A nivel de política, las puntuaciones de transparencia agregadas podrían destacar escuelas o programas donde las decisiones de la IA se perciben como opacas, guiando reformas focalizadas sin exponer a las personas.

Mensaje clave para no expertos

La conclusión central es que no tenemos que elegir entre una IA potente y una IA responsable en la educación. Diseñando modelos como EduTransNet que traten la transparencia y la equidad como objetivos de diseño centrales —en lugar de consideraciones secundarias—, los desarrolladores pueden producir sistemas que sean a la vez muy precisos y más fáciles de cuestionar, supervisar y mejorar. Aunque los resultados hasta ahora provienen de tres universidades y deben probarse en otros contextos, el marco ofrece un camino concreto para escuelas, responsables de políticas y desarrolladores de IA que quieren aprovechar herramientas inteligentes sin renunciar a los derechos estudiantiles, la privacidad o la igualdad de oportunidades.

Cita: Alotaibi, R.M., Alnfiai, M.M., Alotaibi, N.N. et al. Ethical considerations in the integration of artificial intelligence into education: a novel deep neural network framework for predicting transparency scores. Sci Rep 16, 12123 (2026). https://doi.org/10.1038/s41598-026-41480-9

Palabras clave: IA en la educación, transparencia algorítmica, IA ética, privacidad estudiantil, equidad en el aprendizaje automático