Clear Sky Science · zh

用于恶劣天气下车辆与行人检测的多维注意力变换器

为什么能看穿恶劣天气很重要

现代汽车和城市摄像头正在学会为我们“看”路,实时发现车辆和行人,从而帮助避免事故。但雨、雾和黑暗仍然让许多系统困惑,在最关键的时刻将人和车隐藏起来。本文提出了MDAT‑YOLO,一种新的计算机视觉模型,旨在即使在浓雾、大雨和低光环境下也能快速且可靠地继续检测道路使用者。

现实驾驶中的挑战

多年来,研究人员通过强大的深度学习模型(如YOLO)改进了自动目标检测,这些模型能扫描图像并实时标注汽车、公交、摩托和行人等目标。然而,大多数模型是在晴朗白天的条件下训练和调优的。当能见度下降——在夜晚、雾中或暴雨时——目标会变得暗淡、模糊或部分被遮挡。小型或远处的道路使用者尤其容易被漏检。现有方法往往只针对单一类型的恶劣天气,或将多个重量级网络拼凑在一起,导致速度慢、结构复杂,不适合实时驾驶和监控。

一种更聪明的关注方式

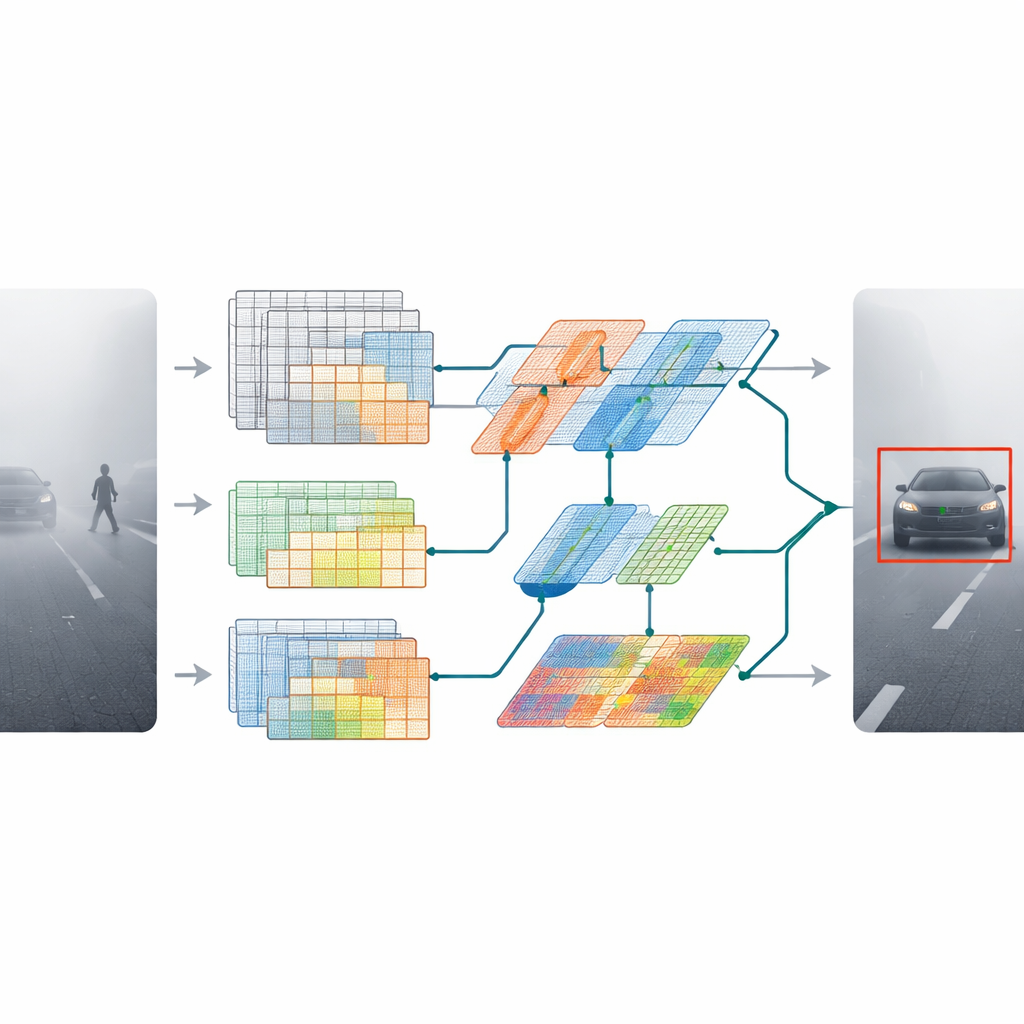

MDAT‑YOLO以一种流行检测器的紧凑版本为起点,重构其内部构件,使其能够适应复杂场景,而不是以相同僵硬的方式处理每一帧图像。关键想法是让模型在运行时决定在图像中应当关注何处以及如何处理不同类型的视觉模式。两种新组件驱动了这种行为。优化的深度可分离卷积层重新塑造了颜色通道间的信息流,使网络更轻量但表达能力更强。第二个模块称为全维动态卷积,不仅在空间上调整滤波器,还在不同特征通道和备选滤波集之间进行调整。两者结合使模型能在不降低速度的情况下对浓雾、强光眩光或嘈杂的雨迹做出不同响应。

在不牺牲速度的前提下加入全局上下文

除了锐化局部细节外,作者还赋予模型更好的整体场景感知。他们引入了一个轻量级的变换器模块——这类模块常用于语言模型——以学习图像中的长距离关系。与其在所有位置使用庞大且开销高的变换器,不如将精简版巧妙地嵌入网络的关键阶段。这有助于检测器理解远处的模糊轮廓更可能是一辆路上的汽车,而非随机噪声,并判断被雾或雨部分遮挡的小像素簇可能属于行人。

在恶劣天气下对模型进行测试

为了评估这些设计改进是否真正有效,研究人员在若干高难度图像集上测试了MDAT‑YOLO。这些数据包括真实世界的雾霾与降雨集、低光夜间集、一个新制作的知名基准的雾化版本,以及一个真实的雨天场景集。在所有测试中,该新模型在检测汽车、公交、摩托车、自行车和行人方面均优于许多近期的YOLO变体和其他先进方法。它在浓雾中识别车辆以及在黑暗场景中发现行人方面表现尤为突出。同样重要的是,该模型保持了实时处理速度,在现代硬件上可处理约每秒145张图像——足以用于行驶中的车辆和实时交通监控。

对日常安全的意义

简而言之,MDAT‑YOLO朝着在恶劣天气中仍能可靠工作的摄像头和车载计算机迈出了一步。通过将高效的构件与灵活的注意力机制及全局上下文结合,系统能在不变得笨重或迟缓的情况下“更努力地观察”昏暗、小型或部分被遮挡的物体。尽管仍需在更广泛、完全真实的环境数据上进行更多测试,结果表明未来的驾驶辅助系统、自动驾驶车辆和路边摄像头在雾、雨和黑暗中可能漏检更少的道路使用者——有助于在最恶劣的天气条件下提高道路安全。

引用: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

关键词: 自动驾驶, 目标检测, 恶劣天气, 计算机视觉, 交通安全