Clear Sky Science · it

Trasformatore di attenzione multi-dimensionale per il rilevamento di veicoli e pedoni in condizioni meteorologiche avverse

Perché è importante vedere attraverso il maltempo

Le auto moderne e le telecamere cittadine stanno imparando a “vedere” la strada per noi, individuando veicoli e pedoni così rapidamente da contribuire a evitare incidenti. Tuttavia pioggia, nebbia e oscurità continuano a confondere molti di questi sistemi, nascondendo persone e automobili proprio quando la sicurezza è più critica. Questo articolo presenta MDAT‑YOLO, un nuovo modello di visione artificiale progettato per continuare a rilevare utenti della strada rapidamente e in modo affidabile anche in nebbia fitta, pioggia intensa e scarsa illuminazione.

La sfida della guida nel mondo reale

Per anni i ricercatori hanno migliorato il rilevamento automatico di oggetti usando potenti modelli deep‑learning come YOLO, che analizzano le immagini e segnalano in tempo reale auto, autobus, biciclette e persone. La maggior parte di questi modelli, però, è addestrata e ottimizzata in condizioni diurne e limpide. Quando la visibilità diminuisce—di notte, nella nebbia o sotto un forte acquazzone—gli oggetti diventano sfocati, attenuati o parzialmente nascosti. Gli utenti della strada piccoli o lontani sono particolarmente facili da perdere. Gli approcci esistenti spesso si specializzano in un solo tipo di maltempo oppure assemblano più reti pesanti che sono troppo lente e complesse per la guida e la sorveglianza in tempo reale.

Un modo più intelligente per focalizzarsi su ciò che conta

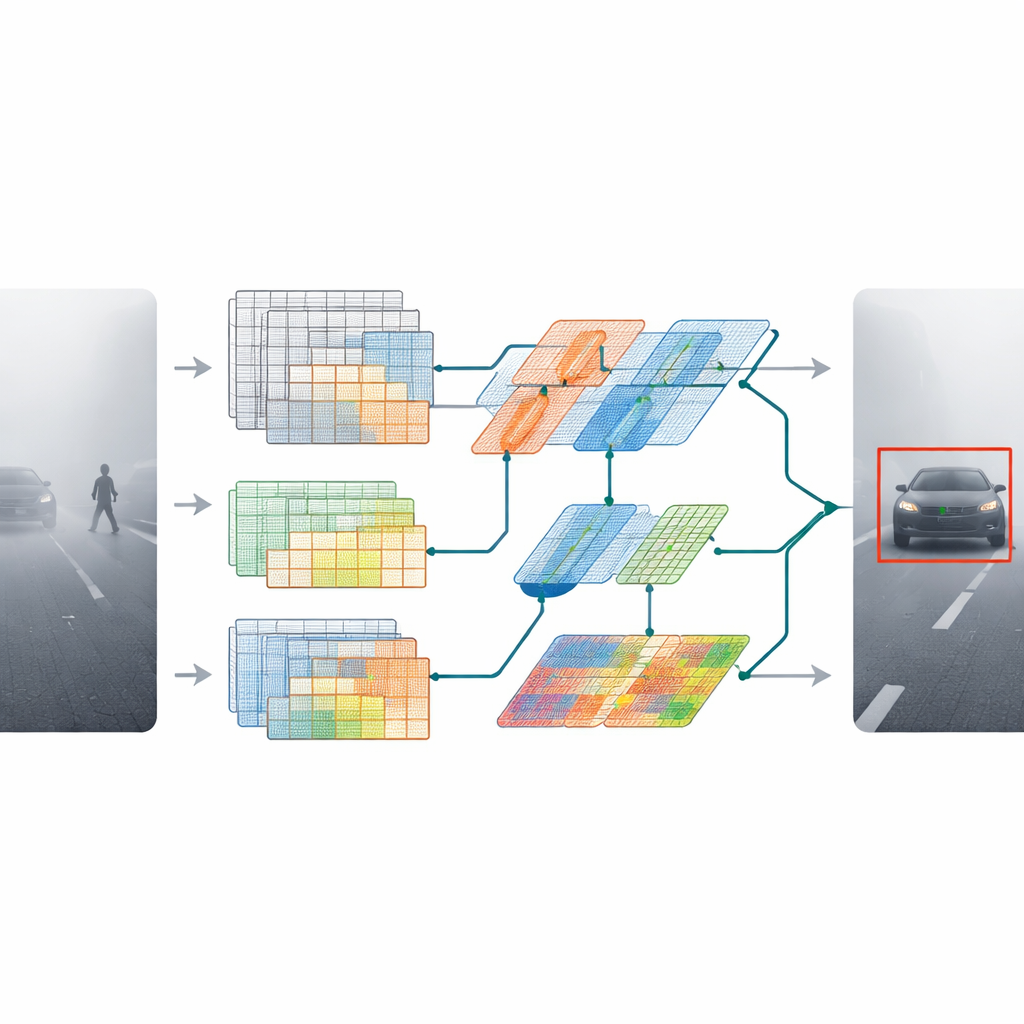

MDAT‑YOLO parte da una versione compatta di un noto rilevatore e riprogetta i suoi componenti interni in modo che possa adattarsi a scene difficili invece di trattare ogni immagine allo stesso modo rigido. L’idea chiave è lasciare al modello la decisione, al volo, di dove concentrare la propria attenzione in un’immagine e come processare diversi tipi di patterns visivi. Due nuovi componenti guidano questo comportamento. Uno strato di convoluzione depthwise ottimizzato rimodella il flusso di informazioni tra i canali di colore, rendendo la rete più leggera ma più espressiva. Un secondo modulo, chiamato convoluzione dinamica omni‑dimensionale, adatta i suoi filtri non solo nello spazio, ma anche attraverso diversi canali di feature e insiemi alternativi di filtri. Insieme, permettono al modello di rispondere in modo diverso a nebbia fitta, abbagliamenti intensi o scrosci di pioggia rumorosi senza rallentare.

Aggiungere contesto globale senza rallentare

Oltre ad affinare i dettagli locali, gli autori danno al modello una migliore comprensione dell’intera scena. Introducono un blocco transformer leggero—comunemente usato nei modelli linguistici—that apprende relazioni a lungo raggio nell’immagine. Invece di applicare un transformer grande e costoso ovunque, inseriscono una versione snellita in fasi chiave della rete. Questo aiuta il rivelatore a capire che un contorno tenue in lontananza è probabile una macchina sulla strada e non rumore casuale, e che piccoli aggregati di pixel possono appartenere a un pedone parzialmente nascosto da nebbia o pioggia.

Mettere il modello alla prova in condizioni difficili

Per valutare se questi cambiamenti progettuali realmente funzionano, i ricercatori hanno testato MDAT‑YOLO su diverse raccolte di immagini impegnative. Queste includono un set reale di nebbia, foschia e pioggia; un set notturno a bassa illuminazione; una nuova versione nebbiosa di un noto benchmark; e un set di scene realmente piovose. Su tutti, il nuovo modello ha rilevato auto, autobus, motocicli, biciclette e persone con maggiore accuratezza rispetto a molte varianti recenti di YOLO e ad altri metodi avanzati. Si è dimostrato particolarmente efficace nell’individuare veicoli in nebbia fitta e persone in scene scure. Non meno importante, il modello ha mantenuto velocità in tempo reale, elaborando fino a circa 145 immagini al secondo su hardware moderno—abbastanza veloce per l’utilizzo su veicoli in movimento e nel monitoraggio del traffico in diretta.

Cosa significa per la sicurezza di tutti i giorni

In termini semplici, MDAT‑YOLO rappresenta un passo verso telecamere e computer di bordo che continuano a funzionare in modo affidabile quando il tempo peggiora. Combinando blocchi costruttivi efficienti con attenzione flessibile e contesto globale, il sistema “guarda più a fondo” oggetti deboli, piccoli o parzialmente nascosti senza diventare ingombrante o lento. Pur richiedendo ulteriori test su dati reali più ampi, i risultati suggeriscono che i futuri sistemi di assistenza alla guida, auto autonome e telecamere stradali potrebbero perdere meno utenti della strada in caso di nebbia, pioggia e oscurità—contribuendo a rendere le strade più sicure anche nelle giornate peggiori.

Citazione: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

Parole chiave: guida autonoma, rilevamento oggetti, condizioni meteorologiche avverse, visione artificiale, sicurezza stradale