Clear Sky Science · pl

Wielowymiarowy transformator uwagi do wykrywania pojazdów i pieszych w niekorzystnych warunkach pogodowych

Dlaczego widzenie przez złą pogodę ma znaczenie

Nowoczesne samochody i miejskie kamery uczą się „widzieć” drogę za nas, rozpoznając pojazdy i pieszych tak szybko, że mogą pomagać unikać wypadków. Jednak deszcz, mgła i ciemność wciąż mylą wiele z tych systemów, ukrywając ludzi i samochody właśnie wtedy, gdy bezpieczeństwo ma największe znaczenie. W artykule przedstawiono MDAT‑YOLO — nowy model widzenia komputerowego zaprojektowany tak, by nadal szybko i niezawodnie wykrywać uczestników ruchu nawet w gęstej mgle, intensywnym deszczu i przy słabym oświetleniu.

Wyzwanie jazdy w rzeczywistym świecie

Przez lata naukowcy ulepszali automatyczne wykrywanie obiektów za pomocą potężnych modeli głębokiego uczenia, takich jak YOLO, które skanują obrazy i oznaczają samochody, autobusy, rowery i ludzi w czasie rzeczywistym. Jednak większość tych modeli jest trenowana i dostrajana w warunkach jasnego, dziennego widzenia. Gdy widoczność spada — w nocy, we mgle czy podczas ulewy — obiekty stają się ledwo widoczne, rozmyte lub częściowo zasłonięte. Szczególnie łatwo o pominięcie małych lub odległych uczestników ruchu. Istniejące podejścia często specjalizują się w jednym rodzaju złej pogody albo łączą kilka ciężkich sieci, które są zbyt wolne i złożone, by działać w czasie rzeczywistym podczas jazdy i monitoringu.

Inteligentniejszy sposób skupiania się na tym, co ważne

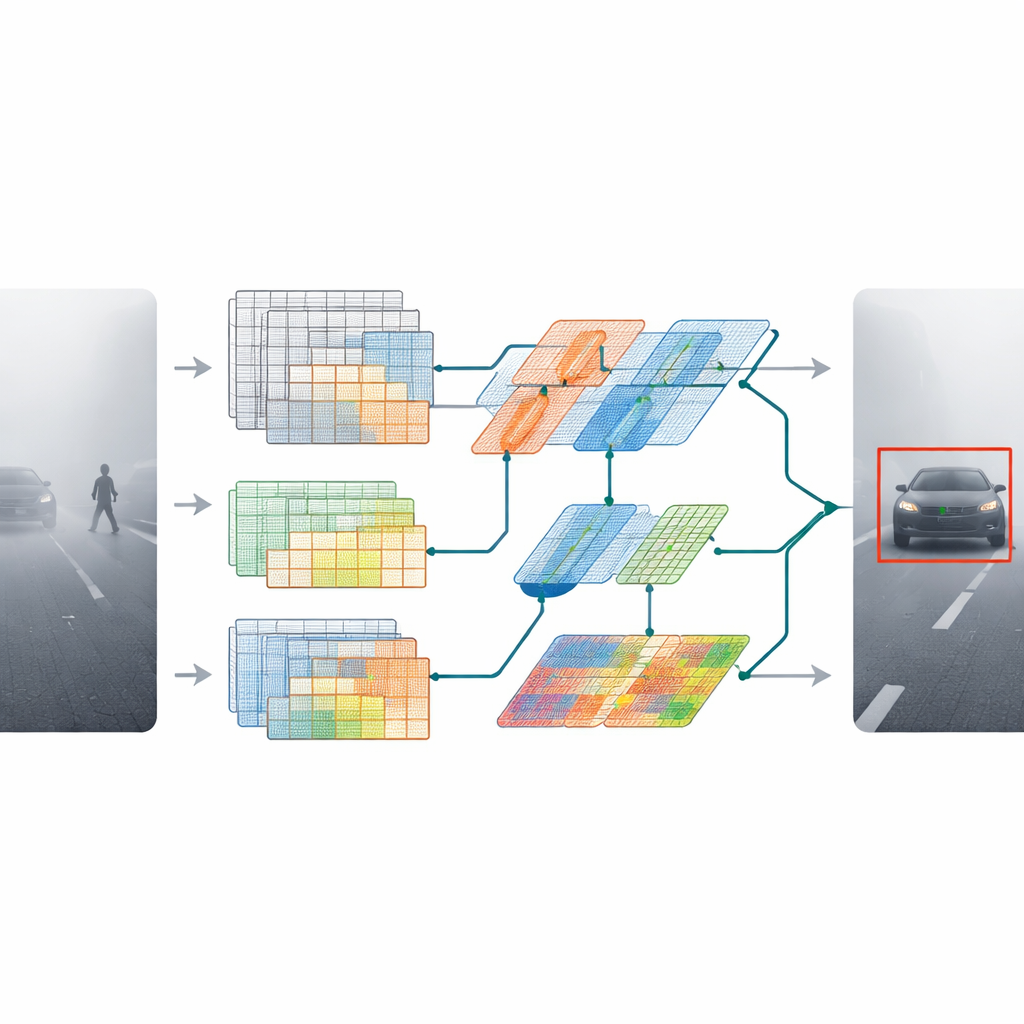

MDAT‑YOLO zaczyna od kompaktowej wersji popularnego detektora i przeprojektowuje jego wewnętrzne bloki, tak aby mógł dostosowywać się do trudnych scen zamiast traktować każde zdjęcie w ten sam sztywny sposób. Kluczowy pomysł polega na tym, by model decydował w czasie rzeczywistym, gdzie skupić uwagę na obrazie i jak przetwarzać różne rodzaje wzorców wizualnych. Na to zachowanie wpływają dwa nowe komponenty. Zoptymalizowana warstwa konwolucji głębokiej (depthwise) zmienia sposób przepływu informacji między kanałami kolorów, czyniąc sieć lżejszą, a jednocześnie bardziej ekspresyjną. Drugi moduł, zwany omni‑wymiarową dynamiczną konwolucją, dostosowuje swoje filtry nie tylko w przestrzeni, ale też pomiędzy różnymi kanałami cech i alternatywnymi zestawami filtrów. Razem pozwalają modelowi reagować inaczej na gęstą mgłę, oślepiające refleksy czy zakłócenia od kropli deszczu, nie spowalniając przy tym działania.

Dodanie kontekstu globalnego bez spowolnienia

Poza wyostrzeniem lokalnych detali, autorzy dali modelowi lepsze wyczucie całej sceny. Wprowadzili lekkie bloki transformera — powszechnie stosowane w modelach językowych — które uczą się relacji dalekiego zasięgu na obrazie. Zamiast stosować duży, kosztowny transformer wszędzie, wplatają jego odchudzoną wersję w kluczowe etapy sieci. Dzięki temu detektor lepiej rozumie, że słabo widoczny zarys w oddali prawdopodobnie jest samochodem na drodze, a małe skupiska pikseli mogą należeć do pieszego częściowo zasłoniętego mgłą lub deszczem.

Testy modelu w trudnej pogodzie

Aby ocenić, czy te zmiany w projekcie rzeczywiście pomagają, badacze przetestowali MDAT‑YOLO na kilku wymagających zbiorach obrazów. Obejmowały one rzeczywiste zestawy z mgłą, zamgleniem i deszczem; zestaw nocny przy słabym oświetleniu; nowo utworzoną mglistą wersję znanego benchmarku; oraz rzeczywisty zestaw scen deszczowych. We wszystkich tych przypadkach nowy model wykrywał samochody, autobusy, motocykle, rowery i ludzi z większą dokładnością niż wiele ostatnich wariantów YOLO i inne zaawansowane metody. Był szczególnie skuteczny w wykrywaniu pojazdów w gęstej mgle i osób w ciemnych scenach. Co równie ważne, utrzymywał prędkości pracy w czasie rzeczywistym, przetwarzając do około 145 obrazów na sekundę na nowoczesnym sprzęcie — na tyle szybko, by nadawać się do zastosowań w pojazdach w ruchu i monitoringu ruchu na żywo.

Co to oznacza dla codziennego bezpieczeństwa

Mówiąc prosto, MDAT‑YOLO to krok w stronę kamer i komputerów pokładowych, które działają niezawodnie, gdy pogoda się pogarsza. Poprzez połączenie wydajnych bloków konstrukcyjnych z elastyczną uwagą i kontekstem globalnym, system „patrzy dokładniej” na słabo widoczne, małe lub częściowo zasłonięte obiekty, nie stając się przy tym masywny ani wolny. Chociaż potrzebne są dalsze testy na szerszych, w pełni rzeczywistych danych, wyniki sugerują, że przyszłe systemy wspomagania kierowcy, samochody autonomiczne i kamery przydrożne mogą mniej często pomijać uczestników ruchu we mgle, deszczu i ciemności — co pomoże zwiększyć bezpieczeństwo na ulicach nawet w najgorsze dni.

Cytowanie: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

Słowa kluczowe: jazda autonomiczna, wykrywanie obiektów, niekorzystne warunki pogodowe, widzenie komputerowe, bezpieczeństwo ruchu