Clear Sky Science · de

Multidimensionaler Aufmerksamkeits‑Transformer zur Erkennung von Fahrzeugen und Fußgängern bei widrigen Wetterbedingungen

Warum Durchblick bei schlechtem Wetter wichtig ist

Moderne Autos und städtische Kameras lernen, die Straße für uns „zu sehen“ und erkennen Fahrzeuge und Fußgänger so schnell, dass sie helfen können, Unfälle zu vermeiden. Regen, Nebel und Dunkelheit verwirren viele dieser Systeme jedoch weiterhin und verbergen Menschen und Autos gerade dann, wenn die Sicherheit am wichtigsten ist. Dieses Papier stellt MDAT‑YOLO vor, ein neues Computer‑Vision‑Modell, das darauf ausgelegt ist, Straßenbeteiligte auch bei dichtem Nebel, starkem Regen und schlechter Beleuchtung schnell und zuverlässig weiter zu erkennen.

Die Herausforderung des Fahrens in der realen Welt

Seit Jahren verbessern Forschende die automatische Objekterkennung mit leistungsfähigen Deep‑Learning‑Modellen wie YOLO, die Bilder scannen und in Echtzeit Autos, Busse, Fahrräder und Menschen markieren. Die meisten dieser Modelle werden jedoch unter klaren Tagesbedingungen trainiert und eingestellt. Wenn die Sicht abnimmt – nachts, im Nebel oder bei einem Wolkenbruch – werden Objekte blass, verschwommen oder teilweise verdeckt. Kleine oder weit entfernte Verkehrsteilnehmer gehen besonders leicht verloren. Bestehende Ansätze spezialisieren sich oft auf eine einzige Art schlechten Wetters oder koppeln mehrere schwere Netze aneinander, die für Echtzeit‑Fahrbetrieb und Überwachung zu langsam und zu komplex sind.

Eine schlauere Art, sich auf Wichtiges zu konzentrieren

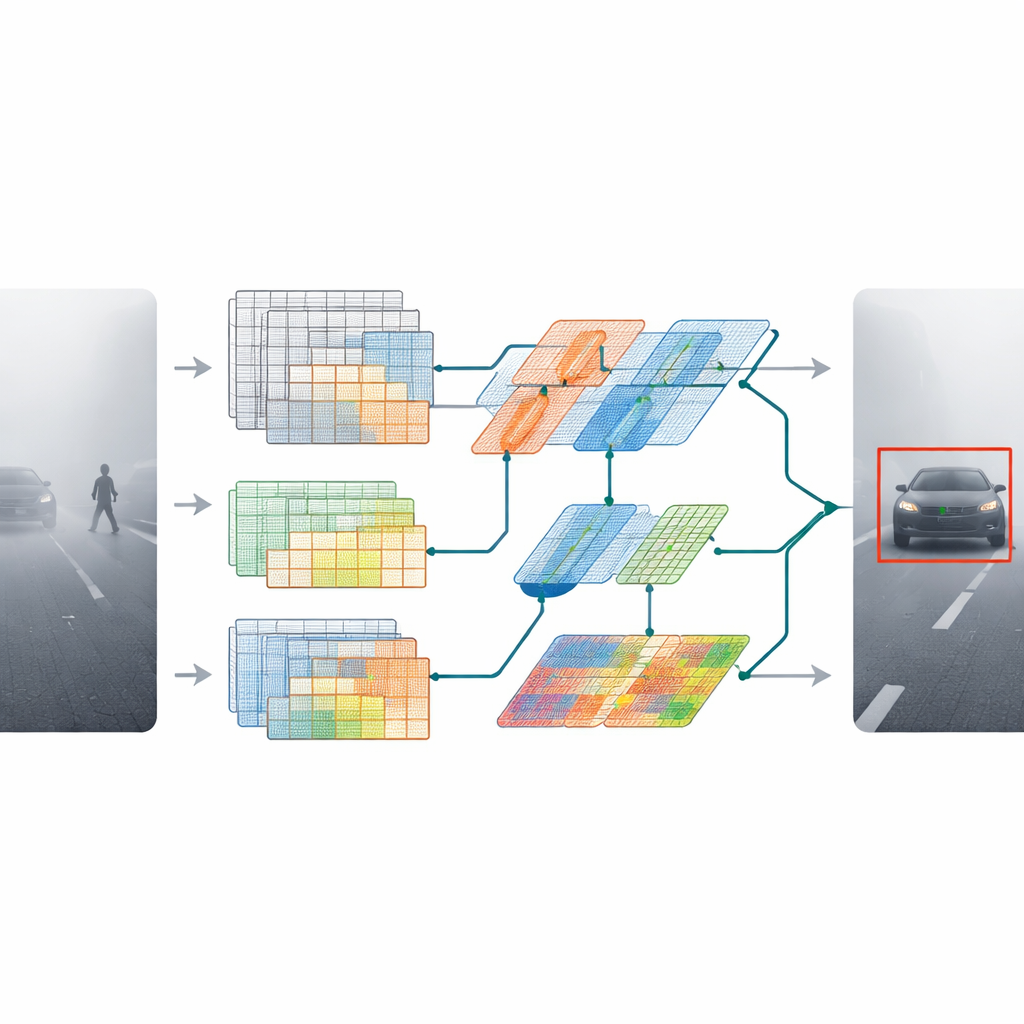

MDAT‑YOLO beginnt mit einer kompakten Version eines bekannten Detektors und überarbeitet seine inneren Bausteine so, dass es sich an schwierige Szenen anpassen kann, anstatt jedes Bild starr gleich zu behandeln. Die Schlüsselidee ist, dem Modell zu erlauben, in Echtzeit zu entscheiden, worauf es im Bild seine Aufmerksamkeit richtet und wie es verschiedene visuelle Muster verarbeitet. Zwei neue Komponenten treiben dieses Verhalten an. Eine optimierte depthwise‑Convolution‑Schicht formt den Informationsfluss zwischen Farbkanälen um und macht das Netzwerk leichter, aber zugleich ausdrucksstärker. Ein zweites Modul, omni‑dimensionale dynamische Convolution genannt, passt seine Filter nicht nur räumlich an, sondern auch über verschiedene Merkmalskanäle und alternative Filtersets. Zusammen ermöglichen sie dem Modell, unterschiedlich auf dichten Nebel, starke Blendung oder Rauschen durch Regenstreifen zu reagieren, ohne langsamer zu werden.

Globalen Kontext hinzufügen, ohne Tempo zu verlieren

Über das Schärfen lokaler Details hinaus geben die Autoren dem Modell ein besseres Verständnis der Gesamtszene. Sie führen einen leichten Transformer‑Block ein – wie er häufig in Sprachmodellen verwendet wird –, der langreichweitige Beziehungen im Bild lernt. Statt einen großen, teuren Transformer überall einzusetzen, fügen sie eine schlankere Version in Schlüsselphasen des Netzwerks ein. Das hilft dem Detektor zu erkennen, dass eine schwache Kontur in der Ferne wahrscheinlich ein Auto auf der Straße und kein zufälliges Rauschen ist und dass kleine Pixelgruppen zu einem teilweise von Nebel oder Regen verdeckten Fußgänger gehören können.

Das Modell bei schwerem Wetter testen

Um zu beurteilen, ob diese Designänderungen wirklich helfen, testeten die Forschenden MDAT‑YOLO an mehreren anspruchsvollen Bildsammlungen. Diese umfassen einen realen Satz mit Nebel, Dunst und Regen; einen Nacht‑Datensatz bei schwacher Beleuchtung; eine neu erstellte neblige Version eines bekannten Benchmarks; sowie eine reale Sammlung von Regenszenen. Über alle Datensätze hinweg erkannte das neue Modell Autos, Busse, Motorräder, Fahrräder und Personen genauer als viele jüngere YOLO‑Varianten und andere fortgeschrittene Methoden. Besonders stark war es beim Finden von Fahrzeugen im dichten Nebel und von Personen in dunklen Szenen. Ebenso wichtig: Das Modell hielt Echtzeitgeschwindigkeiten ein und verarbeitete auf moderner Hardware bis zu etwa 145 Bilder pro Sekunde – schnell genug für den Einsatz in fahrenden Fahrzeugen und in der Live‑Verkehrsüberwachung.

Was das für die tägliche Sicherheit bedeutet

Einfach gesagt ist MDAT‑YOLO ein Schritt hin zu Kameras und Bordcomputern, die zuverlässig weiterarbeiten, wenn das Wetter umschlägt. Durch die Kombination effizienter Bausteine mit flexibler Aufmerksamkeit und globalem Kontext „schaut“ das System intensiver auf schwache, kleine oder teilweise verdeckte Objekte, ohne klobig oder langsam zu werden. Zwar sind weitere Tests an breiteren, vollständig realen Datensätzen nötig, doch die Ergebnisse deuten darauf hin, dass künftige Fahrerassistenzsysteme, autonome Fahrzeuge und Straßenkameras weniger Verkehrsteilnehmer im Nebel, Regen und Dunkelheit übersehen könnten – und so die Straßen auch an schlechten Tagen sicherer machen.

Zitation: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

Schlüsselwörter: autonomes Fahren, Objekterkennung, widrige Wetterbedingungen, Computer Vision, Verkehrssicherheit