Clear Sky Science · es

Transformador de atención multidimensional para la detección de vehículos y peatones en condiciones meteorológicas adversas

Por qué importa ver a través del mal tiempo

Los coches modernos y las cámaras urbanas están aprendiendo a “ver” la carretera por nosotros, identificando vehículos y peatones con tanta rapidez que pueden ayudar a evitar accidentes. Pero la lluvia, la niebla y la oscuridad aún confunden a muchos de estos sistemas, ocultando a las personas y a los vehículos justo cuando la seguridad es más importante. Este trabajo presenta MDAT‑YOLO, un nuevo modelo de visión por computador diseñado para seguir detectando usuarios de la vía de forma rápida y fiable incluso en niebla densa, lluvia intensa y baja luminosidad.

El reto de conducir en el mundo real

Durante años, los investigadores han mejorado la detección automática de objetos usando potentes modelos de aprendizaje profundo como YOLO, que escanean imágenes y marcan coches, autobuses, bicicletas y personas en tiempo real. Sin embargo, la mayoría de estos modelos se entrenan y ajustan en condiciones despejadas y diurnas. Cuando la visibilidad disminuye —por la noche, en la niebla o durante un aguacero— los objetos se vuelven tenues, borrosos o parcialmente ocultos. Los usuarios de la vía pequeños o lejanos son especialmente fáciles de pasar por alto. Los enfoques existentes a menudo se especializan en un único tipo de mal tiempo, o combinan varias redes pesadas que resultan demasiado lentas y complejas para la conducción y la vigilancia en tiempo real.

Una forma más inteligente de centrarse en lo importante

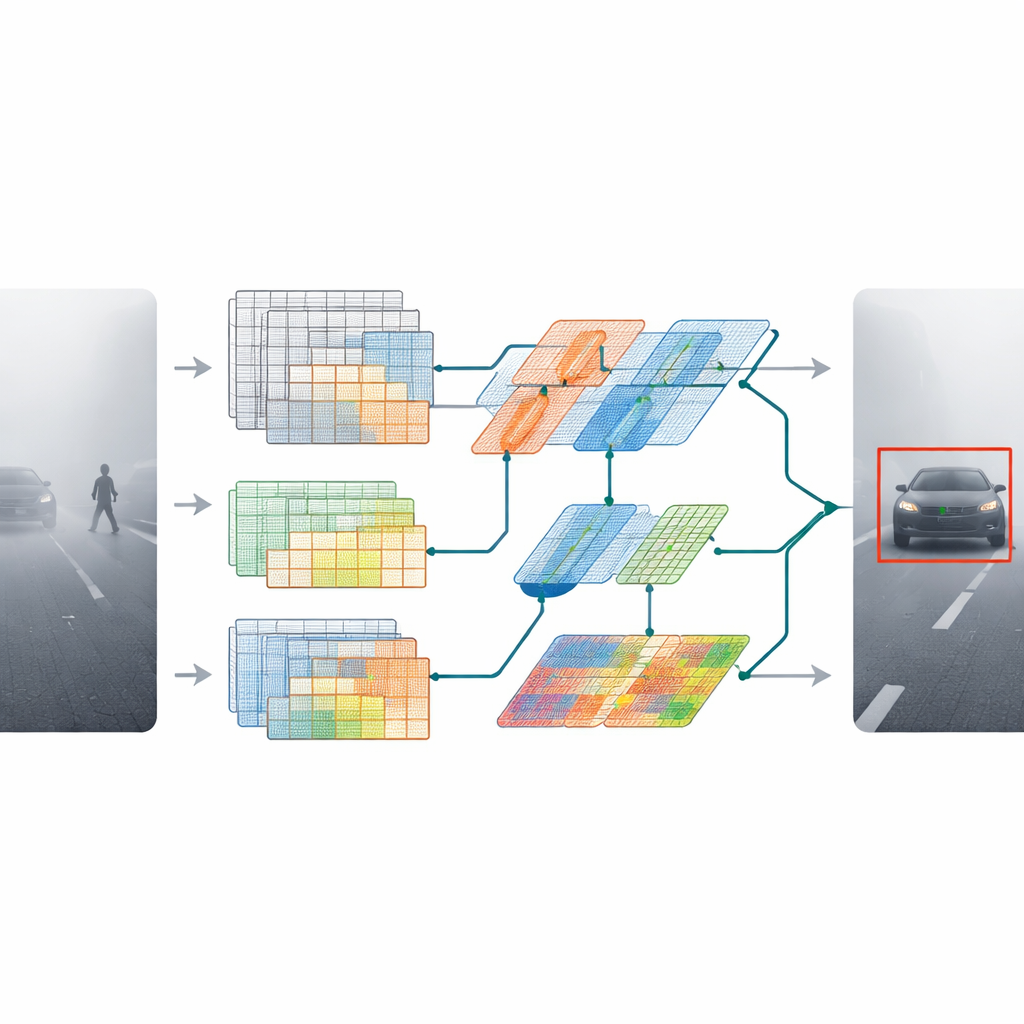

MDAT‑YOLO parte de una versión compacta de un detector popular y rediseña sus bloques internos para que pueda adaptarse a escenas difíciles en lugar de tratar cada imagen de la misma manera rígida. La idea clave es permitir que el modelo decida, sobre la marcha, dónde centrar su atención en una imagen y cómo procesar distintos tipos de patrones visuales. Dos componentes nuevos impulsan este comportamiento. Una capa de convolución depthwise optimizada redefine cómo fluye la información entre los canales de color, haciendo la red más ligera pero más expresiva. Un segundo módulo, llamado convolución dinámica omnidimensional, ajusta sus filtros no solo a través del espacio, sino también entre diferentes canales de características y conjuntos alternativos de filtros. Juntos, permiten que el modelo responda de forma diferente a la niebla densa, al deslumbramiento intenso o a las rachas de lluvia ruidosas sin perder velocidad.

Añadir contexto global sin perder velocidad

Más allá de afinar los detalles locales, los autores dotan al modelo de una mejor percepción de la escena completa. Introducen un bloque transformador ligero —comúnmente usado en modelos de lenguaje— que aprende relaciones de largo alcance en la imagen. En lugar de aplicar un transformador grande y costoso por todas partes, integran una versión reducida en etapas clave de la red. Esto ayuda al detector a entender que un contorno tenue en la distancia probablemente sea un coche en la carretera, no ruido aleatorio, y que pequeños grupos de píxeles pueden pertenecer a un peatón parcialmente oculto por la niebla o la lluvia.

Poner el modelo a prueba en tiempo adverso

Para evaluar si estos cambios de diseño realmente ayudan, los investigadores probaron MDAT‑YOLO en varios conjuntos de imágenes exigentes. Estos incluyen una colección real de niebla, bruma y lluvia; un conjunto nocturno de baja luminosidad; una versión neblinosa nueva de un banco de pruebas bien conocido; y un conjunto real de escenas lluviosas. En todos ellos, el nuevo modelo detectó coches, autobuses, motos, bicicletas y personas con mayor precisión que muchas variantes recientes de YOLO y otros métodos avanzados. Fue especialmente eficaz localizando vehículos en niebla densa y personas en escenas oscuras. Tan importante como la precisión, el modelo mantuvo velocidades en tiempo real, procesando hasta unas 145 imágenes por segundo en hardware moderno —lo bastante rápido para su uso en vehículos en movimiento y en vigilancia de tráfico en directo.

Qué significa esto para la seguridad cotidiana

En términos sencillos, MDAT‑YOLO es un paso hacia cámaras y equipos a bordo que siguen funcionando de forma fiable cuando el tiempo empeora. Al combinar bloques eficientes con atención flexible y contexto global, el sistema “mira más de cerca” objetos tenues, pequeños o parcialmente ocultos sin volverse voluminoso o lento. Aunque hacen falta más pruebas con datos reales más amplios, los resultados sugieren que futuros sistemas de asistencia al conductor, vehículos autónomos y cámaras en carretera podrían pasar por alto a menos usuarios de la vía en niebla, lluvia y oscuridad —contribuyendo a que las calles sean más seguras incluso en los peores días.

Cita: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

Palabras clave: conducción autónoma, detección de objetos, condiciones meteorológicas adversas, visión por computador, seguridad vial