Clear Sky Science · nl

Multidimensionale attention-transformer voor voertuig- en voetgangersdetectie bij slecht weer

Waarom door slecht weer heen kunnen kijken belangrijk is

Moderne auto’s en stadscamera’s leren de weg voor ons ‘‘zien’’, en herkennen voertuigen en voetgangers zo snel dat ze kunnen helpen ongevallen te voorkomen. Maar regen, mist en duisternis verwarren veel van deze systemen nog steeds, waardoor mensen en auto’s juist op momenten dat het veiligheid betreft onzichtbaar worden. Dit artikel introduceert MDAT‑YOLO, een nieuw computerzichtmodel dat is ontworpen om weggebruikers snel en betrouwbaar te blijven detecteren, zelfs bij dikke mist, zware regenval en weinig licht.

De uitdaging van rijden in de echte wereld

Jarenlang hebben onderzoekers automatische objectdetectie verbeterd met krachtige deep‑learningmodellen zoals YOLO, die beelden scannen en in realtime auto’s, bussen, fietsen en mensen markeren. De meeste van deze modellen worden echter getraind en afgesteld onder heldere, daglichtomstandigheden. Als het zicht afneemt—’s nachts, in mist of tijdens een stortbui— worden objecten vaag, vervormd of deels verborgen. Kleine of verafgelegen weggebruikers zijn bijzonder makkelijk te missen. Bestaande benaderingen specialiseren zich vaak in één soort slecht weer, of ze koppelen meerdere zware netwerken aan elkaar die te traag en te complex zijn voor realtime gebruik tijdens rijden en bewaking.

Een slimmer manier om te focussen op wat telt

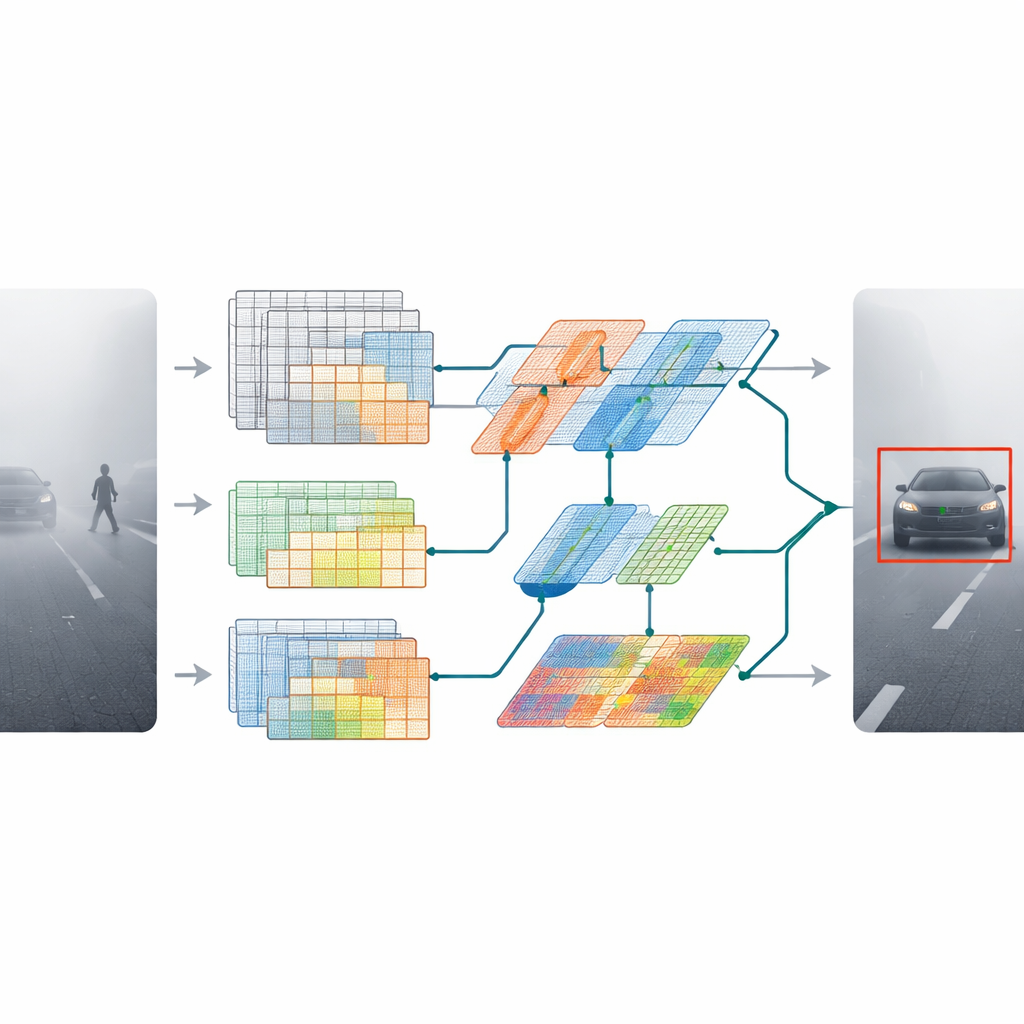

MDAT‑YOLO begint met een compacte versie van een populaire detector en herontwerpt de interne bouwstenen zodat het zich kan aanpassen aan moeilijke scènes in plaats van elke afbeelding op dezelfde starre manier te behandelen. Het kernidee is het model in staat te stellen ter plekke te beslissen waar het zijn aandacht op richt in een beeld en hoe het verschillende typen visuele patronen verwerkt. Twee nieuwe componenten sturen dit gedrag. Een geoptimaliseerde depthwise-convolutielaag vormt de informatiestroom tussen kleurkanalen om, waardoor het netwerk lichter maar expressiever wordt. Een tweede module, omni‑dimensionale dynamische convolutie genoemd, past zijn filters aan niet alleen over de ruimtelijke dimensie, maar ook over verschillende featurekanalen en alternatieve filtersets. Samen stellen ze het model in staat verschillend te reageren op dikke mist, felle schittering of ruisende regendruppels zonder te vertragen.

Globale context toevoegen zonder te vertragen

Buiten het verscherpen van lokale details geeft het artikel het model ook een beter beeld van de hele scène. Ze introduceren een lichtgewicht transformerblok—veelal gebruikt in taalmodellen—dat leert langeafstandsrelaties in het beeld vast te leggen. In plaats van overal een grote, dure transformer toe te passen, vlechten ze een afgeslankte versie in in belangrijke fasen van het netwerk. Dit helpt de detector te begrijpen dat een vaag silhouet in de verte waarschijnlijk een auto op de weg is en geen willekeurige ruis, en dat kleine clusters pixels kunnen behoren tot een voetganger die deels verborgen is door mist of regen.

Het model testen onder zware weersomstandigheden

Om te beoordelen of deze ontwerpwijzigingen daadwerkelijk helpen, testten de onderzoekers MDAT‑YOLO op verschillende veeleisende beeldverzamelingen. Deze omvatten een real‑world set met mist, nevel en regen; een set bij weinig licht ’s nachts; een nieuw gemaakte mistige versie van een bekend benchmark; en een echte regenscène‑set. Over al deze datasets detecteerde het nieuwe model auto’s, bussen, motoren, fietsen en mensen nauwkeuriger dan veel recente YOLO‑varianten en andere geavanceerde methoden. Het was bijzonder sterk in het vinden van voertuigen in dichte mist en mensen in donkere scènes. Even belangrijk: het model behield realtime snelheden en verwerkte op moderne hardware tot ongeveer 145 beelden per seconde—snel genoeg voor gebruik in rijdende voertuigen en bij live verkeersmonitoring.

Wat dit betekent voor dagelijkse veiligheid

Simpel gezegd is MDAT‑YOLO een stap richting camera’s en boordcomputers die betrouwbaar blijven werken wanneer het weer omslaat. Door efficiënte bouwstenen te combineren met flexibele aandacht en globale context kan het systeem ‘‘dieper kijken’’ naar donkere, kleine of deels verborgen objecten zonder log of traag te worden. Hoewel meer tests op bredere, volledig reële datasets nog nodig zijn, suggereren de resultaten dat toekomstige rijhulpsystemen, autonome auto's en wegcamera’s minder weggebruikers zouden kunnen missen in mist, regen en duisternis—waardoor straten veiliger worden, zelfs op de slechtste dagen.

Bronvermelding: Biswas, S., Kumar, J., Mitra, A. et al. Multi-dimensional attention transformer for vehicle and pedestrian detection in adverse weather. Sci Rep 16, 12624 (2026). https://doi.org/10.1038/s41598-026-40319-7

Trefwoorden: autonoom rijden, objectdetectie, slecht weer, computerzicht, verkeersveiligheid