Clear Sky Science · sv

Specialiserade grundmodeller för intelligenta operationssalar

Smartare stöd i operationssalen

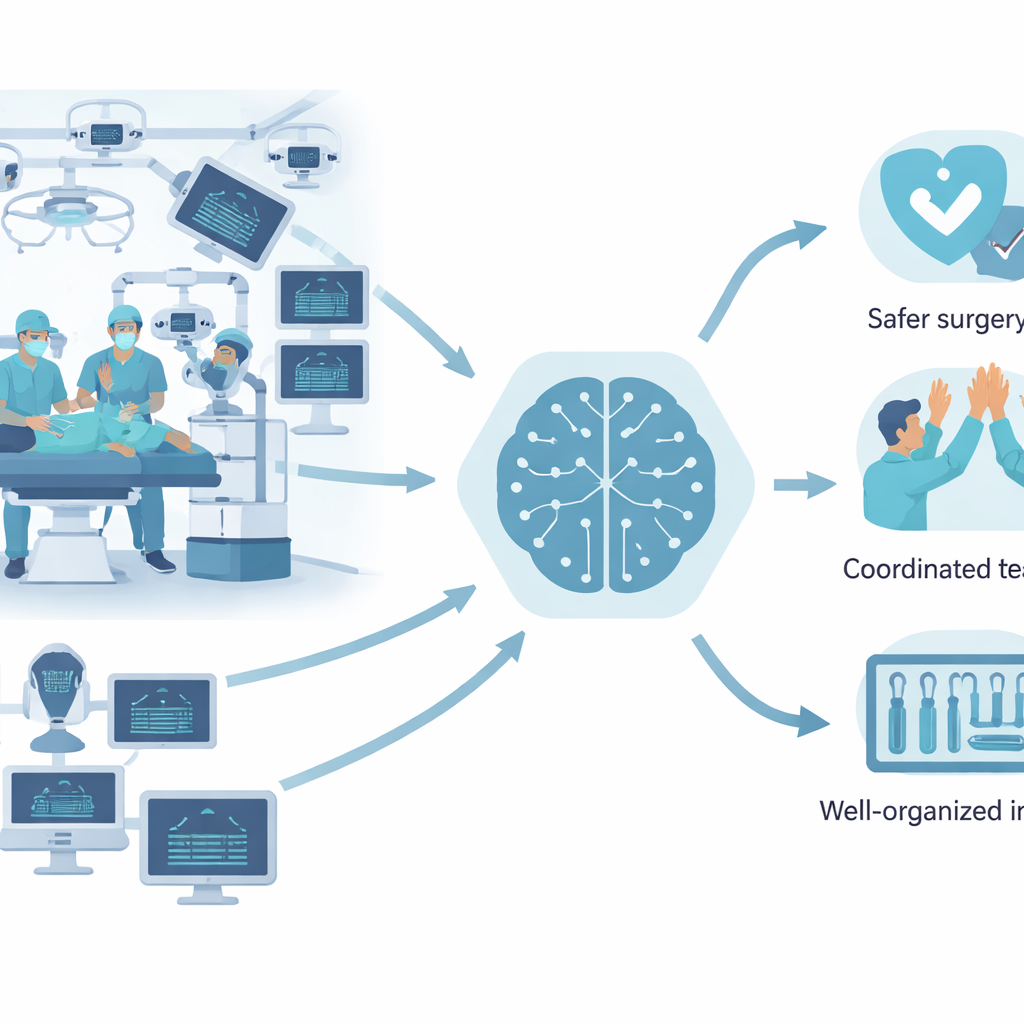

Modern kirurgi äger rum i en tätbefolkad, högteknologisk miljö där människor, robotar, kameror och skärmar måste samarbeta utan fel. Denna artikel presenterar ORQA, en ny typ av artificiell intelligens utvecklad specifikt för operationssalen. Till skillnad från populära chattbotar som huvudsakligen hanterar ord och enkla bilder, är ORQA byggt för att se, lyssna på och tolka allt som händer under en operation så att det kan stödja teamen, upptäcka risker och i sista hand göra ingreppen säkrare.

Varför dagens AI har svårt i kirurgi

Många av de AI‑verktyg som imponerat på världen har tränats på internetbilder, videor och text. De kan förklara medicinska termer eller beskriva ett vanligt ingrepp, men den visuella världen i en operationssal är mycket annorlunda. Flera kameror visar överlappande vyer, robotarmar rör sig nära människor, instrument är små och blanka, och många händelser sker samtidigt. Allmänna AI‑modeller missar ofta kritiska detaljer: de kan se att en kirurg är närvarande men inte lokalisera ett specifikt verktyg, förutsäga nästa steg för en robot eller känna igen när sterila områden kränks. När författarna testade ledande syn‑och‑språk‑system, inklusive kommersiella modeller och en stark öppen källkodsmodell, var deras resultat på kirurgiska uppgifter bara marginellt bättre än att gissa baserat på det vanligaste svaret.

Att omvandla kirurgiska arbetsflöden till frågor och svar

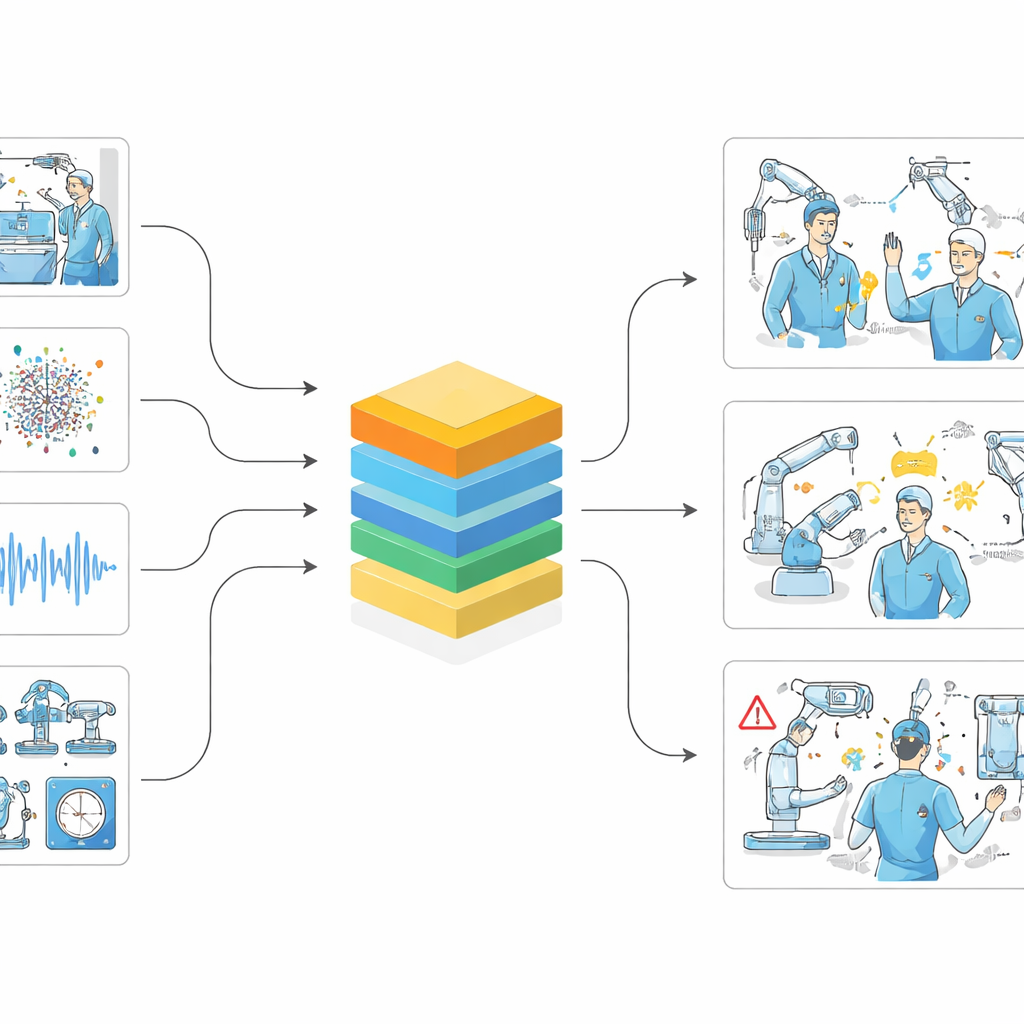

För att systematiskt mäta och förbättra maskinens förståelse för kirurgi skapade forskarna ORQA‑benchmarken. De kombinerade fyra rika datamängder från verkliga och simulerade operationssalar som innehåller externa kameravyer, kirurgsmonterad video, 3D‑scenrekonstruktioner, ljud, robotloggar med mera. Från dessa källor genererade de över 100 miljoner fråga‑och‑svar‑par om vad som händer i salen. Dessa frågor täcker 23 uppgiftstyper, såsom hur många personer som är närvarande, vilka verktyg som används, vilken handling som pågår, var ett verktyg är beläget i 3D‑rum, om ett sterilitetsbrott sker och vad nästa robotssteg blir. Genom att reducera denna stora mängd till en miljon mångsidiga exempel för träning och separata uppsättningar för testning skapade de en gemensam måttstock för varje AI‑modell som påstår sig förstå kirurgi.

En grundmodell byggd för operationssalen

Med denna benchmark tränade teamet ORQA, en specialiserad grundmodell som smälter samman många informationsströmmar från kirurgin. Separata kodare hanterar videoramar, 3D‑punktmoln, ljud, taltranskriptioner, robottelemetri och spårningsdata och omvandlar dem till en gemensam numerisk representation. En stor språkmodell resonerar sedan över denna kombinerade signal för att svara på frågor om scenen. På ORQA‑benchmarken mer än fördubblar detta domänanpassade system prestandan jämfört med generella modeller, och det gör det över ett brett spektrum av uppgifter — att känna igen handlingar, lokalisera instrument, resonera om avstånd och roller samt kontrollera säkerhetsrelaterade tillstånd. Modellen kan till och med utökas med minnesstrukturer som håller reda på hur operationen utvecklats över tid, vilket antyder framtida förbättringar genom rikare temporal modellering.

Göra kirurgisk AI snabb och praktisk

Kraftfulla modeller är ofta för stora för realtidsanvändning inne på sjukhus, där datorer kan vara små och nätverkskopplingar till fjärrservrar är begränsade av sekretesskäl. För att hantera detta använde författarna en process kallad destillation, där en stor ”lärare” tränar mindre ”student”‑versioner. De tog fram tre kompakta ORQA‑varianter som kör flera gånger snabbare samtidigt som de bevarar större delen av originalets noggrannhet. Dessa lättare modeller kan köras lokalt på ett enda grafikkort eller en kant‑enhet, vilket möjliggör övervakning av flera stationer i en operationssal samtidigt och undviker behovet av att strömma känsliga patientdata till molnet. De strukturerade, spårbara utdata — såsom listor över personer, verktyg och deras interaktioner — gör det också enklare för kliniker att granska, revidera och lita på systemets beteende.

Vad detta betyder för framtidens kirurgi

Enkelt uttryckt visar studien att kirurgi behöver sin egen typ av AI, tränad direkt på synintryck och ljud från verkliga ingrepp snarare än på allmänt webbmaterial. ORQA visar att när en modell exponeras för rätt multimodala kirurgiska data kan den pålitligt följa vem som gör vad, var verktyg finns, hur proceduren fortskrider och om något osäkert kan ske. Även om mycket arbete återstår innan sådana system kan vägleda operationer direkt, erbjuder ORQA och dess benchmark en grund för smartare assistenter, bättre dokumentation och så småningom mer autonoma och koordinerade operationssalar.

Citering: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Nyckelord: kirurgisk AI, operationssal, multimodala modeller, medicinsk robotik, patientsäkerhet