Clear Sky Science · pt

Modelos fundacionais especializados para salas de cirurgia inteligentes

Ajuda mais inteligente na sala de cirurgia

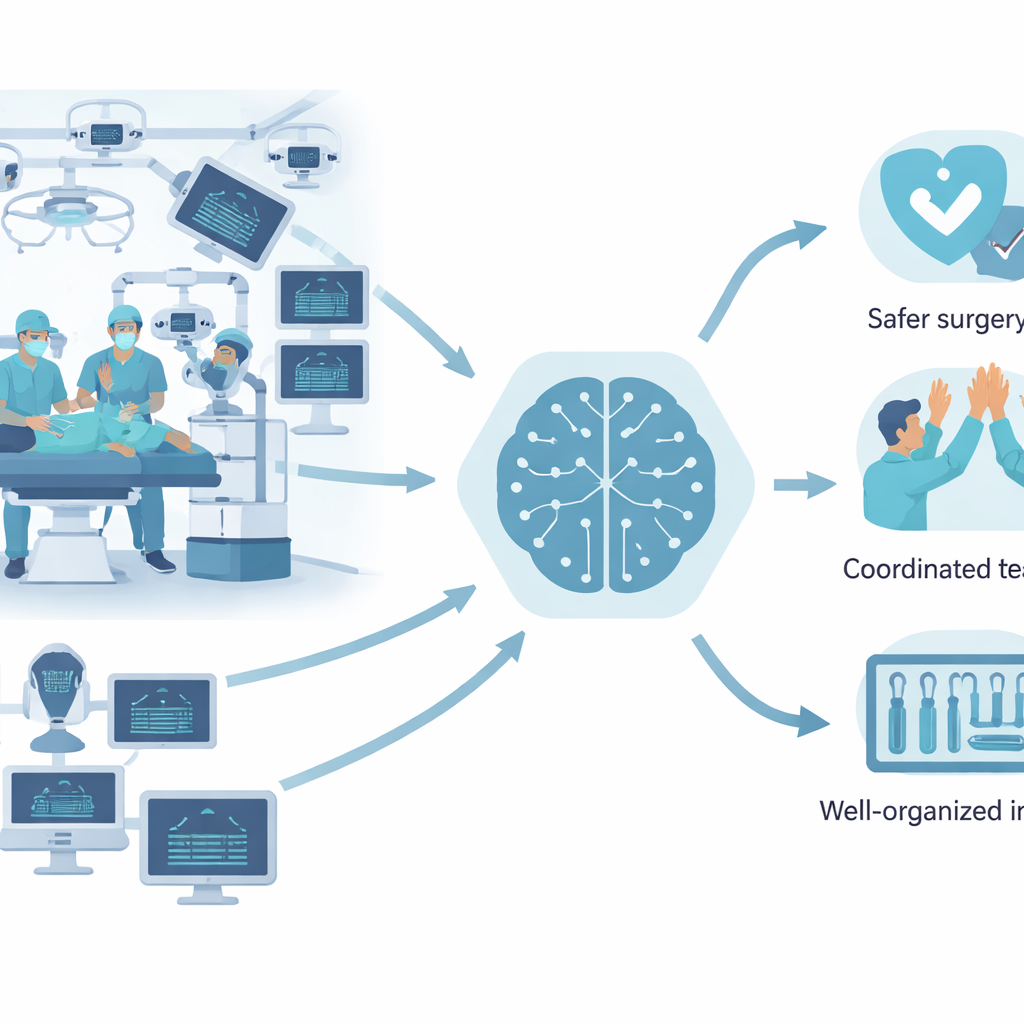

A cirurgia moderna ocorre em um espaço lotado e de alta tecnologia onde pessoas, robôs, câmeras e monitores precisam trabalhar juntos sem erros. Este artigo apresenta o ORQA, um novo tipo de inteligência artificial projetada especificamente para a sala de cirurgia. Ao contrário dos chatbots populares que lidam principalmente com palavras e imagens simples, o ORQA foi construído para observar, ouvir e interpretar tudo o que acontece durante uma operação, de modo a apoiar as equipes, identificar riscos e, em última instância, tornar as cirurgias mais seguras.

Por que a IA atual tem dificuldades na cirurgia

Muitas das ferramentas de IA que impressionaram o mundo foram treinadas com imagens, vídeos e textos da internet. Elas podem explicar termos médicos ou descrever uma operação comum, mas o mundo visual de uma sala de cirurgia é muito diferente. Múltiplas câmeras mostram visões sobrepostas, braços robóticos se movem perto de pessoas, instrumentos são pequenos e brilhantes, e muitos eventos ocorrem ao mesmo tempo. Modelos de propósito geral frequentemente perdem detalhes críticos: podem detectar que um cirurgião está presente, mas não localizar um instrumento específico, prever o próximo passo de um robô ou reconhecer quando áreas estéreis estão sendo violadas. Quando os autores testaram sistemas líderes de visão e linguagem, incluindo modelos comerciais e um forte modelo de código aberto, o desempenho em tarefas cirúrgicas foi apenas um pouco melhor do que adivinhar com base na resposta mais comum.

Transformando fluxos de trabalho cirúrgicos em perguntas e respostas

Para medir e melhorar sistematicamente a compreensão de máquinas sobre cirurgia, os pesquisadores criaram o benchmark ORQA. Eles combinaram quatro conjuntos de dados ricos de salas de cirurgia reais e simuladas que incluem vistas de câmeras externas, vídeo montado no cirurgião, reconstruções 3D da cena, áudio, registros de robôs e mais. A partir dessas fontes geraram mais de 100 milhões de pares de pergunta e resposta sobre o que está acontecendo na sala. Essas perguntas cobrem 23 tipos de tarefa, como quantas pessoas estão presentes, quais ferramentas estão em uso, qual ação está em andamento, onde um instrumento está localizado no espaço 3D, se há uma violação de esterilidade ocorrendo e qual será o próximo passo do robô. Ao reduzir esse grande conjunto para um milhão de exemplos diversos para treinamento e conjuntos separados para teste, eles criaram uma régua comum para qualquer modelo de IA que alegue entender cirurgia.

Um modelo fundacional construído para a sala de cirurgia

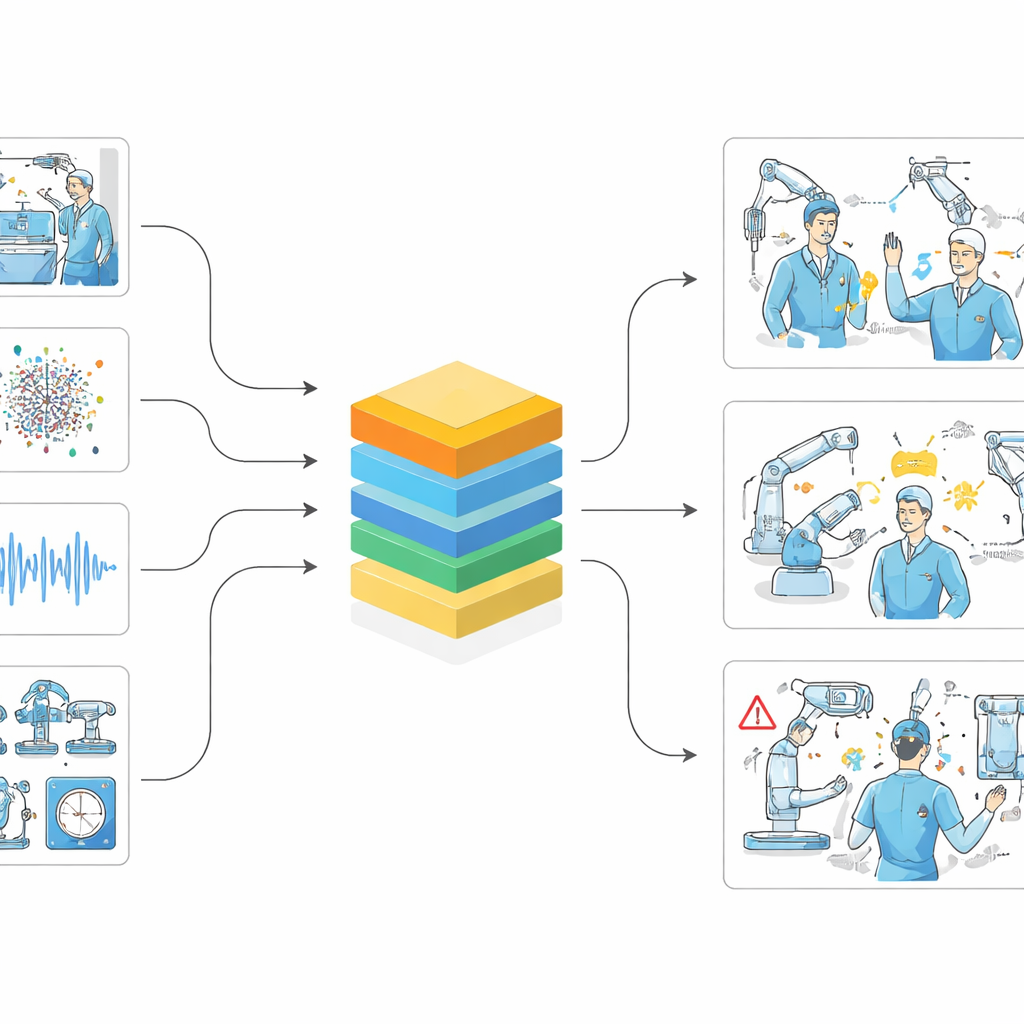

Usando esse benchmark, a equipe treinou o ORQA, um modelo fundacional especializado que funde múltiplos fluxos de dados cirúrgicos. Codificadores separados processam quadros de vídeo, nuvens de pontos 3D, som, transcrições de fala, telemetria do robô e dados de rastreamento, transformando-os em uma representação numérica compartilhada. Um grande modelo de linguagem então raciocina sobre esse sinal combinado para responder perguntas sobre a cena. No benchmark ORQA, esse sistema afinado para o domínio mais que dobra o desempenho dos modelos gerais, e faz isso em uma ampla variedade de tarefas — reconhecer ações, localizar instrumentos, raciocinar sobre distâncias e papéis e verificar condições relacionadas à segurança. O modelo pode até ser estendido com estruturas de memória que acompanham como a operação evoluiu ao longo do tempo, apontando para ganhos futuros com modelagem temporal mais rica.

Tornando a IA cirúrgica rápida e prática

Modelos poderosos costumam ser grandes demais para uso em tempo real dentro de hospitais, onde os computadores podem ser modestos e conexões de rede com servidores remotos são restringidas por motivos de privacidade. Para resolver isso, os autores usaram um processo chamado destilação, no qual um grande modelo “professor” treina versões menores “alunas”. Eles produziram três variantes compactas do ORQA que rodam várias vezes mais rápido preservando a maior parte da precisão original. Esses modelos mais leves podem operar localmente em uma única placa gráfica ou dispositivo de borda, permitindo monitorar várias estações em uma sala de cirurgia ao mesmo tempo e evitando a necessidade de transmitir dados sensíveis de pacientes para a nuvem. As saídas estruturadas e rastreáveis — como listas de pessoas, instrumentos e suas interações — também facilitam que os clínicos inspecionem, auditem e confiem no comportamento do sistema.

O que isso significa para a cirurgia futura

Em termos simples, o estudo mostra que a cirurgia precisa de seu próprio tipo de IA, treinada diretamente nas imagens e sons de operações reais em vez de conteúdo geral da web. O ORQA demonstra que, quando um modelo é exposto aos dados cirúrgicos multimodais certos, ele pode acompanhar de forma confiável quem faz o quê, onde estão os instrumentos, como o procedimento está progredindo e se algo potencialmente inseguro pode estar ocorrendo. Embora muito trabalho ainda seja necessário antes que tais sistemas possam orientar cirurgias diretamente, o ORQA e seu benchmark fornecem uma base para assistentes mais inteligentes, melhor documentação e, eventualmente, salas de cirurgia mais autônomas e coordenadas.

Citação: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Palavras-chave: IA cirúrgica, sala de cirurgia, modelos multimodais, robótica médica, segurança do paciente