Clear Sky Science · nl

Gespecialiseerde foundation-modellen voor intelligente operatiekamers

Slimmere hulp in de operatiekamer

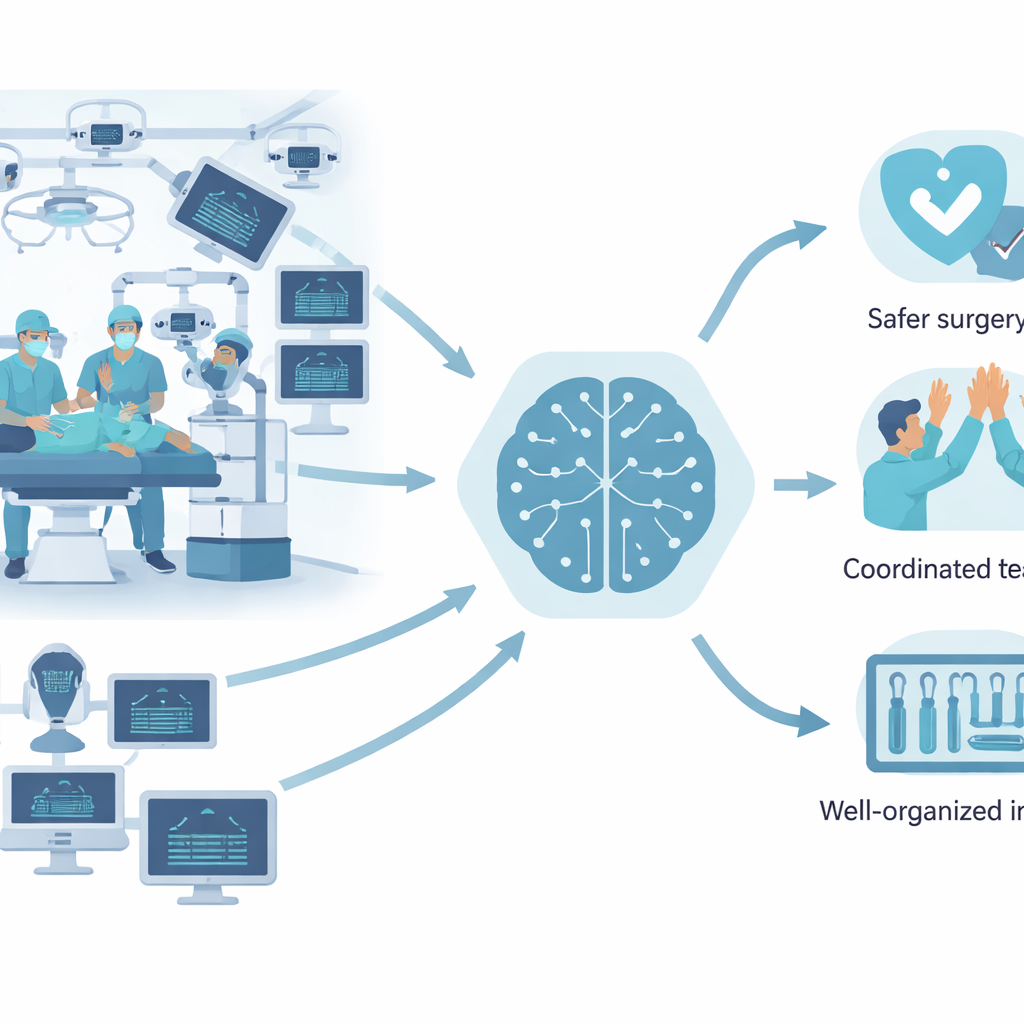

Moderne chirurgie vindt plaats in een drukke, hoogtechnologische omgeving waar mensen, robots, camera’s en beeldschermen zonder fouten moeten samenwerken. Dit artikel presenteert ORQA, een nieuw type kunstmatige intelligentie dat specifiek is ontworpen voor de operatiekamer. In tegenstelling tot populaire chatbots die vooral met tekst en eenvoudige afbeeldingen omgaan, is ORQA gebouwd om te kijken, te luisteren en alles wat er tijdens een operatie gebeurt te interpreteren, zodat het teams kan ondersteunen, gevaren kan signaleren en uiteindelijk operaties veiliger kan maken.

Waarom huidige AI het moeilijk heeft in de chirurgie

Veel van de AI-tools die de wereld hebben onder de indruk gebracht, zijn getraind op internetafbeeldingen, video’s en tekst. Ze kunnen medische termen uitleggen of een gewone ingreep beschrijven, maar de visuele wereld van een operatiekamer is heel anders. Meerdere camera’s tonen overlappende beelden, robotarmen bewegen dicht bij mensen, instrumenten zijn klein en glanzend, en veel gebeurtenissen vinden gelijktijdig plaats. Algemeen bruikbare AI-modellen missen vaak kritieke details: ze zien misschien dat een chirurg aanwezig is maar weten geen specifiek instrument te lokaliseren, voorspellen niet de volgende stap van een robot, of herkennen niet wanneer steriele zones worden geschonden. Toen de auteurs toonaangevende vision-language-systemen testten, inclusief commerciële modellen en een sterk open-source model, was hun prestatie op chirurgische taken slechts iets beter dan raden op basis van het meest voorkomende antwoord.

Chirurgische workflows omzetten in vragen en antwoorden

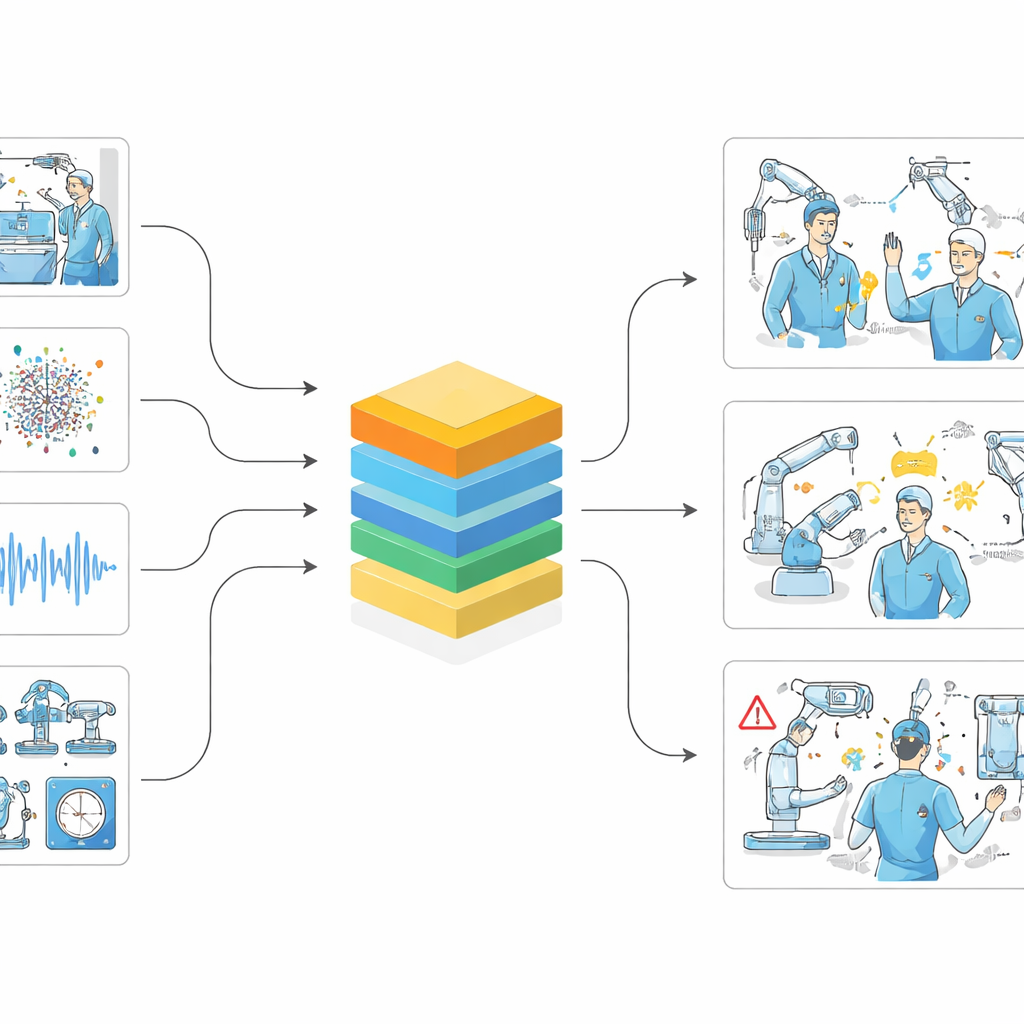

Om de machinebegrip van chirurgie systematisch te meten en te verbeteren, creëerden de onderzoekers de ORQA-benchmark. Ze combineerden vier rijke datasets van echte en gesimuleerde operatiekamers die externe camerabeelden, door de chirurg gedragen video, 3D-scène-reconstructies, audio, robotlogs en meer bevatten. Uit deze bronnen genereerden ze meer dan 100 miljoen vraag-en-antwoord-paren over wat er in de ruimte gebeurt. Deze vragen bestrijken 23 taaktypen, zoals hoeveel mensen aanwezig zijn, welke instrumenten worden gebruikt, welke handeling gaande is, waar een instrument zich in 3D bevindt, of er een schending van de sterieliteit plaatsvindt, en wat de volgende robotstap zal zijn. Door deze enorme verzameling terug te brengen tot één miljoen diverse voorbeelden voor training en aparte sets voor testen, creëerden ze een gemeenschappelijke meetlat voor elk AI-model dat beweert chirurgie te begrijpen.

Een foundation-model gebouwd voor de operatiekamer

Met behulp van deze benchmark trainde het team ORQA, een gespecialiseerd foundation-model dat vele stromen chirurgische data samenvoegt. Afzonderlijke encoders verwerken videoframes, 3D-puntenwolken, geluid, transcripties van spraak, robottelemetrie en trackingdata en zetten die om in een gedeelde numerieke representatie. Een groot taalmodel redeneert vervolgens over dit gecombineerde signaal om vragen over de scène te beantwoorden. Op de ORQA-benchmark verdubbelt dit domeinspecifieke systeem de prestaties van algemene modellen en doet dat over een breed scala aan taken—het herkennen van handelingen, het lokaliseren van instrumenten, redeneren over afstanden en rollen, en het controleren van veiligheidsgerelateerde condities. Het model valt zelfs uit te breiden met geheugenstructuren die bijhouden hoe de operatie in de loop van de tijd is verlopen, wat wijst op toekomstige winst door rijkere temporele modellering.

Chirurgische AI snel en praktisch maken

Krachtige modellen zijn vaak te groot voor realtime gebruik binnen ziekenhuizen, waar computers klein kunnen zijn en netwerkverbindingen met externe servers om privacyredenen beperkt zijn. Om dit aan te pakken, gebruikten de auteurs een proces dat distillatie heet, waarbij een groot “teacher”-model kleinere “student”-versies traint. Ze produceerden drie compacte ORQA-varianten die meerdere keren sneller draaien terwijl ze het grootste deel van de oorspronkelijke nauwkeurigheid behouden. Deze lichtere modellen kunnen lokaal draaien op een enkele grafische kaart of edge-apparaat, waardoor meerdere posities in een operatiekamer tegelijk kunnen worden gemonitord en het streamen van gevoelige patiëntgegevens naar de cloud wordt vermeden. De gestructureerde, traceerbare outputs—zoals lijsten met mensen, instrumenten en hun interacties—maken het ook gemakkelijker voor clinici om het gedrag van het systeem te controleren, te auditen en te vertrouwen.

Wat dit betekent voor de chirurgie van de toekomst

Kort gezegd laat de studie zien dat chirurgie zijn eigen soort AI nodig heeft, direct getraind op de beelden en geluiden van echte operaties in plaats van op algemene webinhoud. ORQA toont aan dat wanneer een model wordt blootgesteld aan de juiste multimodale chirurgische data, het betrouwbaar kan bijhouden wie wat doet, waar instrumenten zijn, hoe de procedure vordert en of er iets onveiligs kan gebeuren. Hoewel er nog veel werk nodig is voordat dergelijke systemen direct bij de chirurgie kunnen sturen, bieden ORQA en de benchmark een basis voor slimere assistenten, betere documentatie en uiteindelijk meer autonome en gecoördineerde operatiekamers.

Bronvermelding: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Trefwoorden: chirurgische AI, operatiekamer, multimodale modellen, medische robotica, patiëntveiligheid