Clear Sky Science · it

Modelli fondamentali specializzati per sale operatorie intelligenti

Assistenza più intelligente in sala operatoria

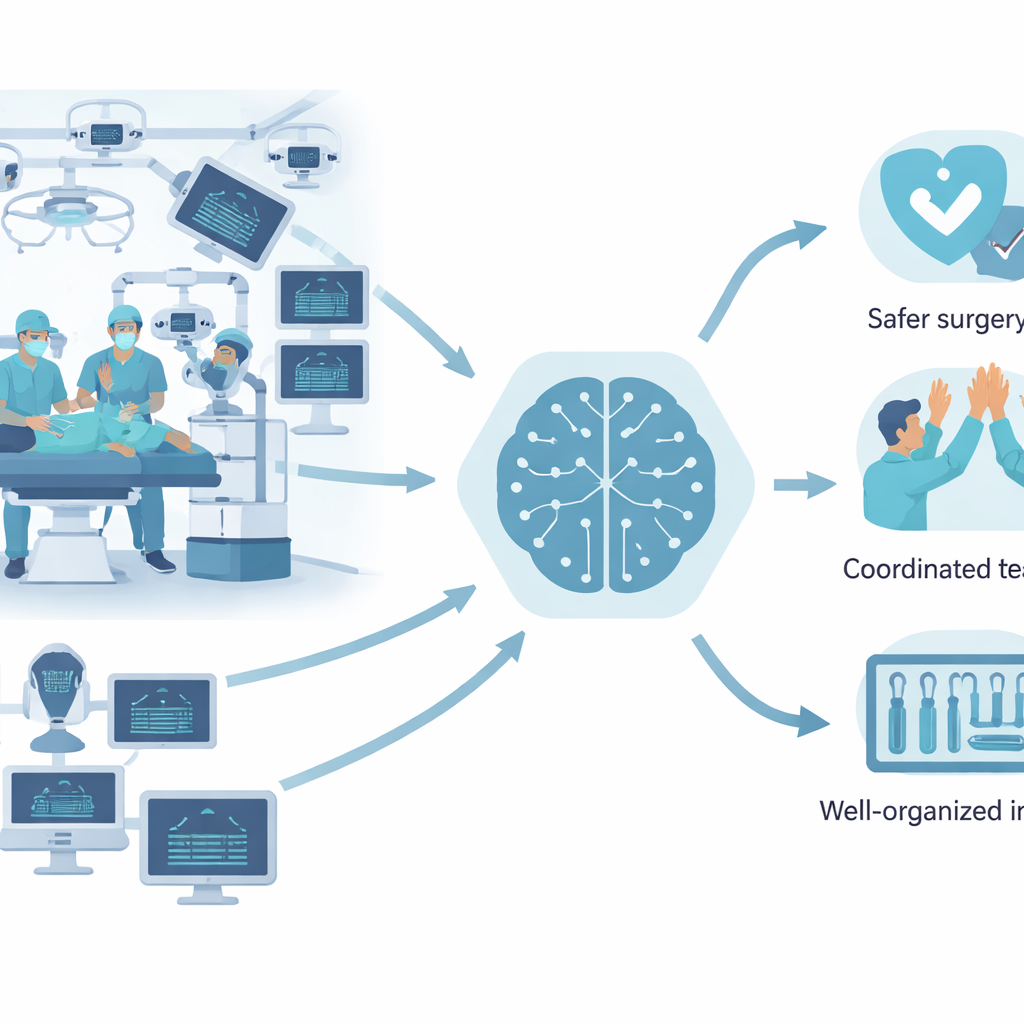

La chirurgia moderna si svolge in uno spazio affollato e ad alta tecnologia dove persone, robot, telecamere e monitor devono collaborare senza errori. Questo articolo presenta ORQA, una nuova forma di intelligenza artificiale progettata specificamente per la sala operatoria. A differenza dei chatbot popolari che gestiscono principalmente parole e immagini semplici, ORQA è stato costruito per osservare, ascoltare e interpretare tutto ciò che accade durante un intervento chirurgico affinché possa supportare le équipe, individuare rischi e, in ultima istanza, rendere le operazioni più sicure.

Perché l’IA attuale fatica in chirurgia

Molti degli strumenti di IA che hanno impressionato il mondo sono stati addestrati su immagini, video e testi reperiti in rete. Possono spiegare termini medici o descrivere un’operazione comune, ma il mondo visivo di una sala operatoria è molto diverso. Più telecamere mostrano visuali sovrapposte, bracci robotici si muovono vicino alle persone, gli strumenti sono piccoli e lucidi e molti eventi si svolgono contemporaneamente. I modelli di IA di uso generale spesso mancano dettagli critici: possono rilevare la presenza di un chirurgo ma non riuscire a localizzare uno strumento specifico, prevedere la prossima mossa di un robot o riconoscere quando vengono violate aree sterili. Quando gli autori hanno testato i principali sistemi vision‑language, compresi modelli commerciali e un forte modello open‑source, le loro prestazioni sui compiti chirurgici erano solo leggermente superiori al caso di rispondere con la risposta più frequente.

Trasformare i flussi di lavoro chirurgici in domande e risposte

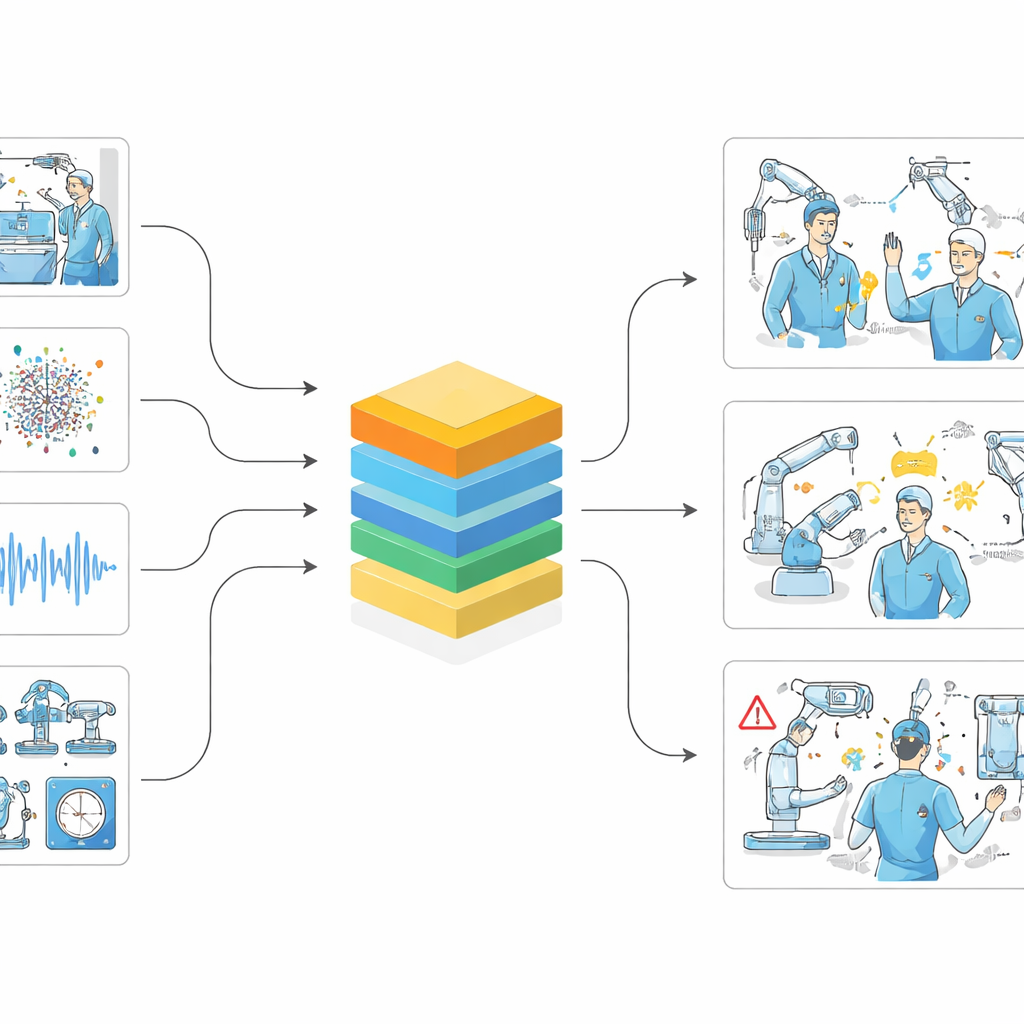

Per misurare e migliorare in modo sistematico la comprensione chirurgica da parte delle macchine, i ricercatori hanno creato il benchmark ORQA. Hanno combinato quattro dataset ricchi di sale operatorie reali e simulate che includono viste da telecamere esterne, video montati sul chirurgo, ricostruzioni 3D della scena, audio, registri del robot e altro ancora. Da queste sorgenti hanno generato oltre 100 milioni di coppie domanda‑risposta su ciò che accade nella stanza. Queste domande coprono 23 tipi di compiti, come quante persone sono presenti, quali strumenti sono in uso, quale azione è in corso, dove si trova uno strumento nello spazio 3D, se si sta verificando una violazione di sterilità e quale sarà il prossimo passo del robot. Riducendo questo enorme insieme a un milione di esempi diversi per l’addestramento e set separati per il test, hanno creato un metro comune per qualsiasi modello di IA che dichiari di capire la chirurgia.

Un modello fondamentale costruito per la sala operatoria

Usando questo benchmark, il team ha addestrato ORQA, un modello fondamentale specializzato che fonde molti flussi di dati chirurgici. Encoder separati gestiscono frame video, nuvole di punti 3D, suono, trascrizioni vocali, telemetria del robot e dati di tracciamento, trasformandoli in una rappresentazione numerica condivisa. Un grande modello linguistico quindi ragiona su questo segnale combinato per rispondere a domande sulla scena. Sul benchmark ORQA, questo sistema adattato al dominio raddoppia più che le prestazioni dei modelli generici, e lo fa su un’ampia gamma di compiti—riconoscere azioni, localizzare strumenti, ragionare su distanze e ruoli e verificare condizioni legate alla sicurezza. Il modello può persino essere esteso con strutture di memoria che tengono traccia di come l’intervento si è svolto nel tempo, suggerendo futuri miglioramenti da modelli temporali più ricchi.

Rendere l’IA chirurgica veloce e pratica

I modelli potenti sono spesso troppo grandi per l’uso in tempo reale negli ospedali, dove i calcolatori possono essere ridotti e le connessioni di rete verso server remoti sono limitate per motivi di privacy. Per affrontare questo problema, gli autori hanno usato un processo chiamato distillazione, in cui un grande modello “insegnante” allena versioni più piccole “studente”. Hanno prodotto tre varianti compatte di ORQA che girano diverse volte più velocemente pur preservando la maggior parte dell’accuratezza originale. Questi modelli più leggeri possono funzionare localmente su una singola GPU o su dispositivi edge, permettendo di monitorare contemporaneamente più postazioni in una sala operatoria ed evitando la necessità di trasmettere dati sensibili dei pazienti al cloud. Le uscite strutturate e tracciabili—come elenchi di persone, strumenti e loro interazioni—rendono inoltre più semplice per i clinici ispezionare, verificare e fidarsi del comportamento del sistema.

Cosa significa questo per la chirurgia futura

In termini semplici, lo studio dimostra che la chirurgia ha bisogno di un proprio tipo di IA, addestrata direttamente sulle immagini e i suoni delle operazioni reali piuttosto che su contenuti generici del web. ORQA dimostra che quando un modello è esposto ai dati multimodali chirurgici appropriati, può tracciare in modo affidabile chi sta facendo cosa, dove si trovano gli strumenti, come procede la procedura e se qualcosa di pericoloso potrebbe star accadendo. Sebbene rimanga molto lavoro prima che tali sistemi possano guidare direttamente gli interventi, ORQA e il suo benchmark forniscono una base per assistenti più intelligenti, una migliore documentazione e, infine, sale operatorie più autonome e coordinate.

Citazione: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Parole chiave: IA chirurgica, sala operatoria, modelli multimodali, robotica medica, sicurezza del paziente