Clear Sky Science · es

Modelos fundamentales especializados para quirófanos inteligentes

Ayuda más inteligente en el quirófano

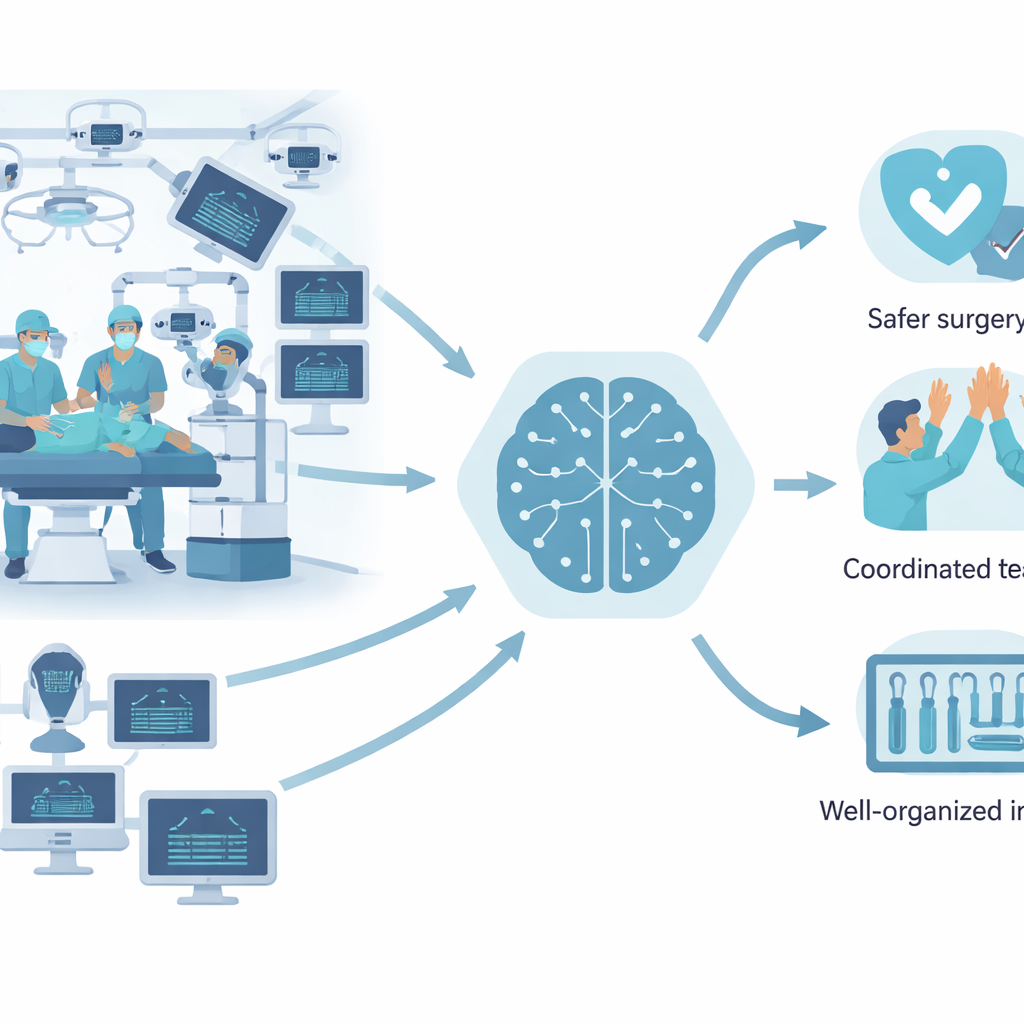

La cirugía moderna se desarrolla en un espacio concurrido y de alta tecnología donde personas, robots, cámaras y monitores deben colaborar sin errores. Este artículo presenta ORQA, un nuevo tipo de inteligencia artificial diseñada específicamente para el quirófano. A diferencia de los chatbots populares que manejan principalmente palabras y imágenes sencillas, ORQA está concebida para observar, escuchar e interpretar todo lo que ocurre durante una operación, de modo que pueda apoyar a los equipos, detectar riesgos y, en última instancia, aumentar la seguridad de las intervenciones.

Por qué la IA actual tiene dificultades en cirugía

Muchas de las herramientas de IA que han impresionado al mundo se entrenaron con imágenes, vídeos y textos de internet. Pueden explicar términos médicos o describir una operación común, pero el mundo visual de un quirófano es muy distinto. Varias cámaras ofrecen vistas superpuestas, brazos robóticos se mueven cerca de las personas, las herramientas son pequeñas y brillantes, y muchos sucesos ocurren simultáneamente. Los modelos de uso general suelen pasar por alto detalles críticos: pueden detectar que hay un cirujano presente pero no localizar una herramienta concreta, predecir el siguiente movimiento de un robot o reconocer cuándo se están violando zonas estériles. Cuando los autores probaron sistemas líderes de visión‑lenguaje, incluidos modelos comerciales y un sólido modelo de código abierto, su rendimiento en tareas quirúrgicas fue apenas superior a adivinar la respuesta más frecuente.

Convertir los flujos de trabajo quirúrgicos en preguntas y respuestas

Para medir y mejorar de forma sistemática la comprensión automática de la cirugía, los investigadores crearon el benchmark ORQA. Combinaron cuatro conjuntos de datos ricos de quirófanos reales y simulados que incluyen vistas de cámaras externas, video montado en el cirujano, reconstrucciones tridimensionales de la escena, audio, registros de robots y más. A partir de estas fuentes generaron más de 100 millones de pares de preguntas y respuestas sobre lo que sucede en la sala. Estas preguntas cubren 23 tipos de tarea, como cuántas personas están presentes, qué instrumentos se están usando, qué acción se está realizando, dónde se encuentra una herramienta en el espacio 3D, si hay una brecha de esterilidad y cuál será el siguiente paso del robot. Al reducir este enorme conjunto a un millón de ejemplos diversos para entrenamiento y conjuntos separados para evaluación, crearon una medida común para cualquier modelo de IA que afirme comprender la cirugía.

Un modelo fundamental construido para el quirófano

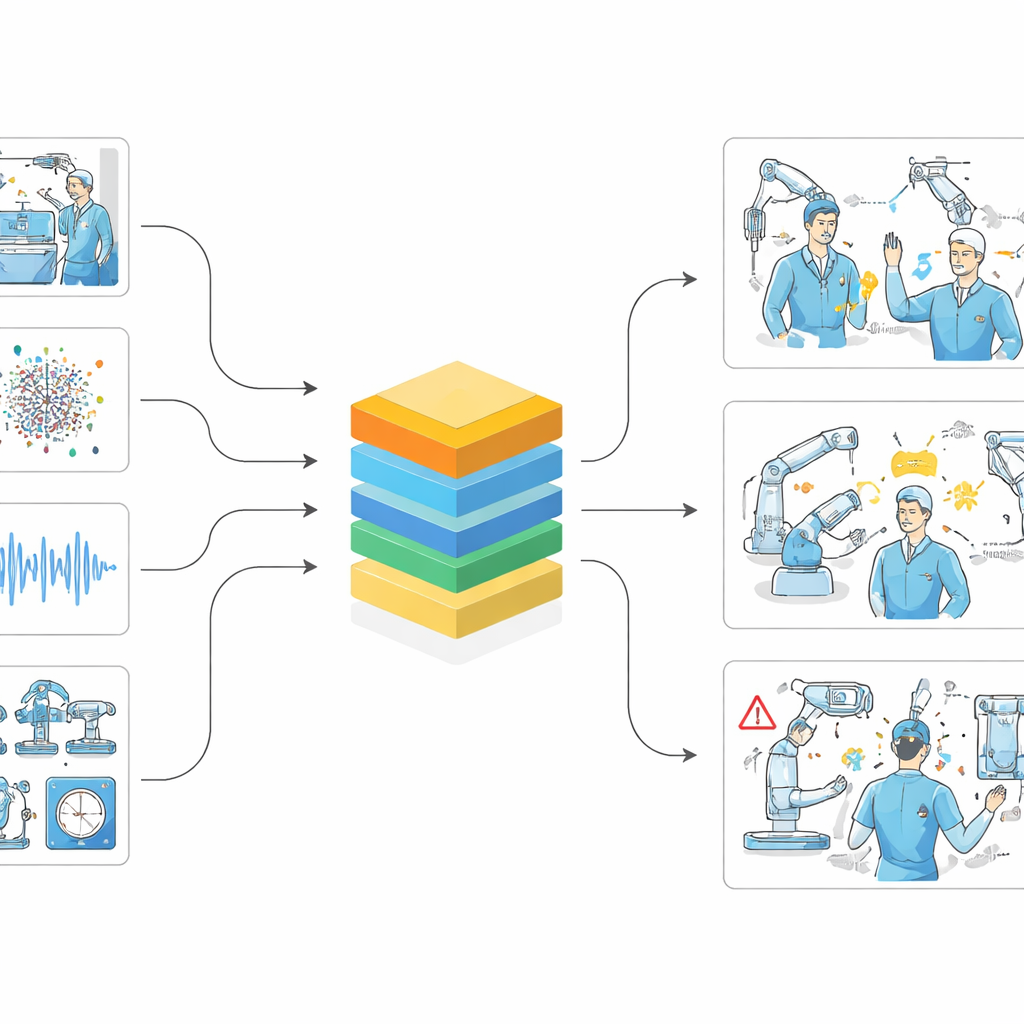

Usando este benchmark, el equipo entrenó ORQA, un modelo fundamental especializado que fusiona múltiples flujos de datos quirúrgicos. Codificadores separados procesan fotogramas de vídeo, nubes de puntos 3D, sonido, transcripciones de voz, telemetría de robots y datos de seguimiento, convirtiéndolos en una representación numérica compartida. Un gran modelo de lenguaje razona sobre esta señal combinada para responder preguntas sobre la escena. En el benchmark ORQA, este sistema afinado para el dominio más que duplica el rendimiento de los modelos generales, y lo hace en una amplia gama de tareas: reconocer acciones, localizar instrumentos, razonar sobre distancias y roles y comprobar condiciones relacionadas con la seguridad. El modelo incluso puede ampliarse con estructuras de memoria que registran cómo se ha desarrollado la operación a lo largo del tiempo, lo que sugiere futuras mejoras mediante un modelado temporal más rico.

Hacer la IA quirúrgica rápida y práctica

Los modelos potentes suelen ser demasiado grandes para su uso en tiempo real dentro de los hospitales, donde los equipos pueden ser modestos y las conexiones de red a servidores remotos están restringidas por motivos de privacidad. Para afrontarlo, los autores emplearon un proceso llamado destilación, en el que un gran modelo “profesor” entrena versiones más pequeñas “alumno”. Obtuvieron tres variantes compactas de ORQA que funcionan varias veces más rápido a la vez que conservan la mayor parte de la precisión original. Estos modelos ligeros pueden operar localmente en una sola tarjeta gráfica o dispositivo de borde, permitiendo monitorizar varias estaciones en un quirófano a la vez y evitando la necesidad de transmitir datos sensibles de pacientes a la nube. Las salidas estructuradas y trazables —como listas de personas, instrumentos y sus interacciones— también facilitan que los clínicos inspeccionen, auditen y confíen en el comportamiento del sistema.

Qué significa esto para la cirugía futura

En términos sencillos, el estudio demuestra que la cirugía necesita su propio tipo de IA, entrenada directamente con las imágenes y sonidos de operaciones reales en lugar de con contenido web general. ORQA muestra que cuando un modelo se expone a los datos multimodales quirúrgicos adecuados, puede seguir de forma fiable quién hace qué, dónde están las herramientas, cómo progresa el procedimiento y si puede estar ocurriendo algo inseguro. Aunque queda mucho trabajo antes de que tales sistemas puedan guiar directamente una intervención, ORQA y su benchmark proporcionan la base para asistentes más inteligentes, mejor documentación y, eventualmente, quirófanos más autónomos y coordinados.

Cita: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Palabras clave: IA quirúrgica, quirófano, modelos multimodales, robótica médica, seguridad del paciente