Clear Sky Science · pl

Specjalistyczne modele bazowe dla inteligentnych sal operacyjnych

Mądrzejsza pomoc na sali operacyjnej

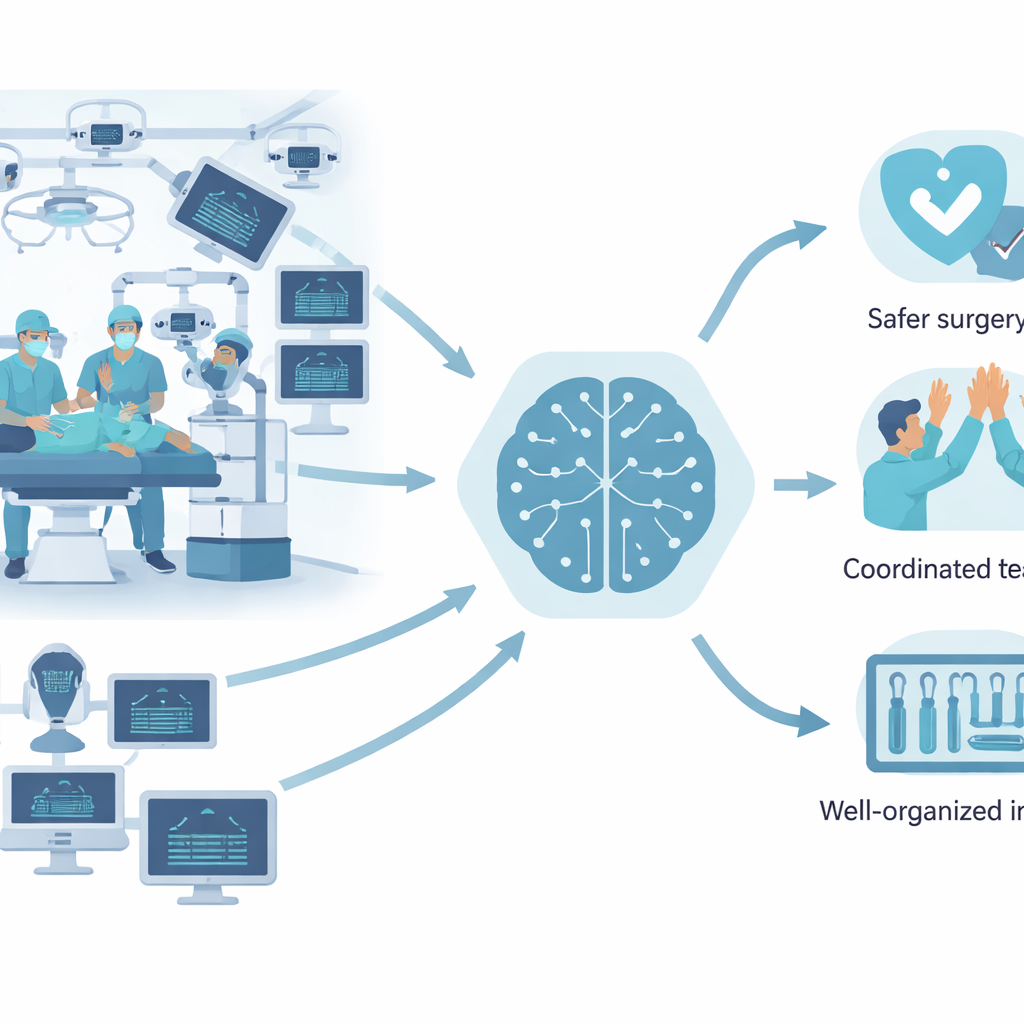

Nowoczesna chirurgia odbywa się w zatłoczonym, wysoko zaawansowanym technologicznie środowisku, gdzie ludzie, roboty, kamery i monitory muszą współpracować bez błędów. W artykule przedstawiono ORQA — nowy rodzaj sztucznej inteligencji zaprojektowany specjalnie dla sali operacyjnej. W przeciwieństwie do popularnych chatbotów, które głównie operują słowem i prostymi obrazami, ORQA został zbudowany tak, by obserwować, słuchać i interpretować wszystko, co dzieje się podczas zabiegu, aby wspierać personel, wykrywać zagrożenia i ostatecznie zwiększać bezpieczeństwo operacji.

Dlaczego dzisiejsze AI ma problemy w chirurgii

Wiele narzędzi AI, które zrobiły wrażenie na świecie, było trenowanych na obrazach, wideo i tekstach z internetu. Potrafią wyjaśniać terminy medyczne lub opisać typowy zabieg, ale wizualny świat sali operacyjnej jest zupełnie inny. Wiele kamer pokazuje nakładające się widoki, ramiona robotów poruszają się w pobliżu ludzi, narzędzia są małe i błyszczące, a wiele zdarzeń rozgrywa się jednocześnie. Modele ogólnego przeznaczenia często pomijają krytyczne szczegóły: mogą wykryć obecność chirurga, ale nie zlokalizować konkretnego narzędzia, przewidzieć kolejnego ruchu robota czy rozpoznać naruszenia stref sterylnych. Gdy autorzy przetestowali wiodące systemy wizja‑język, w tym modele komercyjne i silny model otwartoźródłowy, ich wyniki w zadaniach chirurgicznych były tylko nieznacznie lepsze od losowego wyboru najczęściej występującej odpowiedzi.

Przekształcanie przebiegu zabiegów w pytania i odpowiedzi

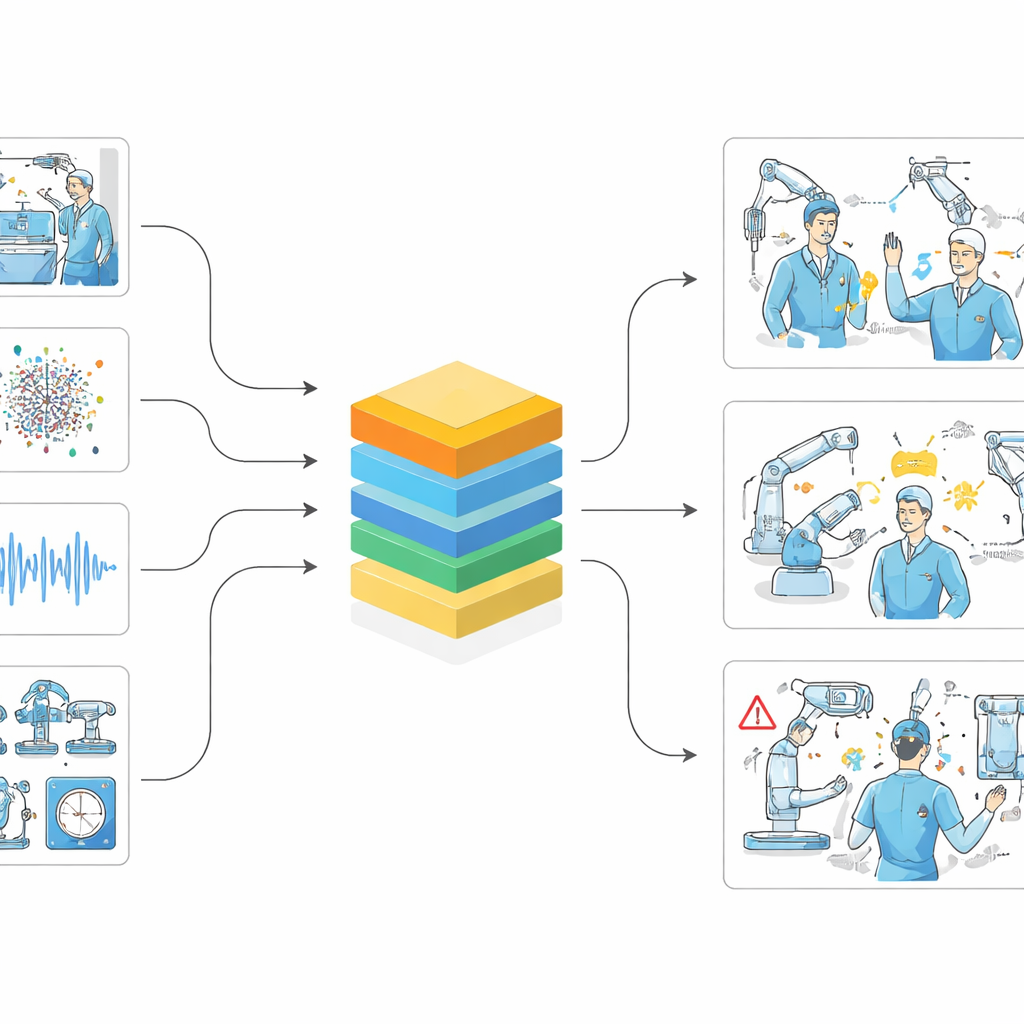

Aby systematycznie mierzyć i poprawiać rozumienie chirurgii przez maszyny, badacze stworzyli benchmark ORQA. Połączyli cztery rozbudowane zbiory danych z rzeczywistych i symulowanych sal operacyjnych, zawierające zewnętrzne ujęcia kamer, wideo z kamer zamontowanych na chirurgach, rekonstrukcje scen 3D, dźwięk, zapisy robotów i inne. Z tych źródeł wygenerowali ponad 100 milionów par pytań i odpowiedzi o tym, co dzieje się w sali. Pytania obejmują 23 typy zadań, takie jak: ile osób jest obecnych, które narzędzia są używane, jaka czynność jest wykonywana, gdzie narzędzie znajduje się w przestrzeni 3D, czy następuje naruszenie sterylności oraz jaki będzie następny krok robota. Redukując tę ogromną pulę do miliona zróżnicowanych przykładów do treningu oraz odrębnych zbiorów testowych, stworzyli wspólną miarę dla każdego modelu AI, który twierdzi, że rozumie chirurgię.

Model bazowy zbudowany dla sali operacyjnej

Korzystając z tego benchmarku, zespół wytrenował ORQA — specjalistyczny model bazowy łączący wiele strumieni danych chirurgicznych. Osobne enkodery przetwarzają klatki wideo, chmury punktów 3D, dźwięk, transkrypcje mowy, telemetrię robota i dane śledzenia, zamieniając je na wspólną reprezentację numeryczną. Następnie duży model językowy rozumuje na podstawie tego skonsolidowanego sygnału, odpowiadając na pytania dotyczące sceny. Na benchmarku ORQA ten dostrojony do domeny system ponad dwukrotnie przewyższa wydajność modeli ogólnych i robi to w szerokim zakresie zadań — rozpoznając działania, lokalizując instrumenty, rozumując o odległościach i rolach oraz sprawdzając warunki związane z bezpieczeństwem. Model można także rozszerzyć o struktury pamięci śledzące przebieg operacji w czasie, co sugeruje dalsze korzyści płynące z bogatszego modelowania temporalnego.

Uczynienie chirurgicznego AI szybszym i praktycznym

Mocne modele bywają zbyt duże do użycia w czasie rzeczywistym w szpitalach, gdzie komputery mogą być ograniczone, a połączenia zdalne do serwerów — ograniczone ze względów prywatności. Aby temu zaradzić, autorzy zastosowali proces zwany destylacją, w którym duży model „nauczyciel” trenuje mniejsze wersje „uczniów”. Uzyskali trzy kompaktowe warianty ORQA, które działają kilkukrotnie szybciej, zachowując większość pierwotnej dokładności. Lżejsze modele mogą pracować lokalnie na jednej karcie graficznej lub urządzeniu brzegowym, umożliwiając jednoczesne monitorowanie kilku stanowisk na sali operacyjnej i unikając potrzeby przesyłania wrażliwych danych pacjenta do chmury. Strukturalne, śledzone wyniki — takie jak listy osób, narzędzi i ich interakcji — ułatwiają także klinicystom kontrolę, audyt i zaufanie do zachowania systemu.

Co to oznacza dla przyszłej chirurgii

Mówiąc prościej, badanie pokazuje, że chirurgia potrzebuje własnego rodzaju AI, trenowanego bezpośrednio na obrazach i dźwiękach prawdziwych zabiegów, a nie na ogólnych treściach z sieci. ORQA demonstruje, że gdy model jest wystawiony na odpowiednie multimodalne dane chirurgiczne, potrafi niezawodnie śledzić, kto co robi, gdzie znajdują się narzędzia, jak przebiega procedura i czy może dziać się coś niebezpiecznego. Choć wciąż wiele pracy przed nami, zanim takie systemy będą mogły bezpośrednio prowadzić zabiegi, ORQA i jego benchmark stanowią fundament pod bardziej inteligentnych asystentów, lepszą dokumentację i ostatecznie bardziej autonomiczne i skoordynowane sale operacyjne.

Cytowanie: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Słowa kluczowe: AI chirurgiczne, sala operacyjna, modele multimodalne, robotyka medyczna, bezpieczeństwo pacjenta