Clear Sky Science · fr

Modèles fondamentaux spécialisés pour des blocs opératoires intelligents

Aide plus intelligente au bloc opératoire

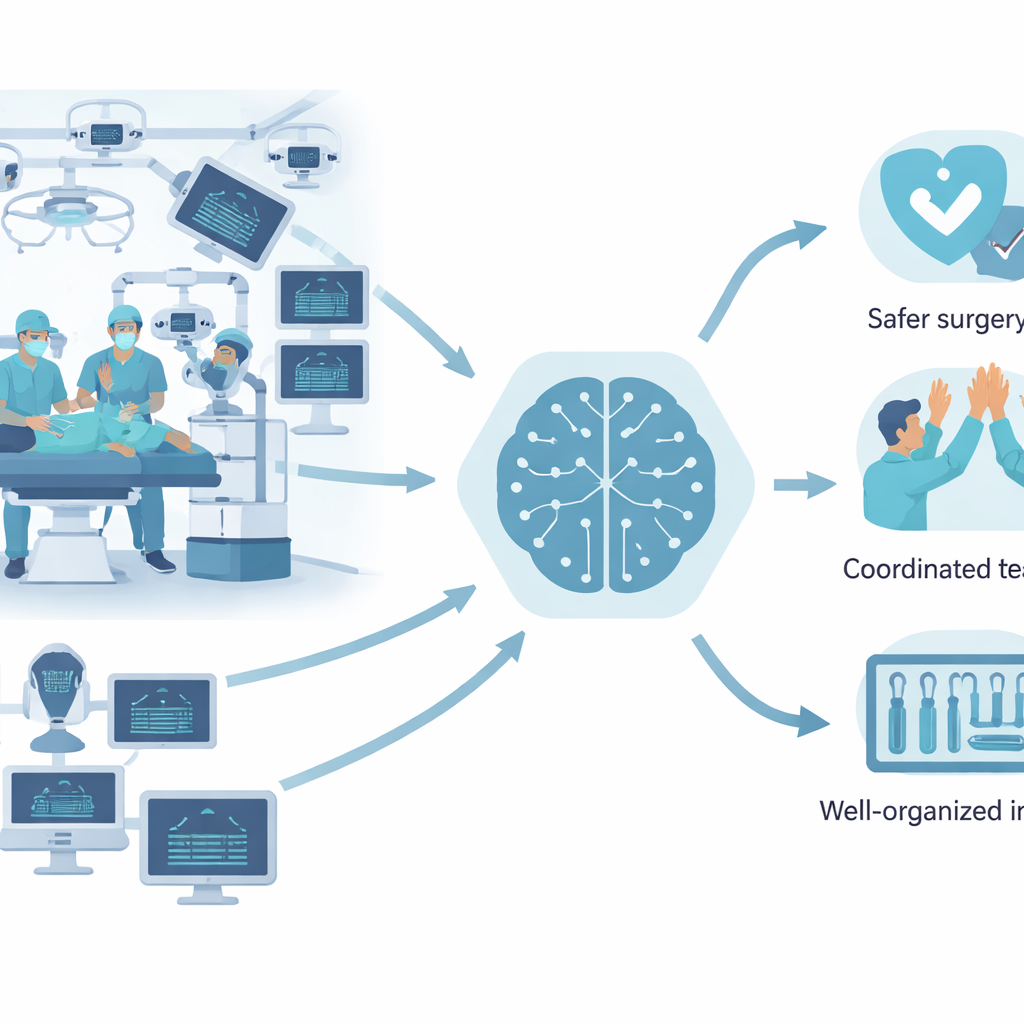

La chirurgie moderne se déroule dans un espace encombré et hautement technologique où personnes, robots, caméras et moniteurs doivent coopérer sans erreur. Cet article présente ORQA, un nouveau type d’intelligence artificielle conçu spécifiquement pour le bloc opératoire. À la différence des chatbots populaires qui traitent surtout des mots et de simples images, ORQA est construit pour observer, écouter et interpréter tout ce qui se passe pendant une opération afin d’aider les équipes, repérer les dangers et, in fine, rendre les interventions plus sûres.

Pourquoi l’IA actuelle peine en chirurgie

Beaucoup d’outils d’IA ayant fait sensation ont été entraînés sur des images, des vidéos et des textes provenant d’internet. Ils peuvent expliquer des termes médicaux ou décrire une opération courante, mais le monde visuel d’un bloc opératoire est très différent. Plusieurs caméras offrent des vues chevauchantes, des bras robotiques se déplacent à proximité des personnes, les instruments sont petits et brillants, et de nombreux événements surviennent simultanément. Les modèles d’usage général manquent souvent des détails critiques : ils peuvent voir la présence d’un chirurgien mais ne pas localiser un instrument précis, prédire l’étape suivante d’un robot ou reconnaître une violation des zones stériles. Lorsque les auteurs ont testé des systèmes vision‑langage de pointe, y compris des modèles commerciaux et un modèle open source performant, leurs résultats sur des tâches chirurgicales n’étaient guère meilleurs que le simple choix de la réponse la plus fréquente.

Transformer les flux de travail chirurgicaux en questions‑réponses

Pour mesurer et améliorer de manière systématique la compréhension machine de la chirurgie, les chercheurs ont créé le benchmark ORQA. Ils ont combiné quatre ensembles de données riches issus de blocs opératoires réels et simulés incluant vues de caméras externes, vidéos montées sur le chirurgien, reconstructions 3D de la scène, audio, journaux des robots et plus encore. À partir de ces sources, ils ont généré plus de 100 millions de paires question‑réponse sur ce qui se passe dans la salle. Ces questions couvrent 23 types de tâches, comme le nombre de personnes présentes, quels instruments sont utilisés, quelle action est en cours, où se trouve un outil dans l’espace 3D, s’il y a une rupture de stérilité, et quelle sera la prochaine étape du robot. En réduisant cet immense corpus à un million d’exemples diversifiés pour l’entraînement et à des ensembles séparés pour les tests, ils ont créé une référence commune pour tout modèle d’IA prétendant comprendre la chirurgie.

Un modèle fondamental conçu pour le bloc opératoire

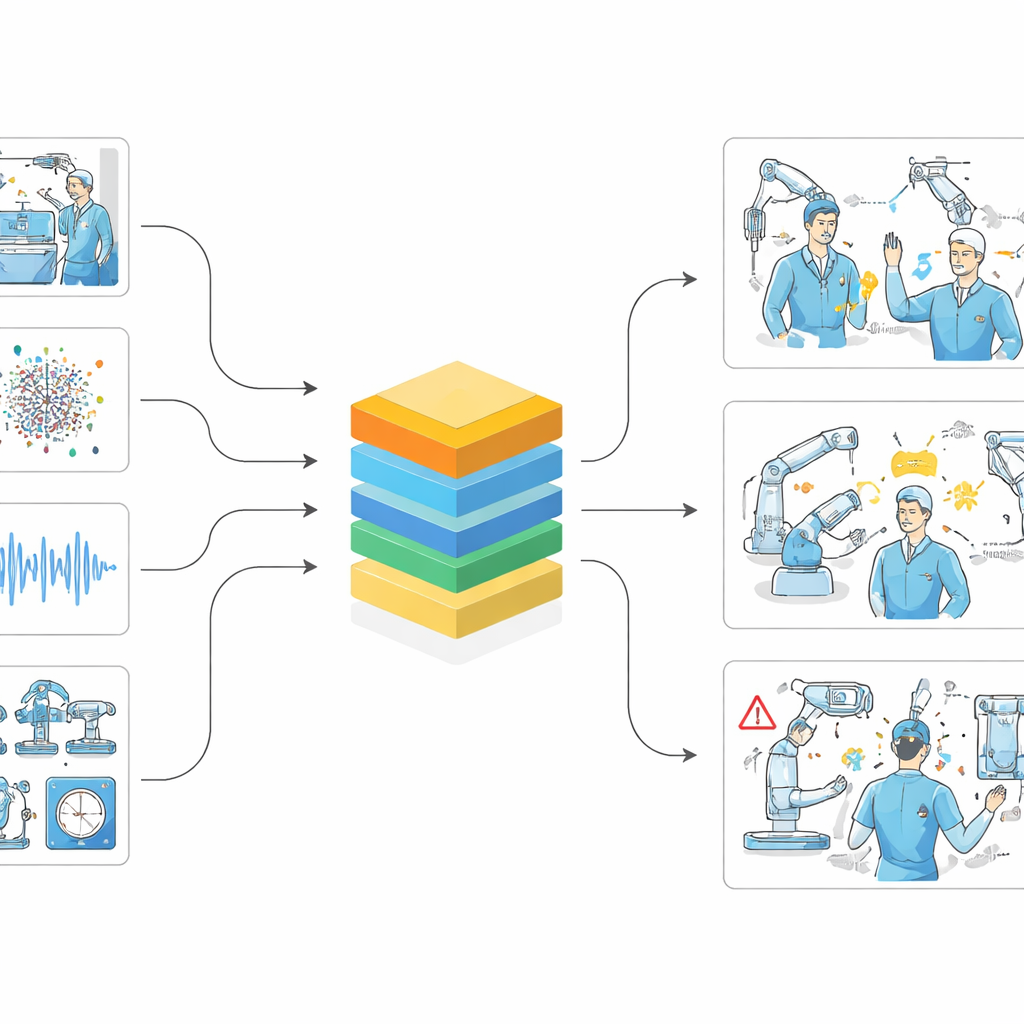

À partir de ce benchmark, l’équipe a entraîné ORQA, un modèle fondamental spécialisé qui fusionne de nombreux flux de données chirurgicales. Des encodeurs distincts traitent les images vidéo, les nuages de points 3D, le son, les transcriptions vocales, la télémétrie robotique et les données de suivi, en les convertissant en une représentation numérique partagée. Un large modèle de langage raisonne ensuite sur ce signal combiné pour répondre aux questions sur la scène. Sur le benchmark ORQA, ce système adapté au domaine double plus que les performances des modèles généraux, et ce, sur une large gamme de tâches — reconnaissance d’actions, localisation d’instruments, raisonnement sur les distances et les rôles, et vérification de conditions liées à la sécurité. Le modèle peut même être étendu par des structures de mémoire qui suivent le déroulement de l’intervention dans le temps, ce qui laisse entrevoir des gains futurs grâce à une modélisation temporelle plus riche.

Rendre l’IA chirurgicale rapide et pratique

Les modèles puissants sont souvent trop volumineux pour un usage en temps réel dans les hôpitaux, où les ordinateurs peuvent être limités et les connexions réseau vers des serveurs distants restreintes pour des raisons de confidentialité. Pour répondre à ce besoin, les auteurs ont utilisé un procédé appelé distillation, dans lequel un grand modèle « enseignant » forme des versions plus petites « étudiantes ». Ils ont produit trois variantes compactes d’ORQA qui s’exécutent plusieurs fois plus vite tout en conservant la majeure partie de la précision initiale. Ces modèles allégés peuvent fonctionner localement sur une seule carte graphique ou un dispositif en périphérie, permettant de surveiller plusieurs postes dans un bloc opératoire simultanément et évitant la nécessité de diffuser des données sensibles des patients vers le cloud. Les sorties structurées et traçables — comme des listes de personnes, d’instruments et de leurs interactions — facilitent également l’inspection, l’audit et la confiance des cliniciens dans le comportement du système.

Ce que cela signifie pour la chirurgie de demain

Concrètement, l’étude montre que la chirurgie nécessite son propre type d’IA, entraînée directement sur les images et sons des opérations réelles plutôt que sur du contenu web général. ORQA démontre que lorsqu’un modèle est exposé aux bonnes données chirurgicales multimodales, il peut suivre de manière fiable qui fait quoi, où se trouvent les instruments, comment la procédure progresse et si quelque chose d’insécurisant est en train de se produire. Si beaucoup de travail reste à accomplir avant que de tels systèmes puissent guider directement une opération, ORQA et son benchmark posent les bases d’assistants plus intelligents, d’une meilleure documentation et, à terme, de blocs opératoires plus autonomes et mieux coordonnés.

Citation: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Mots-clés: IA chirurgicale, salle d’opération, modèles multimodaux, robotique médicale, sécurité des patients