Clear Sky Science · ru

Специализированные базовые модели для интеллектуальных операционных

Умная помощь в операционной

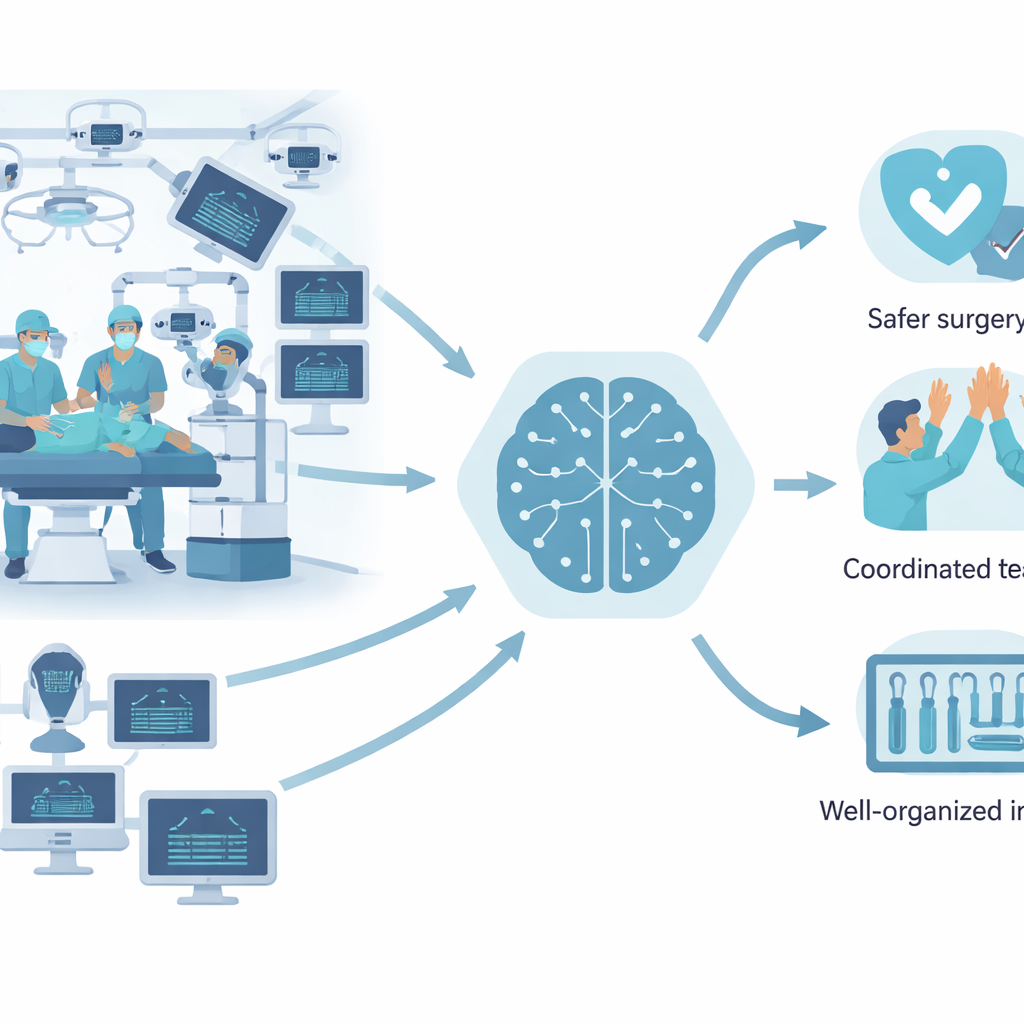

Современная хирургия проходит в плотном, высокотехнологичном пространстве, где люди, роботы, камеры и мониторы должны работать совместно без ошибок. В этой статье представлен ORQA — новый тип искусственного интеллекта, специально разработанный для операционной. В отличие от популярных чат-ботов, которые в основном оперируют словами и простыми изображениями, ORQA создан так, чтобы наблюдать, слушать и интерпретировать всё, что происходит во время операции, чтобы поддерживать команды, выявлять опасности и в конечном итоге повышать безопасность вмешательств.

Почему современному ИИ трудно в хирургии

Многие ИИ-инструменты, впечатлившие мир, обучались на изображениях, видео и текстах из интернета. Они могут объяснить медицинские термины или описать распространённую операцию, но визуальная обстановка в операционной очень отличается. Несколько камер показывают перекрывающиеся ракурсы, роботизированные манипуляторы движутся рядом с людьми, инструменты маленькие и блестящие, и одновременно разворачивается множество событий. Универсальные модели ИИ часто пропускают критические детали: они могут заметить присутствие хирурга, но не определить конкретный инструмент, не предсказать следующий шаг робота или не распознать нарушение стерильности. Когда авторы протестировали ведущие визуально-языковые системы, включая коммерческие модели и мощную открытую модель, их результаты по хирургическим задачам оказались лишь немного выше догадки по наиболее частому ответу.

Преобразование хирургических рабочих процессов в вопросы и ответы

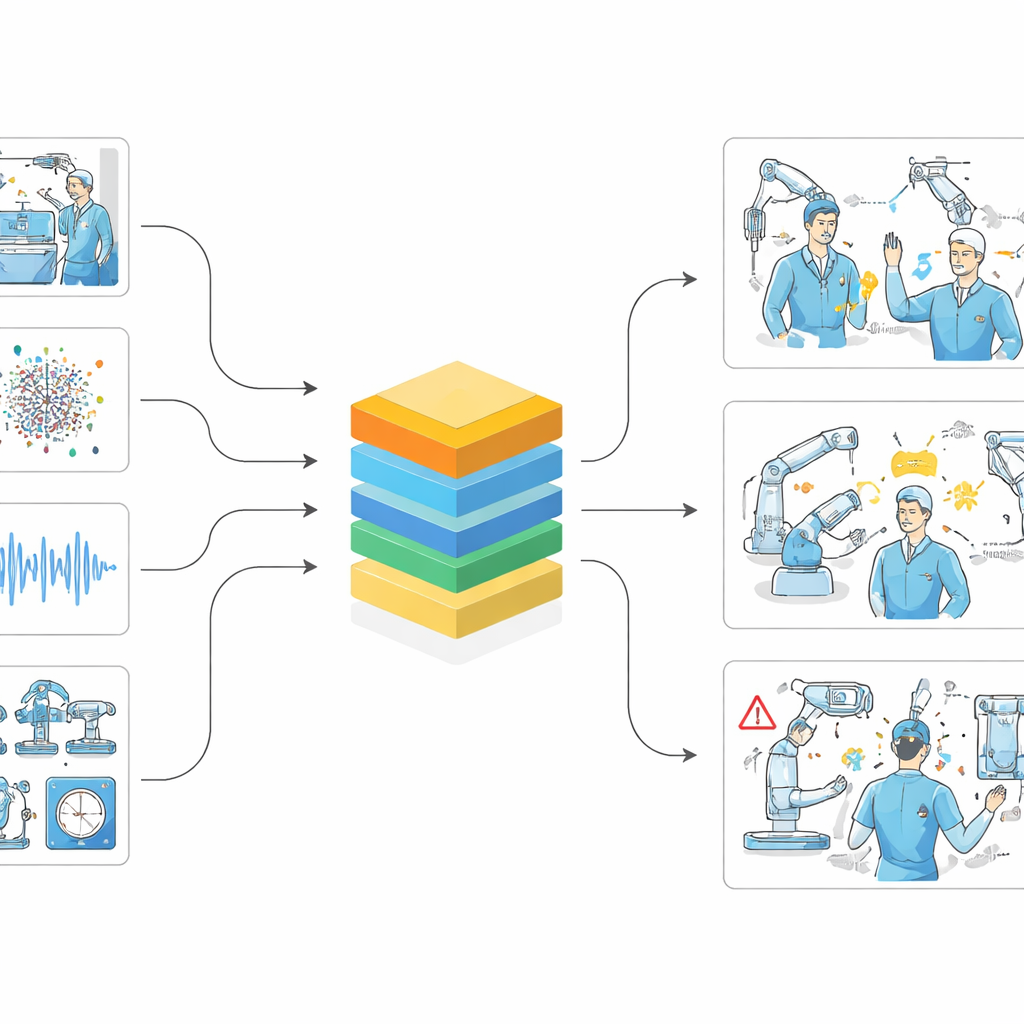

Чтобы системно оценивать и улучшать машинное понимание хирургии, исследователи создали бенчмарк ORQA. Они объединили четыре богатых набора данных реальных и симулированных операционных, включающих внешние видеокамеры, видео с камер, установленных на хирургах, 3D-реконструкции сцены, аудио, журналы роботов и другие источники. Из этих данных было сгенерировано более 100 миллионов пар вопросов и ответов о том, что происходит в помещении. Вопросы охватывают 23 типа задач, например, сколько людей присутствуют, какие инструменты используются, какое действие выполняется, где находится инструмент в 3D-пространстве, происходит ли нарушение стерильности и какой будет следующий шаг робота. Сократив этот огромный объём до миллиона разнообразных примеров для обучения и отдельных наборов для тестирования, они создали общую меру для любой ИИ-модели, претендующей на понимание хирургии.

Базовая модель, созданная для операционной

Используя этот бенчмарк, команда обучила ORQA — специализированную базовую модель, которая объединяет множество потоков хирургических данных. Отдельные кодировщики обрабатывают видеокадры, 3D-точечные облака, звук, транскрипты речи, телеметрию робота и данные трекинга, превращая их в общее числовое представление. Затем большая языковая модель рассуждает над этим объединённым сигналом, чтобы отвечать на вопросы о сцене. На бенчмарке ORQA эта доменно-настроенная система более чем вдвое превосходит общие модели по показателям, и делает это в широком наборе задач — распознавание действий, локализация инструментов, рассуждения о расстояниях и ролях, проверка условий, связанных с безопасностью. Модель можно дополнительно расширить структурами памяти, отслеживающими, как разворачивалась операция во времени, что указывает на возможные улучшения при более глубокой временной модели.

Делаем хирургический ИИ быстрым и практичным

Мощные модели часто слишком велики для использования в реальном времени в больницах, где компьютеры могут быть небольшими, а сетевые соединения с удалёнными серверами ограничены по соображениям конфиденциальности. Чтобы решить эту проблему, авторы использовали процесс, называемый дистилляцией, при котором большая «учительская» модель обучает более компактные «студенческие» версии. Они получили три облегчённых варианта ORQA, которые работают в несколько раз быстрее, сохраняя большую часть исходной точности. Эти более лёгкие модели могут работать локально на одной графической плате или периферийном устройстве, позволяя одновременно контролировать несколько рабочих мест в операционной и избегать необходимости передавать чувствительные данные пациентов в облако. Структурированные, отслеживаемые выходные данные — такие как списки людей, инструментов и их взаимодействий — также упрощают проверку, аудит и доверие клиницистов к поведению системы.

Что это значит для будущей хирургии

Проще говоря, исследование показывает, что хирургии нужен свой собственный тип ИИ, обученный непосредственно на визуальной и аудиоинформации реальных операций, а не на общем веб-контенте. ORQA демонстрирует, что при подаче подходящих мультимодальных хирургических данных модель способна надежно отслеживать, кто что делает, где находятся инструменты, как идёт процедура и не происходит ли чего-то небезопасного. Хотя до того, как такие системы смогут напрямую управлять операциями, ещё предстоит много работы, ORQA и его бенчмарк создают основу для умных ассистентов, улучшённой документации и, в перспективе, более автономных и скоординированных операционных.

Цитирование: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Ключевые слова: хирургический ИИ, операционная, мультимодальные модели, медицинская робототехника, безопасность пациентов