Clear Sky Science · de

Spezialisierte Foundation-Modelle für intelligente Operationssäle

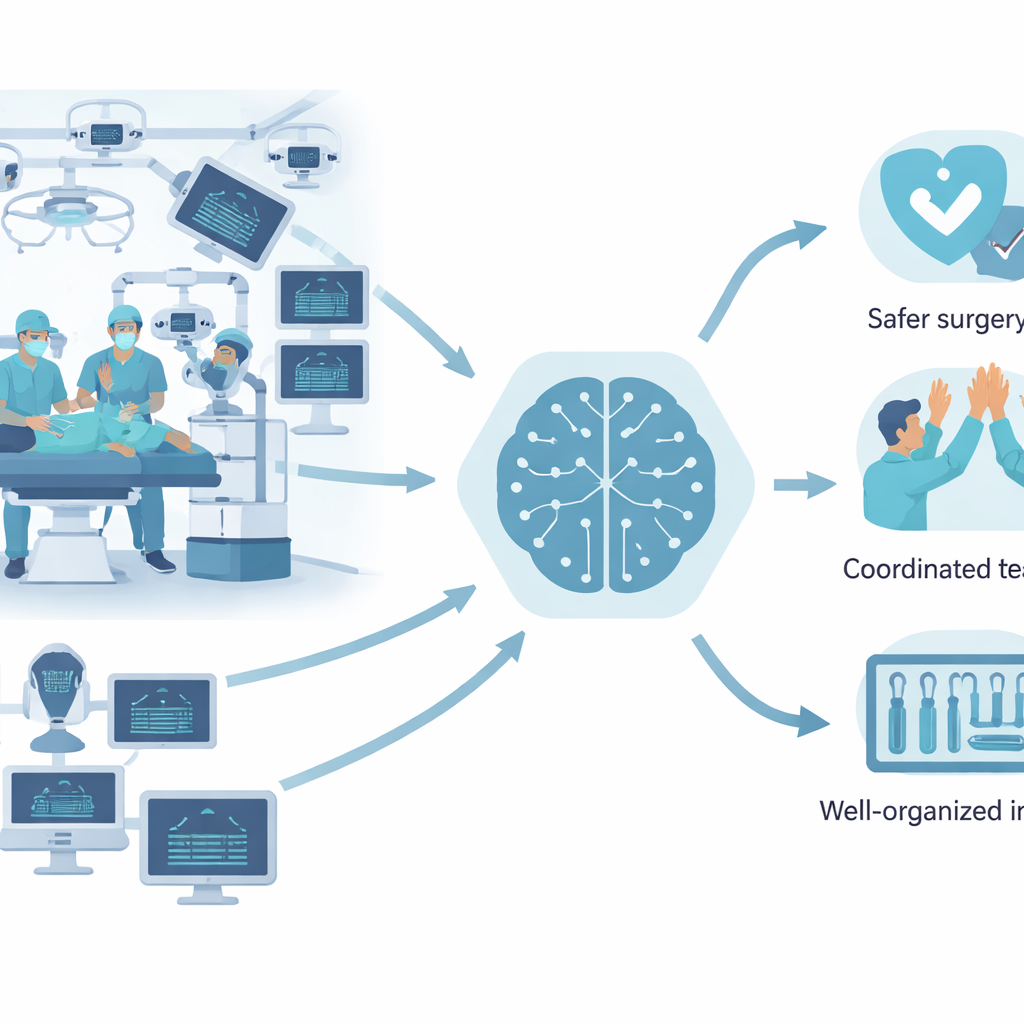

Klügere Unterstützung im Operationssaal

Moderne Chirurgie findet in einem überfüllten, hoch technisierten Umfeld statt, in dem Menschen, Roboter, Kameras und Monitore fehlerfrei zusammenarbeiten müssen. Dieser Artikel stellt ORQA vor, eine neue Art von künstlicher Intelligenz, die speziell für den Operationssaal entwickelt wurde. Anders als gängige Chatbots, die hauptsächlich mit Text und einfachen Bildern arbeiten, ist ORQA darauf ausgelegt, während der Operation zuzusehen, zuzuhören und alles zu interpretieren, um Teams zu unterstützen, Gefahren zu erkennen und letztlich Eingriffe sicherer zu machen.

Warum heutige KI in der Chirurgie versagt

Viele der KI‑Werkzeuge, die die Welt beeindruckt haben, wurden mit Internetbildern, -videos und -texten trainiert. Sie können medizinische Begriffe erklären oder einen Routineeingriff beschreiben, doch die visuelle Welt eines Operationssaals ist sehr anders. Mehrere Kameras liefern überlappende Blickwinkel, Roboterarme bewegen sich in der Nähe von Menschen, Instrumente sind klein und glänzend, und viele Ereignisse laufen gleichzeitig ab. Allgemein einsetzbare KI‑Modelle übersehen oft kritische Details: Sie erkennen möglicherweise, dass ein Chirurg anwesend ist, können aber ein bestimmtes Instrument nicht lokalisieren, den nächsten Schritt eines Roboters nicht vorhersagen oder nicht registrieren, wenn sterile Bereiche verletzt werden. Als die Autorinnen und Autoren führende Vision‑Language‑Systeme testeten – darunter kommerzielle Modelle und ein leistungsstarkes Open‑Source‑Modell – lag deren Leistung bei chirurgischen Aufgaben nur wenig über der Rate, die man durch Raten der häufigsten Antwort erzielen würde.

Chirurgische Arbeitsabläufe in Fragen und Antworten verwandeln

Um das maschinelle Verständnis von Operationen systematisch zu messen und zu verbessern, erstellten die Forschenden das ORQA‑Benchmark. Sie kombinierten vier umfangreiche Datensätze aus realen und simulierten Operationssälen, die Außenkameras, vom Chirurgen getragene Videos, 3D‑Szenerekonstruktionen, Audio, Roboter‑Logs und mehr enthalten. Aus diesen Quellen generierten sie über 100 Millionen Frage‑Antwort‑Paare darüber, was im Saal geschieht. Diese Fragen decken 23 Aufgabentypen ab, etwa wie viele Personen anwesend sind, welche Instrumente verwendet werden, welche Aktion gerade stattfindet, wo sich ein Werkzeug im 3D‑Raum befindet, ob eine Sterilitätsverletzung vorliegt und welcher nächste Roboter‑Schritt zu erwarten ist. Indem sie diesen riesigen Pool auf eine Million vielfältiger Beispiele für das Training und getrennte Sätze für Tests reduzierten, schufen sie ein gemeinsames Messinstrument für jede KI, die behauptet, Chirurgie zu verstehen.

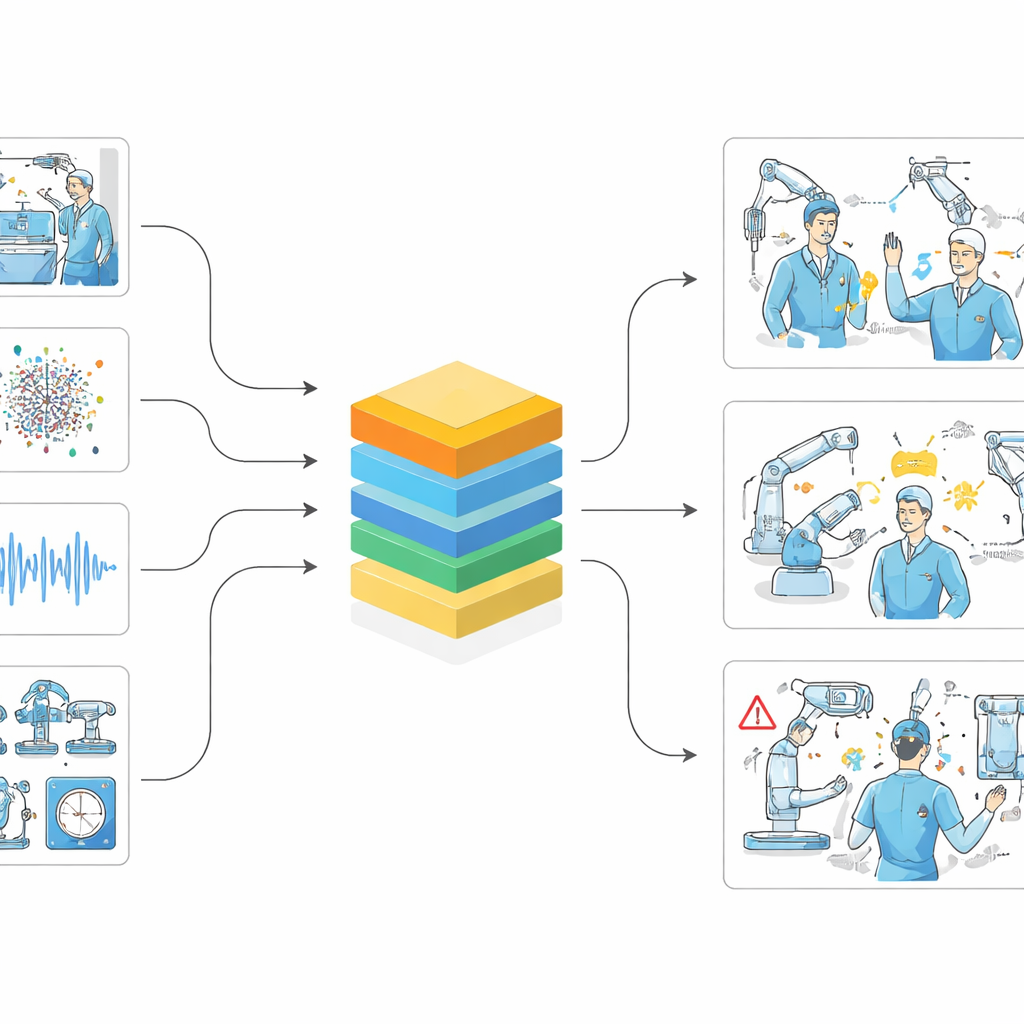

Ein Foundation‑Modell, gebaut für den Operationssaal

Mit diesem Benchmark trainierte das Team ORQA, ein spezialisiertes Foundation‑Modell, das viele Datenströme aus der Chirurgie zusammenführt. Separate Encoder verarbeiten Videoframes, 3D‑Punktwolken, Ton, Transkripte von Sprache, Robotertelemetrie und Tracking‑Daten und verwandeln sie in eine gemeinsame numerische Repräsentation. Ein großes Sprachmodell schließt dann über dieses kombinierte Signal logisch auf Fragen zur Szene. Im ORQA‑Benchmark verdoppelt dieses domänenspezifisch abgestimmte System die Leistung allgemeiner Modelle mehr als und zwar über ein breites Aufgabenspektrum – Erkennen von Aktionen, Lokalisieren von Instrumenten, Schlussfolgern zu Abständen und Rollen sowie Überprüfen sicherheitsrelevanter Zustände. Das Modell lässt sich sogar mit Gedächtnisstrukturen erweitern, die verfolgen, wie sich der Eingriff im Zeitverlauf entwickelt hat, was auf weitere Verbesserungen durch reichere zeitliche Modellierung hindeutet.

Chirurgische KI schnell und praktikabel machen

Leistungsstarke Modelle sind häufig zu groß für die Echtzeitanwendung in Krankenhäusern, wo Rechner begrenzt sein können und Verbindungen zu entfernten Servern aus Datenschutzgründen eingeschränkt sind. Um dem zu begegnen, nutzten die Autorinnen und Autoren einen Prozess namens Distillation, bei dem ein großes „Lehrer“-Modell kleinere „Schüler“-Versionen trainiert. Sie entwickelten drei kompakte ORQA‑Varianten, die mehrere Male schneller laufen und dabei den Großteil der ursprünglichen Genauigkeit bewahren. Diese leichteren Modelle können lokal auf einer einzigen Grafikkarte oder einem Edge‑Gerät betrieben werden, sodass mehrere Stationen in einem Operationssaal gleichzeitig überwacht werden können, ohne sensible Patientendaten in die Cloud streamen zu müssen. Die strukturierten, nachvollziehbaren Ausgaben – wie Listen von Personen, Instrumenten und deren Interaktionen – erleichtern außerdem Klinikern die Inspektion, Prüfung und das Vertrauen in das Systemverhalten.

Was das für die Chirurgie der Zukunft bedeutet

Kurz gesagt zeigt die Studie, dass Chirurgie ihre eigene Art von KI braucht, die direkt mit den Bildern und Geräuschen realer Eingriffe trainiert wird und nicht mit allgemeinem Web‑Content. ORQA demonstriert, dass ein Modell, das die richtigen multimodalen chirurgischen Daten sieht, zuverlässig nachverfolgen kann, wer was tut, wo Instrumente sind, wie der Eingriff voranschreitet und ob etwas Unsicheres geschieht. Zwar bleibt noch viel Arbeit, bevor solche Systeme Eingriffe direkt anleiten können, doch ORQA und sein Benchmark legen die Grundlage für klügere Assistenten, bessere Dokumentation und schließlich für autonomere und koordiniertere Operationssäle.

Zitation: Özsoy, E., Pellegrini, C., Bani-Harouni, D. et al. Specialized foundation models for intelligent operating rooms. npj Digit. Med. 9, 362 (2026). https://doi.org/10.1038/s41746-026-02631-4

Schlüsselwörter: chirurgische KI, Operationssaal, multimodale Modelle, medizinische Robotik, Patientensicherheit