Clear Sky Science · sv

En beteendeanpassande AI‑assistent som förbättrar tillgänglighet och användbarhet för synskadade användare genom personanpassning i realtid

Varför smartare röster är viktiga

Talande datorer blir allt vanligare i våra telefoner, högtalare och bärbara datorer. Men för personer som inte kan se är dessa röster mer än ett bekvämt hjälpmedel — de är en livlina till information, arbete och vardagssysslor. Denna artikel introducerar AURA, en ny typ av talande assistent utformad för att lyssna inte bara på vad synskadade användare säger, utan på hur de reagerar i realtid, och varsamt förändra sitt eget sätt att tala så att det blir enklare att följa och mindre tröttande att använda.

Vardagliga verktyg som fortfarande inte räcker till

Dagens skärmläsare och röstassistenter läser upp skärmar eller svarar på frågor, men de talar vanligtvis till alla på samma sätt. De tenderar att hålla en fast talhastighet, ge antingen för mycket eller för lite information och gå igenom innehåll i en strikt ordning. För många synskadade användare leder detta "en storlek passar alla"‑fokus till upprepade uppspelningar, frekventa hopp och mental överbelastning när de försöker hänga med eller hitta det som är relevant. Tidigare forskning har visat att ändringar i talhastighet, detaljnivå och språklig komplexitet kan göra stor skillnad, men de flesta verktyg justerar inte automatiskt medan en konversation pågår.

En ny form av lyssnande

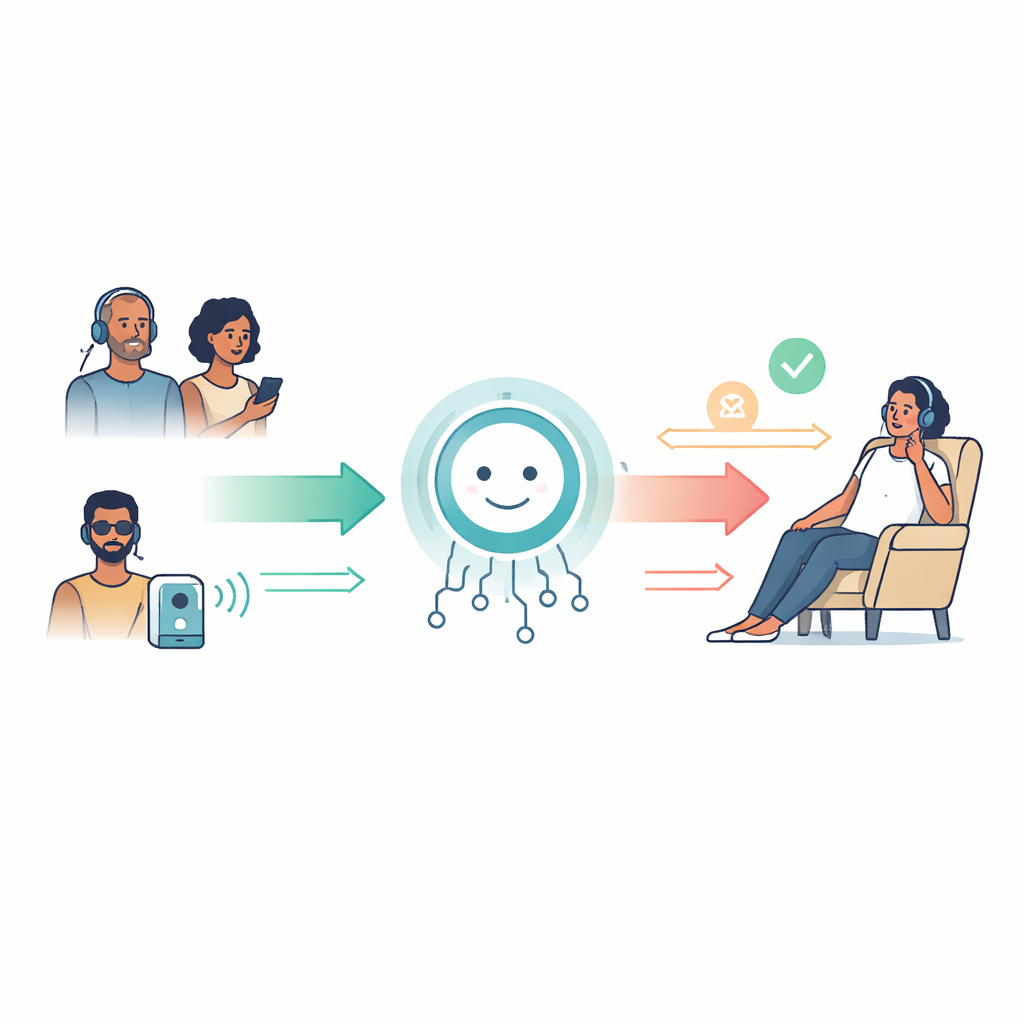

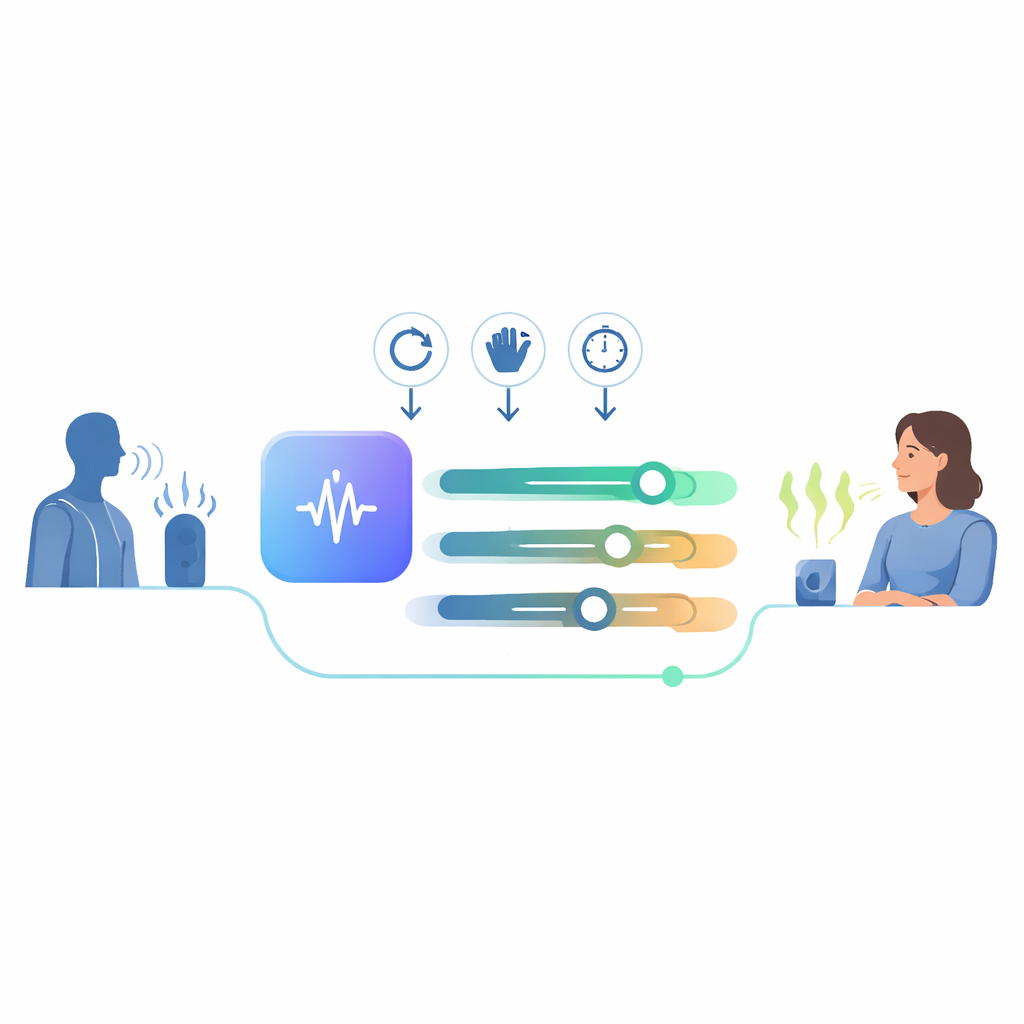

AURA (Adaptive User‑Responsive Assistant) är byggd för att bryta detta mönster. Det är ett röstbaserat system som kombinerar en kraftfull språkmodell — samma generella teknik bakom avancerade chattbotar — med ett enkelt men smart sätt att iaktta hur en användare beter sig under en session. Istället för att gissa utifrån långa enkäter eller fasta användarprofiler observerar AURA tre naturliga signaler: hur ofta en användare spelar upp ett svar igen, hur ofta de avbryter ett meddelande i förtid och hur länge de lyssnar innan de agerar. Dessa ledtrådar kräver ingen extra hårdvara, avslöjar inte privat data som ögonrörelser eller puls och passar naturligt in i hur människor redan använder talande system.

Hur assistenten anpassar sig i realtid

Inuti AURA fungerar interaktionen i en sluten loop. Först talar användaren och deras ord omvandlas till text. Systemet hämtar sedan en lättviktsprofil som lagrar tre justerbara reglage: hur fort det ska tala, hur långa svaren bör vara och hur enkelt eller komplext språket ska vara. Denna profil formar den prompt som skickas till språkmodellen, som sedan skapar ett svar som redan syftar till att matcha användarens aktuella stil. Texten omvandlas till tal med de valda inställningarna och spelas upp för användaren. Under och efter svaret loggar AURA tyst om användaren spelar upp igen, hoppar över eller lyssnar igenom, och justerar sedan profilen inför nästa tur. Efter några fram‑och‑tillbaka‑utbyten "spetsar" assistenten in sig på ett sätt att tala som bättre passar lyssnaren — allt utan att användaren behöver ändra några inställningsmenyer.

Test av idén i en säker sandlåda

För att se om denna regelbaserade anpassning faktiskt beter sig förnuftigt började forskaren inte med mänskliga försökspersoner. Istället använde studien simulerade användarprofiler som efterliknar tre vanliga mönster: en som spelar upp mycket eftersom den har svårt att uppfatta detaljer, en som hoppar mycket eftersom svaren känns för långa, och en som föredrar snabba, täta svar. För varje profil körde systemet många korta sessioner både med och utan anpassning. Studien mätte sedan hur ofta uppspelningar och hopp inträffade, hur lång tid uppgifter tog och om assistentens interna inställningar stabiliserade sig i ett mönster som matchade den tänkta profilen. Medan inga formella statistiska tester utfördes — detta var en genomförbarhetskontroll snarare än en fullständig användarstudie — visade siffrorna tydliga skiften.

Vad de tidiga siffrorna antyder

I situationer med mycket uppspelningar minskade den adaptiva versionen av AURA uppspelningshändelser med ungefär två tredjedelar jämfört med en fast, icke‑adaptiv uppsättning. I hoppsdominerade förhållanden sjönk hoppen med ungefär hälften när systemet lärde sig hålla svaren kortare och mer kärnfulla. Över alla simulerade profiler nådde assistenten stabila inställningar som matchade målprofilen i de flesta sessioner, och att genomföra en standardiserad flerstegsuppgift tog omkring en femtedel mindre tid med anpassning på. Viktigt är att anpassningsreglerna var enkla och transparenta: upprepade uppspelningar skötte assistenten mot långsammare tal och enklare språk, medan frekventa hopp skötte den mot kortare, tätare svar. Denna design gör systemet lättare att förstå och felsöka än en svart‑låda‑inlärningsmodell — en nyckelfråga för säkerhet och förtroende i hjälpteknik.

Vad detta betyder för verkliga människor

För läsare utanför forskarvärlden är huvudpoängen att talande datorer kan bli mer hänsynsfulla lyssnare. Genom att uppmärksamma naturliga signaler som "Spelade du upp det igen?" eller "Avbröt du mig?" kan en assistent snabbt lära sig att tala på ett sätt som är mindre frustrerande och mer effektivt, särskilt för blinda och synskadade användare som är beroende av ljud. Det nuvarande arbetet bevisar ännu inte en förbättrad vardagsupplevelse, eftersom det testades med datorgenererat beteende snarare än riktiga människor. Men det lägger grunden — både tekniskt och konceptuellt — för framtida studier med blinda användare, rikare samtal och stöd på flera språk. Om dessa nästa steg lyckas skulle verktyg som AURA kunna hjälpa till att förflytta hjälpteknik från rigida, envägs‑läsmaskiner till responsiva partners som anpassar sig i realtid till de människor som är mest beroende av dem.

Citering: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Nyckelord: tillgänglighet för synskadade, anpassningsbar röstassistent, beteende‑medveten AI, stora språkmodeller, hjälpteknik