Clear Sky Science · es

Un asistente de IA que se adapta al comportamiento para mejorar accesibilidad y usabilidad de personas ciegas mediante la personalización de la interacción en tiempo real

Por qué importan voces más inteligentes

Los ordenadores que hablan son cada vez más habituales en nuestros teléfonos, altavoces y portátiles. Pero para las personas que no pueden ver, estas voces son más que una comodidad: son una línea vital hacia la información, el trabajo y las tareas diarias. Este artículo presenta AURA, un nuevo tipo de asistente hablante diseñado para escuchar no solo lo que dicen los usuarios ciegos, sino cómo reaccionan en tiempo real, y así ajustar suavemente su propio estilo de habla para que sea más fácil de seguir y menos fatigoso de usar.

Herramientas cotidianas que aún se quedan cortas

Los lectores de pantalla y asistentes de voz actuales leen pantallas o responden preguntas, pero por lo general hablan a todo el mundo de la misma manera. Suelen mantener una velocidad fija, ofrecen demasiados o muy pocos detalles y recorren el contenido en un orden estricto. Para muchos usuarios ciegos, este enfoque “talla única” provoca repeticiones constantes, saltos frecuentes y sobrecarga mental mientras intentan seguir el ritmo o extraer lo que importa. Investigaciones previas han mostrado que cambiar la velocidad de habla, la cantidad de detalle y la complejidad del lenguaje puede marcar una gran diferencia, pero la mayoría de herramientas no se ajustan automáticamente a medida que se desarrolla una conversación.

Un nuevo modo de escuchar

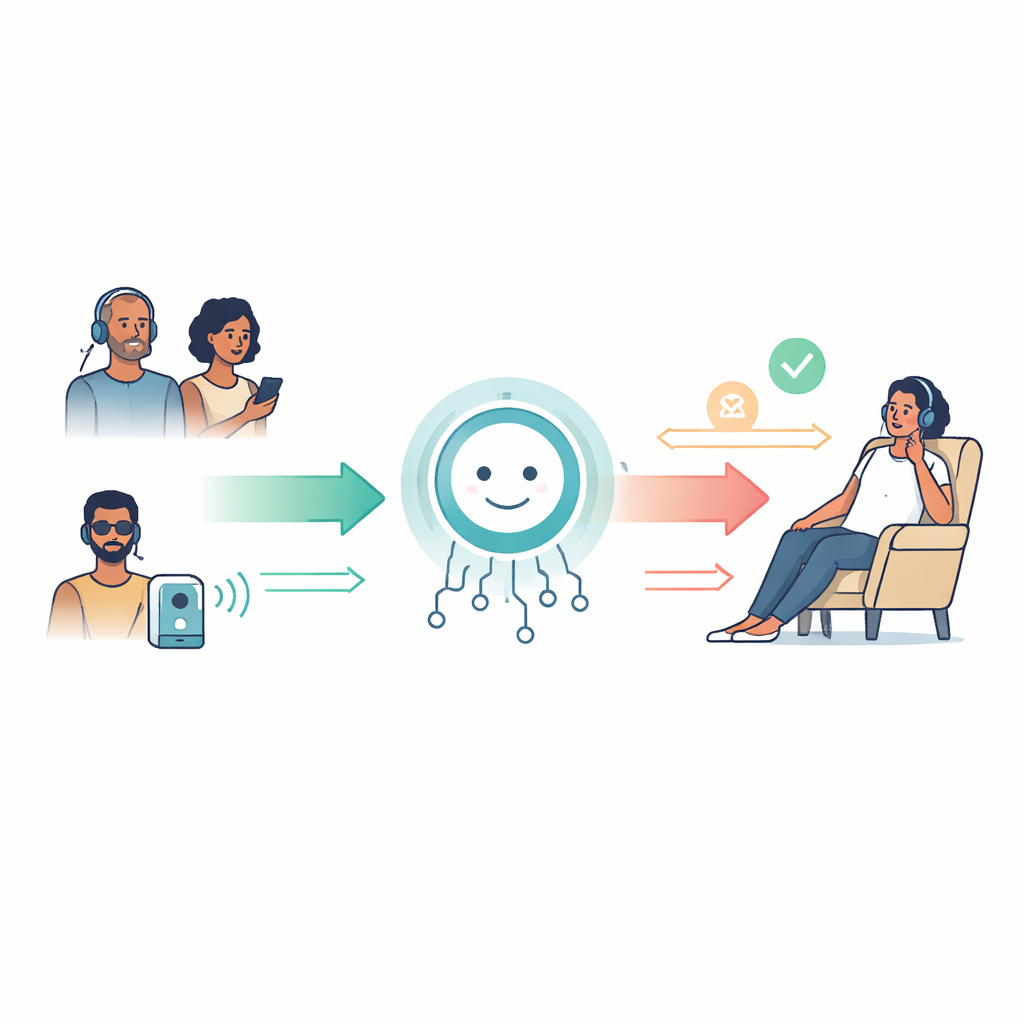

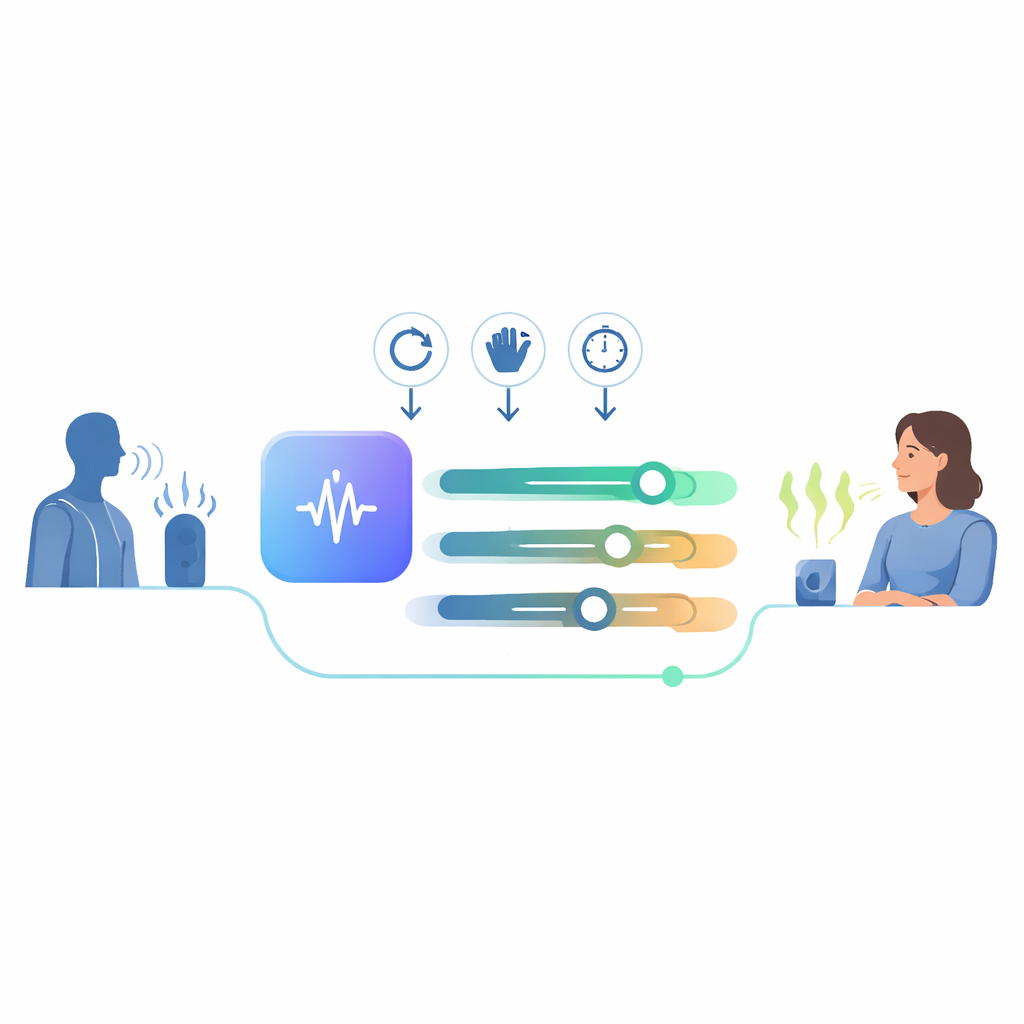

AURA (Adaptive User-Responsive Assistant) está diseñada para cambiar ese patrón. Es un sistema basado en voz que combina un potente modelo de lenguaje —la misma tecnología general detrás de chatbots avanzados— con una forma sencilla pero inteligente de observar cómo se comporta el usuario durante una sesión. En lugar de adivinar a partir de largas encuestas o perfiles fijos, AURA vigila tres señales naturales: con qué frecuencia un usuario reproduce una respuesta, con qué frecuencia interrumpe un mensaje y cuánto tiempo escucha antes de actuar. Estas pistas no requieren hardware adicional, no exponen datos privados como movimientos oculares o ritmo cardíaco y encajan de forma natural en el uso habitual de los sistemas hablantes.

Cómo se adapta el asistente al instante

Dentro de AURA, la interacción funciona en un bucle cerrado. Primero, el usuario habla y sus palabras se convierten en texto. El sistema luego recupera un perfil ligero que almacena tres perillas ajustables: qué tan rápido debe hablar, cuánto deben durar sus respuestas y qué tan sencillo o complejo debe ser su lenguaje. Este perfil moldea el prompt enviado al modelo de lenguaje, que a continuación genera una respuesta ya orientada a coincidir con el estilo actual del usuario. El texto se transforma en habla usando los ajustes elegidos y se reproduce al usuario. Durante y después de esa respuesta, AURA registra discretamente si el usuario reproduce, salta o escucha hasta el final, y ajusta el perfil para la siguiente intervención. Tras unos pocos intercambios, el asistente se “afina” hacia una forma de hablar que encaja mejor con el oyente, todo sin que el usuario tenga que cambiar ningún menú de configuración.

Probar la idea en un entorno controlado

Para comprobar si esta adaptación basada en reglas realmente se comporta de forma sensata, el investigador no empezó con voluntarios humanos. En su lugar, el estudio usó perfiles de usuario simulados que imitan tres patrones comunes: uno que reproduce mucho porque le cuesta captar detalles, otro que salta con frecuencia porque las respuestas parecen demasiado largas y uno que prefiere respuestas rápidas y densas. Para cada perfil, el sistema ejecutó muchas sesiones cortas con y sin adaptación. El estudio midió entonces con qué frecuencia ocurrían reproducciones y saltos, cuánto tardaban las tareas y si los ajustes internos del asistente se asentaban en un patrón estable que coincidiera con el perfil previsto. Aunque no se realizaron estadísticas formales —esto fue una prueba de viabilidad más que un ensayo con usuarios—, los números mostraron cambios claros.

Qué sugieren las primeras cifras

En condiciones con muchas reproducciones, la versión adaptativa de AURA redujo los eventos de reproducción en aproximadamente dos tercios en comparación con una configuración fija y no adaptativa. En condiciones con muchos saltos, los saltos se redujeron alrededor de la mitad una vez que el sistema aprendió a mantener respuestas más breves y directas. En todos los perfiles simulados, el asistente alcanzó ajustes estables que coincidían con el estilo objetivo en la mayoría de las sesiones, y completar una tarea estándar de varios pasos llevó aproximadamente un 20% menos de tiempo con la adaptación activada. Es importante señalar que las reglas de adaptación eran simples y transparentes: las reproducciones repetidas empujaban al asistente hacia una voz más lenta y un lenguaje más sencillo, mientras que los saltos frecuentes lo orientaban hacia respuestas más breves y densas. Este diseño mantiene el sistema más fácil de entender y depurar que un modelo de aprendizaje en caja negra, una preocupación clave para la seguridad y la confianza en la tecnología asistiva.

Qué significa esto para las personas reales

Para lectores ajenos al mundo de la investigación, la conclusión principal es que los ordenadores hablantes pueden convertirse en oyentes más considerados. Prestando atención a señales naturales como “¿Has reproducido eso?” o “¿Me has interrumpido?”, un asistente puede aprender rápidamente a hablar de una manera menos frustrante y más eficiente, especialmente para usuarios ciegos y con baja visión que dependen del audio. El trabajo actual aún no demuestra una mejor experiencia diaria, porque se probó con comportamiento generado por ordenador en lugar de con personas reales. Pero sienta las bases —tanto técnicas como conceptuales— para futuros estudios con usuarios ciegos, conversaciones más ricas y soporte en varios idiomas. Si estos siguientes pasos prosperan, herramientas como AURA podrían ayudar a transformar la tecnología asistiva de máquinas lectoras rígidas y unidireccionales a socios receptivos que se adaptan en tiempo real a las personas que más dependen de ellas.

Cita: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Palabras clave: accesibilidad para ciegos, asistente de voz adaptativo, IA consciente del comportamiento, modelos de lenguaje a gran escala, tecnología asistiva