Clear Sky Science · pl

Asystent AI adaptujący się do zachowań, poprawiający dostępność i użyteczność dla osób niewidomych poprzez personalizację interakcji w czasie rzeczywistym

Dlaczego mądrzejsze głosy mają znaczenie

Mówiące komputery stają się powszechne w naszych telefonach, głośnikach i laptopach. Dla osób, które nie widzą, te głosy to nie tylko wygoda — są one linią życia do informacji, pracy i codziennych zadań. W artykule przedstawiono AURA, nowy rodzaj asystenta głosowego zaprojektowanego tak, by słuchać nie tylko tego, co mówią użytkownicy niewidomi, ale także tego, jak reagują w czasie rzeczywistym, delikatnie dostosowując własny sposób mówienia, aby stał się łatwiejszy do śledzenia i mniej męczący w użyciu.

Codzienne narzędzia, które wciąż zawodzą

Obecne czytniki ekranu i asystenci głosowi odczytują zawartość ekranu lub odpowiadają na pytania, ale zazwyczaj mówią do wszystkich w ten sam sposób. Mają stałe tempo mowy, oferują albo za dużo, albo za mało szczegółów i przechodzą przez treść w sztywnym porządku. Dla wielu użytkowników niewidomych takie podejście „jeden rozmiar dla wszystkich” prowadzi do powtarzanych odtwarzań, częstych pomijania fragmentów i przeciążenia umysłowego, gdy próbują nadążyć lub wydobyć istotne informacje. Badania wcześniejsze wykazały, że zmiana tempa mowy, ilości szczegółów i złożoności języka może zrobić dużą różnicę, jednak większość narzędzi nie dostosowuje się automatycznie w miarę przebiegu rozmowy.

Nowy rodzaj słuchania

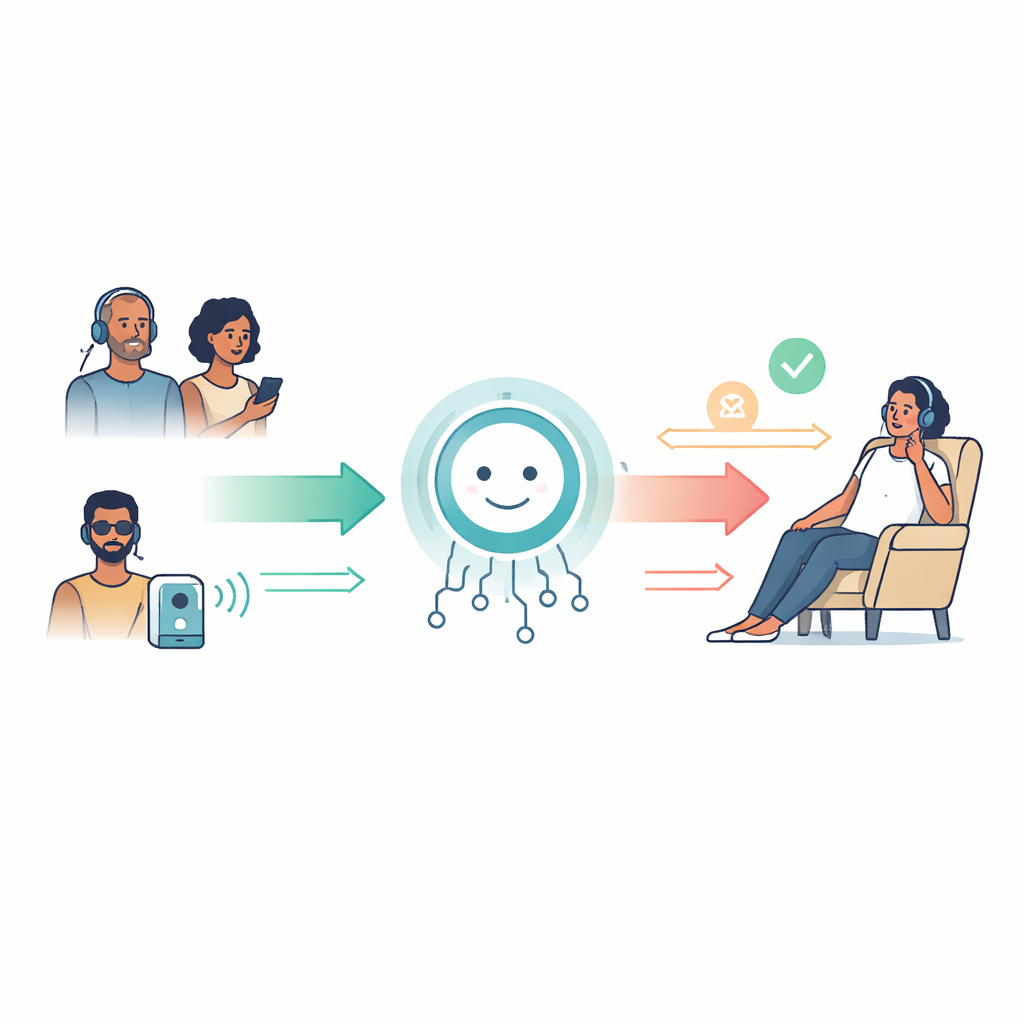

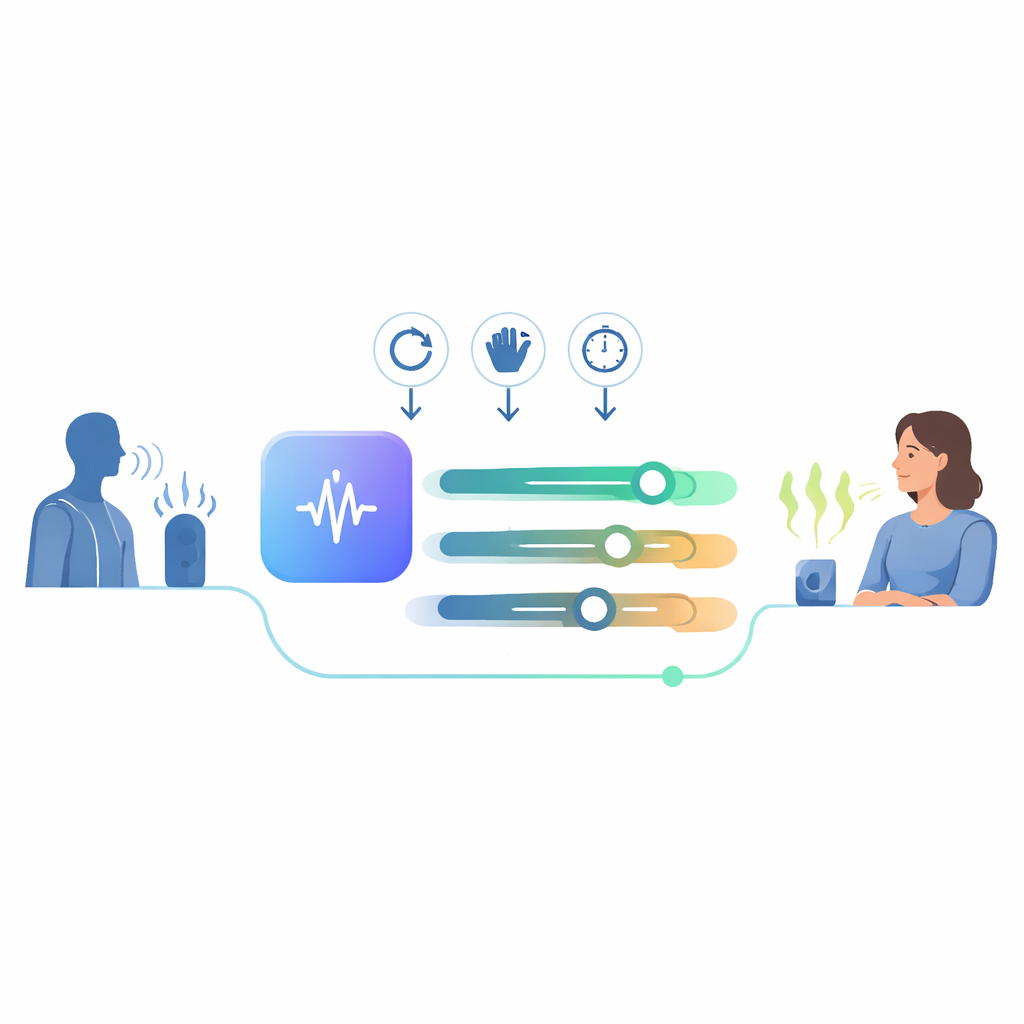

AURA (Adaptive User-Responsive Assistant) została stworzona, by zmienić ten wzorzec. To system oparty na głosie, łączący potężny model językowy — tę samą ogólną technologię stojącą za zaawansowanymi chatbotami — z prostym, lecz inteligentnym sposobem obserwowania zachowań użytkownika podczas sesji. Zamiast polegać na długich ankietach lub stałych profilach użytkownika, AURA obserwuje trzy naturalne sygnały: jak często użytkownik odtwarza odpowiedź ponownie, jak często przerywa wiadomość przed końcem oraz jak długo słucha przed podjęciem działania. Te wskazówki nie wymagają dodatkowego sprzętu, nie ujawniają prywatnych danych, takich jak ruchy oczu czy tętno, i naturalnie wpisują się w sposób, w jaki ludzie już korzystają z systemów głosowych.

Jak asystent adaptuje się w locie

W AURA interakcja przebiega w pętli zamkniętej. Najpierw użytkownik mówi, a jego słowa są zamieniane na tekst. System pobiera następnie lekki profil zawierający trzy regulowane pokrętła: tempo mówienia, długość odpowiedzi oraz prostotę lub złożoność języka. Ten profil kształtuje polecenie wysyłane do modelu językowego, który tworzy odpowiedź już mającą na celu dopasowanie do bieżącego stylu użytkownika. Tekst jest przekształcany na mowę z użyciem wybranych ustawień i odtwarzany użytkownikowi. Podczas i po tej odpowiedzi AURA cicho rejestruje, czy użytkownik odtwarza ponownie, pomija czy słucha do końca, a następnie koryguje profil na kolejną turę. W ciągu kilku wymian asystent „dostraja się” do sposobu mówienia lepiej pasującego do słuchacza — wszystko to bez konieczności, by użytkownik zmieniał ustawienia w menu.

Testowanie pomysłu w bezpiecznym piaskownicy

Aby sprawdzić, czy ta regułowa adaptacja zachowuje się sensownie, badacz nie rozpoczął od ochotników ludzkich. Zamiast tego w badaniu użyto symulowanych profili użytkowników, które naśladują trzy powszechne wzorce: jeden, który często odtwarza, ponieważ ma trudności ze złapaniem szczegółów; drugi, który często pomija, bo odpowiedzi wydają się zbyt długie; oraz trzeci, który woli szybkie, zwarte odpowiedzi. Dla każdego profilu system przeprowadził wiele krótkich sesji zarówno z adaptacją, jak i bez niej. W badaniu mierzono następnie, jak często występowały odtwarzania i pominięcia, ile czasu zajmowały zadania i czy wewnętrzne ustawienia asystenta ustabilizowały się w sposób zgodny z zamierzonym profilem. Choć nie przeprowadzono formalnej analizy statystycznej — był to test wykonalności, a nie pełne badanie użytkowników — liczby wykazały wyraźne przesunięcia.

Co sugerują wstępne dane

W warunkach z dominującymi odtworzeniami adaptacyjna wersja AURA zmniejszyła liczbę zdarzeń odtwarzania o około dwie trzecie w porównaniu z ustalonym, nieadaptacyjnym ustawieniem. W warunkach z przewagą pomijania, pominięcia spadły o około połowę, gdy system nauczył się utrzymywać odpowiedzi krótsze i bardziej treściwe. We wszystkich symulowanych profilach asystent osiągał stabilne ustawienia odpowiadające docelowemu stylowi w większości sesji, a wykonanie standardowego zadania wieloetapowego zajmowało około jednej piątej mniej czasu przy włączonej adaptacji. Co ważne, reguły adaptacji były proste i przejrzyste: powtarzane odtwarzania skłaniały asystenta ku wolniejszej mowie i prostszemu językowi, podczas gdy częste pominięcia skłaniały go ku krótszym, gęstszym odpowiedziom. Takie projektowanie utrzymuje system łatwiejszym do zrozumienia i debugowania niż model uczący się w trybie „czarnej skrzynki” — co jest kluczowe dla bezpieczeństwa i zaufania w technologii wspomagającej.

Co to oznacza dla realnych ludzi

Dla czytelników spoza świata badań główny wniosek jest taki, że mówiące komputery mogą stać się bardziej uważnymi słuchaczami. Zwracając uwagę na naturalne sygnały, takie jak „Czy odtworzyłeś to ponownie?” lub „Czy przerwałeś mi?”, asystent może szybko nauczyć się mówić w sposób mniej frustrujący i bardziej efektywny, szczególnie dla użytkowników niewidomych i niedowidzących, którzy polegają na dźwięku. Obecna praca jeszcze nie dowodzi poprawy codziennego doświadczenia, ponieważ testy przeprowadzono z zachowaniami generowanymi przez komputer, a nie prawdziwymi ludźmi. Jednak tworzy ona podstawy — zarówno techniczne, jak i koncepcyjne — dla przyszłych badań z użytkownikami niewidomymi, bogatszych rozmów i wsparcia w wielu językach. Jeśli te kolejne kroki się powiodą, narzędzia takie jak AURA mogą pomóc przesunąć technologię wspomagającą od sztywnych, jednostronnie czytających maszyn do responsywnych partnerów, którzy dostosowują się w czasie rzeczywistym do osób, które najbardziej na nich polegają.

Cytowanie: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Słowa kluczowe: dostępność dla niewidomych, adaptacyjny asystent głosowy, AI świadoma zachowań, duże modele językowe, technologie wspomagające