Clear Sky Science · pt

Um assistente de IA que se adapta ao comportamento melhorando acessibilidade e usabilidade para pessoas cegas por meio da personalização da interação em tempo real

Por que vozes mais inteligentes importam

Computadores falantes estão se tornando comuns em nossos celulares, alto-falantes e laptops. Mas para pessoas que não conseguem ver, essas vozes são mais do que uma conveniência — são um fio vital para informação, trabalho e tarefas diárias. Este artigo apresenta a AURA, um novo tipo de assistente falante projetado para ouvir não apenas o que usuários cegos dizem, mas como eles reagem em tempo real, ajustando suavemente seu próprio estilo de fala para que seja mais fácil de acompanhar e menos cansativo de usar.

Ferramentas do dia a dia que ainda deixam a desejar

Os leitores de tela e assistentes de voz atuais leem telas ou respondem perguntas, mas geralmente falam com todo mundo da mesma forma. Tendem a falar em velocidade fixa, oferecem detalhes demais ou de menos e percorrem o conteúdo em uma ordem rígida. Para muitos usuários cegos, essa abordagem “tamanho único” leva a repetições frequentes, pulos constantes e sobrecarga mental enquanto tentam acompanhar ou encontrar o que importa. Pesquisas anteriores mostraram que mudar a velocidade de fala, a quantidade de detalhe e a complexidade da linguagem pode fazer grande diferença, ainda que a maioria das ferramentas não ajuste automaticamente conforme a conversa se desenrola.

Um novo tipo de escuta

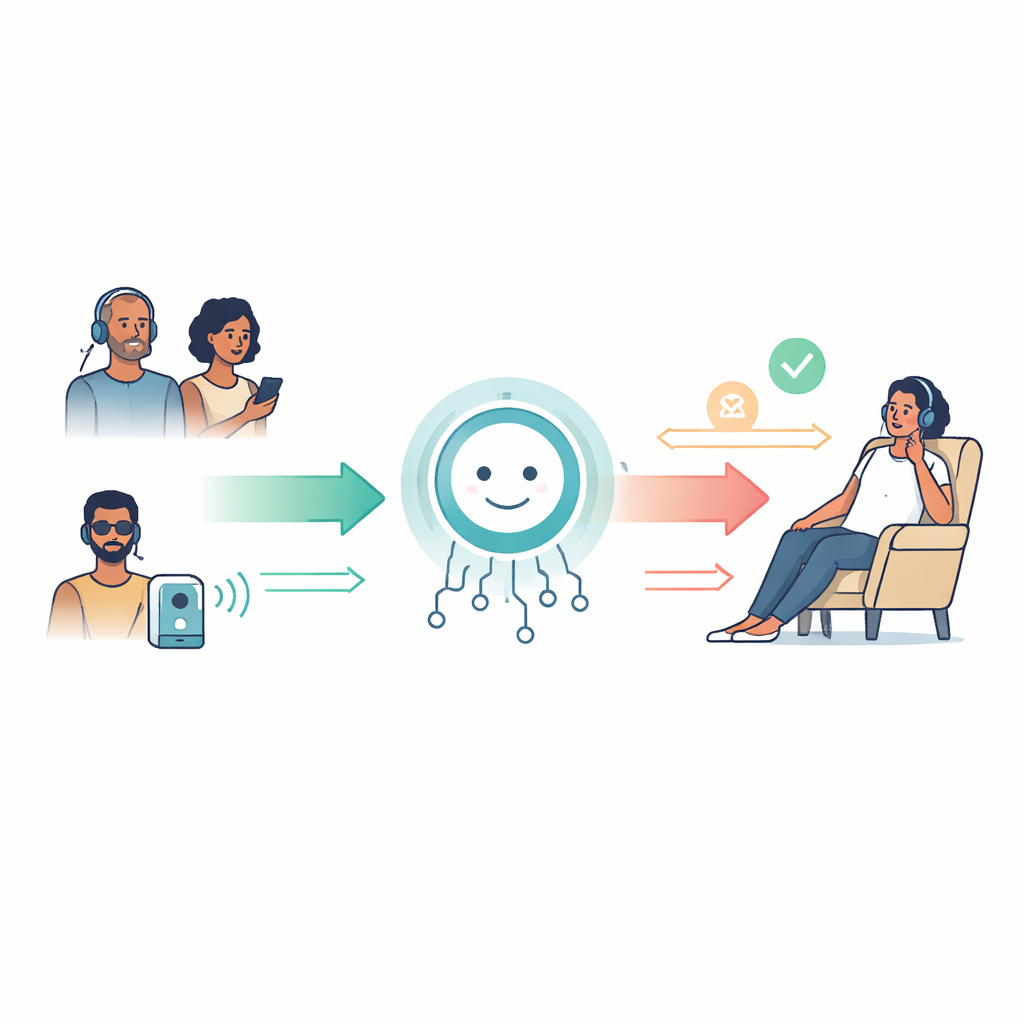

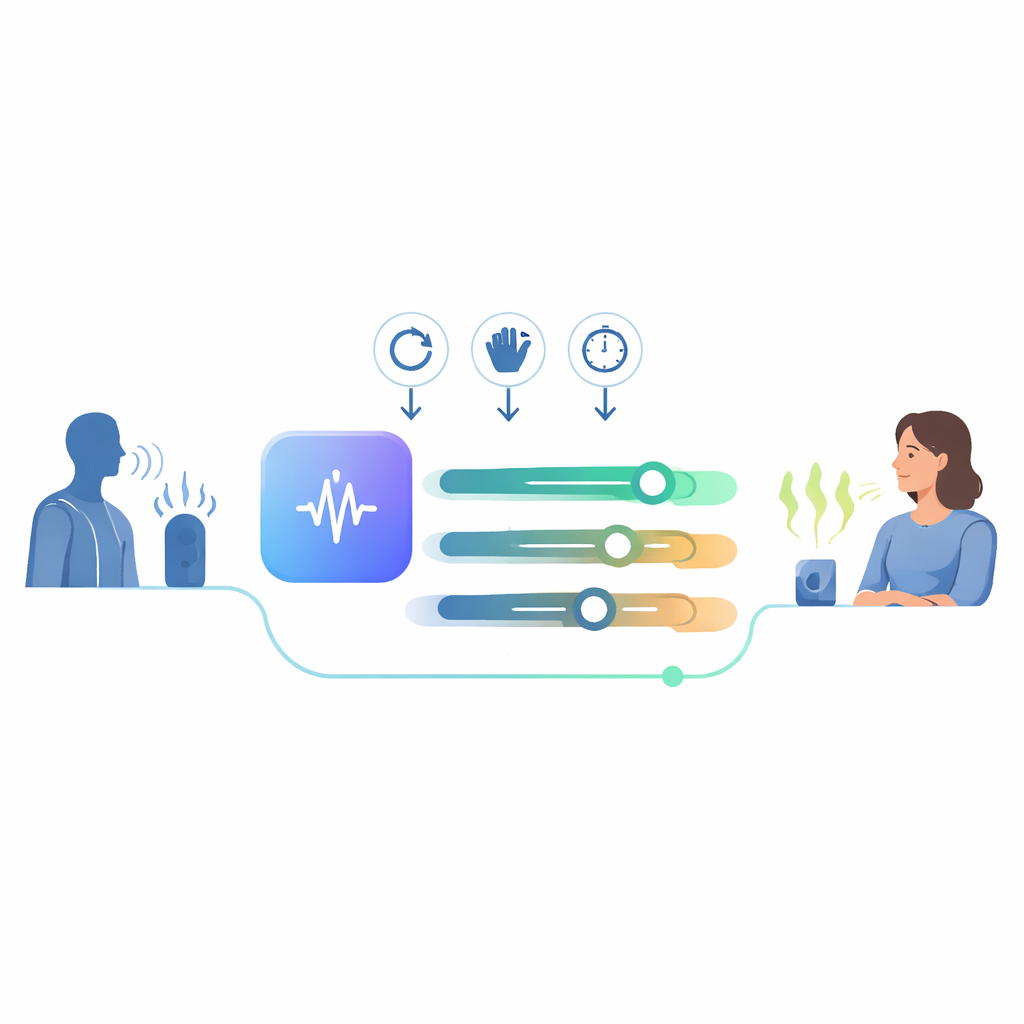

AURA (Adaptive User-Responsive Assistant) foi criada para mudar esse padrão. É um sistema baseado em voz que combina um potente modelo de linguagem — a mesma tecnologia geral por trás de chatbots avançados — com uma forma simples porém inteligente de observar como o usuário se comporta durante uma sessão. Em vez de adivinhar a partir de longos questionários ou perfis fixos, a AURA observa três sinais naturais: com que frequência um usuário repete uma resposta, com que frequência interrompe uma mensagem e quanto tempo ele escuta antes de agir. Essas pistas não exigem hardware adicional, não expõem dados privados como movimentos oculares ou frequência cardíaca e se encaixam naturalmente no modo como as pessoas já usam sistemas falantes.

Como o assistente se adapta em tempo real

Dentro da AURA, a interação ocorre em um ciclo fechado. Primeiro, o usuário fala e suas palavras são transformadas em texto. O sistema então busca um perfil leve que armazena três controles ajustáveis: quão rápido deve falar, quão longas devem ser as respostas e quão simples ou complexa deve soar a linguagem. Esse perfil molda o prompt enviado ao modelo de linguagem, que então gera uma resposta já com o objetivo de corresponder ao estilo atual do usuário. O texto é convertido em fala usando as configurações escolhidas e reproduzido ao usuário. Durante e após essa resposta, a AURA registra discretamente se o usuário repetiu, pulou ou ouviu até o fim, e ajusta o perfil para a próxima interação. Ao longo de algumas trocas, o assistente “acerta” um modo de falar que se encaixa melhor no ouvinte — tudo isso sem que o usuário precise mexer em menus de configuração.

Testando a ideia em um ambiente controlado

Para verificar se essa adaptação baseada em regras realmente se comporta de forma sensata, o pesquisador não começou com voluntários humanos. Em vez disso, o estudo usou perfis de usuário simulados que imitam três padrões comuns: um que repete muito porque tem dificuldade para captar detalhes, outro que pula frequentemente porque as respostas parecem longas demais e um que prefere respostas rápidas e densas. Para cada perfil, o sistema executou muitas sessões curtas com e sem adaptação. O estudo então mediu com que frequência ocorreram repetições e pulos, quanto tempo as tarefas levaram e se as configurações internas do assistente se estabilizaram em um padrão correspondente ao perfil pretendido. Embora não tenham sido aplicadas estatísticas formais — isto era uma verificação de viabilidade em vez de um ensaio completo com usuários — os números mostraram mudanças claras.

O que os primeiros números sugerem

Em condições com muitas repetições, a versão adaptativa da AURA reduziu eventos de repetição em aproximadamente dois terços em comparação com uma configuração fixa e não adaptativa. Em condições com muitos pulos, os pulos diminuíram cerca de metade depois que o sistema aprendeu a tornar as respostas mais curtas e objetivas. Em todos os perfis simulados, o assistente alcançou configurações estáveis que correspondiam ao estilo alvo na maioria das sessões, e completar uma tarefa multi-etapa padrão levou cerca de um quinto a menos de tempo com a adaptação ativada. Importante notar que as regras de adaptação eram simples e transparentes: repetições repetidas empurravam o assistente para fala mais lenta e linguagem mais simples, enquanto pulos frequentes o direcionavam para respostas mais breves e densas. Esse desenho mantém o sistema mais fácil de entender e depurar do que um modelo de aprendizado em caixa-preta — uma preocupação chave para segurança e confiança em tecnologia assistiva.

O que isso significa para pessoas reais

Para leitores fora do mundo acadêmico, a principal conclusão é que computadores falantes podem se tornar ouvintes mais atenciosos. Ao prestar atenção a sinais naturais como “Você repetiu isso?” ou “Você me interrompeu?”, um assistente pode rapidamente aprender a falar de um modo menos frustrante e mais eficiente, especialmente para usuários cegos e com baixa visão que dependem do áudio. O trabalho atual ainda não prova uma experiência melhor no dia a dia, porque foi testado com comportamento gerado por computador em vez de pessoas reais. Mas ele estabelece a base — tanto técnica quanto conceitual — para estudos futuros com usuários cegos, conversas mais ricas e suporte a múltiplos idiomas. Se esses próximos passos tiverem sucesso, ferramentas como a AURA poderiam ajudar a transformar a tecnologia assistiva de máquinas leitoras rígidas em parceiros responsivos que se adaptam em tempo real às pessoas que mais dependem delas.

Citação: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Palavras-chave: acessibilidade para cegos, assistente de voz adaptativo, IA sensível ao comportamento, grandes modelos de linguagem, tecnologia assistiva