Clear Sky Science · de

Ein verhaltensadaptiver KI-Assistent, der die Barrierefreiheit und Nutzbarkeit für blinde Anwender durch personalisierte Echtzeit-Interaktion verbessert

Warum intelligentere Stimmen wichtig sind

Sprechende Computer sind auf unseren Telefonen, Lautsprechern und Laptops zunehmend alltäglich. Für Menschen, die nicht sehen können, sind diese Stimmen jedoch mehr als ein Komfort — sie sind eine Lebensader zu Informationen, Arbeit und täglichen Aufgaben. Dieses Papier stellt AURA vor, eine neue Art von sprechendem Assistenten, der nicht nur darauf hört, was blinde Nutzer sagen, sondern wie sie in Echtzeit reagieren, und dabei seinen eigenen Sprechstil behutsam anpasst, sodass er leichter zu folgen ist und weniger ermüdet.

Alltägliche Werkzeuge, die noch nicht ausreichen

Heutige Screenreader und Sprachassistenten lesen Bildschirminhalte vor oder beantworten Fragen, aber sie sprechen meist alle Nutzer auf dieselbe Weise an. Sie neigen zu einer festen Sprechgeschwindigkeit, bieten entweder zu viele oder zu wenige Details und führen Inhalte in starrer Reihenfolge vor. Für viele blinde Anwender führt dieser „Einheitsansatz“ zu wiederholten Wiedergaben, häufigem Überspringen und mentaler Überlastung, während sie versuchen, mitzuhalten oder Relevantes herauszufiltern. Frühere Forschung hat gezeigt, dass Änderungen von Sprechtempo, Detailgrad und sprachlicher Komplexität einen großen Unterschied machen können, doch die meisten Werkzeuge passen sich während eines Gesprächs nicht automatisch an.

Eine neue Form des Zuhörens

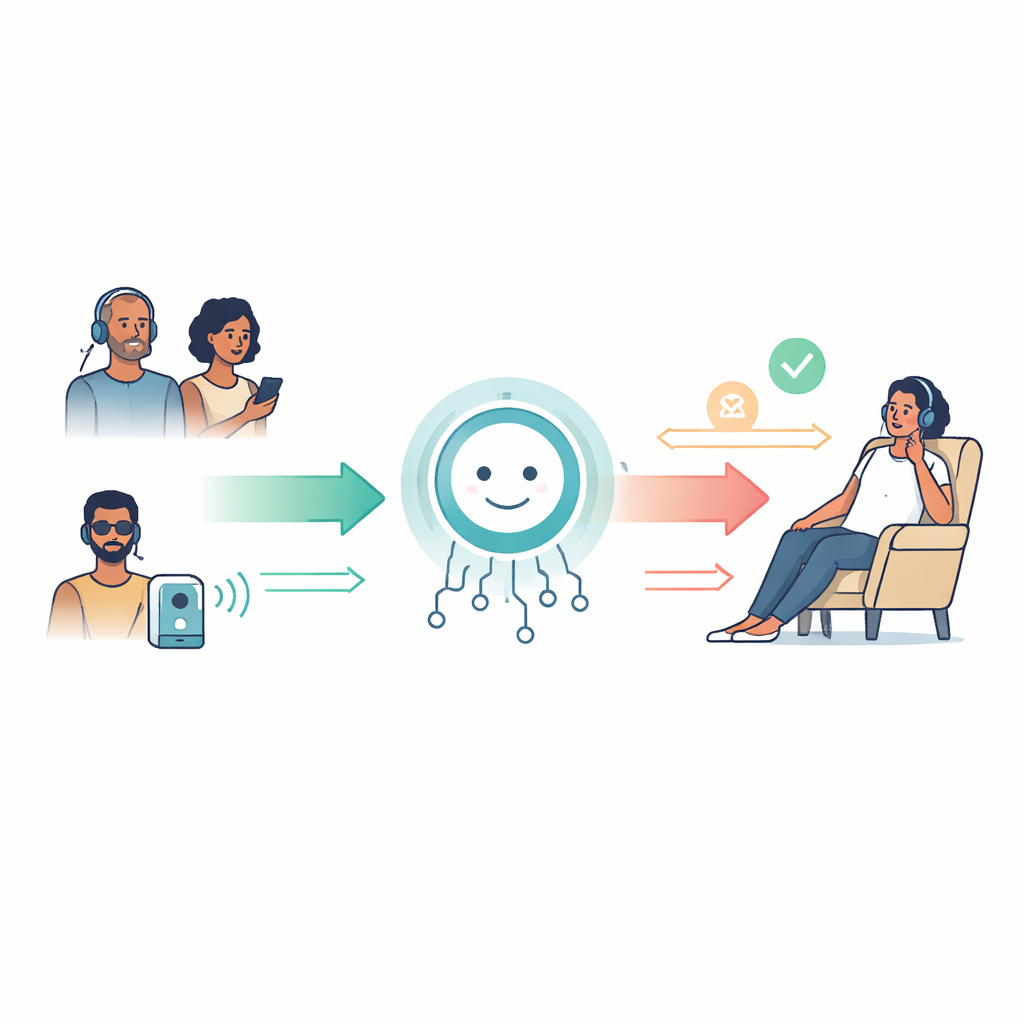

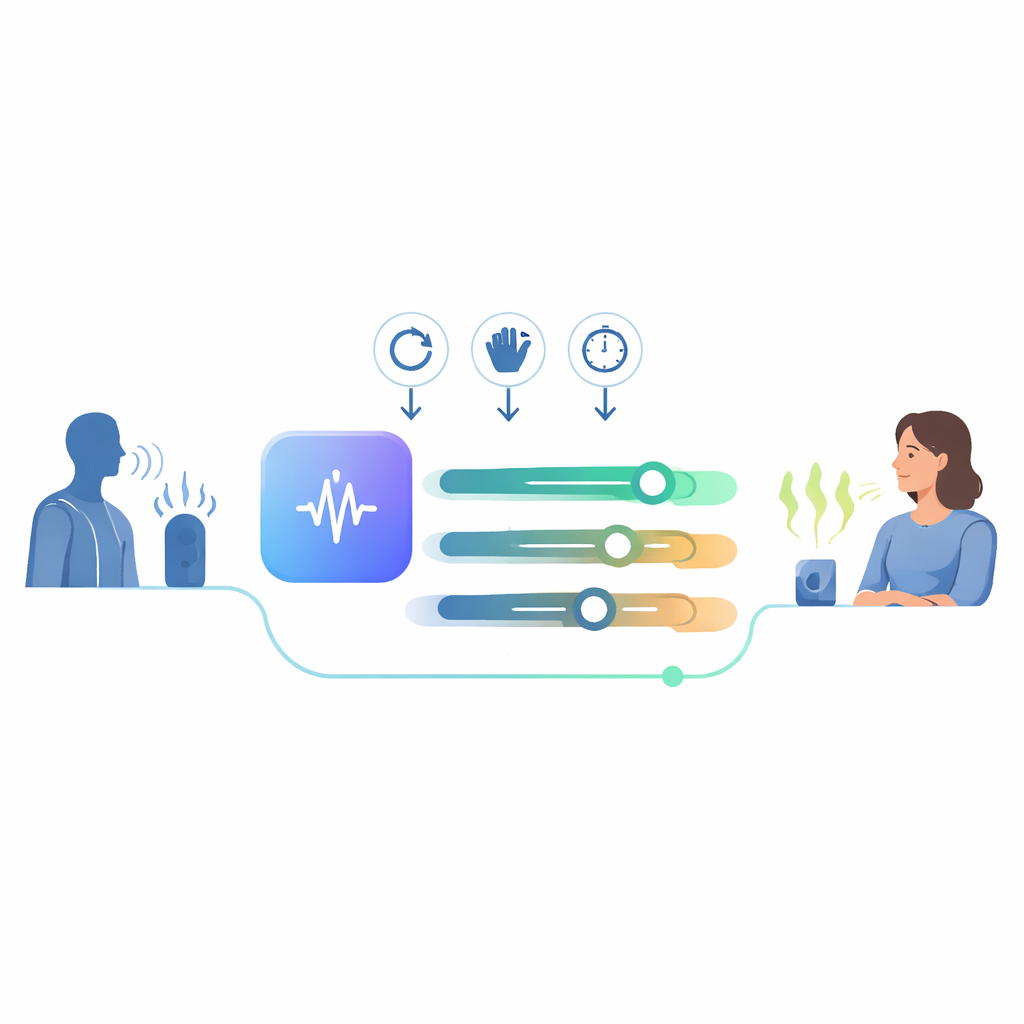

AURA (Adaptive User-Responsive Assistant) wurde entwickelt, um dieses Muster zu durchbrechen. Es ist ein sprachbasiertes System, das ein leistungsfähiges Sprachmodell — dieselbe generelle Technologie hinter fortgeschrittenen Chatbots — mit einer einfachen, aber intelligenten Beobachtung des Nutzerverhaltens während einer Sitzung kombiniert. Anstatt aus langen Umfragen oder festen Nutzerprofilen zu schließen, achtet AURA auf drei natürliche Signale: wie oft ein Nutzer eine Antwort erneut abspielt, wie oft er eine Nachricht abbricht, und wie lange er zuhört, bevor er handelt. Diese Hinweise benötigen keine zusätzliche Hardware, geben keine privaten Daten wie Augenbewegungen oder Herzfrequenz preis und fügen sich natürlich in die bestehende Nutzung sprechender Systeme ein.

Wie sich der Assistent in Echtzeit anpasst

Innerhalb von AURA läuft die Interaktion in einer geschlossenen Schleife ab. Zuerst spricht der Nutzer, und seine Worte werden in Text umgewandelt. Das System ruft dann ein leichtgewichtiges Profil ab, das drei einstellbare Regler speichert: wie schnell gesprochen werden soll, wie lang die Antworten sein sollen und wie einfach oder komplex die Sprache klingen soll. Dieses Profil formt die Eingabe an das Sprachmodell, das daraufhin eine Antwort erstellt, die bereits auf den aktuellen Stil des Nutzers abgestimmt ist. Der Text wird mit den gewählten Einstellungen in Sprache umgewandelt und dem Nutzer vorgespielt. Während und nach dieser Antwort protokolliert AURA unaufdringlich, ob der Nutzer erneut abspielt, überspringt oder durchhört, und passt das Profil für den nächsten Zug an. Nach einigen Austauschzyklen „findet“ der Assistent eine Sprechweise, die besser zum Zuhörenden passt — ganz ohne dass der Nutzer Einstellungen in Menüs ändern muss.

Die Idee in einer sicheren Sandbox testen

Um zu prüfen, ob diese regelbasierte Anpassung sinnvoll funktioniert, begann die Studie nicht mit menschlichen Freiwilligen. Stattdessen verwendete die Untersuchung simulierte Nutzerprofile, die drei häufige Muster nachbilden: eines, das viele Wiedergaben verursacht, weil Details schwer zu erfassen sind; eines, das häufig überspringt, weil Antworten zu lang wirken; und eines, das schnelle, dichte Antworten bevorzugt. Für jedes Profil führte das System viele kurze Sitzungen mit und ohne Anpassung durch. Gemessen wurde, wie oft Wiedergaben und Übersprünge auftraten, wie lange Aufgaben dauerten und ob die internen Einstellungen des Assistenten in ein stabiles Muster übergingen, das dem Zielprofil entsprach. Zwar wurden keine formalen statistischen Tests durchgeführt — es handelte sich um eine Machbarkeitsprüfung und nicht um eine vollständige Nutzerstudie — doch die Zahlen zeigten deutliche Verschiebungen.

Was die ersten Zahlen nahelegen

Unter wiedergabeintensiven Bedingungen reduzierte die adaptive Version von AURA Wiedergabeereignisse um etwa zwei Drittel verglichen mit einer festen, nicht adaptiven Konfiguration. In überspring-intensiven Bedingungen sanken die Übersprünge um etwa die Hälfte, sobald das System gelernt hatte, Antworten kürzer und prägnanter zu halten. Über alle simulierten Profile hinweg erreichte der Assistent in den meisten Sitzungen stabile Einstellungen, die dem Zielstil entsprachen, und das Abschließen einer standardisierten mehrstufigen Aufgabe dauerte mit aktivierter Anpassung etwa ein Fünftel weniger Zeit. Wichtig ist, dass die Anpassungsregeln einfach und transparent waren: Wiederholte Wiedergaben lenkten den Assistenten zu langsamerer Sprechweise und einfacherer Sprache, während häufige Übersprünge ihn zu kürzeren, dichten Antworten führten. Dieses Design macht das System leichter verständlich und nachvollziehbar als ein undurchsichtiger Black-Box-Lernansatz — ein zentraler Aspekt für Sicherheit und Vertrauen in Hilfstechnologien.

Was das für reale Menschen bedeutet

Für Leser außerhalb der Forschungswelt ist die wichtigste Erkenntnis, dass sprechende Computer zu aufmerksamerem Zuhören fähig werden können. Indem ein Assistent auf natürliche Signale wie „Hast du das erneut abgespielt?“ oder „Hast du mich unterbrochen?“ achtet, kann er schnell lernen, in einer Weise zu sprechen, die weniger frustrierend und effizienter ist — besonders für blinde und sehbehinderte Nutzer, die auf Audio angewiesen sind. Die vorliegende Arbeit beweist noch nicht ein besseres Alltagserlebnis, da sie mit computergeneriertem Verhalten statt mit realen Personen getestet wurde. Sie schafft jedoch die technische und konzeptionelle Grundlage für zukünftige Studien mit blinden Nutzern, reichere Gespräche und Mehrsprachenunterstützung. Gelingen diese nächsten Schritte, könnten Werkzeuge wie AURA die Hilfstechnologie von starren, einseitigen Vorlesemaschinen zu reaktionsfähigen Partnern weiterentwickeln, die sich in Echtzeit an die Menschen anpassen, die am meisten auf sie angewiesen sind.

Zitation: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Schlüsselwörter: Barrierefreiheit für Blinde, adaptiver Sprachassistent, verhaltensbewusste KI, große Sprachmodelle, Hilfstechnologie