Clear Sky Science · ja

視覚障害者のためのリアルタイム対話パーソナライズによりアクセシビリティと使いやすさを高める行動適応型AIアシスタント

なぜ賢い声が重要なのか

話すコンピュータは携帯電話やスピーカー、ノートパソコンに広がりつつあります。しかし視覚を失った人々にとって、これらの音声は単なる利便性を超え、情報、仕事、日常業務へとつながる生命線です。本論文はAURAを紹介します。AURAは、視覚障害者が何を言うかだけでなく、リアルタイムでどのように反応するかにも注意を払い、自らの話し方を穏やかに調整して聞き取りやすく疲れにくい形にすることを目指した新しい種類の音声アシスタントです。

日常的なツールがまだ十分でない理由

現在のスクリーンリーダーや音声アシスタントは画面を読み上げたり質問に答えたりしますが、たいてい全員に対して同じ話し方をします。固定された話速で話し、情報量が多すぎたり少なすぎたりし、順序通りに淡々と進める傾向があります。多くの視覚障害者にとって、この「ワンサイズ・フィッツ・オール」方式は、重要な部分を追いかけるための再生の繰り返しや頻繁なスキップ、そして認知的負荷を招きます。過去の研究では、話速、説明の詳細度、言語の複雑さを変えることが大きな違いを生むことが示されていますが、多くのツールはいまだ会話の進行に合わせて自動的に調整しません。

新しい聞き方

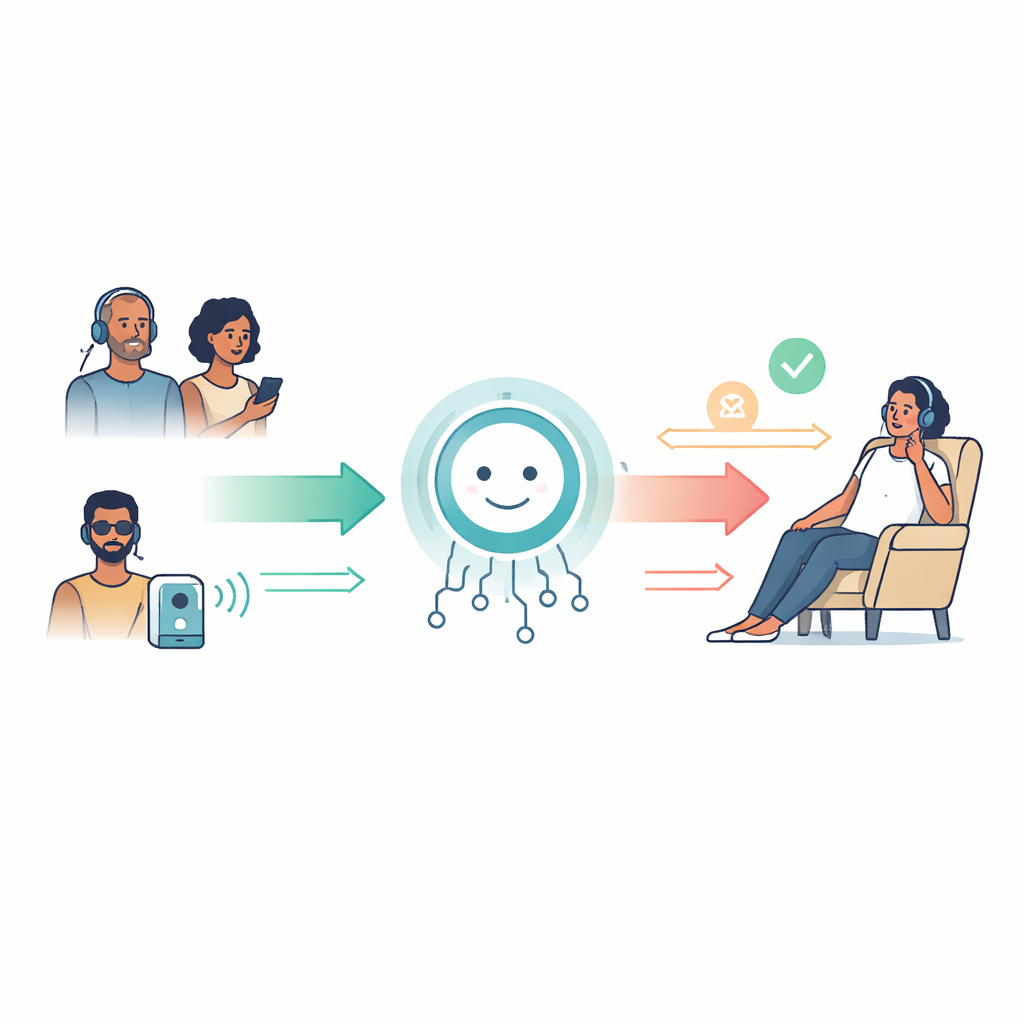

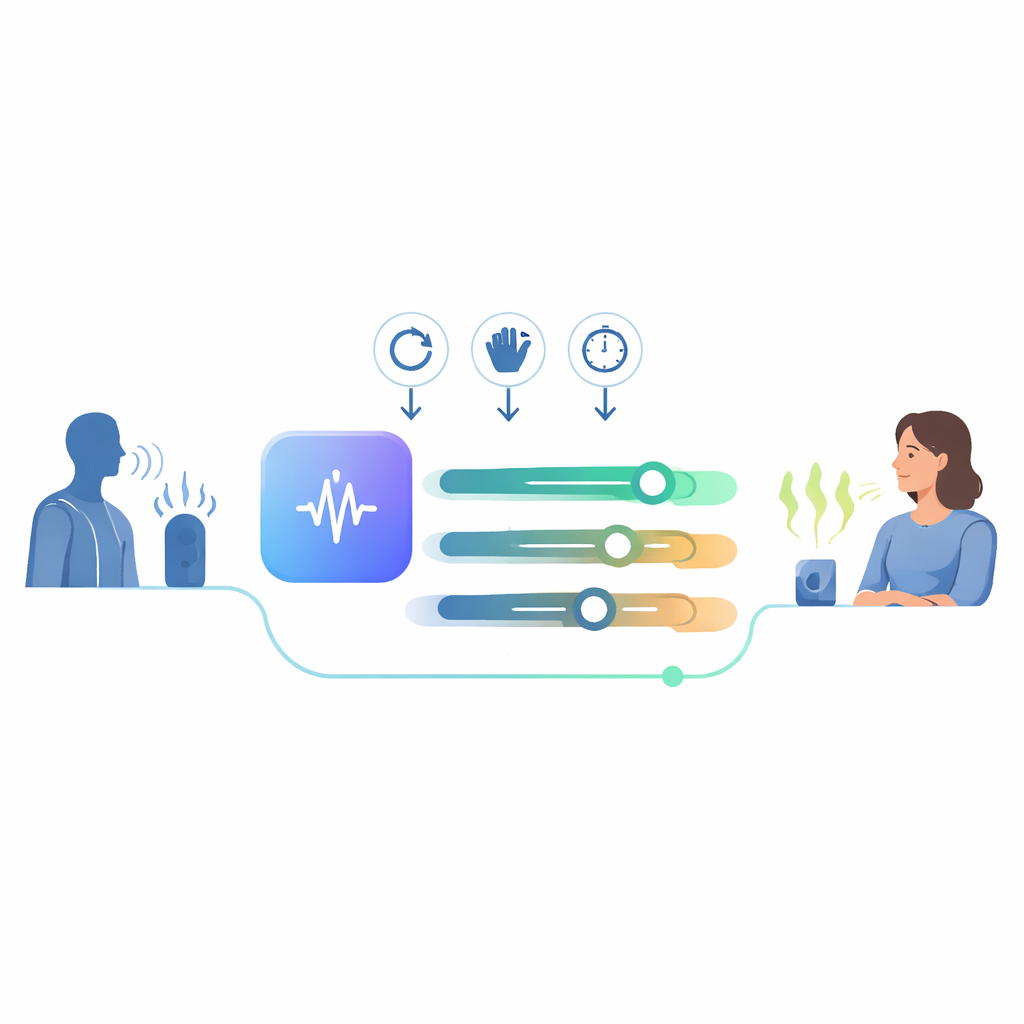

AURA(Adaptive User-Responsive Assistant)はそのパターンを変えるために設計されました。これは音声ベースのシステムで、高度なチャットボットの背後にあるのと同様の強力な言語モデルと、セッション中のユーザー行動を監視するシンプルだが賢い手法を組み合わせています。長いアンケートや固定プロフィールから推測する代わりに、AURAは三つの自然な信号を観察します:ユーザーが応答をどれだけ再生するか、メッセージをどれだけ途中で遮るか、そして行動するまでにどれくらい聞くか。これらの手がかりは追加ハードウェアを必要とせず、視線や心拍数のようなプライベートなデータをさらすこともなく、人々が既に音声システムを使う流れに自然に組み込めます。

アシスタントが即時に適応する仕組み

AURAの内部では、対話が閉ループで進行します。まずユーザーが話し、その言葉はテキストに変換されます。システムは次に、三つの調整可能なダイヤルを格納した軽量なプロファイルを取得します:話す速さ、応答の長さ、言語の単純さまたは複雑さです。このプロファイルは言語モデルに送るプロンプトの形を決め、言語モデルはユーザーの現在のスタイルに合うことを目指した応答を生成します。生成されたテキストは選択された設定で音声に変換されユーザーに再生されます。応答の途中および応答後に、AURAはユーザーが再生したか、スキップしたか、最後まで聞いたかを密かに記録し、次のターンに向けてプロファイルを微調整します。数回のやり取りで、アシスタントはユーザーにより合った話し方に「収束」していきます—ユーザーが設定メニューを変更する必要はありません。

安全なサンドボックスでアイデアを検証する

このルールベースの適応が実際に妥当な振る舞いをするかを確認するために、研究者はまず人間の参加者から始めませんでした。代わりに、研究では三つの一般的なパターンを模したシミュレートされたユーザープロファイルを使用しました:詳細を聞き取るのに苦労して多く再生するタイプ、応答が長すぎると感じて頻繁にスキップするタイプ、速く密度の高い応答を好むタイプです。各プロファイルについて、システムは適応あり/なしの短いセッションを多数実行しました。研究では再生やスキップの頻度、タスク完了時間、アシスタントの内部設定が意図したプロファイルに一致する安定したパターンに収束したかを測定しました。公式な統計解析は行われませんでした—これは本格的なユーザートライアルではなく実現可能性の確認でした—が、数値は明確な変化を示しました。

初期の数字が示唆すること

再生が多い条件下では、適応型AURAは固定で非適応のセットアップと比べて再生イベントをおよそ3分の1に削減しました。スキップが多い条件では、システムが応答を短く簡潔にすることを学習するとスキップが約半分に減りました。すべてのシミュレートされたプロファイルにわたり、アシスタントは多くのセッションでターゲットスタイルに一致する安定した設定に到達し、標準的な多段階タスクの完了時間は適応を有効にした場合に約5分の1短縮されました。重要なのは、適応ルールがシンプルで透明であったことです:繰り返される再生はアシスタントをよりゆっくりで単純な言語へと促し、頻繁なスキップはより簡潔で密度の高い応答へと促しました。この設計はブラックボックスの学習モデルより理解やデバッグが容易であり、支援技術における安全性と信頼性の観点で重要です。

これが実際の人々に意味すること

研究の世界の外にいる読者への主な要点は、話すコンピュータがより配慮ある聞き手になり得るということです。「それを再生しましたか?」や「話を途中で遮りましたか?」のような自然な信号に注意を払うことで、アシスタントは特に音声に依存する視覚障害者にとって、よりフラストレーションが少なく効率的な話し方を素早く学べます。本研究はまだ日常体験の改善を実証するものではありません。なぜなら実験は実際の人間ではなくコンピュータ生成の振る舞いで行われたからです。しかしこれは、視覚障害者を対象とした将来の研究、より豊かな会話、多言語対応のための技術的・概念的基盤を築くものです。これらの次のステップが成功すれば、AURAのようなツールは支援技術を硬直した一方通行の読み上げ機から、利用者に即時に適応する応答的なパートナーへと変える助けとなる可能性があります。

引用: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

キーワード: 視覚障害者のアクセシビリティ, 適応型音声アシスタント, 行動認識AI, 大規模言語モデル, 支援技術