Clear Sky Science · nl

Een gedrag-adaptieve AI-assistent die toegankelijkheid en bruikbaarheid voor blinde gebruikers verbetert via realtime personalisatie van interacties

Waarom slimmer spreken ertoe doet

Pratende computers komen steeds vaker voor in onze telefoons, luidsprekers en laptops. Maar voor mensen die niet kunnen zien zijn deze stemmen meer dan een gemak—ze vormen een levensader naar informatie, werk en dagelijkse taken. Dit artikel introduceert AURA, een nieuw soort spraakassistent die niet alleen luistert naar wat blinde gebruikers zeggen, maar ook naar hoe ze in realtime reageren, en zodoende op subtiele wijze haar spreekstijl aanpast zodat het makkelijker te volgen is en minder vermoeiend om te gebruiken.

Alledaagse hulpmiddelen die nog tekortschieten

Huidige schermlezers en spraakassistenten lezen schermen voor of beantwoorden vragen, maar ze spreken meestal iedereen op dezelfde manier toe. Ze hanteren vaak een vaste spreeksnelheid, geven óf te veel óf te weinig details en werken inhoud af in een starre volgorde. Voor veel blinde gebruikers leidt deze ’one size fits all’-benadering tot herhaalde herhalingen, frequente overslagen en mentale overbelasting terwijl ze proberen bij te blijven of te achterhalen wat belangrijk is. Eerdere onderzoeken tonen aan dat variatie in spreeksnelheid, detailniveau en taalkundige complexiteit veel kan veranderen, maar de meeste hulpmiddelen passen zich niet automatisch aan terwijl een gesprek verloopt.

Een nieuwe manier van luisteren

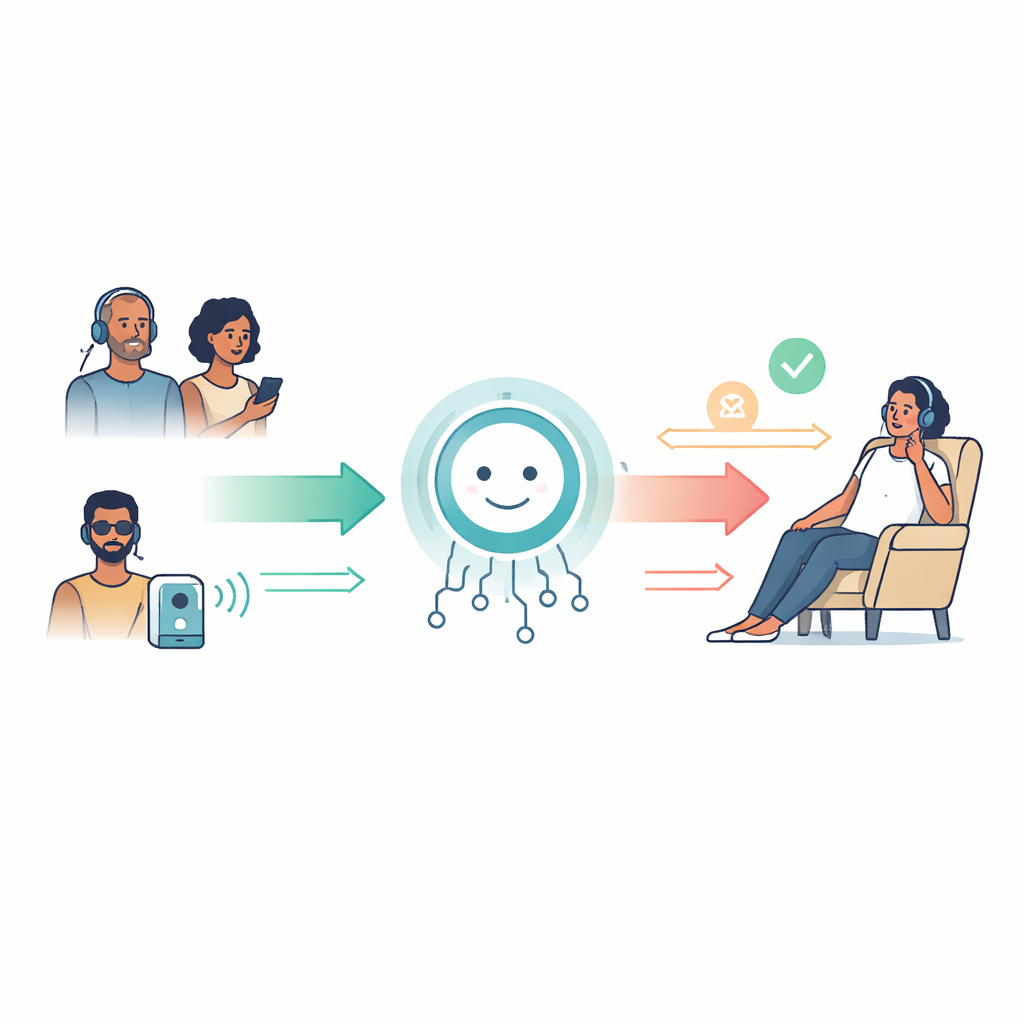

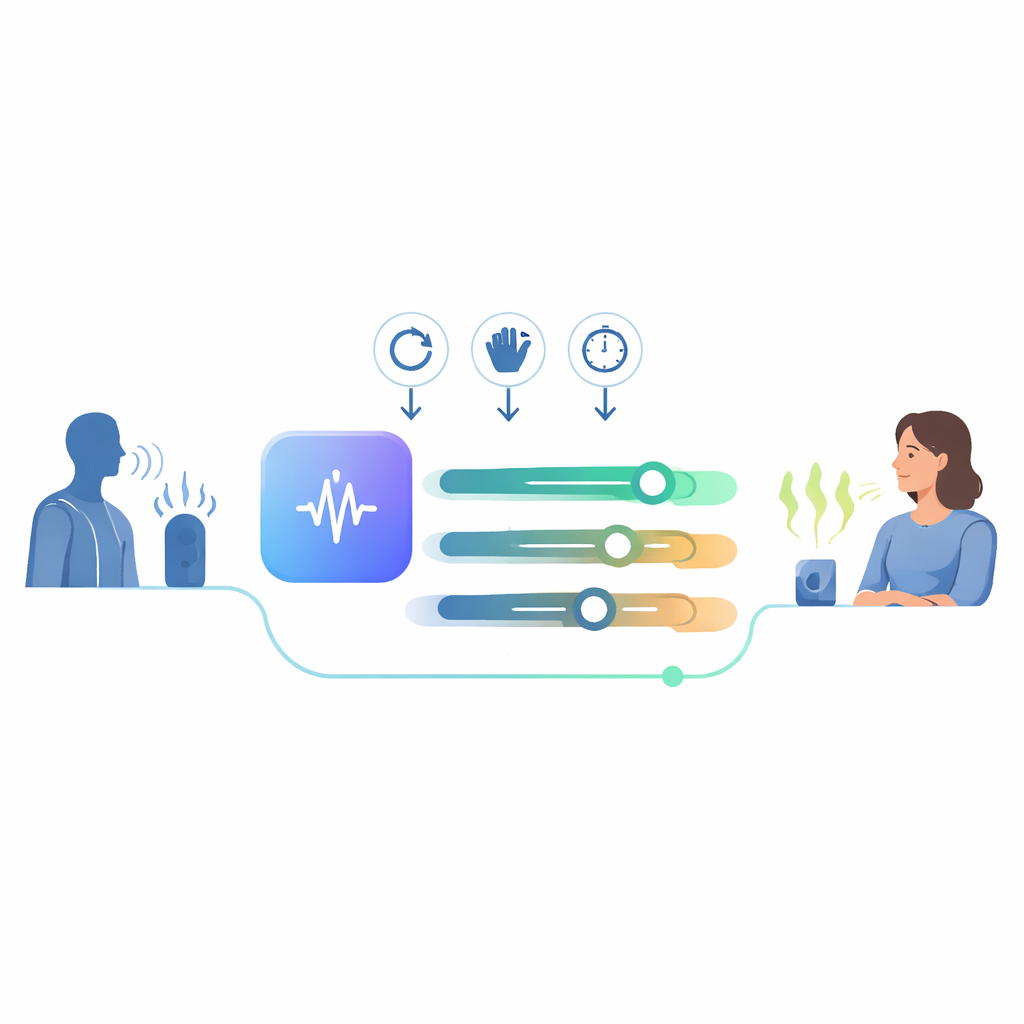

AURA (Adaptive User-Responsive Assistant) is gebouwd om dat patroon te doorbreken. Het is een spraakgestuurd systeem dat een krachtig taalmodel—dezelfde algemene technologie achter geavanceerde chatbots—combineert met een eenvoudige maar slimme manier om te observeren hoe een gebruiker zich tijdens een sessie gedraagt. In plaats van te raden op basis van lange vragenlijsten of vaste gebruikersprofielen, let AURA op drie natuurlijke signalen: hoe vaak een gebruiker een antwoord opnieuw afspeelt, hoe vaak zij een bericht afkappen, en hoe lang ze luisteren voordat ze actie ondernemen. Deze aanwijzingen vereisen geen extra hardware, onthullen geen privégegevens zoals oogbewegingen of hartslag, en passen natuurlijk in hoe mensen al gebruikmaken van spraaksystemen.

Hoe de assistent zich direct aanpast

Binnen AURA verloopt de interactie in een gesloten lus. Eerst spreekt de gebruiker, en worden die woorden omgezet in tekst. Het systeem haalt vervolgens een lichtgewicht profiel op dat drie instelbare knoppen bevat: hoe snel het moet spreken, hoe lang de antwoorden moeten zijn, en hoe eenvoudig of complex de taal moet klinken. Dit profiel vormt de prompt die naar het taalmodel wordt gestuurd, dat vervolgens een antwoord genereert dat al gericht is op de huidige stijl van de gebruiker. De tekst wordt omgezet in spraak met de gekozen instellingen en afgespeeld voor de gebruiker. Tijdens en na dit antwoord registreert AURA stilletjes of de gebruiker opnieuw afspeelt, overslaat of tot het einde luistert, en past het profiel aan voor de volgende beurt. Over een paar uitwisselingen ‘scherpt’ de assistent zich in op een spreekwijze die beter bij de luisteraar past—zonder dat de gebruiker instellingen hoeft te wijzigen in menu’s.

Het idee testen in een veilige sandbox

Om te onderzoeken of deze regelgebaseerde aanpassing zich daadwerkelijk verstandig gedraagt, begon de onderzoeker niet met menselijke proefpersonen. In plaats daarvan gebruikte de studie gesimuleerde gebruikersprofielen die drie veelvoorkomende patronen nabootsen: één die veel opnieuw afspeelt omdat het moeite heeft details te vangen, één die veel overslaat omdat antwoorden te lang aanvoelen, en één die snelle, compacte antwoorden prefereert. Voor elk profiel draaide het systeem veel korte sessies met en zonder adaptatie. De studie mat vervolgens hoe vaak opnieuw afspelen en overslaan voorkwamen, hoe lang taken duurden en of de interne instellingen van de assistent stabiliseerden naar een patroon dat bij het bedoelde profiel paste. Hoewel er geen formele statistische tests werden uitgevoerd—dit was een haalbaarheidscheck en geen volledige gebruikerstest—lieten de cijfers duidelijke verschuivingen zien.

Wat de vroege cijfers suggereren

Onder omstandigheden met veel herhalingen verminderde de adaptieve versie van AURA het aantal herhalingsgebeurtenissen met ongeveer twee derde vergeleken met een vaste, niet-adaptieve opzet. In omstandigheden met veel overslagen daalden de overslagen met ongeveer de helft zodra het systeem leerde antwoorden korter en bondiger te houden. Over alle gesimuleerde profielen bereikte de assistent in de meeste sessies stabiele instellingen die bij de doelstijl pasten, en het voltooien van een standaard meerstappentaak nam ongeveer een vijfde minder tijd in beslag met adaptatie ingeschakeld. Belangrijk is dat de aanpassingsregels eenvoudig en transparant waren: herhaalde herhalingen duwden de assistent naar langzamere spraak en eenvoudigere taal, terwijl frequente overslagen hem richting kortere, compactere antwoorden duwden. Dit ontwerp houdt het systeem makkelijker te begrijpen en te debuggen dan een black-box leermodel—aangezien veiligheid en vertrouwen sleutelzorgen zijn bij hulpmiddelentechnologie.

Wat dit betekent voor echte mensen

Voor lezers buiten de onderzoekswereld is de belangrijkste conclusie dat pratende computers meer overwegende luisteraars kunnen worden. Door te letten op natuurlijke signalen zoals “Heb je dat opnieuw afgespeeld?” of “Heb je me afgekapt?”, kan een assistent snel leren te spreken op een manier die minder frustrerend en efficiënter is, vooral voor blinde en visueel beperkte gebruikers die afhankelijk zijn van audio. Het huidige werk bewijst nog niet dat de dagelijkse ervaring daadwerkelijk beter wordt, omdat het getest is met computergestuurd gedrag in plaats van echte mensen. Maar het legt de technische en conceptuele basis voor toekomstige studies met blinde gebruikers, rijkere gesprekken en ondersteuning in meerdere talen. Als deze volgende stappen slagen, zouden hulpmiddelen zoals AURA kunnen helpen om assistentietechnologie te verschuiven van starre, éénrichtings voorleesmachines naar responsieve partners die zich realtime aanpassen aan de mensen die het meest op hen steunen.

Bronvermelding: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Trefwoorden: toegankelijkheid voor blinden, adaptieve spraakassistent, gedragsbewuste AI, grote taalmodellen, hulpmiddelentechnologie