Clear Sky Science · fr

Un assistant IA adaptatif au comportement améliorant l’accessibilité et l’utilisabilité pour les personnes aveugles grâce à une personnalisation en temps réel des interactions

Pourquoi des voix plus intelligentes comptent

Les ordinateurs parlants se répandent dans nos téléphones, enceintes et ordinateurs portables. Mais pour les personnes qui ne voient pas, ces voix sont plus qu’une commodité : elles constituent un lien vital vers l’information, le travail et les tâches quotidiennes. Cet article présente AURA, un nouveau type d’assistant vocal conçu pour écouter non seulement ce que disent les utilisateurs aveugles, mais aussi la façon dont ils réagissent en temps réel, ajustant progressivement son style de parole pour devenir plus facile à suivre et moins fatigant à utiliser.

Des outils quotidiens qui restent insuffisants

Les lecteurs d’écran et assistants vocaux actuels lisent les écrans ou répondent aux questions, mais ils s’adressent généralement à tout le monde de la même manière. Ils ont tendance à parler à une vitesse fixe, à fournir soit trop soit trop peu de détails, et à dérouler le contenu dans un ordre strict. Pour de nombreux utilisateurs aveugles, cette approche « taille unique » entraîne des réécoutes répétées, des sauts fréquents et une surcharge mentale lorsqu’ils essaient de suivre ou d’extraire l’essentiel. Des travaux antérieurs ont montré que modifier la vitesse de parole, la quantité de détails et la complexité du langage peut faire une grande différence, pourtant la plupart des outils ne s’ajustent pas automatiquement au fil d’une conversation.

Une nouvelle manière d’écouter

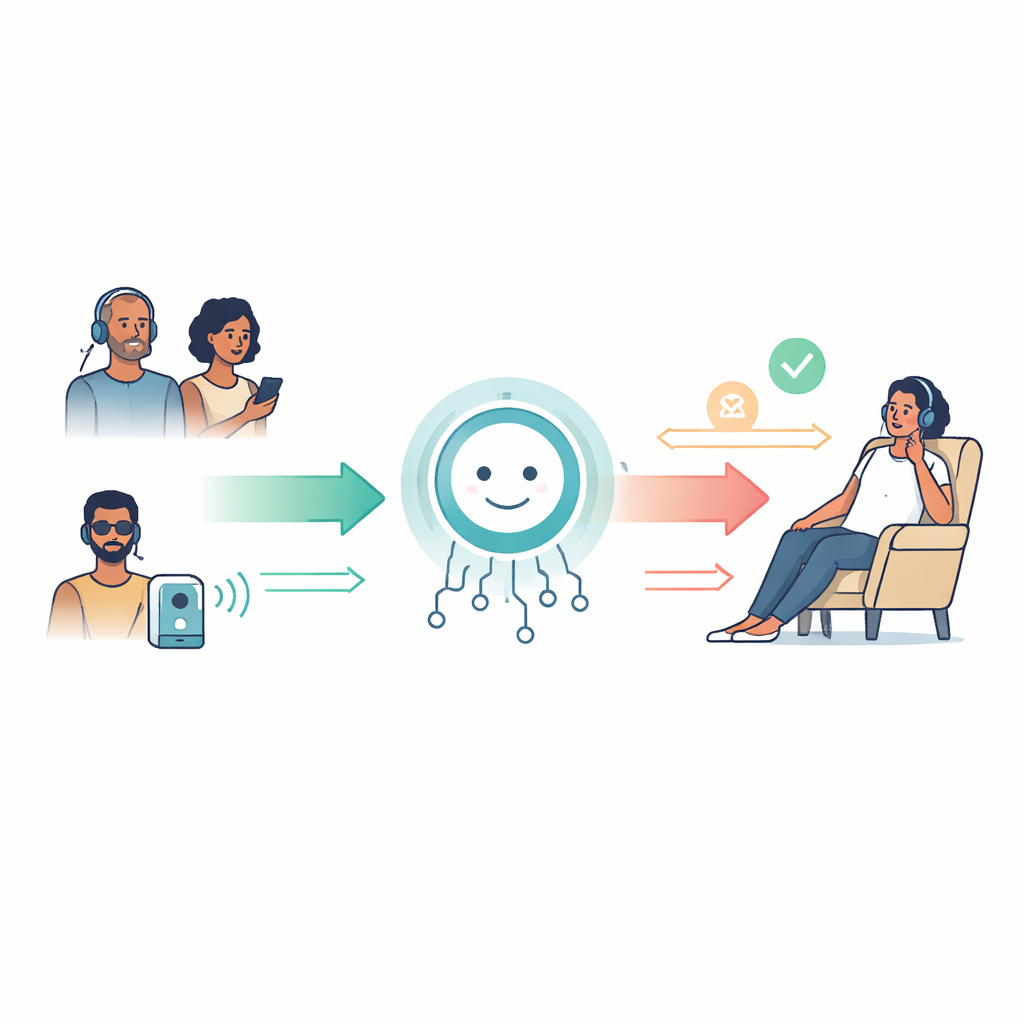

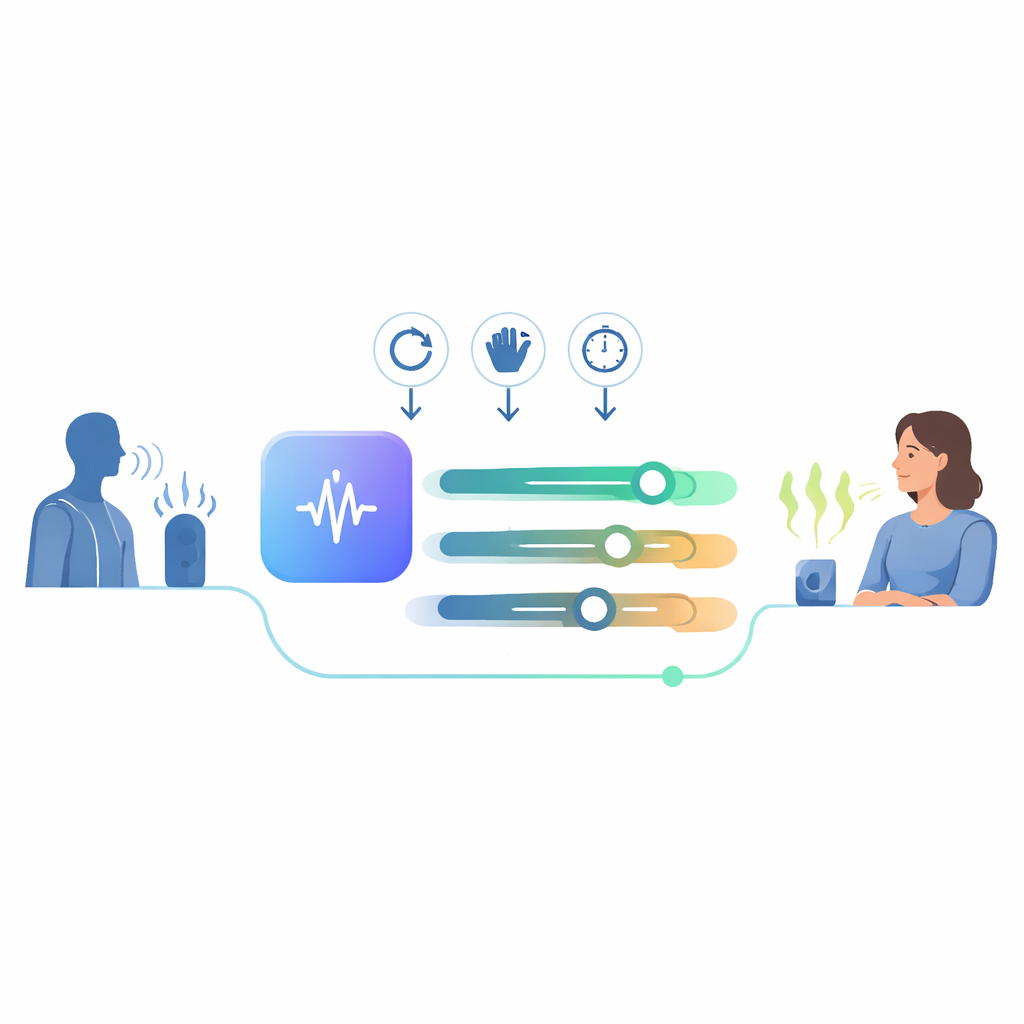

AURA (Adaptive User-Responsive Assistant) a été conçue pour changer ce schéma. C’est un système vocal qui combine un puissant modèle de langage — la même technologie générale que celle des chatbots avancés — avec une méthode simple mais intelligente d’observation du comportement de l’utilisateur pendant une session. Plutôt que de se baser sur de longues enquêtes ou des profils fixes, AURA observe trois signaux naturels : la fréquence de réécoute d’une réponse, la fréquence à laquelle l’utilisateur interrompt un message, et la durée d’écoute avant d’agir. Ces indices ne nécessitent aucun matériel supplémentaire, n’exposent pas de données privées comme les mouvements oculaires ou le rythme cardiaque, et s’intègrent naturellement à l’usage courant des systèmes vocaux.

Comment l’assistant s’adapte en temps réel

Dans AURA, l’interaction fonctionne en boucle fermée. D’abord, l’utilisateur parle et ses mots sont transcrits en texte. Le système récupère ensuite un profil léger qui contient trois réglages ajustables : la vitesse de parole, la longueur des réponses et la simplicité ou la complexité du langage. Ce profil façonne l’invite envoyée au modèle de langage, qui génère alors une réponse déjà calibrée pour correspondre au style courant de l’utilisateur. Le texte est converti en parole selon les paramètres choisis et restitué à l’utilisateur. Pendant et après cette réponse, AURA enregistre discrètement si l’utilisateur réécoute, saute ou écoute jusqu’au bout, puis ajuste le profil pour le tour suivant. Après quelques échanges, l’assistant converge vers un mode d’expression mieux adapté à l’auditeur — sans que celui-ci ait à modifier des menus de paramètres.

Tester l’idée en environnement sécurisé

Pour vérifier si cette adaptation fondée sur des règles se comportait de façon sensée, le chercheur n’a pas commencé par des volontaires humains. L’étude a utilisé des profils d’utilisateurs simulés qui reproduisent trois comportements courants : un profil qui réécoute beaucoup car il a du mal à saisir les détails, un profil qui saute fréquemment les réponses car elles semblent trop longues, et un profil qui préfère des réponses rapides et denses. Pour chaque profil, le système a exécuté de nombreuses sessions courtes avec et sans adaptation. L’étude a ensuite mesuré la fréquence des réécoutes et des sauts, la durée des tâches, et si les réglages internes de l’assistant se stabilisaient dans un schéma correspondant au profil visé. Bien qu’aucune statistique formelle n’ait été réalisée — il s’agissait d’un contrôle de faisabilité plutôt que d’un essai utilisateur complet — les chiffres ont montré des variations nettes.

Ce que suggèrent les premiers chiffres

Dans les conditions où les réécoutes étaient fréquentes, la version adaptative d’AURA a réduit les événements de réécoute d’environ deux tiers par rapport à une configuration fixe non adaptative. Dans les conditions où les sauts dominaient, les sauts ont diminué d’environ moitié une fois que le système a appris à rendre les réponses plus courtes et plus ciblées. Pour l’ensemble des profils simulés, l’assistant a atteint des réglages stables correspondant au style ciblé dans la plupart des sessions, et l’exécution d’une tâche multi-étapes standard a pris environ un cinquième de temps en moins avec l’adaptation activée. Fait important, les règles d’adaptation étaient simples et transparentes : des réécoutes répétées poussaient l’assistant vers une parole plus lente et un langage plus simple, tandis que des sauts fréquents le poussaient vers des réponses plus brèves et plus denses. Ce choix de conception rend le système plus facile à comprendre et à déboguer qu’un modèle d’apprentissage « boîte noire », ce qui est crucial pour la sécurité et la confiance dans les technologies d’assistance.

Ce que cela implique pour les personnes réelles

Pour les lecteurs hors du milieu de la recherche, l’essentiel est que les ordinateurs parlants peuvent devenir des auditeurs plus attentifs. En prêtant attention à des signaux naturels comme « Avez-vous réécouté cela ? » ou « M’avez-vous interrompu ? », un assistant peut rapidement apprendre à s’exprimer d’une manière moins frustrante et plus efficace, en particulier pour les utilisateurs aveugles et malvoyants qui dépendent de l’audio. Le travail actuel ne prouve pas encore une meilleure expérience quotidienne, car il a été testé avec des comportements générés par ordinateur plutôt qu’avec de vraies personnes. Mais il jette les bases — techniques et conceptuelles — pour des études futures avec des usagers aveugles, des conversations plus riches et un support multilingue. Si ces prochaines étapes réussissent, des outils comme AURA pourraient faire passer les technologies d’assistance de machines de lecture rigides et unidirectionnelles à des partenaires réactifs qui s’adaptent en temps réel aux personnes qui comptent le plus sur eux.

Citation: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Mots-clés: accessibilité pour personnes aveugles, assistant vocal adaptatif, IA sensible au comportement, grands modèles de langage, technologie d’assistance