Clear Sky Science · it

Un assistente IA adattivo al comportamento che migliora accessibilità e usabilità per utenti non vedenti tramite personalizzazione dell’interazione in tempo reale

Perché le voci più intelligenti contano

I computer parlanti stanno diventando comuni nei nostri telefoni, altoparlanti e laptop. Ma per chi non può vedere, queste voci sono più di una comodità: sono un’ancora di salvezza per l’informazione, il lavoro e le attività quotidiane. Questo articolo presenta AURA, un nuovo tipo di assistente vocale progettato per ascoltare non solo ciò che gli utenti non vedenti dicono, ma anche come reagiscono in tempo reale, rimodellando delicatamente il proprio stile di parola in modo da diventare più facile da seguire e meno faticoso da usare.

Strumenti quotidiani che ancora non bastano

I lettori di schermo e gli assistenti vocali di oggi leggono gli schermi o rispondono alle domande, ma solitamente parlano a tutti nello stesso modo. Tendono a mantenere una velocità fissa, offrono dettagli troppo numerosi o troppo scarsi e percorrono i contenuti in un ordine rigido. Per molti utenti non vedenti, questo approccio “taglia unica” porta a riascolti ripetuti, salti frequenti e sovraccarico mentale mentre cercano di tenere il passo o di estrarre ciò che conta. Ricerche precedenti hanno mostrato che modificare la velocità di parola, la quantità di dettagli e la complessità del linguaggio può fare una grande differenza, eppure la maggior parte degli strumenti non si adatta automaticamente mentre una conversazione si svolge.

Un nuovo modo di ascoltare

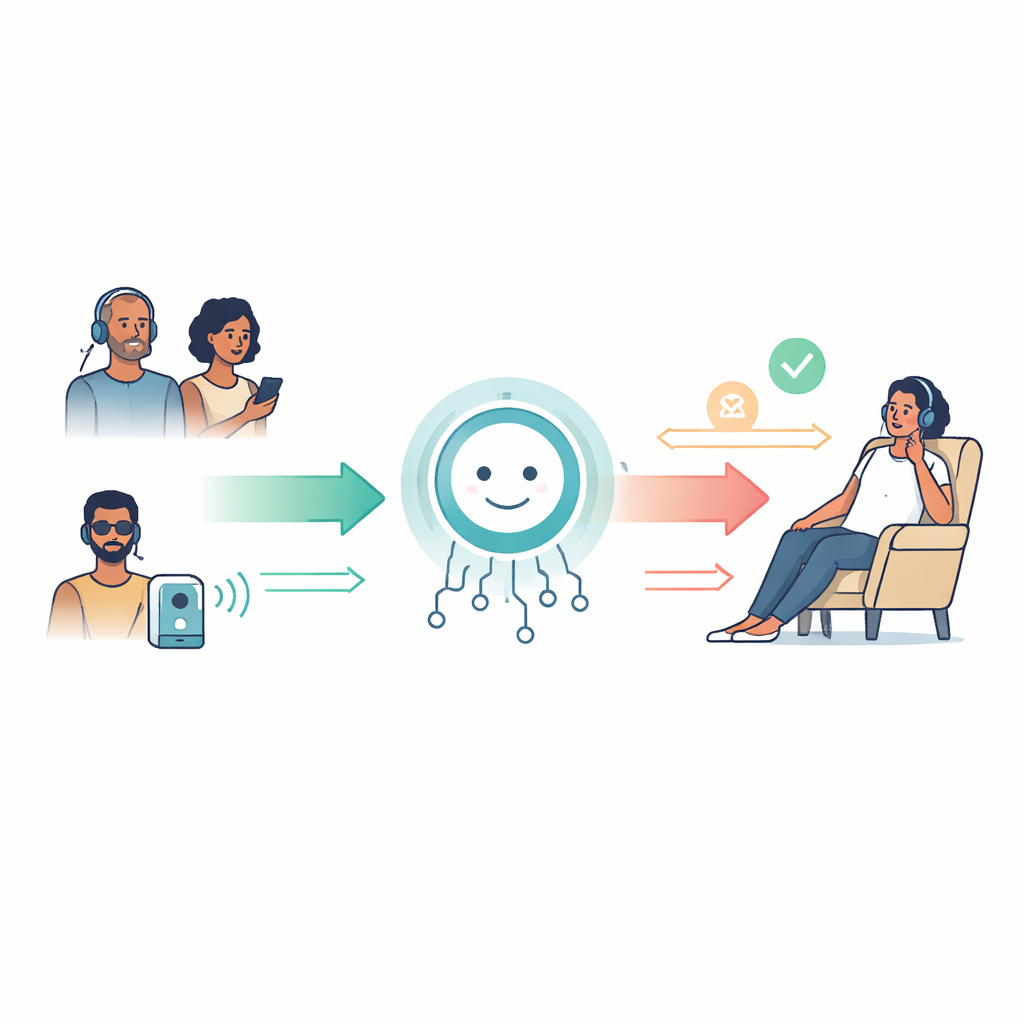

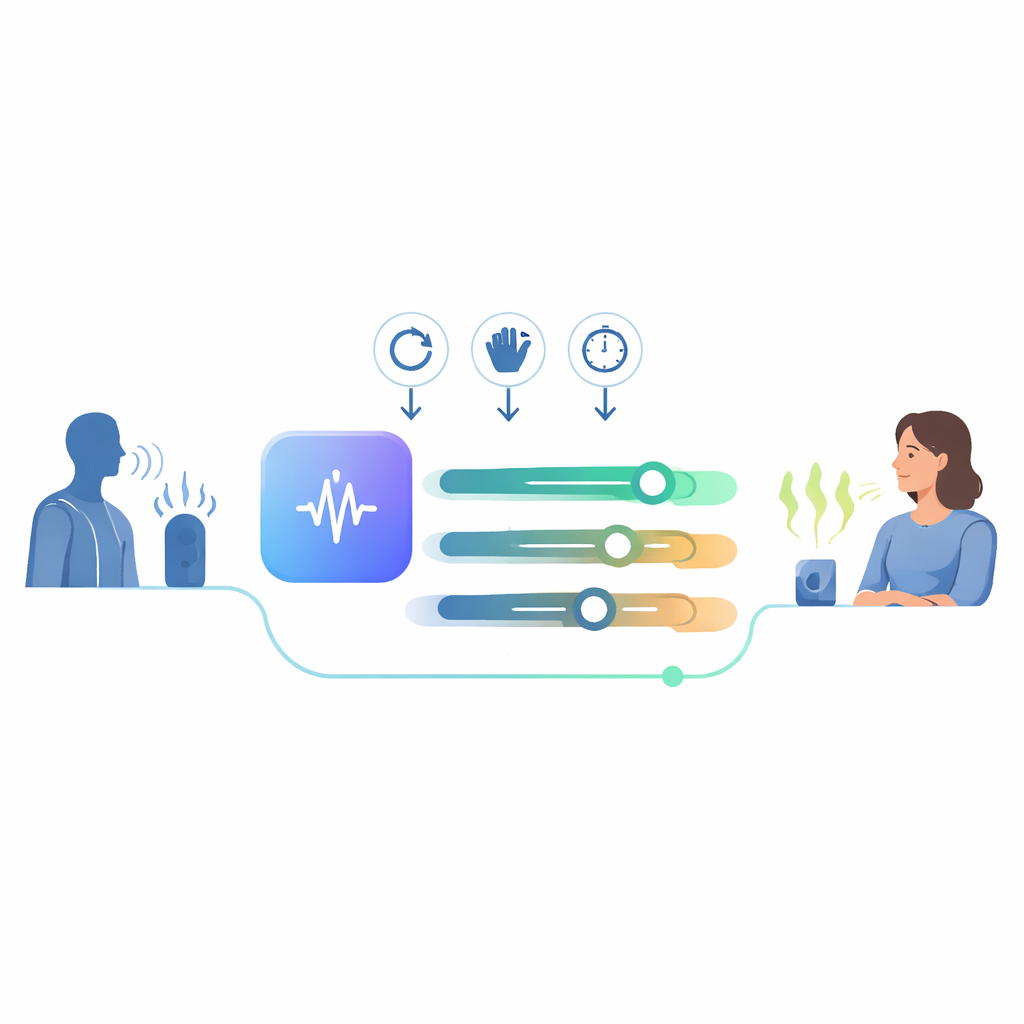

AURA (Adaptive User-Responsive Assistant) è progettata per rompere questo schema. È un sistema basato sulla voce che combina un potente modello linguistico—la stessa tecnologia generale alla base degli avanzati chatbot—with un modo semplice ma intelligente di osservare come si comporta l’utente durante una sessione. Invece di basarsi su lunghi questionari o profili utente fissi, AURA osserva tre segnali naturali: quanto spesso un utente riascolta una risposta, quanto spesso interrompe un messaggio e quanto a lungo ascolta prima di agire. Questi indizi non richiedono hardware aggiuntivo, non espongono dati privati come movimenti oculari o battito cardiaco e si integrano naturalmente nel modo in cui le persone già usano i sistemi vocali.

Come l’assistente si adatta al volo

All’interno di AURA, l’interazione si svolge in anello chiuso. Prima l’utente parla e le sue parole vengono trasformate in testo. Il sistema recupera quindi un profilo leggero che memorizza tre manopole regolabili: quanto veloce parlare, quanto lunghe devono essere le risposte e quanto semplice o complesso deve risultare il linguaggio. Questo profilo modella il prompt inviato al modello linguistico, che quindi costruisce una risposta già orientata a corrispondere allo stile corrente dell’utente. Il testo viene convertito in parlato usando le impostazioni scelte e riprodotto all’utente. Durante e dopo la risposta, AURA registra in modo discreto se l’utente riascolta, salta o ascolta fino alla fine, quindi aggiusta il profilo per il turno successivo. In pochi scambi di ida e ritorno, l’assistente “si concentra” su un modo di parlare che si adatta meglio all’ascoltatore—il tutto senza che l’utente debba cambiare alcun menu di impostazioni.

Testare l’idea in un ambiente controllato

Per verificare se questa adattazione basata su regole si comportasse in modo sensato, il ricercatore non ha iniziato con volontari umani. Invece, lo studio ha usato profili utente simulati che imitano tre pattern comuni: uno che riascolta molto perché fatica a cogliere i dettagli, uno che salta molto perché le risposte sembrano troppo lunghe e uno che preferisce risposte veloci e dense. Per ogni profilo, il sistema ha eseguito molte sessioni brevi sia con che senza adattamento. Lo studio ha poi misurato quanto spesso si verificavano riascolti e salti, quanto tempo richiedevano i compiti e se le impostazioni interne dell’assistente si stabilizzavano in un profilo coerente con lo stile previsto. Pur non essendo state condotte analisi statistiche formali—si è trattato di un controllo di fattibilità piuttosto che di una prova su utenti reali—i numeri hanno mostrato cambiamenti chiari.

Cosa suggeriscono i primi dati

In condizioni con prevalenza di riascolti, la versione adattiva di AURA ha ridotto gli eventi di riascolto di circa due terzi rispetto a una configurazione fissa e non adattiva. In condizioni con prevalenza di salti, i salti sono diminuiti di circa la metà una volta che il sistema ha imparato a mantenere le risposte più brevi e mirate. In tutti i profili simulati, l’assistente ha raggiunto impostazioni stabili che corrispondevano allo stile target nella maggior parte delle sessioni, e il completamento di un tipico compito multi-step ha richiesto circa un quinto in meno di tempo con l’adattamento attivato. È importante notare che le regole di adattamento erano semplici e trasparenti: riascolti ripetuti spingevano l’assistente verso una parola più lenta e un linguaggio più semplice, mentre salti frequenti lo spingevano verso risposte più brevi e dense. Questo design mantiene il sistema più facile da capire e da debuggare rispetto a un modello di apprendimento “scatola nera”—una questione chiave per la sicurezza e la fiducia nella tecnologia assistiva.

Cosa significa per le persone reali

Per i lettori al di fuori del mondo della ricerca, il principale messaggio è che i computer parlanti possono diventare ascoltatori più attenti. Prestando attenzione a segnali naturali come “Hai riascoltato?” o “Mi hai interrotto?”, un assistente può imparare rapidamente a parlare in modo meno frustrante e più efficiente, specialmente per gli utenti ciechi e ipovedenti che dipendono dall’audio. Il lavoro attuale non dimostra ancora un’esperienza migliore nel quotidiano, perché è stato testato con comportamenti generati dal computer piuttosto che con persone reali. Ma pone le basi—sia tecniche che concettuali—for studi futuri con utenti non vedenti, conversazioni più ricche e supporto in più lingue. Se questi passi successivi avranno successo, strumenti come AURA potrebbero contribuire a spostare la tecnologia assistiva da macchine di lettura rigide e unidirezionali a partner reattivi che si adattano in tempo reale alle persone che più dipendono da loro.

Citazione: Algamdi, S.A. A behaviour-adaptive AI assistant enhancing accessibility and usability for blind users through real-time interaction personalization. Sci Rep 16, 12666 (2026). https://doi.org/10.1038/s41598-026-43320-2

Parole chiave: accessibilità per ciechi, assistente vocale adattivo, IA sensibile al comportamento, modelli linguistici di grandi dimensioni, tecnologia assistiva