Clear Sky Science · sv

Meta-inlärningsbaserad få-skott komplettion av kunskapsgrafer med domänvald aggregering

Varför det spelar roll att lära maskiner med bara några få exempel

Moderna artificiella intelligenssystem förlitar sig i allt högre grad på stora ”kunskapsgrafer” som kopplar samman människor, platser, saker och idéer i gigantiska nätverk av fakta. Dessa grafer driver sökmotorer, rekommendationssystem och fråge‑svarverktyg. Men i verkligheten är många samband i dessa grafer sällsynta, dåligt dokumenterade eller helt nya. Att lära en maskin att känna igen och komplettera sådana sällsynta länkar när bara ett fåtal exempel finns är svårt. Denna artikel presenterar en metod som hjälper AI att lära från mycket få prover samtidigt som distraherande information filtreras bort, så att den kan gissa saknade fakta i en kunskapsgraf mer träffsäkert.

Kartor över kunskap byggda av enkla fakta

En kunskapsgraf representerar information som enkla tresatsiga påståenden, till exempel ”person A works_for företag B” eller ”stad C is_in land D.” Varje påstående länkar två entiteter via en relation, och miljoner av dessa länkar tillsammans bildar en kunskapskarta. Traditionella tekniker omvandlar varje entitet och relation till tal i ett matematiskt rum och lär sedan regler som gör det möjligt för systemet att förutsäga nya länkar. Dessa tekniker fungerar väl när det finns gott om exempel för varje relation, som ”born_in” eller ”located_in”, men har svårare när en relation förekommer bara ett fåtal gånger i datan. I praktiken är sällsynta relationer vanliga—till exempel en specifik medicinsk åkomma, en nischad yrkestitel eller ett nybildat partnerskap—så att förbättra prestanda för dessa ”få‑skotts” fall är avgörande.

Lära av grannar utan att gå vilse i brus

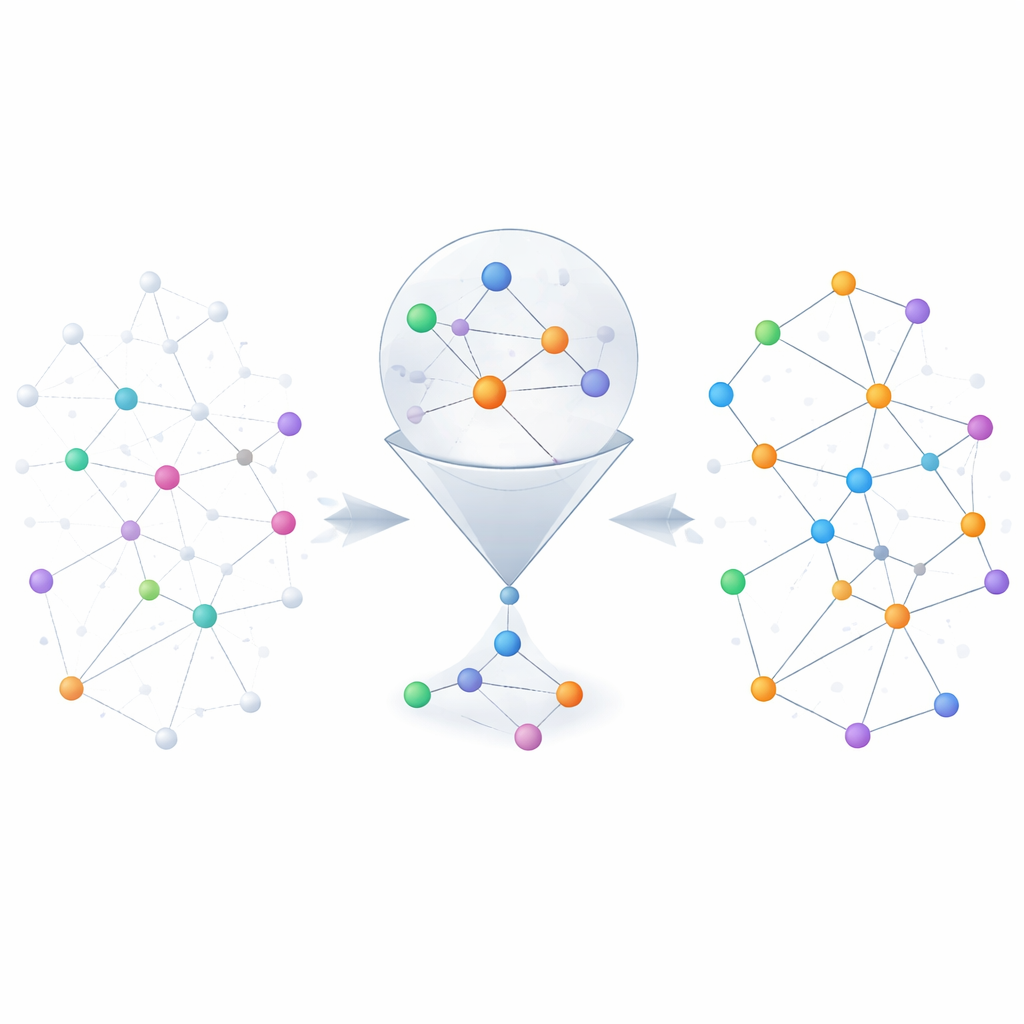

Ett sätt att hantera knapphändiga exempel är att titta på varje entitets ”grannar” i grafen—de andra fakta som är direkt kopplade till den. Till exempel, när man försöker förutsäga någons make/maka hjälper det mer att känna till familjemedlemmar än affärspartners. Befintliga metoder behandlar ofta alla närliggande fakta som lika användbara, vilket kan dränka de verkligt relevanta ledtrådarna i brus. Författarna föreslår en modul för val av grannskap som först värderar varje granne efter relevans, behåller endast de högst rankade och sedan använder en grindmekanism inspirerad av återkommande neurala nätverk för att avgöra hur mycket av denna granneinformation som faktiskt ska uppdatera entitetens representation. Denna tvåstegsprocess filtrerar både bort off‑topic‑grannar och balanserar dynamiskt vad som ska kommas ihåg och vad som ska ignoreras, vilket är särskilt hjälpsamt när bara ett fåtal träningsexempel finns tillgängliga.

Lära systemet hur man lär nya relationer

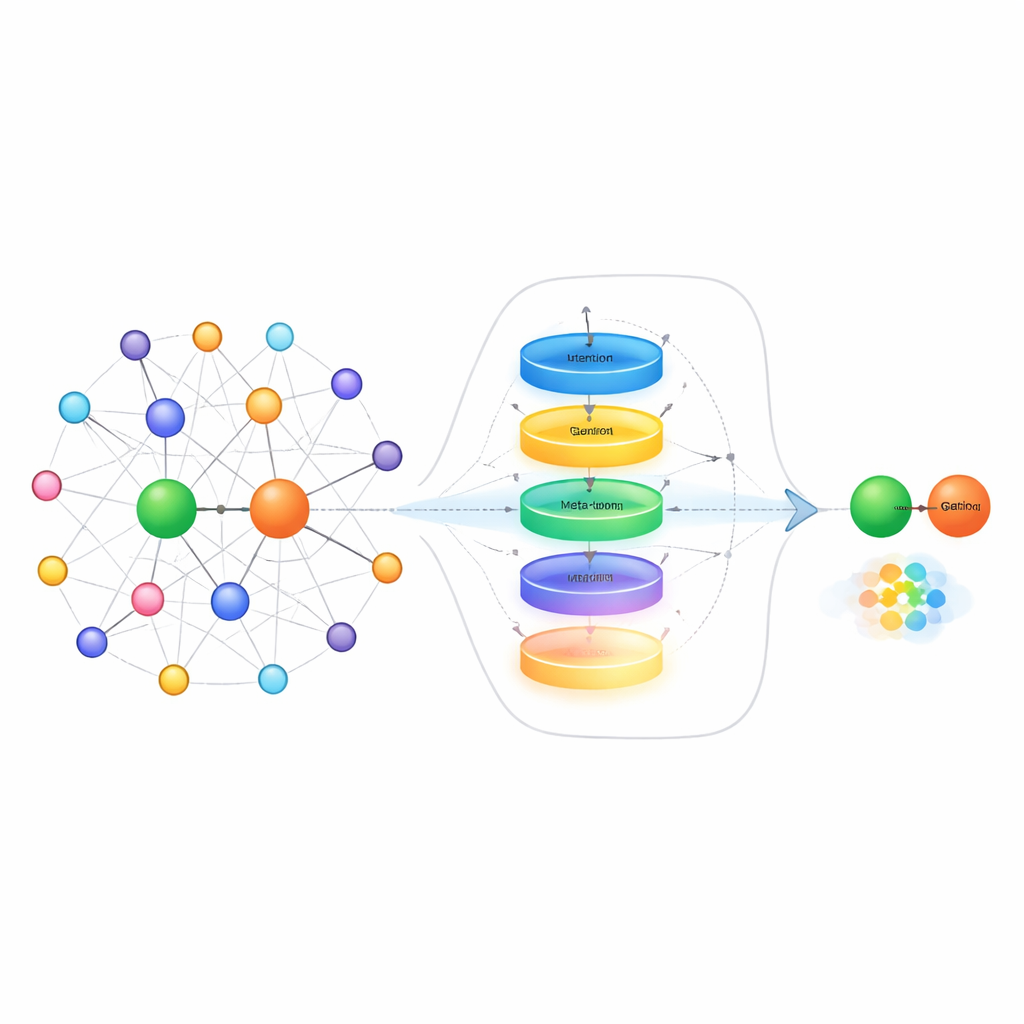

Utöver att rensa upp grannskapsinformationen tar metoden också itu med hur systemet representerar relationer när det bara ser ett fåtal exempelpar. I stället för att enkelt medelvärdesbilda dessa exempel bygger författarna en relations‑”meta‑inlärare.” Den behandlar alla exempelpar för en given relation som en kort sekvens och skickar dem genom en gated recurrent unit för att fånga mönster över exemplen. En kontextuell uppmärksamhetsmekanism låter sedan modellen fokusera mer på de mest informativa paren, medan ett litet feed‑forward‑nätverk ytterligare förfinar den sammanslagna signalen. Residuala anslutningar och normalisering hjälper till att stabilisera inlärningen. Resultatet är en kompakt, uppgiftsanpassad representation av relationen som fångar subtila skillnader i hur entiteter interagerar, såsom riktning, styrka eller typ av koppling.

Lära sig anpassa snabbt med meta‑optimering

Den sista delen av angreppssättet är en inbäddningsinläraren som använder idéer från meta‑inlärning—ofta kallat ”lära sig att lära.” Under träning ser systemet många olika relationer som separata små uppgifter. För varje uppgift anpassar det kort sina parametrar med bara de få tillgängliga exemplen, och kontrollerar sedan hur väl det presterar på nya frågor för den relationen. Gradienterna från detta andra steg uppdaterar en delad uppsättning parametrar så att modellen med tiden blir bättre på att anpassa sig snabbt till helt nya relationer som den aldrig tidigare sett. Metoden bygger vidare på en befintlig teknik som placerar entiteter på relationsspecifika geometriska ytor, och den uppdaterar både relationsrepresentationen och dessa ytor under meta‑inlärningen, vilket skärper förutsägelserna ytterligare.

Vad resultaten betyder för vardagliga AI‑verktyg

Författarna testar sin metod på två välanvända benchmark‑dataset, NELL‑One och Wiki‑One, och jämför den med många toppmoderna system för få‑skotts komplettering av kunskapsgrafer. Över flera utvärderingsmått presterar deras ansats konsekvent bättre, särskilt när den har fem exempel länkar per relation. Vinsterna är mest uttalade på ett dataset där granneinformationen är rikare, vilket understryker nyttan av noggrant grannval och relationsmeta‑inlärning. För vardagliga tillämpningar innebär detta att AI‑system på ett mer tillförlitligt sätt kan fylla i saknade kunskapsbitar—såsom sällsynta relationer, specialiserade begrepp eller framväxande fakta—även när bara ett litet antal exempel finns tillgängligt, vilket gör nedströmsverktyg som sök, rekommendationer och fråge‑svar mer exakta och robusta.

Citering: Yang, B., Peng, M., Liu, S. et al. Meta learning based few shot knowledge graph completion with domain selected aggregation. Sci Rep 16, 12333 (2026). https://doi.org/10.1038/s41598-026-42198-4

Nyckelord: kunskapsgrafer, få-skottsinlärning, meta-inlärning, grafneuronätverk, länkprediktion