Clear Sky Science · ru

Метапоисковое обучение для дополнения графов знаний при малом числе примеров с отбором соседей по домену

Почему важно обучать машины на всего нескольких примерах

Современные системы искусственного интеллекта всё чаще опираются на обширные «графы знаний», связывающие людей, места, объекты и идеи в гигантские сети фактов. Эти графы обеспечивают работу поисковых систем, рекомендательных сервисов и систем ответов на вопросы. Но в реальном мире многие связи в таких графах редки, плохо задокументированы или совсем новые. Научить машину распознавать и восстанавливать такие редкие связи, имея в распоряжении лишь несколько примеров, сложно. В этой статье предлагается метод, который позволяет ИИ эффективно учиться на очень небольшом количестве образцов, отфильтровывая отвлекающую информацию, чтобы точнее восстанавливать недостающие факты в графе знаний.

Карты знаний, построенные из простых фактов

Граф знаний представляет информацию в виде простых трёхчастных утверждений, таких как «человек A работaет в компании B» или «город C находится в стране D». Каждое утверждение связывает два объекта через отношение, и миллионы таких связей вместе формируют карту знаний. Традиционные подходы переводят каждое сущность и отношение в числовые представления в некотором векторном пространстве и затем обучают правила, позволяющие системе предсказывать новые связи. Эти методы хорошо работают, когда для каждого отношения имеется много примеров, например для «родился_в» или «расположен_в», но испытывают трудности, когда отношение встречается в данных лишь несколько раз. На практике редкие отношения — обычное дело: это может быть специфическое медицинское состояние, узкая профессиональная должность или недавно возникшее партнёрство — поэтому улучшение работы в таких «few-shot» случаях критично.

Учиться у соседей, не теряясь в шуме

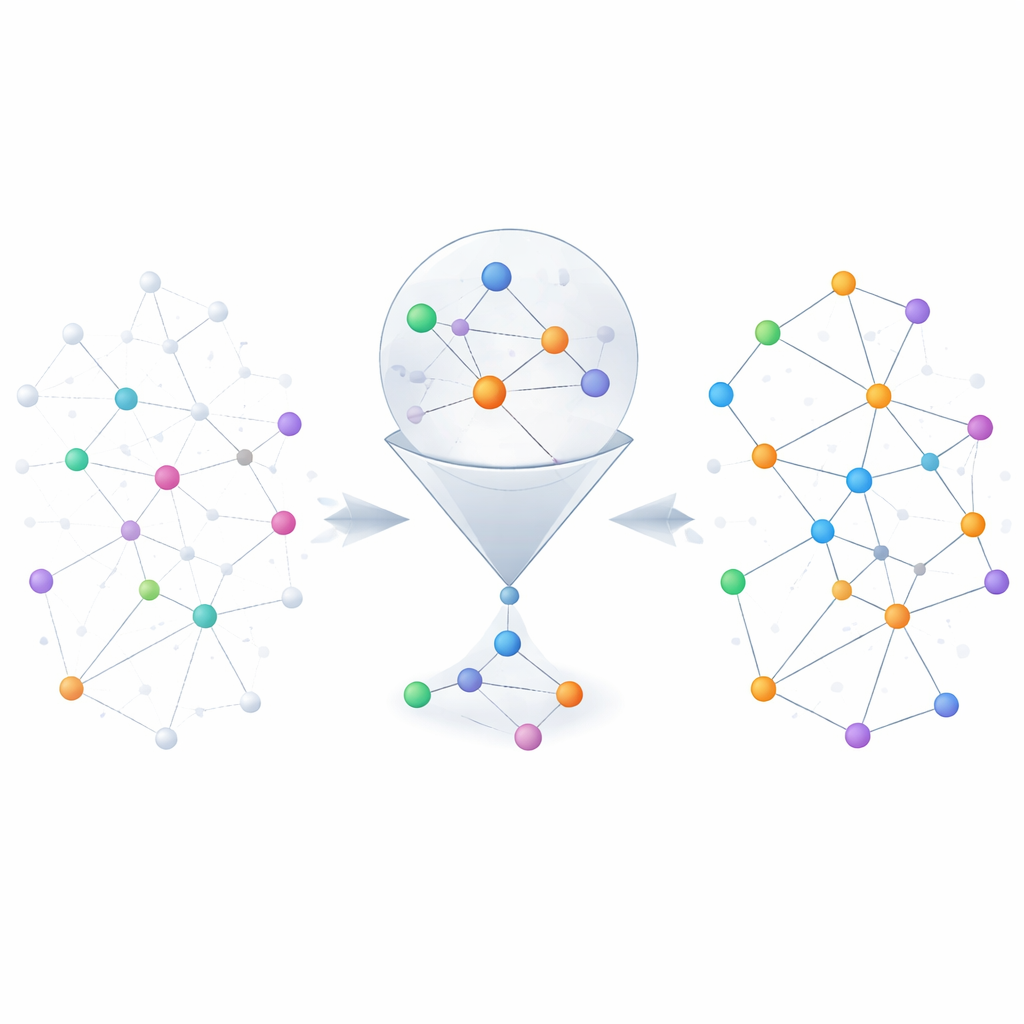

Один из способов справиться с дефицитом примеров — смотреть на «соседей» каждой сущности в графе — то есть на другие факты, напрямую связанные с ней. Например, при попытке предсказать супругу человека важнее знать его членов семьи, чем деловых партнёров. Существующие методы часто рассматривают все близкие факты как одинаково полезные, что может заглушать действительно релевантные подсказки шумом. Авторы предлагают модуль отбора соседей, который сначала оценивает каждого соседа по степени релевантности, сохраняет только наиболее высоко оценённых, а затем использует механизм затвора, вдохновлённый рекуррентными нейронными сетями, чтобы решить, какая часть информации от соседей действительно должна обновить представление сущности. Этот двухэтапный процесс одновременно фильтрует нерелевантные соседи и динамически балансирует между запоминанием и игнорированием, что особенно полезно при наличии лишь нескольких обучающих примеров.

Обучить систему представлять новые отношения

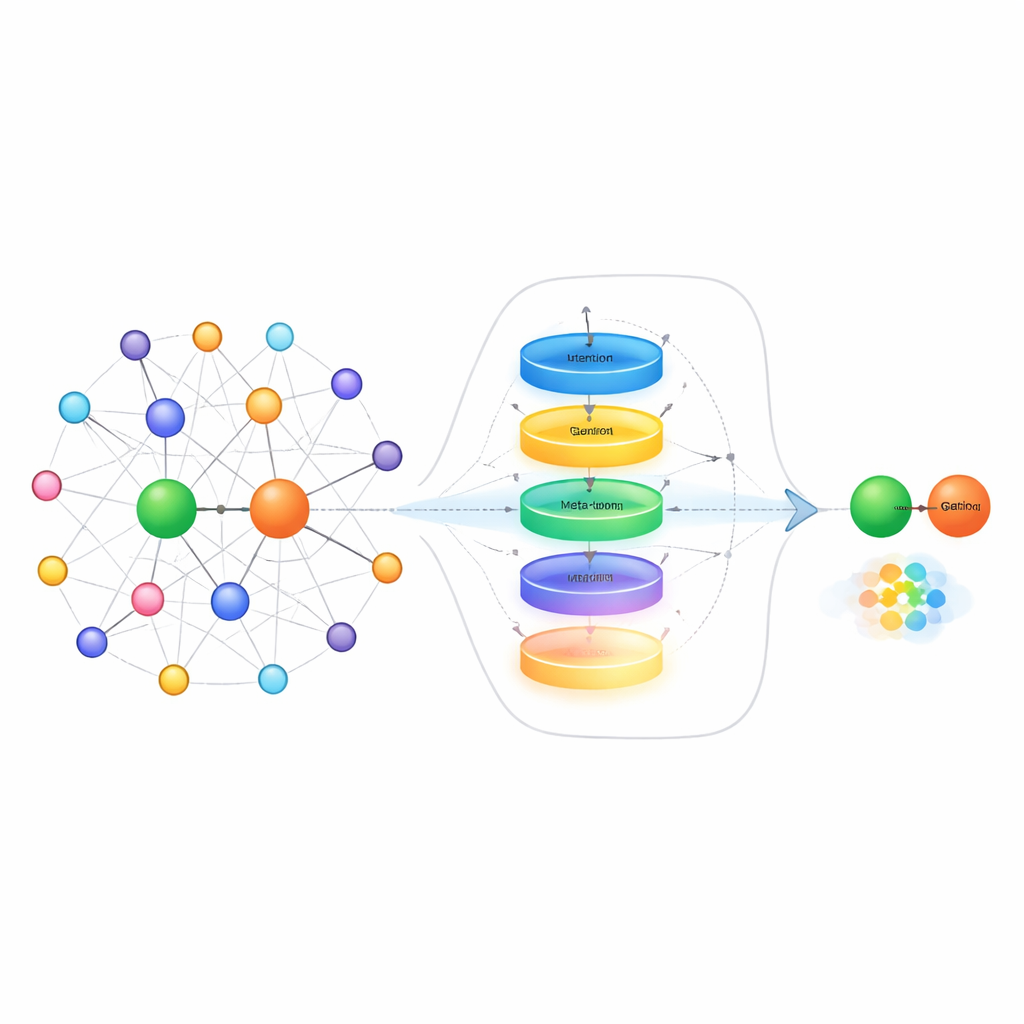

Кроме очистки информации от соседей, метод также решает задачу представления самих отношений, когда доступно лишь несколько примеров ссылок. Вместо простого усреднения примеров авторы строят «мета-обучатель» отношений. Он рассматривает все пары примеров для данного отношения как короткую последовательность и пропускает их через блок с затворами (gated recurrent unit), чтобы уловить закономерности между примерами. Контекстный механизм внимания затем позволяет модели сосредоточиться на наиболее информативных парах, а небольшой полносвязный нейронный слой дополнительно уточняет объединённый сигнал. Резидуальные соединения и нормализация помогают стабилизировать обучение. В результате получается компактное, ориентированное на задачу представление отношения, которое фиксирует тонкие различия во взаимодействии сущностей, такие как направление, сила или тип связи.

Учиться быстро адаптироваться с помощью мета‑оптимизации

Финальный элемент подхода — обучатель эмбеддингов, который использует идеи мета‑обучения — то есть «обучения учиться». Во время тренировки система видит множество различных отношений как отдельные небольшие задачи. Для каждой задачи она кратко адаптирует свои параметры, используя лишь имеющиеся несколько примеров, а затем проверяет, насколько хорошо отвечает на новые запросы по этому отношению. Градиенты со второго шага обновляют общий набор параметров так, что со временем модель всё лучше справляется с быстрой адаптацией к совершенно новым отношениям, которых она раньше не видела. Метод опирается на существующий подход, помещающий сущности на отношение-специфические геометрические поверхности, и обновляет как представление отношения, так и эти поверхности в процессе мета‑обучения, что ещё больше повышает точность предсказаний.

Что означают результаты для повседневных инструментов ИИ

Авторы проверили свой метод на двух широко используемых бенчмарках, NELL‑One и Wiki‑One, и сравнили его со многими современными системами для дополнения графов знаний при малом числе примеров. По нескольким метрикам их подход последовательно показывает лучшие результаты, особенно в настройке с пятью примерами на отношение. Прирост особенно заметен на датасете, где информация о соседях богаче, что подчёркивает ценность тщательного отбора соседей и мета‑обучения представлений отношений. Для повседневных приложений это означает, что системы ИИ смогут надёжнее восполнять недостающие элементы знаний — такие как редкие отношения, специализированные понятия или недавно появившиеся факты — даже при небольшом числе доступных примеров, делая такие сервисы, как поиск, рекомендации и ответы на вопросы, более точными и устойчивыми.

Цитирование: Yang, B., Peng, M., Liu, S. et al. Meta learning based few shot knowledge graph completion with domain selected aggregation. Sci Rep 16, 12333 (2026). https://doi.org/10.1038/s41598-026-42198-4

Ключевые слова: графы знаний, обучение с малым числом образцов, мета-обучение, графовые нейронные сети, предсказание связей