Clear Sky Science · sv

Kvantifiera osäkerhet i proteinrepresentationer över modeller och uppgifter

Varför pålitlighet i protein-AI är viktigt

Artificiell intelligens har blivit ett kraftfullt förstoringsglas för proteiners osynliga värld. Moderna "proteinspråksmodeller" kan gissa hur ett protein ser ut i 3D och hur det kan bete sig — enbart utifrån dess sekvens av byggstenar. Dessa modeller hjälper redan till att designa nya läkemedel och förstå sjukdomsframkallande mutationer. Men det finns ett dolt problem: de berättar sällan hur mycket vi bör lita på de interna representationer de skapar. Denna artikel tar itu med den luckan genom att ställa en enkel fråga med stora konsekvenser: när en modell omvandlar ett protein till ett moln av siffror, hur kan vi avgöra om det molnet verkligen speglar riktig biologi eller bara är brus?

Från meningar till proteiner

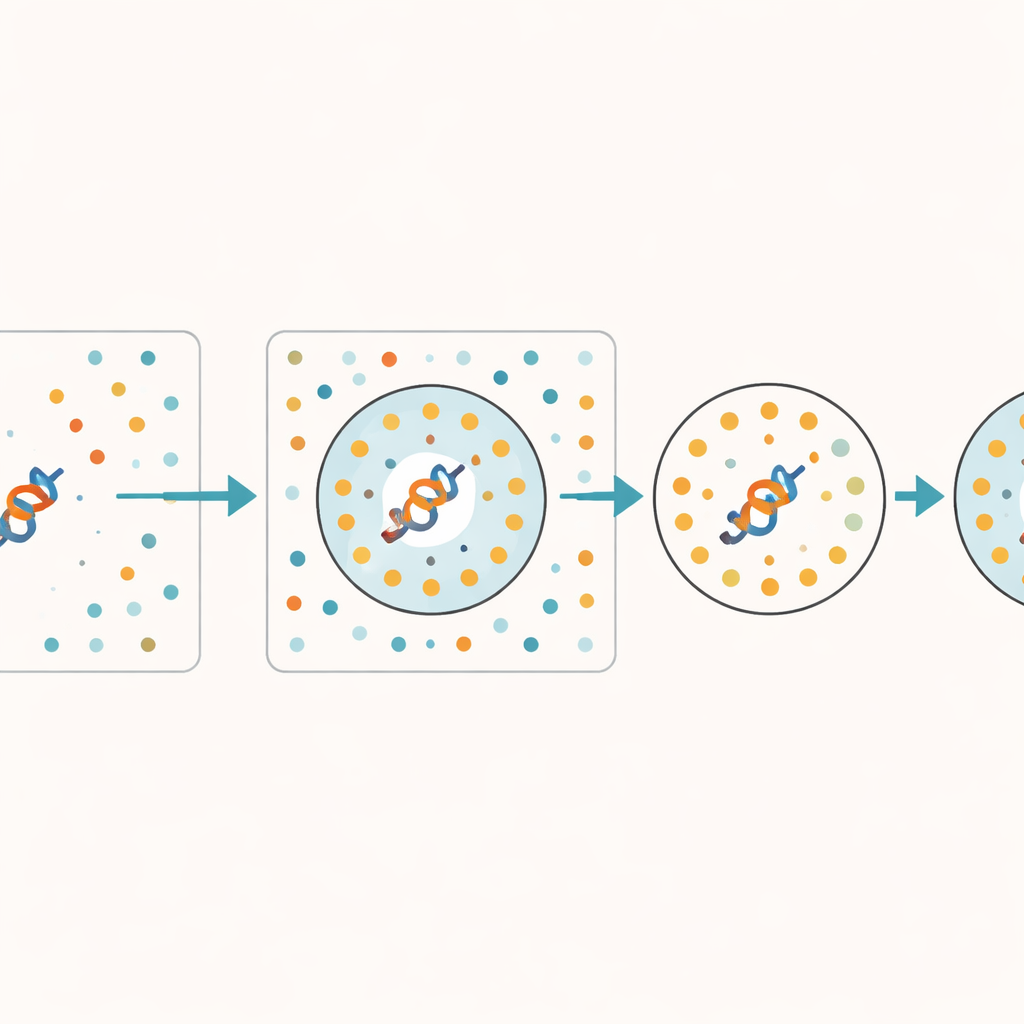

Språkmodeller utvecklades först för mänsklig text, där de lär sig hur ord relaterar och förutsäger vad som kommer härnäst i en mening. Samma idéer driver nu modeller som läser protein- och DNA-sekvenser som om de vore långa ord. För varje protein producerar modellen en "inbäddning" — en punkt i ett högdimensionellt rum som ska sammanfatta vad modellen vet om det proteinet. Dessa inbäddningar används i många efterföljande uppgifter, såsom att förutsäga struktur, funktion och effekten av mutationer. Men till skillnad från välkända prediktionspoäng eller konfidensmått tas inbäddningar oftast för givna: om modellen ger ut en vektor tenderar användare att lita på den, även i delar av proteinrymden som modellen knappt sett under träningen.

Upptäcka när modellen gissar

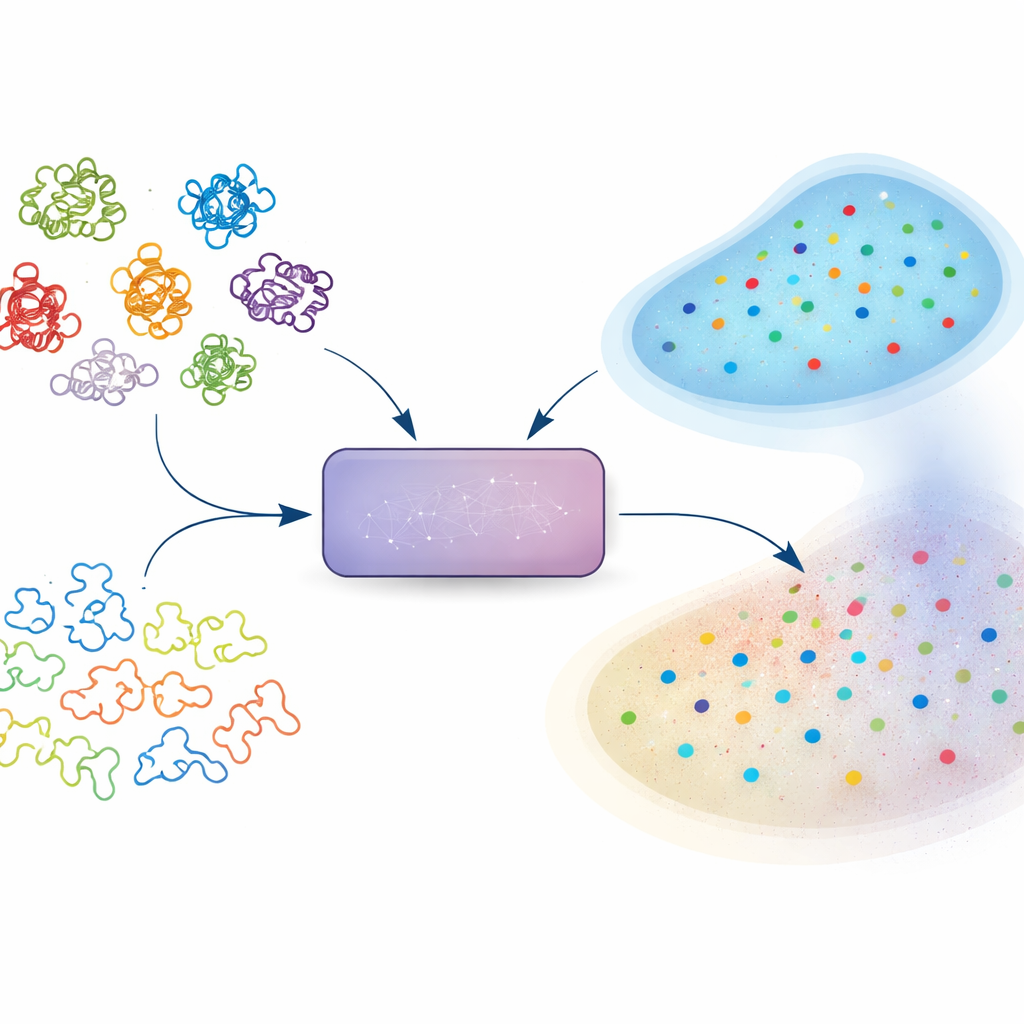

Författarna föreslår ett praktiskt sätt att uppskatta hur pålitlig en inbäddning är, utan att ändra den underliggande modellen. Deras nyckelidé är att ge modellen en uppsättning avsiktligt rörda proteinsekvenser som behåller samma grundläggande sammansättning men förlorar alla meningsfulla biologiska mönster. Dessa syntetiska sekvenser fungerar som en "skrotgård" — en referens för vad modellen producerar när det inte finns någon verklig signal att lära sig. För ett givet verkligt protein kontrollerar metoden hur många av dess närmaste grannar i modellens interna rum som tillhör denna skrotgård. Om många närliggande punkter kommer från rörda sekvenser är proteinets representation troligen underinlärd eller tvetydig. Författarna kallar denna andel skrotgårdsgrannar för Random Neighbor Score (RNS).

Koppla osäkerhet till verklig prestanda

För att se om RNS faktiskt speglar något biologiskt viktigt analyserade teamet stora samlingar av proteinstrukturer och sekvenser med flera toppmoderna modeller, inklusive ESM-2 och ProtT5. De fann att proteiner vars strukturer förutsades noggrant tenderade att ha låg RNS — vilket innebär att deras inbäddningar låg långt från skrotgården. I kontrast levde proteiner med dåliga strukturprediktioner i områden där verkliga och rörda sekvenser överlappade. Detta mönster höll över olika modeller och uppgifter. När de tittade på mer tillämpade problem, såsom att förutsäga vilka aminosyror som kontaktar varandra i 3D eller att tilldela sekundärstruktur, observerade de en tydlig minskning i noggrannhet när RNS ökade. Med andra ord: ju mindre säker inbäddningen är (högre RNS), desto mindre pålitlig är den efterföljande prediktionen.

Blinda fläckar i proteinrymden

RNS avslöjade också systematiska blinda fläckar i hur modeller representerar olika delar av proteinuniversumet. Intrinsiskt oordnade regioner — flexibla segment som saknar en stabil struktur — hade konsekvent högre RNS än välstrukturerade domäner, vilket visar att modeller har större svårigheter med dessa svårfångade sekvenser. Även inom det välstuderade humana proteomet hade en betydande andel proteiner icke-noll RNS, vilket indikerar att de inte fångas väl av populära modeller. Överraskande nog var större modeller inte alltid bättre: en stor, strukturfokuserad modell kunde vara mer osäker om många mänskliga proteiner än en mindre, mer generell modell. För nyligen upptäckta metagenomiska proteiner och till och med datorgenererade "hallucinerade" proteiner som designats för att se realistiska ut, antydde låg RNS att modeller kan generalisera med förtroende bortom sin träningsdata när mönstren är koherenta.

Bättre filter för bättre biologisk insikt

Författarna testade sedan hur RNS-baserad screening påverkar en kliniskt relevant uppgift: att förutsäga om en enkel bokstavsförändring i ett mänskligt protein sannolikt stör dess funktion eller orsakar sjukdom. När de begränsade analysen till proteiner med låg RNS — där inbäddningarna verkade pålitliga — förbättrades modellens prestanda markant, ofta till en stark diskriminering mellan skadliga och neutrala varianter. För proteiner med hög RNS sjönk prediktionerna mot slumpmässiga nivåer. Detta stöder uppfattningen att opålitliga inbäddningar tyst begränsar den bästa möjliga noggrannheten för vilket efterföljande verktyg som helst byggt på dem, oavsett smarta träningsknep.

Vad detta betyder för användning av AI i biologi

För icke-specialister är slutsatsen att inte alla AI-baserade proteinrepresentationer är lika pålitliga, och att denna pålitlighet nu kan kvantifieras. Random Neighbor Score fungerar som en enkel, modellagnostisk hälsokontroll för inbäddningar: låga poäng indikerar att ett protein sitter bland andra biologiskt meningsfulla sekvenser, medan höga poäng tyder på att det driver mot en skrotgård av slumpmässiga liknande sekvenser. Genom att filtrera eller väga proteiner baserat på RNS innan man gör strukturprediktioner, annoterar funktioner eller prioriterar sjukdomsvarianter, kan forskare fokusera på områden där modellen verkligen "förstår" datan. Precis som ingen forskare skulle använda ett suddigt mikroskop utan att märka det, argumenterar detta arbete för att varje proteinspråksmodell bör levereras med ett inbyggt sätt att mäta skärpan i dess interna bild av biologin.

Citering: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Nyckelord: proteinspråksmodeller, inbäddningspålitlighet, representationsosäkerhet, prediktion av variantpåverkan, intrinsiskt oordnade proteiner