Clear Sky Science · es

Cuantificar la incertidumbre en las representaciones de proteínas entre modelos y tareas

Por qué importa la fiabilidad en la IA aplicada a proteínas

La inteligencia artificial se ha convertido en un potente microscopio para el mundo invisible de las proteínas. Los modernos “modelos de lenguaje para proteínas” pueden intuir cómo es una proteína en 3D y cómo podría comportarse solo a partir de su secuencia de bloques constructores. Estos modelos ya ayudan a diseñar nuevos fármacos y a entender mutaciones relacionadas con enfermedades. Pero hay un problema oculto: rara vez nos dicen cuánto debemos confiar en las representaciones internas que generan. Este artículo aborda esa laguna planteando una pregunta simple con grandes consecuencias: cuando un modelo convierte una proteína en una nube de números, ¿cómo podemos saber si esa nube refleja realmente la biología o no es más que ruido?

De oraciones a proteínas

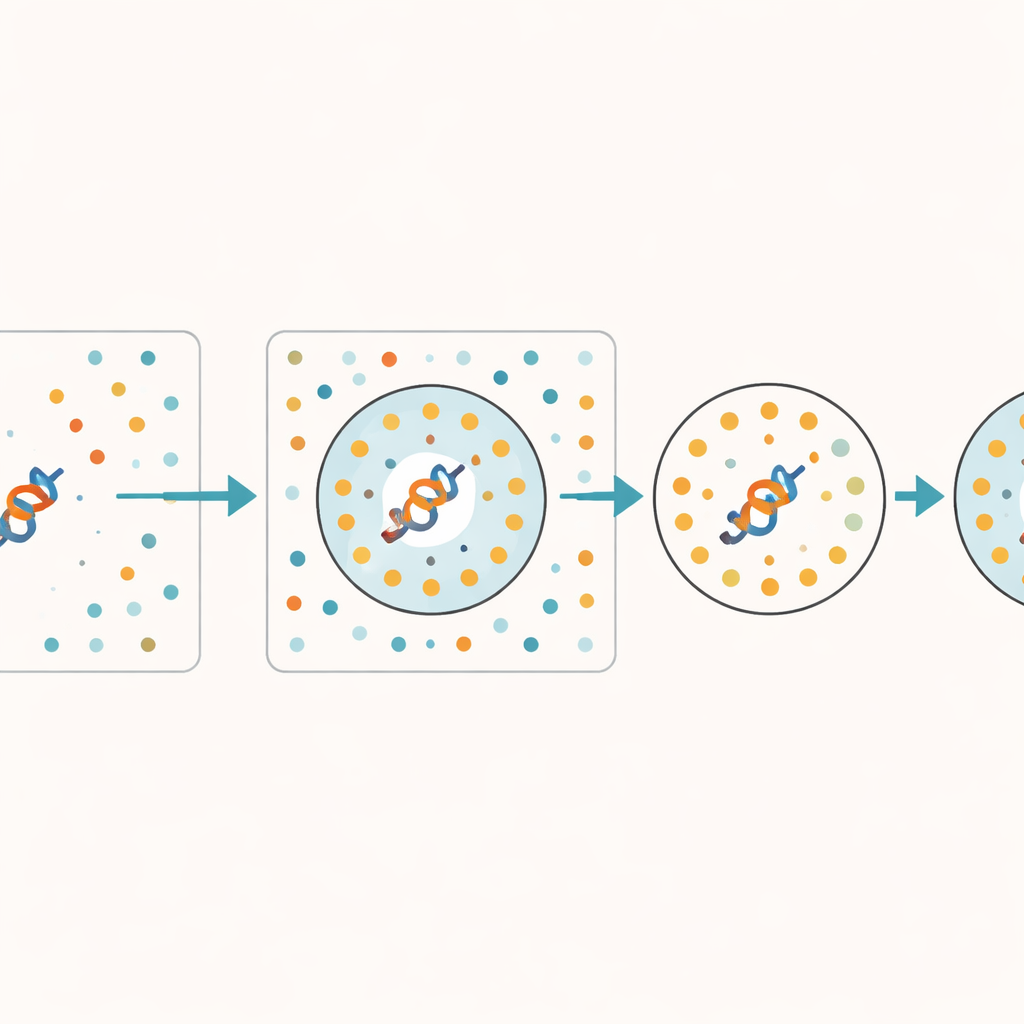

Los modelos de lenguaje se desarrollaron originalmente para procesar texto humano, aprendiendo cómo se relacionan las palabras y prediciendo qué sigue en una frase. Las mismas ideas ahora impulsan modelos que leen secuencias de proteínas y ADN como si fueran largas palabras. Para cada proteína, el modelo produce un “embedding”: un punto en un espacio de alta dimensión pensado para resumir lo que el modelo sabe sobre esa proteína. Esos embeddings se usan en muchas tareas posteriores, como predecir estructura, función y el impacto de mutaciones. Sin embargo, a diferencia de las puntuaciones de predicción o las medidas de confianza familiares, los embeddings suelen darse por sentados: si el modelo emite un vector, los usuarios tienden a confiar en él, incluso en regiones del espacio proteico que el modelo apenas vio durante el entrenamiento.

Detectar cuándo el modelo está adivinando

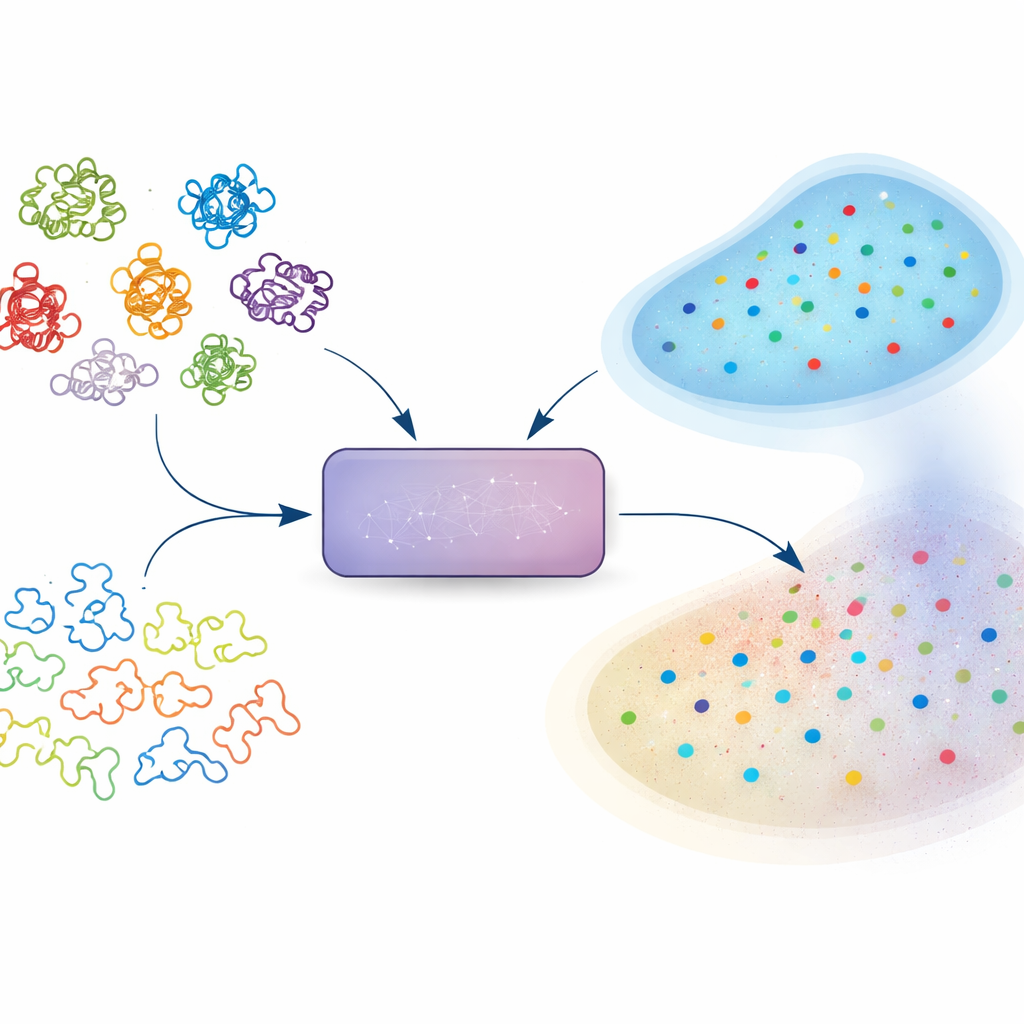

Los autores proponen una forma práctica de estimar cuán fiable es un embedding sin modificar el modelo subyacente. Su idea clave es dar al modelo un conjunto de secuencias de proteína deliberadamente mezcladas que mantienen la misma composición básica pero pierden todos los patrones biológicos significativos. Estas secuencias sintéticas actúan como un “vertedero”: una referencia de lo que produce el modelo cuando no hay señal real que aprender. Para cualquier proteína real, el método comprueba cuántos de sus vecinos más cercanos en el espacio interno del modelo pertenecen a ese vertedero. Si muchos puntos próximos proceden de secuencias mezcladas, la representación de la proteína probablemente esté poco aprendida o sea ambigua. Los autores llaman a esta fracción de vecinos del vertedero la Puntuación de Vecino Aleatorio (Random Neighbor Score, RNS).

Vincular la incertidumbre con el rendimiento en el mundo real

Para comprobar si la RNS refleja algo biológicamente relevante, el equipo analizó grandes colecciones de estructuras y secuencias de proteínas usando varios modelos de vanguardia, incluidos ESM-2 y ProtT5. Encontraron que las proteínas cuya estructura se predijo con precisión tendían a tener baja RNS: sus embeddings estaban alejados del vertedero. En contraste, las proteínas con predicciones estructurales pobres vivían en regiones donde las secuencias reales y las mezcladas se solapaban. Este patrón se mantuvo a través de distintos modelos y tareas. Al analizar problemas más aplicados, como predecir qué residuos de aminoácidos contactan entre sí en 3D o asignar estructura secundaria, observaron una clara caída en la precisión a medida que aumentaba la RNS. En otras palabras, cuanto menos seguro es el embedding (RNS mayor), menos fiable es la predicción posterior.

Puntos ciegos en el espacio de proteínas

La RNS también reveló puntos ciegos sistemáticos en cómo los modelos representan distintas partes del universo proteico. Las regiones intrínsecamente desordenadas—tramos flexibles que carecen de una estructura estable—tenían consistentemente RNS más altas que los dominios bien estructurados, lo que muestra que los modelos tienen más dificultades con estas secuencias resbaladizas. Incluso dentro del bien estudiado proteoma humano, una fracción sustancial de proteínas tenía RNS distinta de cero, lo que indica que no están bien capturadas por los modelos populares. Sorprendentemente, los modelos más grandes no siempre eran mejores: un modelo grande enfocado en estructura podía mostrar más incertidumbre sobre muchas proteínas humanas que otro más pequeño y generalista. Para proteínas metagenómicas recientemente descubiertas e incluso proteínas “alucinadas” diseñadas por ordenador para parecer realistas, una RNS baja sugería que los modelos pueden generalizar con confianza más allá de sus datos de entrenamiento cuando los patrones son coherentes.

Mejores filtros para una mejor comprensión biológica

Los autores probaron a continuación cómo el cribado basado en RNS afecta una tarea clínicamente relevante: predecir si un cambio de una sola letra en una proteína humana es probable que altere su función o cause enfermedad. Al restringir el análisis a proteínas con baja RNS—donde los embeddings parecían fiables—el rendimiento del modelo mejoró notablemente, alcanzando a menudo una fuerte discriminación entre variantes dañinas y neutras. Para proteínas con RNS alta, las predicciones cayeron hasta niveles equivalentes a lanzar una moneda. Esto respalda la idea de que los embeddings poco fiables limitan silenciosamente la máxima precisión posible de cualquier herramienta posterior construida sobre ellos, independientemente de trucos de entrenamiento sofisticados.

Qué significa esto para el uso de la IA en biología

Para los no especialistas, la conclusión es que no todas las representaciones de proteínas derivadas por IA son igualmente dignas de confianza, y que esa fiabilidad puede ahora cuantificarse. La Puntuación de Vecino Aleatorio actúa como una comprobación simple y agnóstica al modelo sobre la salud de los embeddings: puntuaciones bajas indican que una proteína se sitúa entre otras secuencias biológicamente significativas, mientras que puntuaciones altas sugieren que deriva hacia un vertedero de semejantes aleatorios. Al filtrar o ponderar las proteínas según la RNS antes de hacer predicciones estructurales, anotar funciones o priorizar variantes asociadas a enfermedades, los investigadores pueden centrarse en regiones donde el modelo realmente “entiende” los datos. Así como ningún científico usaría un microscopio borroso sin darse cuenta, este trabajo argumenta que todo modelo de lenguaje para proteínas debería venir con una forma integrada de medir la nitidez de su visión interna de la biología.

Cita: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Palabras clave: modelos de lenguaje de proteínas, confiabilidad de embeddings, incertidumbre en representaciones, predicción del efecto de variantes, proteínas intrínsecamente desordenadas