Clear Sky Science · ru

Квантование неопределённости в представлениях белков в разных моделях и задачах

Почему надёжность в ИИ для белков важна

Искусственный интеллект стал мощным микроскопом для невидимого мира белков. Современные «языковые модели белков» могут предсказывать трёхмерную форму белка и его поведение, исходя только из последовательности аминокислот. Эти модели уже помогают в разработке новых лекарств и понимании болезнетворных мутаций. Но существует скрытая проблема: они редко сообщают, насколько можно доверять внутренним представлениям, которые они формируют. В этой статье рассматривается этот пробел через простой, но важный вопрос: когда модель превращает белок в облако чисел, как понять, отражает ли это облако реальную биологию или это просто шум?

От предложений к белкам

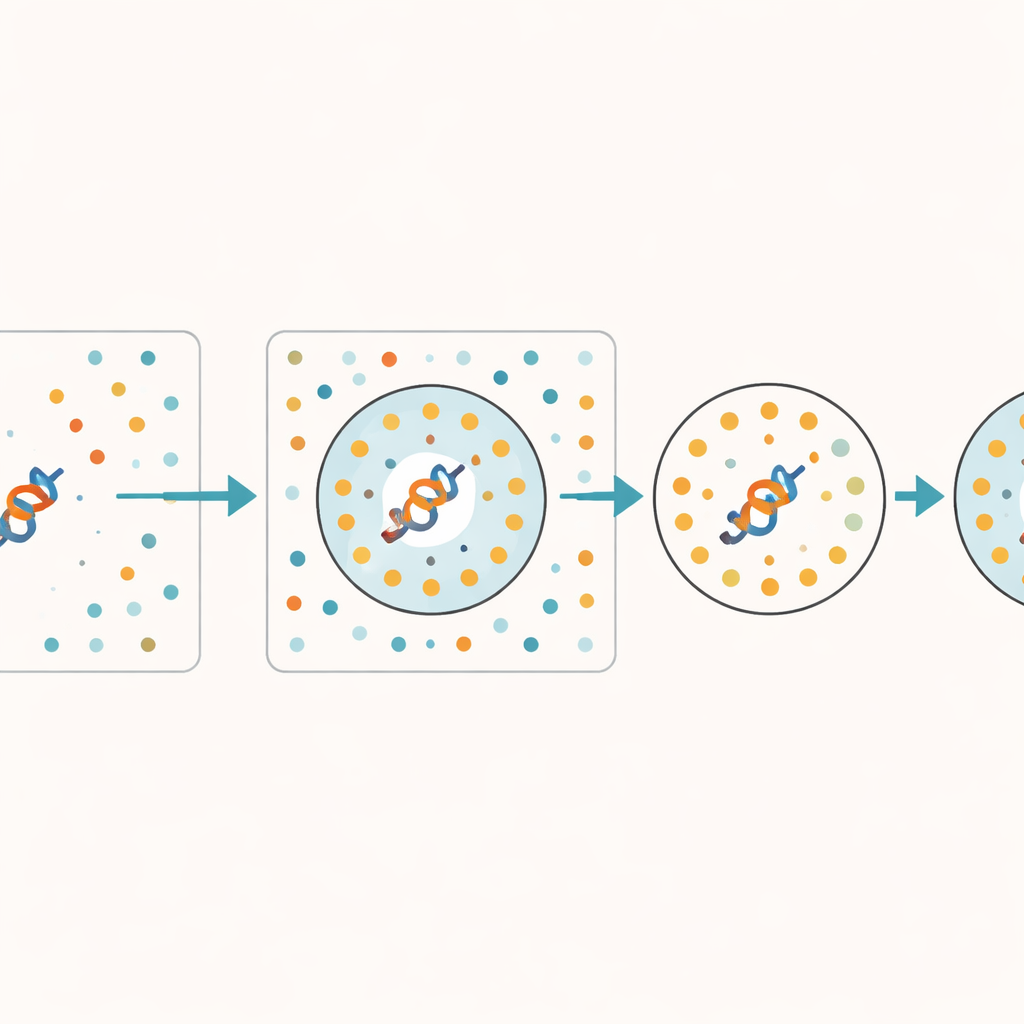

Языковые модели изначально разрабатывались для обработки человеческого текста, они учились взаимосвязям слов и предсказывали, что будет дальше в предложении. Те же идеи сейчас используются для работы с последовательностями белков и ДНК, будто это длинные «слова». Для каждого белка модель производит «встраивание» — точку в пространстве высокой размерности, которая суммирует то, что модель знает об этом белке. Эти встраивания затем используются во множестве задач, например, для предсказания структуры, функции и влияния мутаций. В отличие от привычных оценок предсказаний или мер уверенности, встраивания обычно принимают как есть: если модель выдала вектор, пользователи склонны ему доверять, даже в областях белкового пространства, которые модель видела лишь мало во время обучения.

Определение, когда модель угадывает

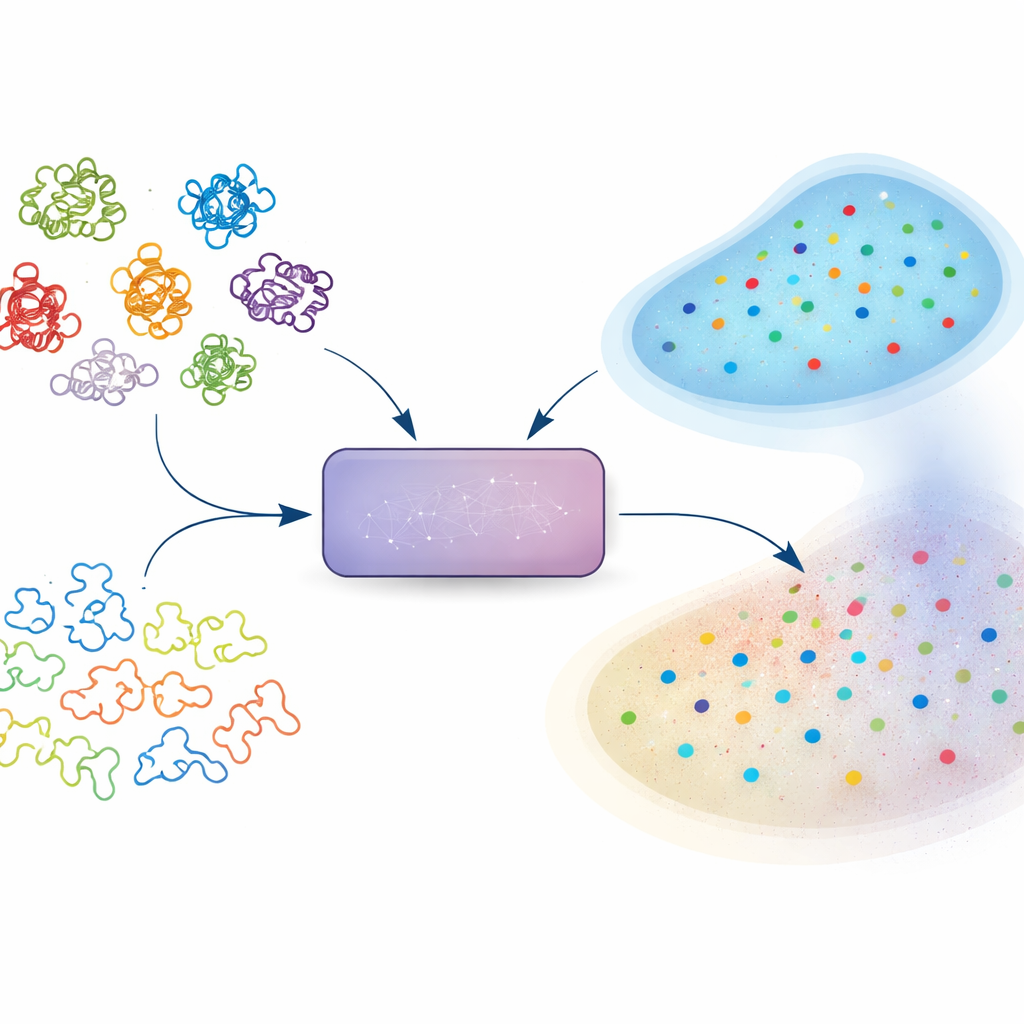

Авторы предлагают практический способ оценить, насколько можно доверять встраиванию, не меняя саму модель. Ключевая идея состоит в том, чтобы дать модели набор целенаправленно перемешанных последовательностей белков, которые сохраняют ту же основную композицию, но теряют все значимые биологические шаблоны. Эти синтетические последовательности служат «мусорной свалкой» — эталоном того, что модель производит, когда нет реального сигнала для обучения. Для любого реального белка метод проверяет, сколько из его ближайших соседей во внутреннем пространстве модели принадлежат этой свалке. Если многие ближайшие точки исходят от перемешанных последовательностей, представление белка, вероятно, недостаточно изучено или неоднозначно. Авторы называют эту долю соседей с мусорной свалки Случайным Соседним Баллом (Random Neighbor Score, RNS).

Связь неопределённости с реальной производительностью

Чтобы проверить, действительно ли RNS отражает нечто биологически важное, команда проанализировала большие наборы структур и последовательностей белков, используя несколько современных моделей, включая ESM-2 и ProtT5. Они обнаружили, что белки с точно предсказанной структурой обычно имели низкий RNS — их встраивания были далеко от мусорной свалки. Напротив, белки с плохими структурными предсказаниями находились в регионах, где реальные и перемешанные последовательности перекрывались. Эта закономерность наблюдалась для разных моделей и задач. При рассмотрении более прикладных задач, таких как предсказание контактов между остатками в 3D или присвоение вторичной структуры, точность заметно падала с ростом RNS. Иными словами, чем менее уверенна модель в встраивании (выше RNS), тем менее надёжно работает последующий предсказательный инструмент.

Слепые зоны в белковом пространстве

RNS также выявил системные слепые зоны в том, как модели представляют разные части белкового мира. Внутренне неупорядоченные регионы — гибкие участки без устойчивой структуры — постоянно имели более высокий RNS, чем хорошо структурированные домены, что показывает, что моделям сложнее работать с этими «скользкими» последовательностями. Даже в хорошо изученном человеческом протеоме значительная доля белков имела ненулевой RNS, указывая на то, что они плохо описываются популярными моделями. Удивительно, но большие модели не всегда были лучше: крупная модель, ориентированная на структуру, могла оказаться более неопределённой относительно многих человеческих белков, чем меньшая, более общая модель. Для недавно обнаруженных метагеномных белков и даже для компьютерно сгенерированных «галлюцинированных» белков, созданных так, чтобы выглядеть реалистично, низкий RNS указывал на то, что модели могут уверенно обобщать за пределы обучающих данных, когда шаблоны согласованы.

Лучшие фильтры — для более точного биологического понимания

Далее авторы проверили, как скрининг на основе RNS влияет на клинически значимую задачу: предсказание того, нарушит ли одиночная замена аминокислоты в человеческом белке его функцию или вызовет заболевание. Когда анализ ограничивали белками с низким RNS — где встраивания казались надёжными — производительность моделей заметно улучшалась, часто обеспечивая хорошее различие между вредными и нейтральными вариантами. Для белков с высоким RNS предсказания падали до уровня, близкого к подбрасыванию монетки. Это подтверждает идею о том, что ненадёжные встраивания незаметно ограничивают максимально достижимую точность любых последующих инструментов, построенных на их основе, независимо от хитрых приёмов обучения.

Что это значит для использования ИИ в биологии

Для неспециалистов вывод прост: не все представления белков, полученные с помощью ИИ, одинаково надёжны, и теперь эту надёжность можно количественно оценить. Random Neighbor Score служит простым, независимым от модели индикатором состояния встраиваний: низкие значения означают, что белок находится среди других биологически значимых последовательностей, тогда как высокие значения указывают, что он дрейфует к «мусорной свалке» случайных похожих последовательностей. Фильтруя или взвешивая белки по RNS перед предсказанием структуры, аннотированием функций или приоритизацией заболеваний, исследователи могут сосредоточиться на областях, где модель действительно «понимает» данные. Так же, как ни один учёный не стал бы пользоваться размытым микроскопом, не заметив этого, эта работа утверждает, что у каждой языковой модели белков должен быть встроенный способ оценивать чёткость её внутреннего взгляда на биологию.

Цитирование: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Ключевые слова: языковые модели белков, надёжность встраиваемых представлений, неопределённость представлений, предсказание эффектов вариантов, внутренне неупорядоченные белки