Clear Sky Science · it

Quantificare l'incertezza nelle rappresentazioni proteiche tra modelli e compiti

Perché l'affidabilità nell'IA per le proteine è importante

L'intelligenza artificiale è diventata un potente microscopio per il mondo invisibile delle proteine. I moderni “modelli linguistici per proteine” possono indovinare l'aspetto tridimensionale di una proteina e come potrebbe comportarsi, basandosi solo sulla sua sequenza di mattoncini. Questi modelli stanno già aiutando a progettare nuovi farmaci e a capire le mutazioni legate alle malattie. Ma esiste un problema nascosto: raramente comunicano quanto dovremmo fidarci delle rappresentazioni interne che producono. Questo articolo affronta quel vuoto ponendo una domanda semplice ma dalle grandi conseguenze: quando un modello trasforma una proteina in una nuvola di numeri, come possiamo capire se quella nuvola riflette davvero la biologia o è solo rumore?

Dalle frasi alle proteine

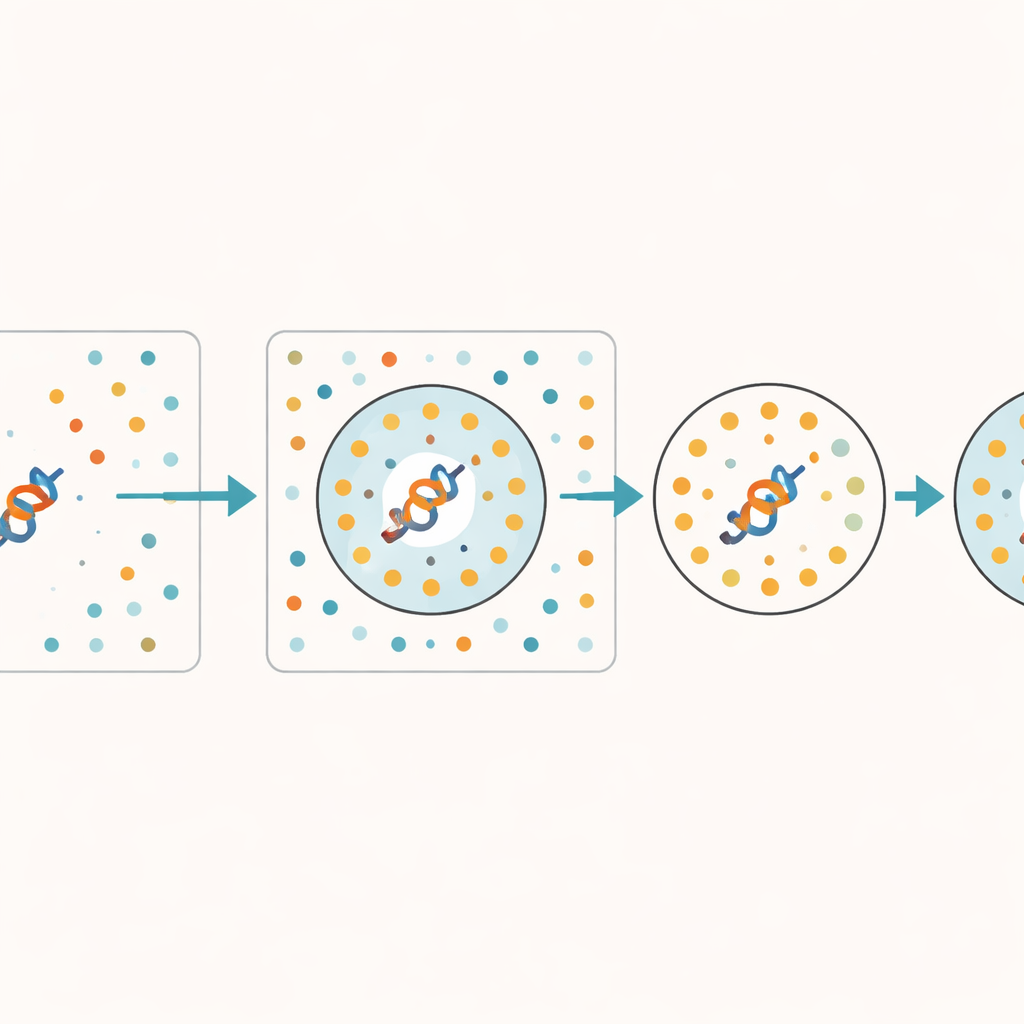

I modelli linguistici sono stati sviluppati inizialmente per trattare il testo umano, imparando come le parole si relazionano e prevedendo cosa segue in una frase. Le stesse idee ora alimentano modelli che leggono sequenze di proteine e di DNA come se fossero lunghe parole. Per ogni proteina, il modello produce un “embedding”—un punto in uno spazio ad alta dimensionalità pensato per riassumere ciò che il modello sa su quella proteina. Questi embedding sono poi impiegati in numerosi compiti downstream, come prevedere struttura, funzione e l'impatto delle mutazioni. Eppure, a differenza dei punteggi di previsione o delle misure di confidenza abituali, gli embedding vengono solitamente accettati così come sono: se il modello restituisce un vettore, gli utenti tendono a fidarsi, anche in regioni dello spazio delle proteine che il modello ha visto pochissimo durante l'addestramento.

Rilevare quando il modello sta indovinando

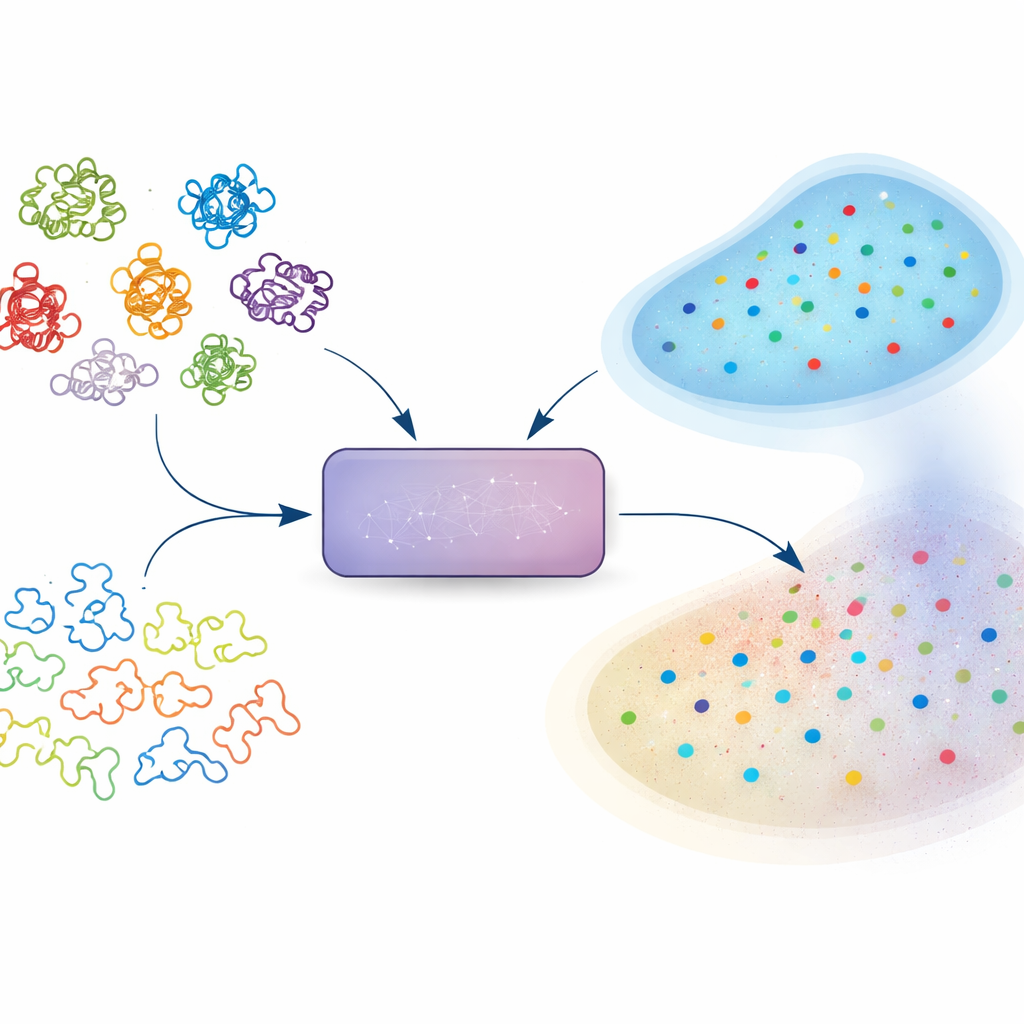

Gli autori propongono un modo pratico per stimare quanto sia affidabile un embedding, senza modificare il modello sottostante. L'idea chiave è fornire al modello un insieme di sequenze proteiche deliberatamente mescolate che mantengono la stessa composizione di base ma perdono tutti i pattern biologici significativi. Queste sequenze sintetiche fungono da “discarica”—un riferimento per ciò che il modello produce quando non c'è alcun segnale reale da apprendere. Per ogni proteina reale, il metodo verifica quanti dei suoi vicini più prossimi nello spazio interno del modello appartengono a questa discarica. Se molti punti vicini provengono da sequenze mescolate, la rappresentazione della proteina è probabilmente poco appresa o ambigua. Gli autori chiamano questa frazione di vicini della discarica il Random Neighbor Score (RNS).

Collegare l'incertezza alle prestazioni reali

Per capire se l'RNS riflette davvero qualcosa di biologicamente rilevante, il team ha analizzato grandi collezioni di strutture e sequenze proteiche usando diversi modelli all'avanguardia, inclusi ESM-2 e ProtT5. Hanno scoperto che le proteine le cui strutture erano previste accuratamente tendevano ad avere RNS basso—cioè i loro embedding stavano lontano dalla discarica. Al contrario, le proteine con previsioni strutturali scadenti si trovavano in regioni dove sequenze reali e mescolate si sovrapponevano. Questo schema è rimasto valido attraverso modelli e compiti differenti. Quando hanno considerato problemi più applicati, come prevedere quali residui amminoacidici sono a contatto in 3D o assegnare la struttura secondaria, hanno osservato un chiaro calo di accuratezza all'aumentare dell'RNS. In altre parole, meno è certa la rappresentazione (RNS più alto), meno affidabile è la previsione downstream.

Punti ciechi nello spazio delle proteine

L'RNS ha anche rivelato punti ciechi sistematici nel modo in cui i modelli rappresentano diverse parti dell'universo proteico. Le regioni intrinsecamente disordinate—tratti flessibili che non hanno una struttura stabile—avevano costantemente RNS più alti rispetto ai domini ben strutturati, indicando che i modelli faticano di più con queste sequenze scivolose. Anche all'interno del ben studiato proteoma umano, una frazione sostanziale di proteine mostrava RNS non nullo, indicando che non sono ben catturate dai modelli popolari. Sorprendentemente, i modelli più grandi non erano sempre migliori: un modello ampio, focalizzato sulla struttura, poteva essere più incerto su molte proteine umane rispetto a uno più piccolo e più generale. Per proteine metagenomiche recentemente scoperte e persino per proteine “allucinate” progettate al computer per sembrare realistiche, un RNS basso suggeriva che i modelli possono generalizzare con fiducia oltre i dati di addestramento quando i pattern sono coerenti.

Filtri migliori per approfondire la biologia

Gli autori hanno poi testato come lo screening basato su RNS influisce su un compito rilevante clinicamente: prevedere se una singola sostituzione in una proteina umana è probabile che ne comprometta la funzione o causi malattia. Quando hanno limitato l'analisi alle proteine con RNS basso—dove gli embedding apparivano affidabili—le prestazioni del modello sono migliorate notevolmente, spesso raggiungendo una solida discriminazione tra varianti dannose e neutrali. Per le proteine con RNS alto, le previsioni sono scese verso livelli casuali. Questo supporta l'idea che embedding inaffidabili limitino silenziosamente la massima accuratezza possibile di qualsiasi strumento downstream costruito su di essi, indipendentemente da trucchi di addestramento più sofisticati.

Cosa significa per l'uso dell'IA in biologia

Per i non specialisti, la conclusione è che non tutte le rappresentazioni proteiche derivate dall'IA sono ugualmente affidabili, e che ora questa affidabilità può essere quantificata. Il Random Neighbor Score agisce come un semplice controllo di salute, indipendente dal modello, sugli embedding: punteggi bassi indicano che una proteina si trova tra altre sequenze biologicamente significative, mentre punteggi alti suggeriscono che deriva verso una discarica di imitazioni casuali. Filtrando o pesando le proteine in base all'RNS prima di effettuare previsioni strutturali, annotare funzioni o prioritizzare varianti patologiche, i ricercatori possono concentrarsi sulle regioni in cui il modello veramente “capisce” i dati. Proprio come nessuno scienziato userebbe un microscopio sfocato senza rendersene conto, questo lavoro sostiene che ogni modello linguistico per le proteine dovrebbe essere accompagnato da un modo incorporato per valutare la nitidezza della sua visione interna della biologia.

Citazione: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Parole chiave: modelli linguistici per proteine, affidabilità degli embedding, incertezza delle rappresentazioni, predizione dell'effetto delle varianti, proteine intrinsecamente disordinate