Clear Sky Science · pt

Quantificando a incerteza nas representações de proteínas entre modelos e tarefas

Por que a confiabilidade em IA para proteínas importa

A inteligência artificial tornou-se um poderoso microscópio para o mundo invisível das proteínas. Os modernos “modelos de linguagem para proteínas” podem inferir a aparência 3D de uma proteína e como ela pode se comportar apenas a partir de sua sequência de blocos de construção. Esses modelos já ajudam a projetar novos medicamentos e a entender mutações relacionadas a doenças. Mas existe um problema oculto: raramente informam o quanto devemos confiar nas representações internas que produzem. Este artigo aborda essa lacuna fazendo uma pergunta simples com grandes consequências: quando um modelo transforma uma proteína em uma nuvem de números, como sabemos se essa nuvem realmente reflete biologia real ou é apenas ruído?

De frases a proteínas

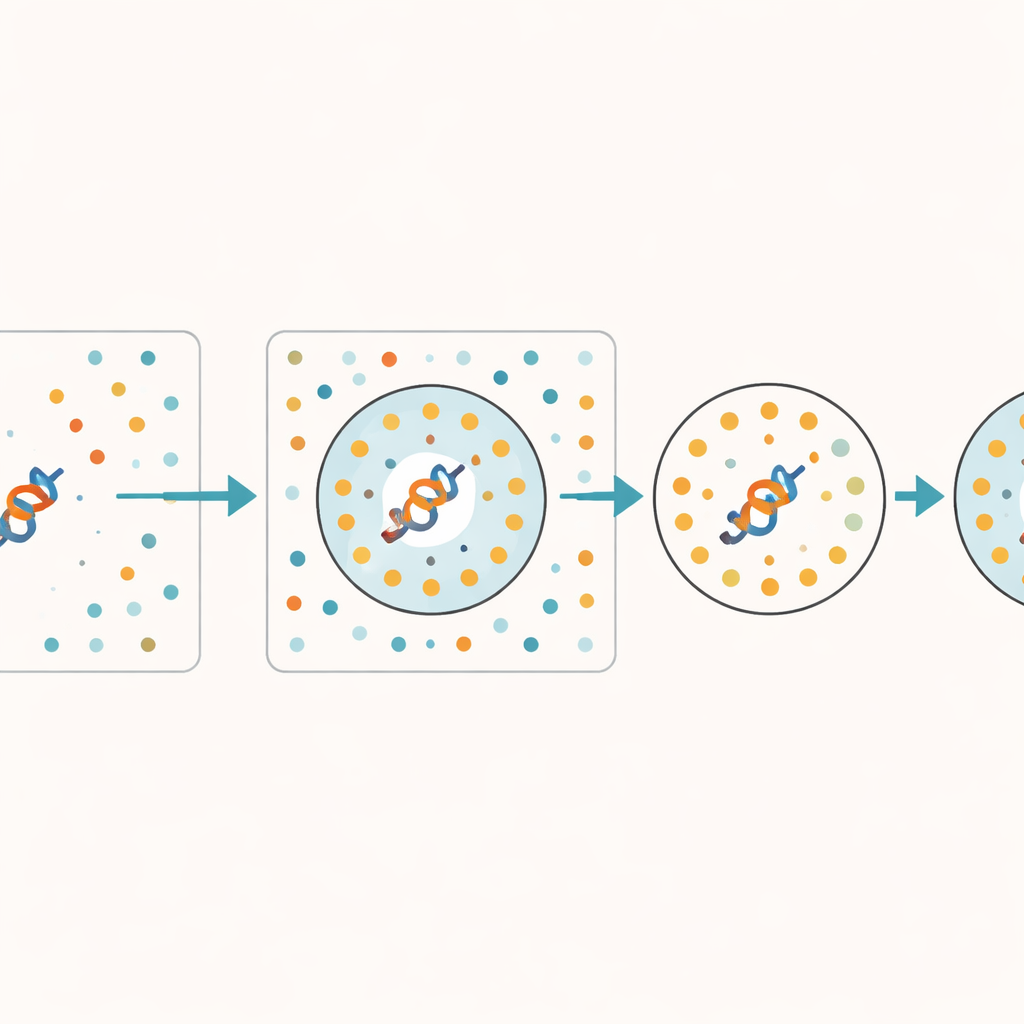

Modelos de linguagem foram inicialmente desenvolvidos para lidar com texto humano, aprendendo como as palavras se relacionam e prevendo o que vem a seguir em uma frase. As mesmas ideias agora impulsionam modelos que leem sequências de proteínas e DNA como se fossem longas palavras. Para cada proteína, o modelo produz um “embedding” — um ponto em um espaço de alta dimensão destinado a resumir o que o modelo sabe sobre essa proteína. Esses embeddings são usados em muitas tarefas posteriores, como prever estrutura, função e o impacto de mutações. No entanto, ao contrário de pontuações de previsão familiares ou medidas de confiança, embeddings costumam ser aceitos sem questionamento: se o modelo gera um vetor, os usuários tendem a confiar nele, mesmo em regiões do espaço proteico que o modelo viu pouco durante o treinamento.

Detectando quando o modelo está chutando

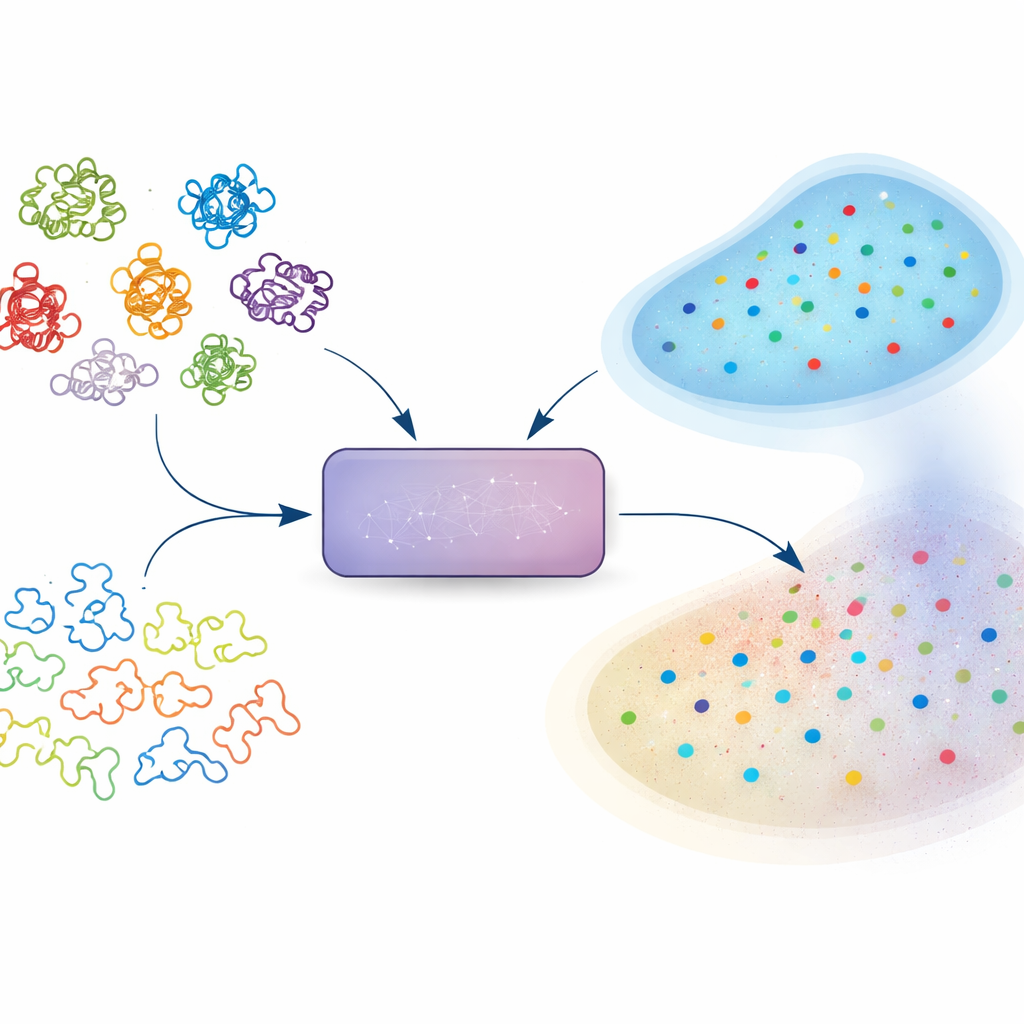

Os autores propõem uma forma prática de estimar quão confiável é um embedding, sem modificar o modelo subjacente. A ideia central é fornecer ao modelo um conjunto de sequências de proteínas propositadamente embaralhadas que mantêm a mesma composição básica, mas perdem todos os padrões biológicos significativos. Essas sequências sintéticas atuam como um “lixão” — uma referência para o que o modelo produz quando não há sinal real a aprender. Para qualquer proteína real, o método verifica quantos de seus vizinhos mais próximos no espaço interno do modelo pertencem a esse lixão. Se muitos pontos próximos vierem de sequências embaralhadas, a representação da proteína provavelmente está pouco aprendida ou é ambígua. Os autores chamam essa fração de vizinhos do lixão de Random Neighbor Score (RNS).

Vinculando incerteza ao desempenho no mundo real

Para testar se o RNS realmente reflete algo biologicamente importante, a equipe analisou grandes coleções de estruturas e sequências de proteínas usando vários modelos de ponta, incluindo ESM-2 e ProtT5. Eles descobriram que proteínas cujas estruturas foram previstas com precisão tendiam a ter RNS baixo — o que significa que seus embeddings estavam longe do lixão. Em contraste, proteínas com previsões estruturais pobres viviam em regiões onde sequências reais e embaralhadas se sobrepunham. Esse padrão se manteve entre diferentes modelos e tarefas. Quando analisaram problemas mais aplicados, como prever quais resíduos de aminoácidos entram em contato em 3D ou atribuir estrutura secundária, observaram uma queda clara na acurácia conforme o RNS aumentava. Em outras palavras, quanto menos certo o embedding (RNS mais alto), menos confiável é a predição subsequente.

Pontos cegos no espaço proteico

O RNS também revelou pontos cegos sistemáticos em como os modelos representam diferentes partes do universo das proteínas. Regiões intrinsecamente desordenadas — trechos flexíveis que não têm uma estrutura estável — apresentaram RNS consistentemente mais altos do que domínios bem estruturados, mostrando que os modelos têm mais dificuldade com essas sequências escorregadias. Mesmo dentro do bem estudado proteoma humano, uma fração substancial de proteínas tinha RNS não nulo, indicando que não são bem capturadas por modelos populares. Surpreendentemente, modelos maiores nem sempre foram melhores: um grande modelo focado em estrutura poderia ser mais incerto sobre muitas proteínas humanas do que um modelo menor e mais geral. Para proteínas metagenômicas recém-descobertas e até proteínas “alucinadas” projetadas por computador para parecerem realistas, RNS baixo sugeriu que os modelos podem generalizar com confiança além dos dados de treinamento quando os padrões são coerentes.

Filtros melhores para insights biológicos melhores

Os autores então testaram como a triagem baseada em RNS afeta uma tarefa clinicamente relevante: prever se uma mudança de uma letra em uma proteína humana é provável de prejudicar sua função ou causar doença. Ao restringir a análise a proteínas com RNS baixo — onde os embeddings pareciam confiáveis — o desempenho do modelo melhorou marcadamente, muitas vezes alcançando forte discriminação entre variantes prejudiciais e neutras. Para proteínas com RNS alto, as previsões caíram a níveis próximos ao acaso. Isso corrobora a visão de que embeddings não confiáveis silenciosamente limitam a melhor acurácia possível de qualquer ferramenta subsequente construída sobre eles, independentemente de truques de treinamento sofisticados.

O que isso significa para o uso de IA na biologia

Para não especialistas, a lição é que nem todas as representações de proteínas derivadas por IA são igualmente confiáveis, e que essa confiabilidade agora pode ser quantificada. O Random Neighbor Score funciona como uma checagem simples e agnóstica ao modelo sobre a saúde dos embeddings: pontuações baixas indicam que uma proteína está entre outras sequências biologicamente significativas, enquanto pontuações altas sugerem que ela deriva para um lixão de semelhantes aleatórios. Ao filtrar ou ponderar proteínas com base no RNS antes de fazer previsões estruturais, anotar funções ou priorizar variantes de doença, os pesquisadores podem se concentrar em regiões onde o modelo realmente “entende” os dados. Assim como nenhum cientista usaria um microscópio desfocado sem perceber, este trabalho argumenta que todo modelo de linguagem para proteínas deveria vir com uma maneira integrada de avaliar a nitidez de sua visão interna da biologia.

Citação: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Palavras-chave: modelos de linguagem para proteínas, confiabilidade de embeddings, incerteza de representação, predição do efeito de variantes, proteínas intrinsecamente desordenadas