Clear Sky Science · de

Quantifizierung der Unsicherheit in Proteinrepräsentationen über Modelle und Aufgaben hinweg

Warum Zuverlässigkeit in Protein-KI wichtig ist

Künstliche Intelligenz ist zu einem leistungsstarken Mikroskop für die unsichtbare Welt der Proteine geworden. Moderne „Protein‑Sprachmodelle“ können allein aus der Aminosäuresequenz abschätzen, wie ein Protein in 3D aussehen und sich verhalten könnte. Diese Modelle helfen bereits bei der Wirkstoffentwicklung und beim Verständnis krankheitsauslösender Mutationen. Es gibt jedoch ein verborgenes Problem: Sie sagen selten, wie sehr man den internen Repräsentationen, die sie erzeugen, vertrauen sollte. Dieses Papier schließt diese Lücke mit einer einfachen, aber folgenreichen Frage: Wenn ein Modell ein Protein in eine Zahlenwolke übersetzt, wie lässt sich feststellen, ob diese Wolke echte Biologie widerspiegelt oder nur Rauschen ist?

Von Sätzen zu Proteinen

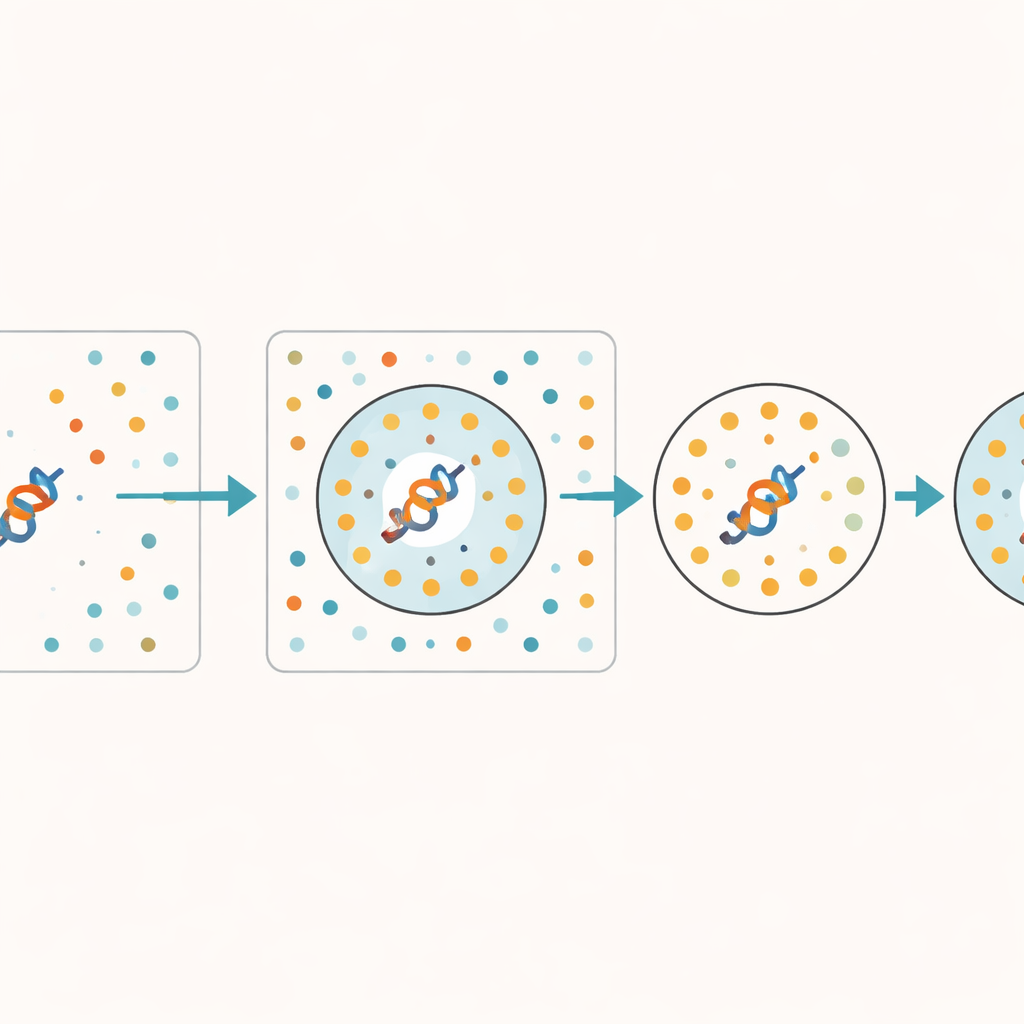

Sprachmodelle wurden ursprünglich für menschlichen Text entwickelt: Sie lernen, wie Wörter zusammenhängen, und sagen voraus, was als Nächstes kommt. Dieselben Ideen treiben heute Modelle an, die Protein‑ und DNA‑Sequenzen wie lange Wörter lesen. Für jedes Protein erzeugt das Modell eine „Einbettung“—einen Punkt in einem hochdimensionalen Raum, der zusammenfassen soll, was das Modell über dieses Protein weiß. Diese Einbettungen werden in viele nachgelagerte Aufgaben eingespeist, etwa Vorhersage von Struktur, Funktion und Mutationsauswirkungen. Anders als vertraute Vorhersagewerte oder Konfidenzmaße werden Einbettungen jedoch meist für bare Münze genommen: Wenn das Modell einen Vektor ausgibt, vertrauen Anwender ihm häufig, selbst in Bereichen des Proteomraums, die das Modell während des Trainings kaum gesehen hat.

Erkennen, wann das Modell rät

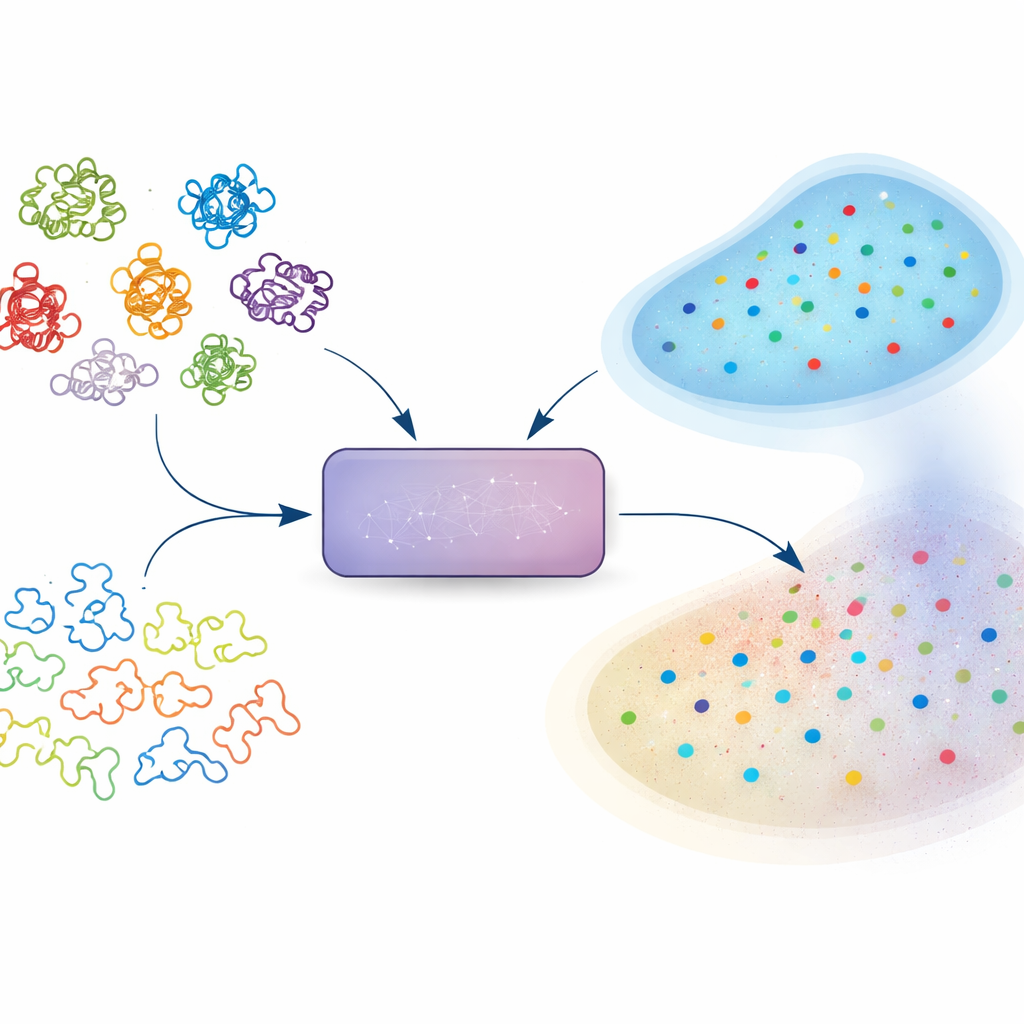

Die Autoren schlagen eine praktische Methode vor, um abzuschätzen, wie vertrauenswürdig eine Einbettung ist, ohne das zugrunde liegende Modell zu verändern. Die zentrale Idee ist, dem Modell eine Reihe bewusst durcheinandergebrachter Proteinsequenzen zu geben, die zwar dieselbe Basiskomposition behalten, aber alle biologisch sinnvollen Muster verlieren. Diese synthetischen Sequenzen fungieren als „Schrottplatz“—als Referenz dafür, was das Modell produziert, wenn kein echtes Signal vorhanden ist. Für jedes reale Protein prüft die Methode, wie viele seiner nächsten Nachbarn im internen Raum des Modells zu diesem Schrottplatz gehören. Wenn viele nahe Punkte von durcheinandergebrachten Sequenzen stammen, ist die Repräsentation des Proteins wahrscheinlich unzureichend gelernt oder mehrdeutig. Die Autoren nennen diesen Anteil an Schrottplatz‑Nachbarn den Random Neighbor Score (RNS).

Unsicherheit mit realer Leistung verknüpfen

Um zu prüfen, ob RNS tatsächlich biologisch relevantes widerspiegelt, analysierte das Team große Sammlungen von Proteinstrukturen und -sequenzen mit mehreren modernen Modellen, darunter ESM‑2 und ProtT5. Sie fanden heraus, dass Proteine, deren Strukturen genau vorhergesagt wurden, tendenziell niedrigen RNS aufwiesen—ihre Einbettungen lagen also weit vom Schrottplatz entfernt. Dagegen befanden sich Proteine mit schlechten Strukturvorhersagen in Bereichen, in denen reale und durcheinandergebrachte Sequenzen überlappten. Dieses Muster zeigte sich modell‑ und aufgabenübergreifend. Bei praktischeren Problemen, etwa der Vorhersage, welche Aminosäurereste in 3D miteinander in Kontakt stehen, oder der Zuordnung von Sekundärstruktur, beobachteten sie einen klaren Leistungsabfall, wenn der RNS zunahm. Anders gesagt: Je unsicherer die Einbettung (höherer RNS), desto weniger zuverlässig die nachgelagerte Vorhersage.

Blinde Flecken im Proteinraum

RNS deckte auch systematische blinde Flecken auf, wie Modelle verschiedene Bereiche des Proteinuniversums repräsentieren. Intrinsisch ungeordnete Regionen—flexible Abschnitte ohne stabile Struktur—hatten durchweg höheren RNS als gut strukturierte Domänen, was zeigt, dass Modelle mit diesen schwer fassbaren Sequenzen stärker kämpfen. Selbst innerhalb des gut untersuchten menschlichen Proteoms hatten erhebliche Anteile von Proteinen einen von null verschiedenen RNS, was darauf hinweist, dass sie von populären Modellen nicht gut erfasst werden. Überraschenderweise waren größere Modelle nicht immer besser: Ein großes, strukturfokussiertes Modell konnte bei vielen menschlichen Proteinen unsicherer sein als ein kleineres, allgemeineren Modell. Bei neu entdeckten metagenomischen Proteinen und sogar bei computergenerierten „halluzinierten“ Proteinen, die so konstruiert wurden, realistisch zu wirken, deutete ein niedriger RNS darauf hin, dass Modelle bei kohärenten Mustern selbst außerhalb ihrer Trainingsdaten sicher generalisieren können.

Bessere Filter für besseren biologischen Einblick

Die Autoren testeten anschließend, wie sich eine RNS‑basierte Auswahl auf eine klinisch relevante Aufgabe auswirkt: die Vorhersage, ob eine Einzelbuchstabenänderung in einem menschlichen Protein dessen Funktion stören oder eine Krankheit verursachen dürfte. Beschränkten sie die Analyse auf Proteine mit niedrigem RNS—deren Einbettungen also verlässlich erschienen—verbesserte sich die Modellleistung deutlich und erreichte häufig eine starke Unterscheidung zwischen schädlichen und neutralen Varianten. Bei Proteinen mit hohem RNS fielen die Vorhersagen auf Zufallsniveau. Das stützt die Ansicht, dass unzuverlässige Einbettungen die maximal erreichbare Genauigkeit jedes darauf aufbauenden Werkzeugs stillschweigend begrenzen, unabhängig von ausgeklügelten Trainingsmethoden.

Was das für den Einsatz von KI in der Biologie bedeutet

Für Nicht‑Spezialisten lautet die Botschaft: Nicht alle KI‑abgeleiteten Proteinrepräsentationen sind gleichermaßen vertrauenswürdig, und diese Vertrauenswürdigkeit lässt sich nun quantifizieren. Der Random Neighbor Score fungiert als einfache, modellunabhängige Gesundheitsprüfung für Einbettungen: Niedrige Werte zeigen an, dass ein Protein zwischen anderen biologisch sinnvollen Sequenzen sitzt, während hohe Werte nahelegen, dass es in Richtung eines Schrottplatzes zufälliger Doppelgänger driftet. Indem Forscher Proteine vor Strukturvorhersagen, Funktionsannotationen oder Priorisierung von Krankheitsvarianten anhand des RNS filtern oder gewichten, können sie sich auf Bereiche konzentrieren, in denen das Modell die Daten tatsächlich „versteht“. So wie kein Wissenschaftler ein verschwommenes Mikroskop unbemerkt verwenden würde, argumentiert diese Arbeit dafür, dass jedes Protein‑Sprachmodell mit einer eingebauten Methode zur Einschätzung der Schärfe seiner internen Sicht auf die Biologie ausgestattet sein sollte.

Zitation: Prabakaran, R., Bromberg, Y. Quantifying uncertainty in protein representations across models and tasks. Nat Methods 23, 796–804 (2026). https://doi.org/10.1038/s41592-026-03028-7

Schlüsselwörter: Protein-Sprachmodelle, Einbettungszuverlässigkeit, Repräsentationsunsicherheit, Vorhersage von Variantenwirkungen, intrinsisch ungeordnete Proteine