Clear Sky Science · pt

Comprimindo o conhecimento coletivo do ESM em um único modelo de linguagem de proteínas

Por que transformar muitos modelos de proteínas em um só importa

Cada pessoa carrega milhões de pequenas diferenças em seu DNA, muitas das quais alteram um único bloco de construção nas proteínas. A maioria dessas mudanças é inofensiva, mas algumas podem causar doenças. Médicos e pesquisadores gostariam de uma forma rápida e precisa de dizer quais são quais, usando apenas a sequência proteica. Este artigo descreve uma nova estratégia que reúne o conhecimento coletivo de muitos “modelos de linguagem” de proteínas existentes e o comprime em um único sistema eficiente que rivaliza ou supera as melhores ferramentas atuais para avaliar o impacto de mudanças genéticas.

De ler frases a ler proteínas

Modelos de linguagem de proteínas aproveitam ideias da tecnologia que sustenta os sistemas modernos de tradução e diálogo. Em vez de aprender palavras em uma frase, eles aprendem padrões em sequências de aminoácidos, as letras das proteínas. Ao treinar em centenas de milhões de proteínas naturais, esses modelos captam sinais sobre quais posições são altamente conservadas e quais toleram variação. Esses padrões podem então ser usados para pontuar variantes genéticas: se uma mudança quebra um padrão que a evolução protege fortemente, é mais provável que seja prejudicial. Até agora, os métodos mais fortes combinavam esses modelos com informações extras, como estrutura 3D ou árvores evolutivas de família, tornando-os poderosos, porém complexos e às vezes difíceis de aplicar de forma ampla.

Deixando os modelos ensinarem uns aos outros

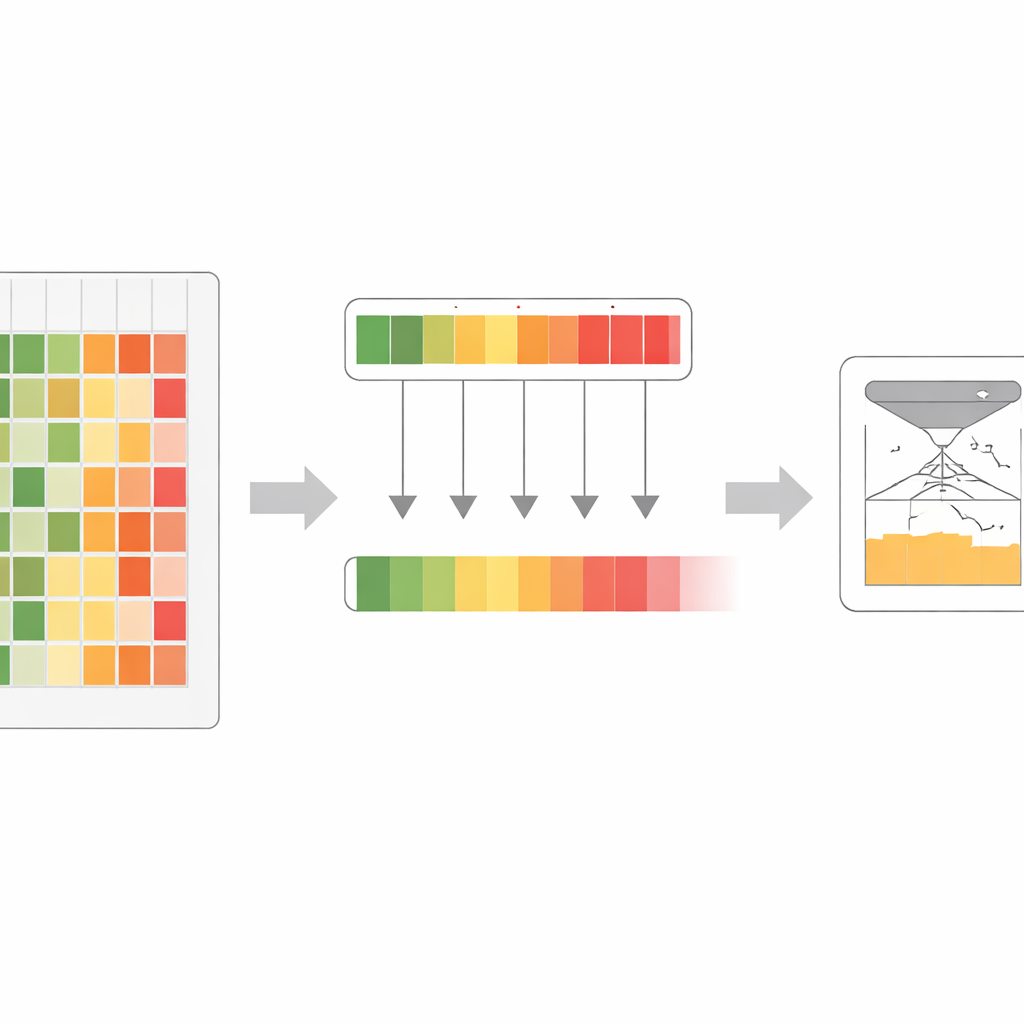

Os autores notaram que diferentes modelos de linguagem de proteínas, mesmo quando treinados em dados semelhantes, têm pontos fortes e pontos cegos distintos. Um modelo pode ser especialmente bom em detectar regiões sensíveis em uma família proteica, enquanto outro se destaca em outro lugar. Em vez de simplesmente fazer uma média das opiniões, a equipe introduziu uma regra de “confiança máxima”: para cada possível alteração proteica, eles examinam toda a família de modelos e mantêm aquele que está mais certo de que a mudança é danosa. Esse passo produz um conjunto enriquecido de escores que captura os sinais evolutivos de alerta mais fortes de qualquer modelo do grupo, em vez de diluí‑los.

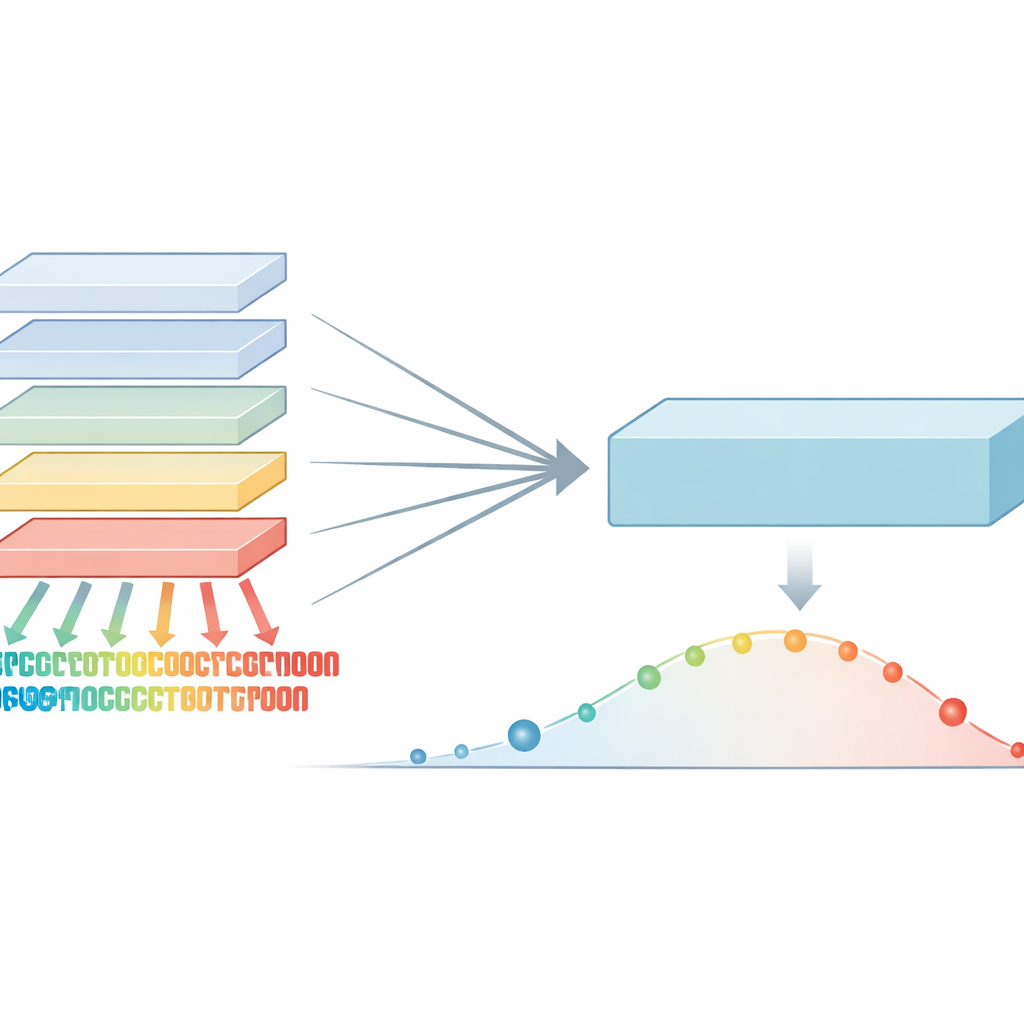

Destilando muitas vozes em uma

Com esse sinal enriquecido, os pesquisadores projetaram um processo de treinamento que chamam de co‑destilação. Aqui, todos os modelos originais praticam repetidamente igualar o sinal combinado mais forte, revezando‑se como “aluno” e “professor” dependendo de onde cada um está mais confiante. Nas primeiras rodadas, a regra de confiança máxima ajuda a destacar padrões sutis mas importantes que alguns modelos não captaram. Em rodadas posteriores, um passo de média mais suave ajuda os modelos a convergir e reduzir o ruído. Através de vários ciclos, um modelo grande gradualmente absorve quase toda a informação útil que antes estava espalhada pelo conjunto completo. Esse modelo final, chamado VESM‑3B, é então usado para treinar versões menores que rodam rápido o suficiente para grandes conjuntos de dados genéticos, mantendo a maior parte da precisão.

Superando sistemas complexos usando apenas sequências

Apesar de usar apenas sequências brutas de proteínas como entrada, os modelos VESM igualam ou superam concorrentes sofisticados que também dependem de estruturas 3D, histórias evolutivas construídas manualmente ou dados de populações humanas. Em benchmarks clínicos extraídos do banco de dados ClinVar de variantes de doença, o modelo principal VESM supera muitas ferramentas amplamente usadas e até ultrapassa o AlphaMissense, um sistema recente de destaque que combina estrutura e dados populacionais. Crucialmente, o desempenho do VESM se mantém para variantes muito raras, aquelas que os clínicos têm mais dificuldade em interpretar. Os modelos também se destacam em medidas laboratoriais que testam como mutações afetam a aptidão, a estabilidade e a ligação das proteínas, e conseguem acompanhar a magnitude e a direção dos efeitos de variantes em características clínicas reais em grandes coortes biobank.

O que isso significa para genética e medicina

Ao combinar e refinar cuidadosamente os pontos fortes de muitos modelos de sequência, este trabalho mostra que as sequências brutas de proteínas por si só podem conter sinal suficiente para prever o impacto de mudanças genéticas em níveis de ponta. O resultado é uma família de ferramentas mais simples de implantar do que sistemas pesados em estrutura ou famintos por dados, mas que permanecem altamente precisas em proteínas humanas, microbianas e virais. Para clínicos e pesquisadores, isso significa triagem de variantes de DNA mais rápida e confiável, uma noção mais clara de quão fortemente uma mudança pode influenciar traços relacionados a doenças, e uma maneira prática de levar modelos preditivos poderosos para fluxos de trabalho diários em genética e design de proteínas.

Citação: Dinh, T., Jang, SK., Zaitlen, N. et al. Compressing the collective knowledge of ESM into a single protein language model. Nat Methods 23, 772–784 (2026). https://doi.org/10.1038/s41592-026-03050-9

Palavras-chave: modelos de linguagem de proteínas, predição do efeito de variantes, variantes genéticas, sinais evolutivos, genômica clínica