Clear Sky Science · es

Comprimir el conocimiento colectivo de ESM en un único modelo de lenguaje para proteínas

Por qué importa convertir muchos modelos de proteínas en uno

Cada persona lleva millones de pequeñas diferencias en su ADN, muchas de las cuales cambian un solo bloque de construcción en las proteínas. La mayoría de esos cambios son inofensivos, pero algunos pueden provocar enfermedad. Médicos e investigadores desean una forma rápida y precisa de distinguir unos de otros usando solo la secuencia de la proteína. Este artículo describe una nueva estrategia que toma el saber colectivo de muchos “modelos de lenguaje” de proteínas existentes y lo comprime en un único sistema eficiente que iguala o supera a las mejores herramientas actuales para evaluar el impacto de cambios genéticos.

De leer frases a leer proteínas

Los modelos de lenguaje para proteínas toman ideas de la tecnología que impulsa los sistemas modernos de traducción y conversación. En lugar de aprender palabras en una frase, aprenden patrones en cadenas de aminoácidos, las letras de las secuencias proteicas. Al entrenar con cientos de millones de proteínas naturales, estos modelos captan señales sobre qué posiciones están muy conservadas y cuáles toleran cambios. Esos patrones se pueden usar para puntuar variantes genéticas: si un cambio rompe un patrón que la evolución protege con fuerza, es más probable que sea dañino. Hasta ahora, los métodos más potentes combinaban estos modelos con información adicional como estructura 3D o árboles evolutivos, lo que los hacía poderosos pero también complejos y, a veces, difíciles de aplicar de forma general.

Dejar que los modelos se enseñen entre sí

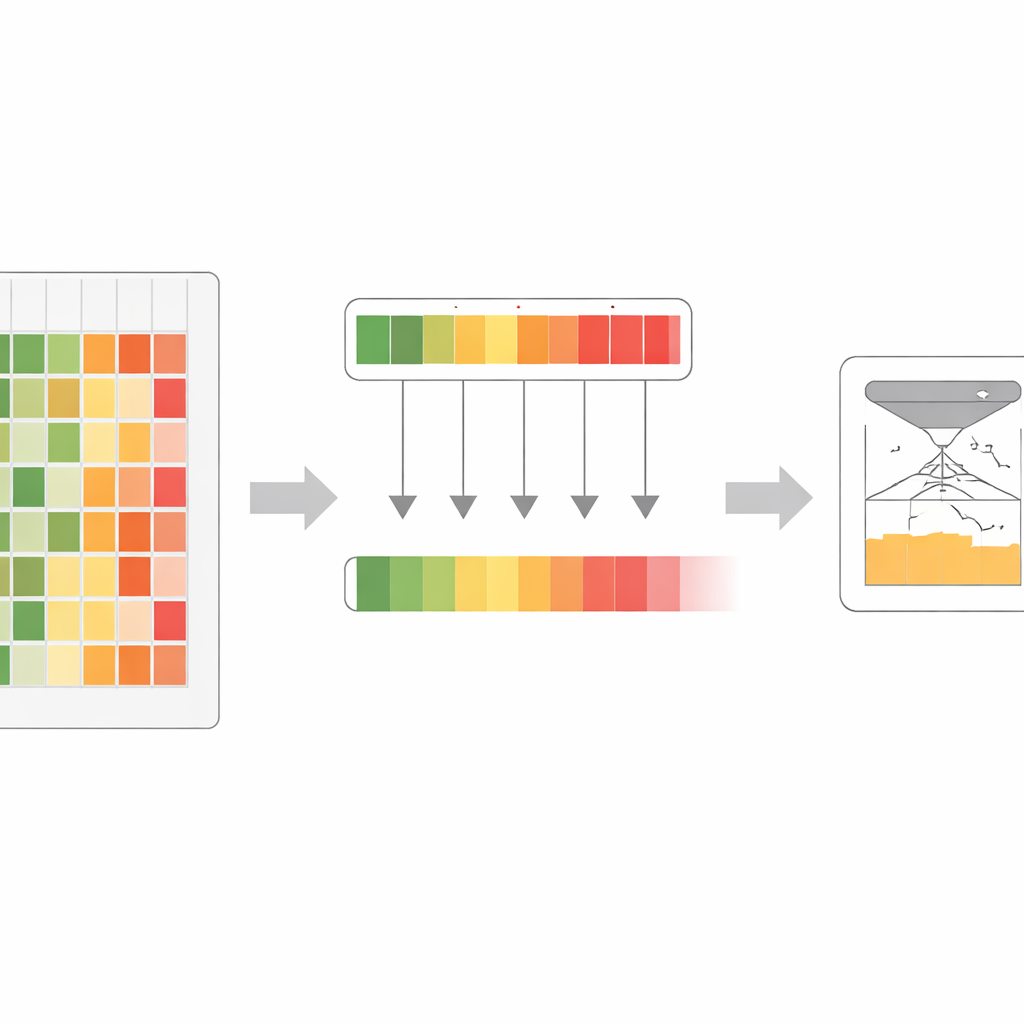

Los autores observaron que distintos modelos de lenguaje para proteínas, incluso cuando se construyen con datos similares, tienen fortalezas y puntos ciegos distintos. Un modelo puede ser especialmente agudo para detectar regiones sensibles en una familia proteica, mientras que otro sobresale en otra parte. En lugar de promediar sus opiniones, el equipo introdujo una regla de “confianza máxima”: para cada posible cambio proteico, examinan toda la familia de modelos y mantienen el que sea más seguro de que el cambio es dañino. Este paso produce un conjunto enriquecido de puntuaciones que captura las señales evolutivas de advertencia más fuertes de cualquier modelo del grupo, en lugar de diluirlas.

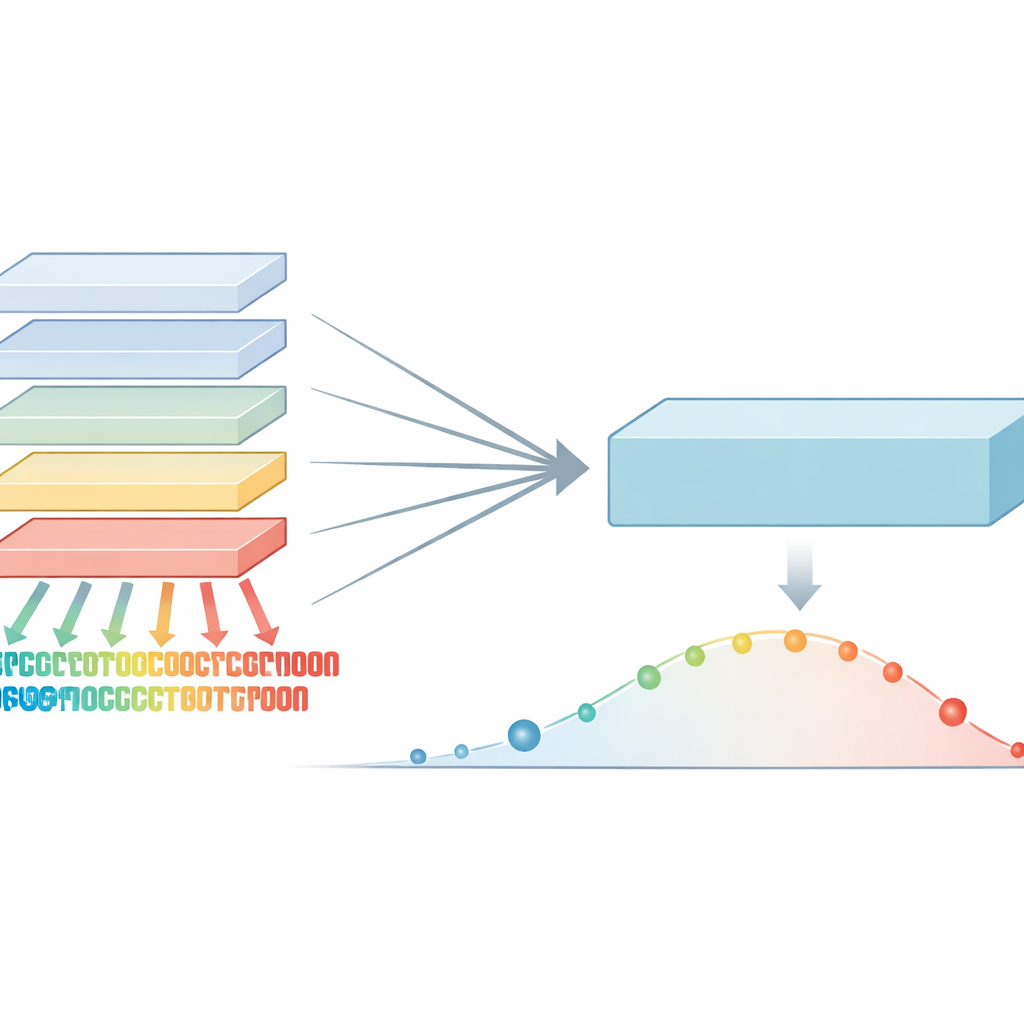

Condensar muchas voces en una

Trabajando con esta señal enriquecida, los investigadores diseñaron un proceso de entrenamiento que llaman co‑distillation. Aquí, todos los modelos originales practican repetidamente para igualar la señal combinada más fuerte, turnándose como “estudiante” y “profesor” según dónde cada uno tenga mayor confianza. En rondas tempranas, la regla de confianza máxima ayuda a resaltar patrones sutiles pero importantes que algunos modelos pasaron por alto. En rondas posteriores, un paso de promediado más suave ayuda a que los modelos concuerden y atenúen el ruido. A lo largo de varios ciclos, un modelo grande absorbe gradualmente casi toda la información útil que antes estaba repartida por el conjunto completo. Este modelo final, llamado VESM‑3B, se usa luego para entrenar versiones más pequeñas que se ejecutan lo suficientemente rápido para grandes conjuntos de datos genéticos manteniendo la mayor parte de la precisión.

Superar sistemas complejos usando solo secuencias

A pesar de usar solo secuencias proteicas sin procesar como entrada, los modelos VESM igualan o superan a competidores sofisticados que también se basan en estructuras 3D, historias evolutivas construidas a mano o datos de poblaciones humanas. En puntos de referencia clínicos extraídos de la base de datos ClinVar de variantes asociadas a enfermedad, el modelo principal de VESM supera a muchas herramientas de uso extendido e incluso aventaja a AlphaMissense, un sistema reciente y de alto perfil que combina estructura y datos poblacionales. De forma crucial, el rendimiento de VESM se mantiene para variantes muy raras, aquellas que más cuestan interpretar a los clínicos. Los modelos también sobresalen en mediciones de laboratorio que prueban cómo las mutaciones afectan la aptitud, la estabilidad y la unión de proteínas, y pueden seguir el tamaño y la dirección de los efectos de las variantes sobre rasgos clínicos reales en grandes biobancos.

Qué supone esto para la genética y la medicina

Al combinar y refinar cuidadosamente las fortalezas de muchos modelos basados en secuencias, este trabajo demuestra que las secuencias proteicas crudas por sí solas pueden llevar suficiente señal para predecir el impacto de cambios genéticos a niveles de vanguardia. El resultado es una familia de herramientas más sencilla de desplegar que los sistemas pesados en estructura o exigentes en datos, y aun así muy precisa en proteínas humanas, microbianas y virales. Para clínicos e investigadores, esto significa un cribado de variantes de ADN más rápido y fiable, una idea más clara de cuán fuertemente un cambio puede influir en rasgos relacionados con la enfermedad y una forma práctica de llevar modelos predictivos potentes a los flujos de trabajo cotidianos de genética y diseño de proteínas.

Cita: Dinh, T., Jang, SK., Zaitlen, N. et al. Compressing the collective knowledge of ESM into a single protein language model. Nat Methods 23, 772–784 (2026). https://doi.org/10.1038/s41592-026-03050-9

Palabras clave: modelos de lenguaje para proteínas, predicción del efecto de variantes, variantes genéticas, señales evolutivas, genómica clínica