Clear Sky Science · pl

YOLO-MFD: wieloskalowa sieć cech i dynamiczna głowica dla wykrywania obiektów pod wodą przy prefabrykowanych brzegach

Bystrzejsze spojrzenie pod miejskie nabrzeża

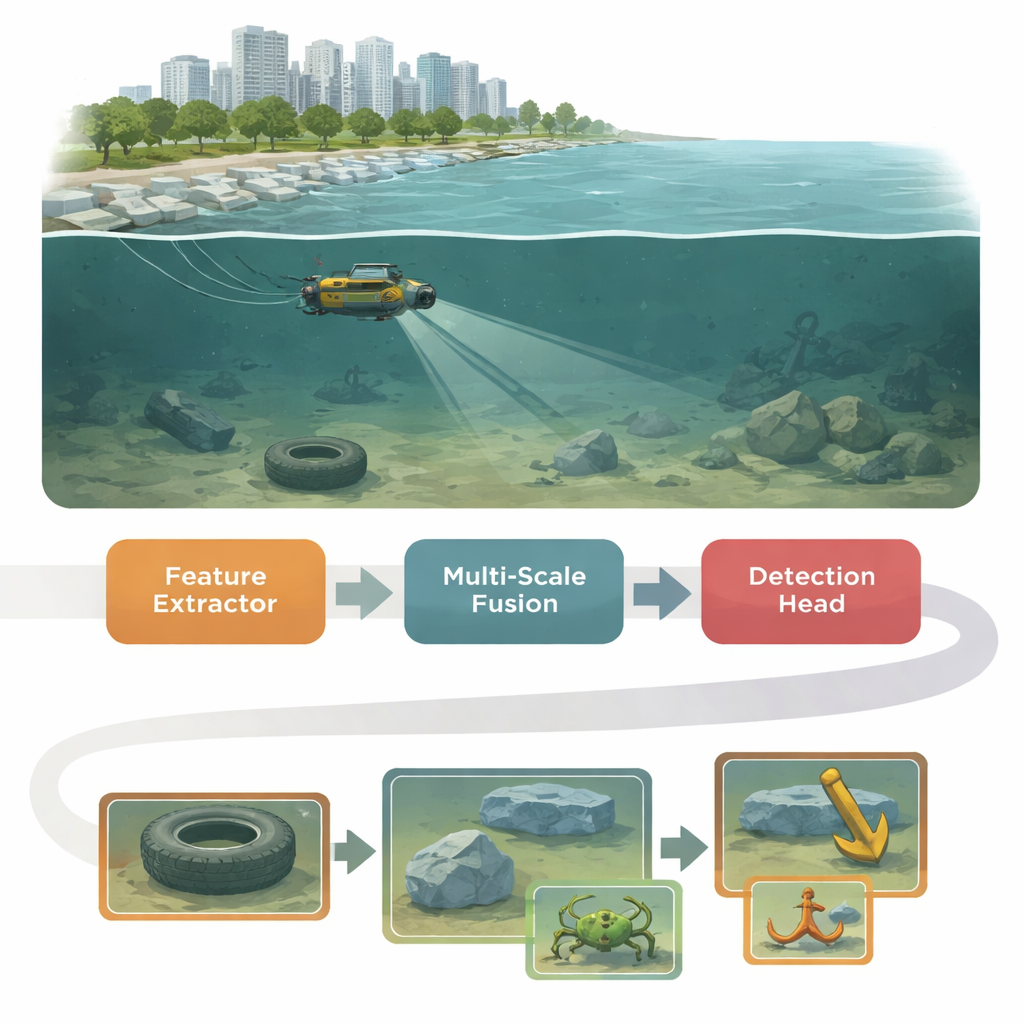

W miarę jak miasta budują więcej ścian, nabrzeży i prefabrykowanych umocnień przy rzekach i jeziorach, wiele kluczowej infrastruktury trafia pod wodę. Sprawdzenie, czy elementy te są stabilne, popękane lub zanieczyszczone gruzem, jest trudne, zwłaszcza w mętnej, płytkiej wodzie o słabej widoczności. W artykule przedstawiono YOLO-MFD — nowy system widzenia komputerowego, który pomaga robotom podwodnym wykrywać małe, słabo widoczne obiekty wzdłuż brzegów szybciej i pewniej, nawet gdy woda jest mętna, a scena zatłoczona.

Dlaczego zdjęcia pod wodą są tak trudne do analizy

Rzeki, jeziora i wody przybrzeżne w miastach rzadko są krystalicznie czyste. Światło jest absorbowane i rozpraszane, barwy przesuwają się w kierunku zieleni lub błękitu, a zawieszone cząstki rozmazują krawędzie. Małe stworzenia, śmieci morskie czy uszkodzenia prefabrykowanych bloków mogą być malutkie, o niskim kontraście i gęsto skupione. Standardowe systemy detekcji obiektów, zaprojektowane pierwotnie do przejrzystych scen ulicznych, często pomijają takie cele lub mylą je z tłem. Jednocześnie roboty inspekcyjne i urządzenia wbudowane używane przy nabrzeżach mają ograniczoną moc obliczeniową, więc rozwiązanie musi być zarówno dokładne, jak i efektywne.

Trójdzielny mózg do pracy w mętnej wodzie

YOLO-MFD bazuje na popularnej rodzinie detektorów YOLO, ale przeprojektowuje jej wewnętrzną „strukturę” w trzech skoordynowanych etapach. Po pierwsze, nowy trzon nazwany CUMANet (Cross-scale Unified Multi-scale Attention Network) uczy się wydobywać cechy z obrazów z uwzględnieniem szerokiego kontekstu. Wykorzystuje równoległe gałęzie i specjalizowaną konwolucję, która podczas treningu zachowuje się jak moduł wielogałęziowy, lecz w fazie wdrożenia upraszcza się do pojedynczej, wydajnej operacji. Dzięki temu sieć potrafi patrzeć poza lokalny szum, wychwytywać dalekosiężne wskazówki i zachowywać istotne detale, które mogłyby zostać zatarte przez mętność i zniekształcenie barw.

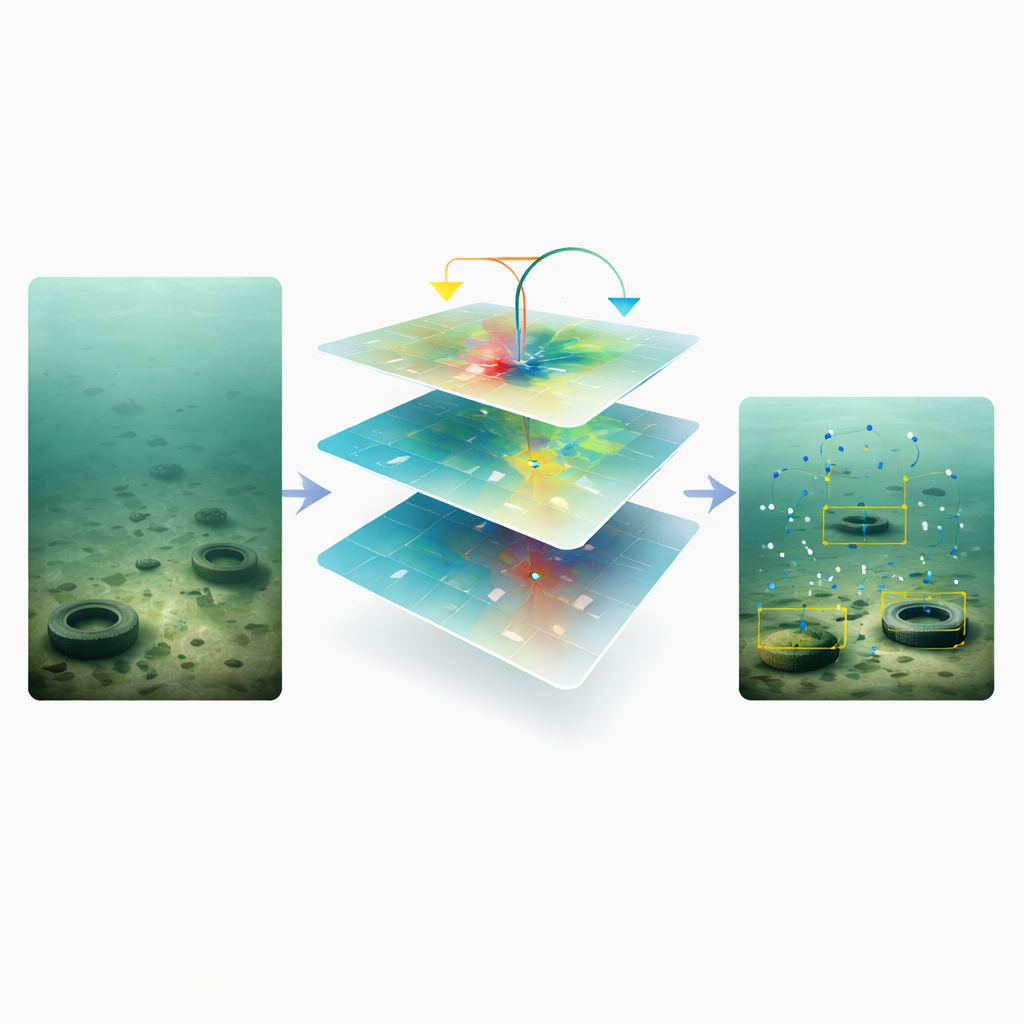

Śledzenie drobnych wskazówek na różnych skalach

Drugi etap, Adaptive Feature Modulation (AFM), rozwiązuje typową słabość systemów wizji: przy łączeniu informacji z różnych rozdzielczości drobne detale często giną. AFM łączy dwie mapy cech, najpierw dopasowując ich rozmiary i kanały, a następnie obliczając łagodne, niezależne bramki dla każdej gałęzi. Zamiast narzucać dominację jednej skali, AFM pozwala obu wnosić wkład, gdy niosą użyteczne sygnały, i dodaje skrót resztkowy, aby uniknąć utraty słabych, lecz istotnych wzorców. Taka zrównoważona fuzja wieloskalowa jest szczególnie pomocna przy wykrywaniu małych ogórków morskich, rozgwiazd czy rys w betonie, które trudno odróżnić od tła.

Bardziej elastyczny moduł decyzyjny

Ostatni etap, DPNDyHead (Dual-Pooling and Normalized Dynamic Head), dopracowuje cechy tuż przed podjęciem decyzji o klasie i lokalizacji obiektów. Zapożycza ideę deformowalnych konwolucji, które przesuwają punkty próbkowania, by lepiej dopasować się do rozmytych lub zniekształconych kształtów pod wodą. Aby poradzić sobie z obiektami o bardzo różnych rozmiarach, DPNDyHead stosuje zarówno pooling średni, jak i maksymalny w różnych skalach, łącząc kontekst globalny z ostrymi lokalnymi odpowiedziami, takimi jak krawędzie czy tekstury. Krok normalizacji stabilizuje statystyki cech przed generowaniem aktywacji specyficznych dla zadań, zmniejszając wpływ przesunięć kolorów i nierównomiernego oświetlenia. W efekcie te zabiegi pomagają zsynchronizować pewność klasyfikacji (co to jest) z precyzją lokalizacji (gdzie jest).

Jak sprawdza się w rzeczywistych warunkach?

Autorzy przetestowali YOLO-MFD na dwóch publicznych zbiorach danych podwodnych z akwakultury i farm otwartego morza, które zawierają wiele małych, zatłoczonych celów oraz silne pogorszenie jakości obrazu. Zarówno na DUO, jak i UDD, nowe rozwiązanie przewyższyło klasyczne detektory dwustopniowe, metody bezkotwicowe, współczesne modele oparte na Transformerach oraz ostatnie warianty YOLO. Osiągnęło wyższe średnie AP i recall — co oznacza, że znajdowało więcej prawdziwych obiektów i popełniało mniej błędów — przy użyciu zaledwie kilku milionów parametrów i umiarkowanej mocy obliczeniowej. Szczegółowe eksperymenty wykazały, że każdy z trzech modułów (CUMANet, AFM i DPNDyHead) wnosił mierzalne korzyści, a ich połączenie dawało najlepszą równowagę między dokładnością, odpornością i szybkością.

Jaśniejszy wgląd dla bezpieczniejszych brzegów

W praktyce praca ta daje robotom podwodnym i systemom monitoringu ostrzejszy, bardziej niezawodny obraz tego, co znajduje się wzdłuż miejskich nabrzeży i umocnionych brzegów rzecznych. Poprzez zaprojektowanie detektora obiektów, który wprost przeciwdziała mętnej wodzie, nierównowadze skali i niezsynchronizowanym predykcjom, autorzy dostarczają narzędzie do lepszego śledzenia stanu infrastruktury, wsparcia badań ekologicznych i inteligentnego zarządzania prefabrykowanymi konstrukcjami brzegowymi. W przyszłych pracach, eksplorujących szersze środowiska i jeszcze lżejsze wersje modelu, metody takie jak YOLO-MFD mogą stać się kluczowym elementem rutynowych inspekcji podwodnych, pomagając utrzymać bezpieczniejsze i lepiej zarządzane miasta nadbrzeżne i drogi wodne wewnątrz kraju.

Cytowanie: Gang, Y., Li, T., Li, S. et al. YOLO-MFD: a multi-scale feature and dynamic head framework for prefabricated shoreline underwater object detection. Sci Rep 16, 10971 (2026). https://doi.org/10.1038/s41598-026-45591-1

Słowa kluczowe: wykrywanie obiektów pod wodą, infrastruktura brzegowa, widzenie komputerowe, autonomiczne pojazdy podwodne, głębokie uczenie