Clear Sky Science · fr

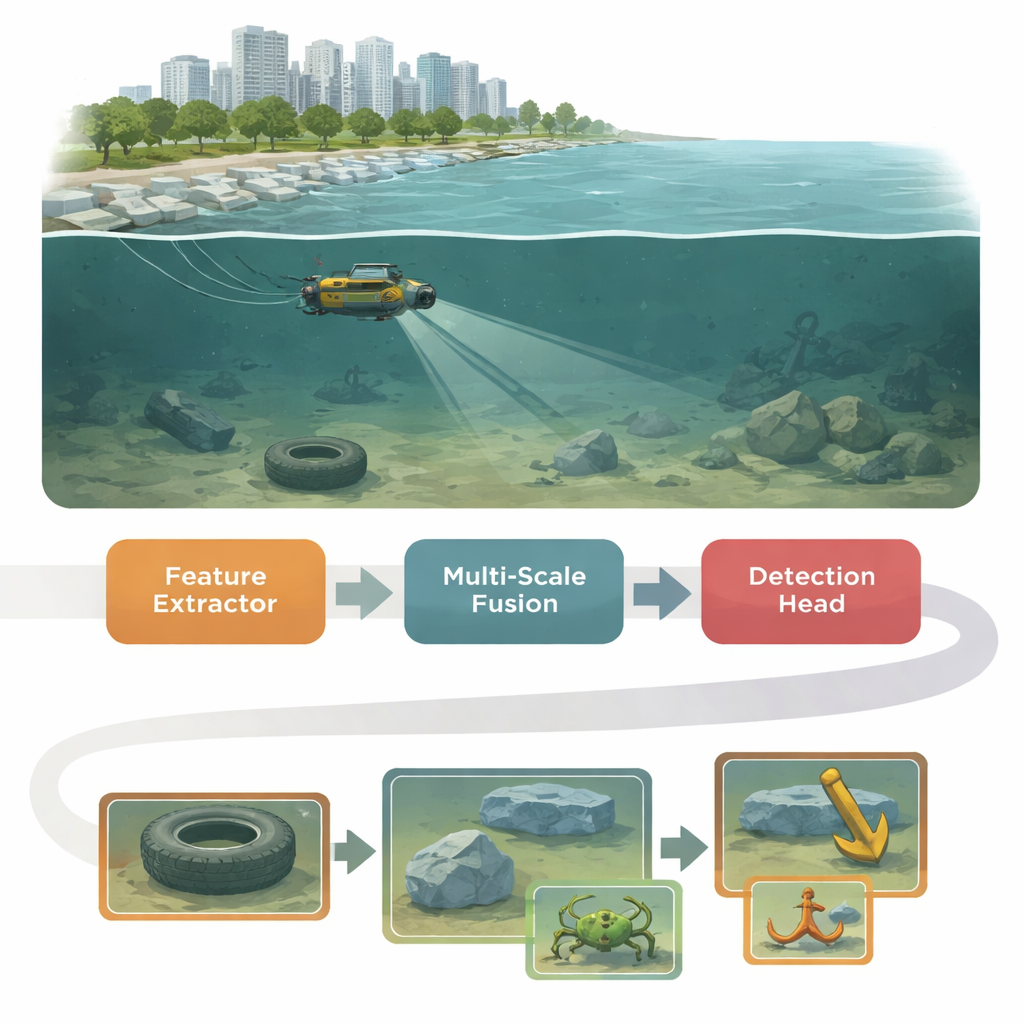

YOLO-MFD : un cadre à caractéristiques multi-échelles et tête dynamique pour la détection d’objets sous-marins le long des berges préfabriquées

Des yeux plus intelligents sous les berges urbaines

À mesure que les villes construisent des murs, des quais et des enrochements préfabriqués le long des rivières et des lacs, une grande partie des infrastructures critiques se retrouve immergée. Vérifier si ces blocs sont stables, fissurés ou encombrés de débris est difficile, surtout dans des eaux peu profondes et turbides où la visibilité est mauvaise. Cet article présente YOLO-MFD, un nouveau système de vision par ordinateur qui aide les robots sous-marins à repérer des objets petits et peu contrastés le long des berges de façon plus fiable et plus rapide, même lorsque l’eau est trouble et que la scène est encombrée.

Pourquoi les images sous-marines sont si difficiles à interpréter

Les rivières, les lacs et les eaux côtières urbaines sont rarement cristallins. La lumière y est absorbée et diffusée, les couleurs se déplacent vers le vert ou le bleu, et les particules en suspension brouillent les contours. De petits organismes, des déchets marins ou des défauts dans les blocs préfabriqués peuvent être minuscules, à faible contraste et densément groupés. Les systèmes classiques de détection d’objets, conçus à l’origine pour des scènes de rue claires, ont tendance à manquer ces cibles ou à les confondre avec le fond. Parallèlement, les robots d’inspection et les dispositifs embarqués utilisés près des berges disposent de ressources de calcul limitées, de sorte que toute solution doit être à la fois précise et efficace.

Un cerveau en trois parties pour l’eau trouble

YOLO-MFD s’appuie sur la populaire famille YOLO de détecteurs en temps réel mais restructure son « cerveau » interne en trois étapes coordonnées. D’abord, une nouvelle architecture de base appelée CUMANet (Cross-scale Unified Multi-scale Attention Network) apprend à extraire des caractéristiques tout en accordant de l’attention au contexte large. Elle utilise des branches parallèles et une convolution spécialisée qui agit comme un module multi-branches pendant l’entraînement mais se simplifie en une opération unique et efficace au déploiement. Cela aide le réseau à dépasser le bruit local, capturer des indices à longue portée et préserver des détails importants malgré la turbidité et la distorsion des couleurs.

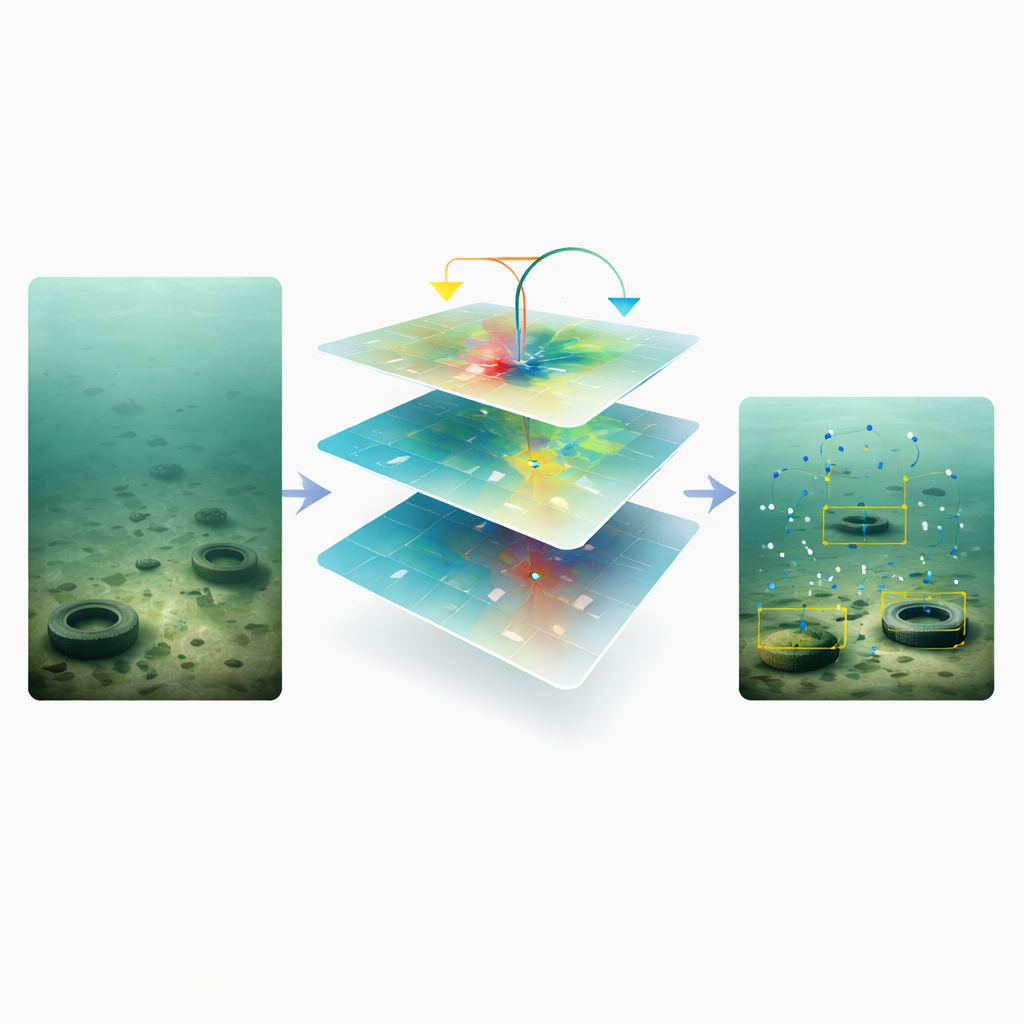

Conserver les indices minuscules à différentes échelles

La deuxième étape, Adaptive Feature Modulation (AFM), s’attaque à une faiblesse courante des systèmes visuels : lors de la fusion d’informations issues de résolutions grossières et fines, les détails de petite échelle sont souvent noyés. AFM rassemble deux cartes de caractéristiques en alignant d’abord leurs tailles et canaux, puis en calculant des portes indépendantes et modulées pour chaque branche. Plutôt que de laisser une échelle dominer, AFM permet aux deux d’apporter leur contribution lorsque chacune contient des signaux utiles, et ajoute un raccourci résiduel pour éviter la perte de motifs faibles mais importants. Cette fusion multi-échelle équilibrée est particulièrement utile pour repérer de petits concombres de mer, étoiles de mer ou fissures dans le béton qui se détachent à peine du fond.

Un décideur final plus flexible

La phase finale, DPNDyHead (Dual-Pooling and Normalized Dynamic Head), affine les caractéristiques juste avant que le système décide quoi et où se trouvent les objets. Elle emprunte l’idée des convolutions déformables, qui déplacent leurs points d’échantillonnage pour mieux suivre des formes floues ou déformées sous l’eau. Pour traiter des objets de tailles très différentes, DPNDyHead utilise à la fois des opérations de global pooling moyen et max sur les échelles, mêlant contexte global et réponses locales marquées comme des bords ou textures. Une étape de normalisation stabilise les statistiques des caractéristiques avant de générer des activations spécifiques à la tâche, réduisant l’impact des changements de couleur et d’un éclairage inégal. Ensemble, ces astuces aident à aligner la confiance de la classification (ce qu’est l’objet) avec la précision de la localisation (où il se trouve).

Que vaut-il dans le monde réel ?

Les auteurs ont testé YOLO-MFD sur deux jeux de données sous-marines publics issus de l’aquaculture et de fermes en mer, qui contiennent de nombreuses cibles petites et serrées ainsi qu’une forte dégradation des images. Sur DUO et UDD, le nouveau cadre a surpassé les détecteurs classiques en deux étapes, les méthodes sans ancres, les modèles modernes basés sur Transformer et les variantes récentes de YOLO. Il a obtenu une moyenne de précision (mAP) et un rappel supérieurs — ce qui signifie qu’il a trouvé plus d’objets réels et commis moins d’erreurs — tout en n’utilisant que quelques millions de paramètres et une puissance de calcul modeste. Des expériences détaillées ont montré que chacune des trois composantes (CUMANet, AFM et DPNDyHead) apportait des gains mesurables, et que leur combinaison offrait le meilleur compromis global entre précision, robustesse et vitesse.

Une vision plus claire pour des berges plus sûres

Concrètement, ce travail offre aux robots sous-marins et aux systèmes de surveillance une vue plus nette et plus fiable de ce qui se trouve le long des berges urbaines et des berges artificielles. En concevant un détecteur d’objets qui contre explicitement l’eau trouble, le déséquilibre d’échelle et les prédictions mal alignées, les auteurs fournissent un outil pour mieux suivre l’état des infrastructures, soutenir les relevés écologiques et guider la gestion intelligente des structures préfabriquées des berges. À mesure que des travaux futurs exploreront des environnements plus larges et des versions encore plus légères du modèle, des méthodes comme YOLO-MFD pourraient devenir un élément clé des inspections sous-marines de routine, contribuant à rendre les villes côtières et les voies d’eau intérieures plus sûres et mieux entretenues.

Citation: Gang, Y., Li, T., Li, S. et al. YOLO-MFD: a multi-scale feature and dynamic head framework for prefabricated shoreline underwater object detection. Sci Rep 16, 10971 (2026). https://doi.org/10.1038/s41598-026-45591-1

Mots-clés: détection d’objets sous-marins, infrastructures riveraines, vision par ordinateur, véhicules sous-marins autonomes, apprentissage profond