Clear Sky Science · it

YOLO-MFD: un framework a più scale di feature e testata dinamica per il rilevamento di oggetti sottomarini su rive prefabbricate

Occhi più intelligenti sotto le rive urbane

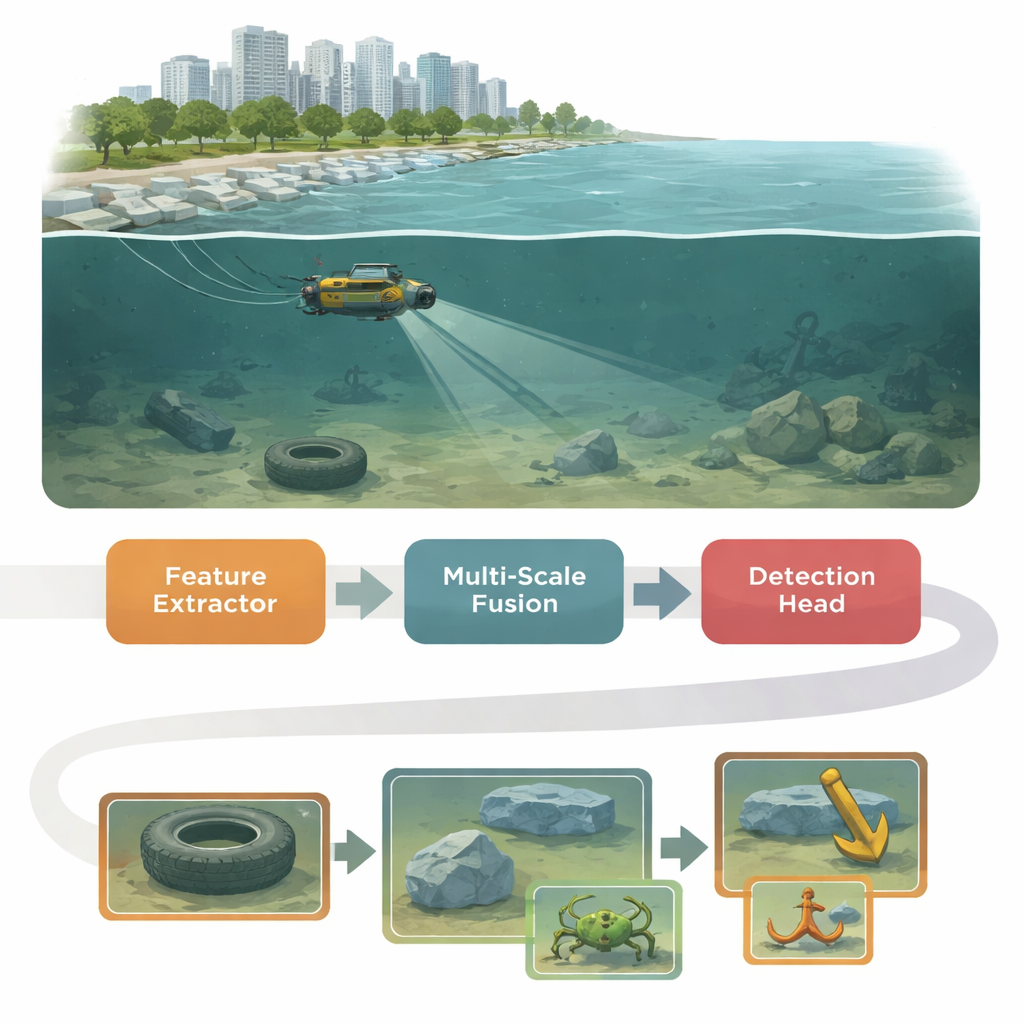

Man mano che le città costruiscono sempre più muri, moli e rive prefabbricate lungo fiumi e laghi, gran parte delle infrastrutture critiche resta nascosta sott’acqua. Verificare se questi elementi sono stabili, crepati o ingombri di detriti è difficile, soprattutto in acque torbide e poco profonde dove la visibilità è scarsa. Questo articolo presenta YOLO-MFD, un nuovo sistema di visione artificiale che aiuta i robot sottomarini a individuare oggetti piccoli e deboli lungo le rive in modo più affidabile e veloce, anche quando l’acqua è torbida e la scena è affollata.

Perché le immagini sottomarine sono così difficili da interpretare

I fiumi, i laghi e le acque costiere urbane raramente sono cristallini. La luce viene assorbita e diffusa, i colori tendono al verde o al blu e le particelle in sospensione sfumano i contorni. Piccoli organismi, rifiuti marini o difetti nei blocchi prefabbricati possono essere minuscoli, a basso contrasto e densamente raggruppati. I sistemi di rilevamento standard, pensati originariamente per scene stradali limpide, tendono a perdere questi bersagli o a confonderli con il rumore di fondo. Allo stesso tempo, i robot di ispezione e i dispositivi embedded usati vicino alle rive hanno potenza di calcolo limitata, quindi qualsiasi soluzione deve essere allo stesso tempo accurata ed efficiente.

Un “cervello” in tre parti per acque torbide

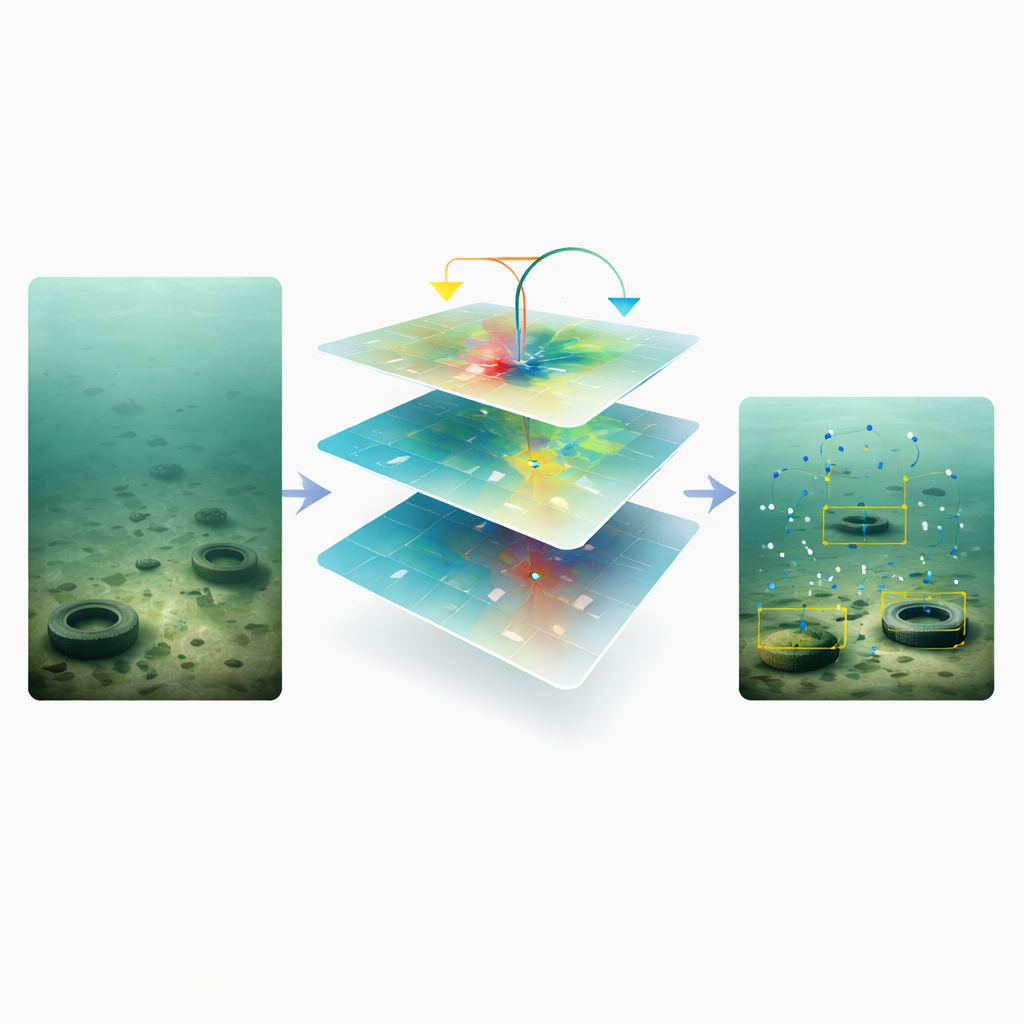

YOLO-MFD si basa sulla popolare famiglia YOLO di rivelatori in tempo reale, ma rimodella il suo “cervello” interno in tre stadi coordinati. Innanzitutto, un nuovo backbone chiamato CUMANet (Cross-scale Unified Multi-scale Attention Network) impara a estrarre feature dalle immagini prestando attenzione al contesto ampio. Utilizza rami paralleli e una convoluzione specializzata che si comporta come un modulo multi-ramo durante l’addestramento ma si semplifica in un’unica operazione efficiente durante il deployment. Questo aiuta la rete a guardare oltre il rumore locale, catturare indizi a lungo raggio e preservare dettagli importanti che altrimenti verrebbero attenuati da torbidità e distorsione cromatica.

Tenere traccia di indizi minuti a scale diverse

Il secondo stadio, Adaptive Feature Modulation (AFM), affronta una debolezza comune nei sistemi di visione: quando si combinano informazioni di risoluzione grossolana e fine, i dettagli su piccola scala spesso vengono sommersi. AFM unisce due mappe di feature allineandone prima le dimensioni e i canali, poi calcolando delle porte leggere e indipendenti per ogni ramo. Invece di forzare la predominanza di una scala, AFM permette a entrambe di contribuire ogni volta che contengono segnali utili, e aggiunge un collegamento residuo per evitare la perdita di pattern deboli ma importanti. Questa fusione multi-scala bilanciata è particolarmente utile per individuare piccoli cetrioli di mare, stelle marine o crepe nel cemento che a malapena emergono dallo sfondo.

Un decisore finale più flessibile

Lo stadio finale, DPNDyHead (Dual-Pooling and Normalized Dynamic Head), affina le feature immediatamente prima che il sistema decida cosa e dove sono gli oggetti. Riprende l’idea delle convoluzioni deformabili, che spostano i punti di campionamento per seguire meglio forme sfocate o distorte sott’acqua. Per gestire oggetti di dimensioni molto diverse, DPNDyHead usa sia pool medi che pool massimi attraverso le scale, fondendo il contesto globale con risposte locali nette come bordi o texture. Un passaggio di normalizzazione stabilizza le statistiche delle feature prima di generare attivazioni specifiche per ciascun compito, riducendo l’impatto degli spostamenti cromatici e dell’illuminazione irregolare. Insieme, questi accorgimenti aiutano ad allineare la confidenza nella classificazione (cos’è l’oggetto) con la precisione della localizzazione (dove si trova).

Quanto è efficace nel mondo reale?

Gli autori hanno testato YOLO-MFD su due dataset sottomarini pubblici provenienti da acquacoltura e allevamenti marini aperti, che includono molti bersagli piccoli e affollati e forte degrado dell’immagine. Sia su DUO sia su UDD, il nuovo framework ha superato i classici detector a due stadi, i metodi anchor-free, i modelli moderni basati su Transformer e le varianti recenti di YOLO. Ha ottenuto una media di Precisione media (mAP) e recall più elevata—cioè ha trovato più oggetti veri e commesso meno errori—pur utilizzando solo pochi milioni di parametri e requisiti di calcolo modesti. Esperimenti dettagliati hanno mostrato che ciascuno dei tre moduli (CUMANet, AFM e DPNDyHead) ha apportato guadagni misurabili, e la loro combinazione ha fornito il miglior equilibrio complessivo tra accuratezza, robustezza e velocità.

Maggiore chiarezza per rive più sicure

In termini pratici, questo lavoro offre a robot sottomarini e sistemi di monitoraggio una visione più nitida e affidabile di ciò che si trova lungo rive urbane e argini ingegnerizzati. Progettando un rivelatore di oggetti che contrasta esplicitamente acqua torbida, squilibrio di scala e predizioni disallineate, gli autori forniscono uno strumento in grado di monitorare meglio lo stato delle infrastrutture, supportare indagini ecologiche e guidare la gestione intelligente delle strutture prefabbricate costiere. Con futuri sviluppi che esplorino ambienti più ampi e versioni ancora più leggere del modello, metodi come YOLO-MFD potrebbero diventare parte integrante delle ispezioni sottomarine di routine, aiutando a mantenere più sicure e meglio manutenute le città costiere e le vie d’acqua interne.

Citazione: Gang, Y., Li, T., Li, S. et al. YOLO-MFD: a multi-scale feature and dynamic head framework for prefabricated shoreline underwater object detection. Sci Rep 16, 10971 (2026). https://doi.org/10.1038/s41598-026-45591-1

Parole chiave: rilevamento di oggetti sottomarini, infrastrutture costiere, computer vision, veicoli sottomarini autonomi, deep learning